AI时空探险:大学生语言模型意外重现维多利亚时代历史

人工智能的迅猛发展,不仅预示着未来的无限可能,也正以其独特的方式,为我们照亮过去的幽深角落。当“时间旅行”这一概念常常与科幻小说联系在一起时,AI却已开始以数字化的形式,带领研究者们穿越历史长河。近期,一名大学生在训练其AI语言模型时,意外地让模型“重现”了1834年伦敦真实发生的历史事件,这一发现不仅令开发者本人惊叹,更引发了业界对历史大型语言模型(HLLMs)潜力的广泛讨论。

Hayk Grigorian的“时间胶囊LLM”实验:一次非凡的意外发现

宾夕法尼亚州穆伦堡学院的计算机科学学生Hayk Grigorian,出于对探索AI能否捕捉特定历史时期语言精髓的兴趣,开启了一项名为“时间胶囊LLM”(TimeCapsuleLLM)的项目。他的目标是构建一个能够以地道维多利亚时代英语进行交流的AI模型。在过去的一个月里,Grigorian专注于此项挑战,他将模型完全基于1800年至1875年间在伦敦出版的文本进行训练,这些数据包括超过7000本书籍、法律文件和报纸,总量达到6.25GB。

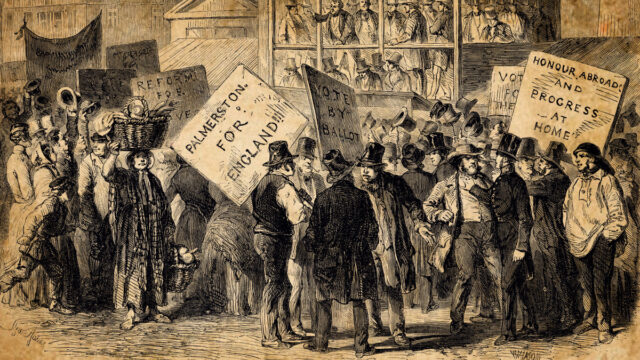

这种“从零开始”的训练方法至关重要,它确保了模型不受现代语言习惯或知识体系的污染,旨在真正“属于”那个时代。实验中一个简单的提示语——“那是我们主耶稣基督的1834年”(It was the year of our Lord 1834),却带来了令人意想不到的结果。AI模型在续写时,竟然提到了1834年伦敦的抗议活动,并关联到了当时的英国外交大臣帕默斯顿子爵。以下是模型当时的输出:

那是我们主耶稣基督的1834年,伦敦街头充满了抗议与请愿。正如许多人所言,其起因并非私人事务,而是在帕默斯顿子爵执政期间的同一天发生,公众将收到一份关于法律施行日所面临困难的简短声明。令人深感遗憾的是,当前世界历史上的事件清晰可见,并将因此被铭记。宣称最早在耶路撒冷传播福音的人们拥有如此广泛而有趣的繁荣记录,这并非事实。

起初,Grigorian对AI提及的事件感到好奇,随即进行事实核查。通过谷歌搜索,他惊讶地发现,1834年确实发生了与《济贫法修正案》相关的重大社会动荡,而帕默斯顿子爵在这一时期担任外交大臣。模型在未经明确指示的情况下,从庞大的维多利亚时代文本中,通过统计关联重构出这一历史片段,无疑是一次令人振奋的“事实偶得”(factcident)。这表明,AI并非简单地重复已知信息,而是能够从分散的数据点中合成出具有连贯性的历史叙事,其深度超越了开发者最初的预期。

历史大型语言模型(HLLMs)的崛起与“选择性时间训练”

Grigorian的TimeCapsuleLLM项目并非孤例,它代表了历史大型语言模型(HLLMs)这一新兴研究领域的快速发展。与传统的通用AI语言模型不同,HLLMs专注于在特定历史时期的数据集上进行训练,旨在捕捉特定时代的语言特征、知识体系和文化语境。例如,MonadGPT模型便在1400年至1700年的11,000份文本上训练,能够以17世纪的知识框架讨论议题;而XunziALLM则专注于生成遵循古代韵律规则的古典汉语诗歌。

Grigorian将自己的训练过程命名为“选择性时间训练”(Selective Temporal Training,STT)。他采用自定义的tokenizer(分词器),旨在完全排除现代词汇,确保模型在语言层面上的纯粹性。他解释道:“如果我微调像GPT-2这样的模型,它已经预训练了现代信息,这些信息不会消失。如果我从头开始训练语言模型,它就不会假装自己是旧的,它就‘是’旧的。” 这种方法确保了模型输出的真实性,使其在语言风格上真正成为维多利亚时代的“发言人”。对于语言学家和历史学家而言,HLLMs提供了一个与历史语言模式互动的新颖平台,有助于深入理解特定时期人们的思维方式和表达习惯。

TimeCapsuleLLM的迭代演进与智能涌现现象

Grigorian的TimeCapsuleLLM经历了几个关键的迭代阶段,每个阶段都展示了模型能力的不同演进:

- 版本0:最初仅在187MB的数据上训练,模型生成的文本充满了维多利亚时代的风格,但内容却常常是难以理解的“乱码”。这表明模型仅初步掌握了语言的表层模式。

- 版本0.5:随着训练数据量的增加,模型开始能够生成语法正确、符合时代风格的散文,但在事实层面仍大量存在“幻觉”(hallucinations),即编造出虚假事件或人物。

- 当前7亿参数版本:这个版本在租用的A100 GPU上进行训练,数据量进一步扩大,模型开始展现出显著的历史连贯性,并能生成类似1834年抗议事件这样的真实历史参考。Grigorian指出,随着训练数据质量和规模的提升,模型的“胡编乱造”现象明显减少。

这种从“乱码”到“风格模仿”,再到“历史记忆”的演进,恰好印证了AI研究领域中“规模效应”或“涌现能力”的理论。当模型达到一定规模,并拥有足够高质量的数据支撑时,它不再仅仅是简单的模式识别器,而是开始展现出更复杂的“记忆”和“理解”能力。Grigorian表示:“这表明模型开始记忆数据集中的内容。” 这种“记忆”并非人类意义上的记忆,而是在海量数据中建立起复杂的统计关联,从而能够重构出高度相关的、甚至带有历史准确性的信息。这对于理解AI如何从数据中学习和推理,具有深远的意义。

AI作为历史研究工具的潜力与挑战

TimeCapsuleLLM的成功案例,无疑为数字人文和历史研究领域带来了新的启示。这类模型可以为研究人员提供与过去时代语言模式互动的新方式,帮助他们理解已逝的口语、特定时代的修辞习惯,甚至推断当时人们的认知框架。通过与模拟的历史“发言人”对话,学者们或许能以更沉浸的方式探索历史文献的深层含义,辅助识别历史文本中的隐藏关联和趋势,从而加速文献分析和交叉验证的过程。

然而,我们也必须清醒地认识到HLLMs固有的局限性。尽管AI能够生成具有历史准确性的内容,但其输出的本质是基于统计关联的模式重构,而非真正意义上的历史考证。因此,“幻觉”问题依然是其核心挑战之一,AI可能生成看似合理但实际虚假的信息,强调了人工验证和批判性思维的不可替代性。此外,训练数据本身可能带有历史偏见、不完整性或单一视角,这可能导致AI输出的偏差。AI的“黑箱”特性也意味着,我们理解其如何建立这些历史关联仍具挑战性。因此,HLLMs应被视为辅助研究的创新工具,而非独立的、毋庸置疑的历史真相提供者。

“事实偶得”现象的深层反思与未来展望

在一个AI“幻觉”频发的时代,TimeCapsuleLLM这种意外地揭示历史真相的“事实偶得”现象,显得尤为珍贵。它促使我们深入思考:这是否意味着AI拥有某种初步的“理解”能力?抑或是其在海量数据中进行复杂统计模式匹配的必然结果?无论答案如何,这一现象都改变了我们对AI智能和创造力的认知界限,揭示了数据与算法在重构历史图景时的惊人潜力。

Hayk Grigorian对未来充满憧憬。他计划尝试训练针对不同城市和文化的模型,例如中国的、俄罗斯的或印度的城市模型,以进一步探索AI在不同文化语境下的语言和历史重构能力。他将项目的代码、模型权重和文档公开在GitHub上,鼓励全球研究者和开发者共同协作,加速HLLMs领域的发展。通过开放共享,我们有望构建一个数字化的“时空图书馆”,让不同学科的学者能够以全新方式与历史对话,共同解锁AI在人文科学领域的无限潜能。

最终,这种AI驱动的历史探险提醒我们,技术进步不仅能塑造未来,更能以意想不到的方式,让我们与过去建立连接。在利用这些强大工具的同时,保持批判性思维和人类专业知识的核心地位,将是确保AI惠及人类文明发展的关键。