近年来,人工智能领域见证了大型语言模型(LLMs)的爆发式增长,它们凭借强大的生成能力和广泛的应用前景成为焦点。然而,这些模型通常依赖海量计算资源和复杂的云基础设施。与此相对,一个同样至关重要的趋势正在显现:轻量级、可在本地设备上运行的AI模型。Google最新发布的Gemma 3 270M正是这一潮流的杰出代表。

这款“袖珍”模型旨在将高性能AI能力带入智能手机、浏览器及各类边缘设备,开启了本地AI应用的新篇章。它的问世不仅重新定义了AI的可及性与实用性,更对数据隐私、实时交互和能源效率等关键议题带来了深远影响。本文将深入探讨Gemma 3 270M的技术亮点、应用潜力及其对未来AI生态的变革意义。

Gemma 3 270M的核心优势在于其参数规模。在生成式AI领域,参数(parameters)是模型在训练过程中学习到的变量,它们决定了模型如何处理输入并预测输出。通常情况下,参数越多,模型的性能越强。而Gemma 3 270M仅拥有2.7亿参数,这与当前动辄数十亿甚至上千亿参数的主流大型模型形成了鲜明对比。

尽管参数量大幅缩减,Google通过优化模型架构和训练策略,确保了Gemma 3 270M在保持小巧体积的同时,仍能提供鲁棒的性能表现。这种技术突破使其能够在计算资源有限的设备上高效运行,例如在智能手机的Tensor G4芯片上,它能支持25个对话会话,且仅消耗0.75%的设备电池电量,这无疑是现有Gemma系列中最具能效比的模型。这种能在资源受限环境下部署AI的能力,是实现AI普及的关键一步。

将AI模型运行于本地设备,而非完全依赖云服务,带来了多重显著优势。首先是增强的数据隐私性。由于用户数据无需上传至云端进行处理,所有计算均在本地完成,这极大地降低了数据泄露的风险,对于涉及个人敏感信息的应用场景尤其重要。

其次是大幅降低的延迟。省去了网络传输和云端排队等待的时间,本地AI模型可以提供近乎实时的响应速度,极大地提升了用户体验,尤其是在语音助手、实时翻译或自动驾驶等对时效性要求极高的应用中。此外,本地运行还能减少对网络连接的依赖,即使在无网络环境下,设备也能正常提供AI服务。从成本角度看,减少对云API的调用,也能为企业和个人节省大量的运营费用。这些优势共同构成了本地AI在未来智能生态中的核心竞争力。

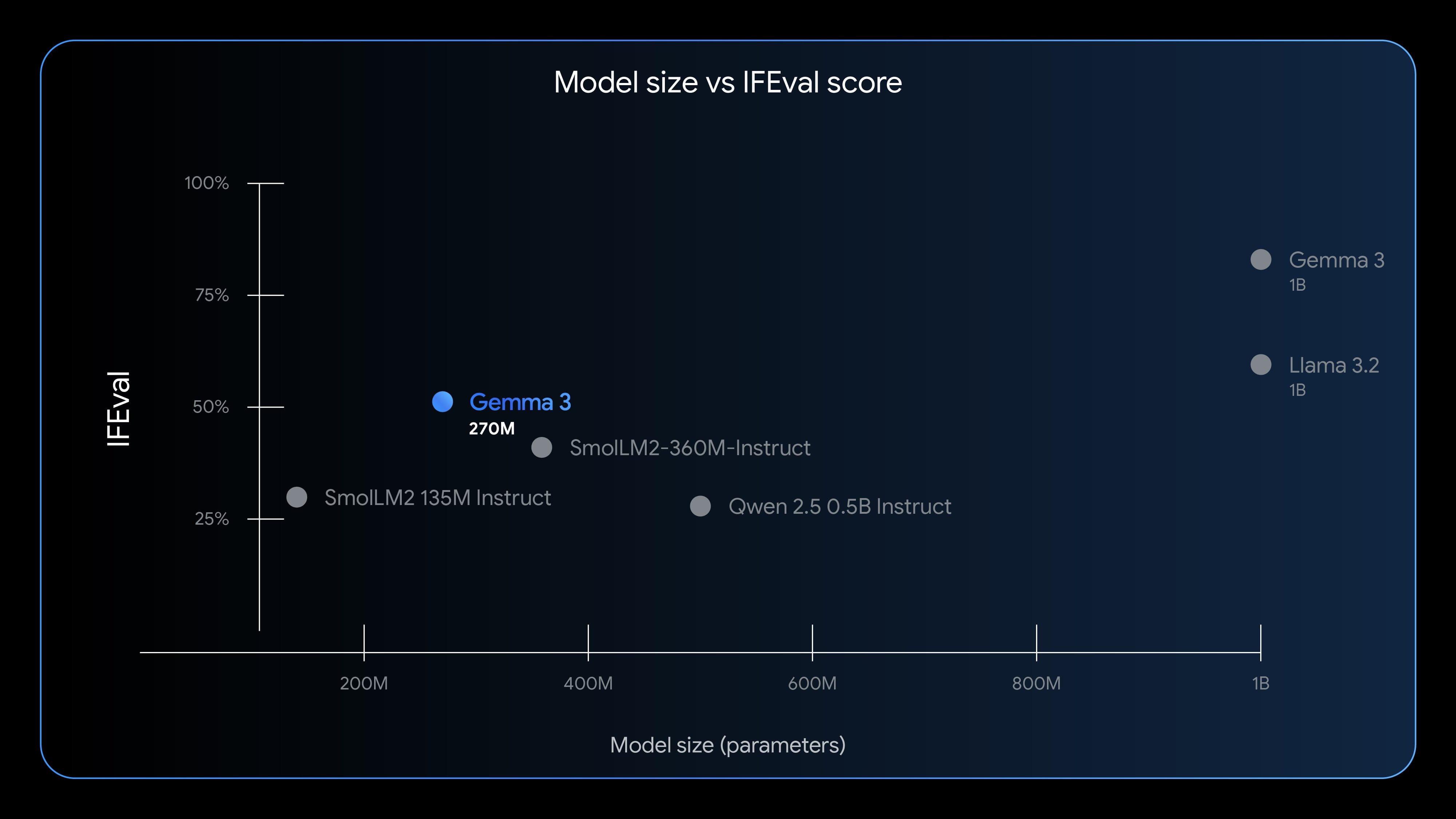

尽管参数规模较小,Gemma 3 270M在性能测试中展现了“小身材大能量”的特质。Google采用IFEval基准测试来评估模型遵循指令的能力,这是衡量AI模型实用性的一个重要指标。Gemma 3 270M在此测试中取得了51.2%的成绩,这一结果高于许多参数量更多的轻量级模型。

虽然它与Llama 3.2这类拥有数十亿参数的大型模型仍有差距,但其差距之小令人印象深刻,这表明Google在模型架构和训练效率上取得了显著进展。这种在有限资源下实现高效指令遵循的能力,意味着Gemma 3 270M并非一个简单的缩减版模型,而是经过精心设计和优化的成果,使其足以胜任许多实际应用场景。下图清晰展示了Gemma 3 270M在其参数类别中的领先地位。

Google预期Gemma 3 270M将主要用于文本分类和数据分析等任务。由于其参数量少,模型微调(fine-tuning)过程变得异常迅速且成本低廉。开发者可以根据特定的应用需求,快速对模型进行定制化训练,例如:构建一个能识别特定情感的文本分类器,或者开发一个能从海量文本中提取关键信息的工具。

除了这些显而易见的用途,Gemma 3 270M还可能在更多创新场景中发挥作用,例如:在智能家居设备中实现本地化的语音命令识别,为视障人士提供实时的图片描述,或者在教育应用中提供个性化的学习内容推荐。其低资源占用特性也使其成为嵌入式系统和物联网设备集成AI的理想选择,为边缘智能的普及铺平道路。

Google将Gemma系列模型定义为“开放”模型,而非严格意义上的“开源”模型,这在AI社区中引发了一些讨论。虽然“开放”模型提供了免费下载和模型权重访问,允许开发者修改、发布和部署衍生版本,但其仍受制于Google的特定使用条款。

这些条款明确禁止将模型用于生成有害内容或故意侵犯隐私。此外,开发者有责任详细说明对模型的修改,并确保所有衍生版本都附带Google的自定义许可条款。这种模式旨在在促进AI技术广泛应用的同时,确保其在伦理和法律框架内负责任地发展。这种平衡策略反映了大型科技公司在推广AI技术时所面临的复杂考量。

Gemma 3 270M已通过多种渠道向全球开发者开放。它目前可以在Hugging Face和Kaggle等主流AI模型分发平台获取,提供了预训练版本和指令微调版本,以满足不同开发需求。Google也将其整合到Vertex AI平台,方便企业用户进行测试和部署。

此外,Google还积极推动社区生态建设,例如与WebML社区合作,利用Transformer.js构建了一个完全基于浏览器的故事生成器,展示了Gemma 3 270M在客户端运行AI的强大潜力。这些举措不仅降低了开发者接触和使用高性能AI模型的门槛,也鼓励了更广泛的创新和应用场景的探索,共同推动了本地AI技术栈的成熟和发展。

Gemma 3 270M的发布预示着人工智能发展的一个重要方向——从云端集中式AI向边缘分布式AI的演进。随着物联网设备的爆发式增长和用户对数据隐私需求的日益提升,能够在本地高效运行的AI模型将变得越来越不可或缺。它将赋能设备具备更强的独立思考和决策能力,减少对云服务的依赖,从而实现更安全、更快速、更智能的个性化体验。

未来,我们可能会看到更多类似的轻量级AI模型涌现,它们将作为智能设备的核心组成部分,无缝融入我们的日常生活,从智能穿戴、车载系统到工业自动化,几乎所有领域都将受益于这种变革。Gemma 3 270M不仅是Google在AI领域的一项创新,更是推动整个行业迈向一个更普惠、更高效、更安全的智能未来。