苹果FastVLM:边缘AI视频理解的新里程碑?

苹果公司近日在Hugging Face平台开放其视觉语言模型FastVLM的浏览器试用版本,此举迅速成为科技界焦点。这款模型以其“闪电般”的视频字幕生成速度闻名,尤其在搭载Apple Silicon芯片的Mac设备上,其处理效率据称比同类模型提升高达85倍。这一宣传无疑描绘了一幅令人振奋的未来图景,但其在实际应用中是否真能如宣传般实现“秒享”体验,仍需我们从技术原理、应用潜力与潜在限制等多个维度进行深入分析。

卓越效率与轻量化设计:FastVLM的核心竞争力

FastVLM最引人注目的优势在于其卓越的效率与极度的轻量化设计。该模型是基于苹果公司自研的开源机器学习框架MLX进行深度优化,并针对Apple Silicon芯片架构进行了特别定制。这种软硬件协同优化的策略,使得FastVLM在性能上实现了显著飞跃。与市场上许多大型视觉语言模型相比,FastVLM的模型体积大幅缩小至约三分之一。这种“瘦身”不仅显著减少了对存储空间和计算资源的占用,更关键的是,它大幅提升了数据处理的速度。

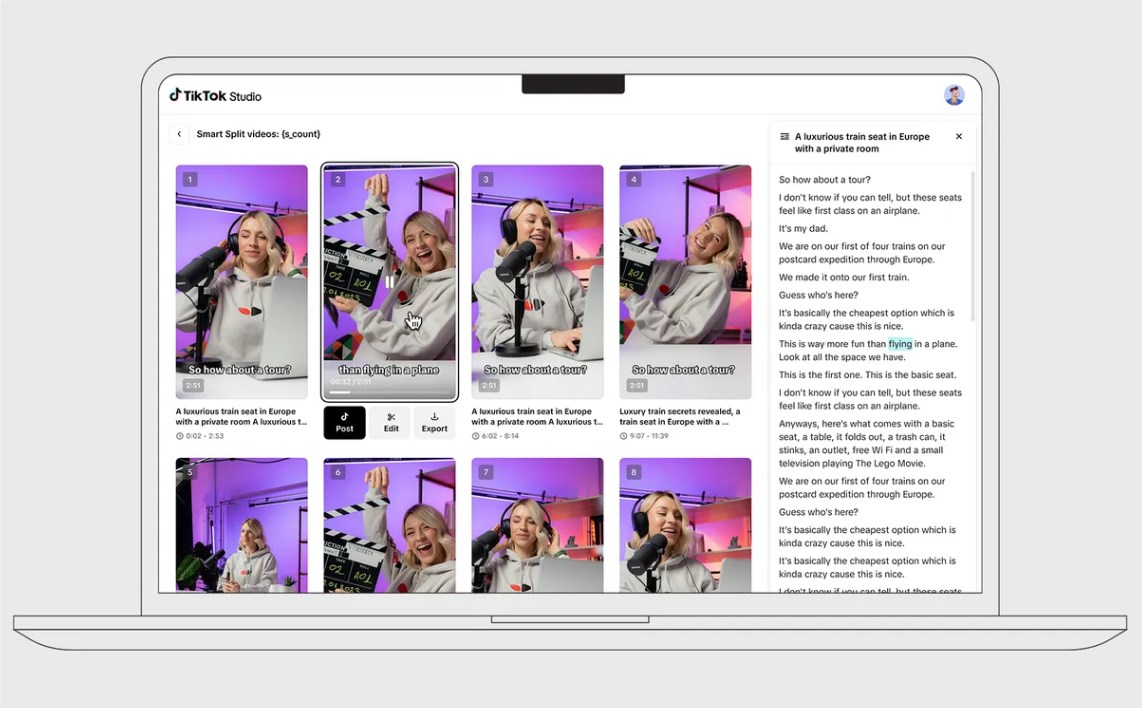

根据业界科技媒体的实测报告,在一台配备16GB内存的M2 Pro MacBook Pro上,尽管首次加载模型可能需要数分钟的初始化时间,但一旦模型完成启动,其便能以惊人的速度和精准度,迅速识别并细致描述视频中的各类元素,包括人物、环境、特定物体,乃至细微的面部表情等。这种几乎实时的性能表现,对于那些需要即时或近实时视频内容理解的场景而言,无疑是极具吸引力的,例如在直播内容分析、快速视频剪辑辅助或智能监控报警等领域。

本地运行能力:数据隐私与低延迟的保障

FastVLM的另一个显著特点是其强大的本地运行能力。这意味着所有的数据处理过程都直接在用户的设备端完成,无需将视频数据上传至云端服务器进行处理。这一设计带来了多重益处。

首先,它彻底消除了因网络延迟带来的处理瓶颈,确保了更快的响应速度和更流畅的用户体验。在追求毫秒级响应的实时应用中,本地化处理的优势尤为突出。

其次,也是更为重要的一点,本地运行机制为用户的数据隐私提供了坚实保障。对于涉及个人隐私、商业机密或敏感内容(如医疗影像、私人录像等)的视频处理任务,无需上传至外部服务器,极大地降低了数据泄露的风险。在当前数据隐私日益受到重视的时代,这一特性无疑提升了FastVLM的吸引力和信任度。

此外,本地化运行还为FastVLM在多样化场景中的应用开启了巨大潜力。例如,在智能眼镜等可穿戴设备中,FastVLM可以实现对周围环境的即时识别与描述,为视障人士提供实时的辅助信息;在实时辅助工具中,它能对复杂场景进行快速理解,从而显著提升用户体验和人机交互效率。其在虚拟摄像头、无人机视觉系统、工业质检等领域的拓展,也拥有广阔前景。

挑战与限制:通往“秒享”的真实路径

尽管FastVLM在效率和本地化方面表现出色,其在实际应用中仍面临一些潜在限制和挑战。理性评估这些因素,有助于我们更全面地认识其价值。

首先,模型首次加载时间较长的问题,可能在某些对启动速度有严格要求的应用场景中构成瓶颈。尽管后续处理速度惊人,但初始的等待时间仍可能影响用户体验。苹果或许需要在未来的版本中进一步优化模型的初始化机制。

其次,FastVLM针对Apple Silicon设备进行了高度优化,这意味着对于非苹果硬件的用户而言,其兼容性与性能可能无法得到同等水平的发挥。尽管MLX是开源框架,理论上可在不同硬件上运行,但在性能表现上,非苹果设备可能难以达到宣传中的极致效果。这在一定程度上限制了其在更广泛硬件生态中的普及速度。

再者,虽然苹果宣传的“高达85倍”的速度提升令人印象深刻,但这一数据可能基于特定的测试环境、对比模型和特定视频类型。在实际使用中,视频内容的复杂度(例如画面运动速度、物体数量、光照条件等)、用户设备的具体配置(如CPU、GPU、内存大小)以及具体的应用场景,都可能导致实际效果与宣传数据产生差异。用户在评估时需保持审慎,并结合自身需求进行实际测试。

从技术演进的角度看,FastVLM的推出深刻反映了苹果在边缘计算和终端AI处理领域的长远投入与战略布局。其将MLX框架与自研芯片紧密结合的策略,不仅进一步强化了苹果生态系统的闭环优势,也为未来智能设备,尤其是下一代个人计算终端的AI能力发展奠定了坚实基础。这预示着未来设备将具备更强大的离线AI处理能力,摆脱对云端的过度依赖。

然而,目前开放的FastVLM-0.5B版本定位为轻量级模型。虽然其在效率上表现非凡,但其在处理高分辨率、超长视频内容,或是进行极其复杂的语义理解任务时的表现,仍有待进一步的验证与功能拓展。对于更高级别的视频分析需求,例如事件检测、情绪识别或细粒度动作理解,可能需要更大型、更复杂的模型版本。

展望:边缘AI视频理解的未来蓝图

总体而言,苹果FastVLM的开放试用无疑为视频字幕生成与更广义的视频内容理解技术带来了新的可能性。其在高速处理与高效率方面的特点令人瞩目,为边缘AI领域树立了新的性能标杆。我们看到,未来智能设备将不再仅仅是信息消费的终端,更将成为强大的本地AI处理中心。

在实际应用中,用户仍需根据自身所拥有的设备条件、具体的应用需求以及对性能的预期,理性评估FastVLM的实际表现。随着苹果对模型的持续优化、MLX框架的进一步成熟以及应用开发者生态的拓展,FastVLM有望在辅助技术、内容创作、智能家居、安防监控等多个智能交互领域扮演日益重要的角色,成为推动终端智能化的关键工具。然而,其是否能真正实现普适意义上的“秒享”体验,最终仍需时间和市场的共同检验,以及用户对其功能边界的持续探索。