引言:AI动作生成领域的新里程碑

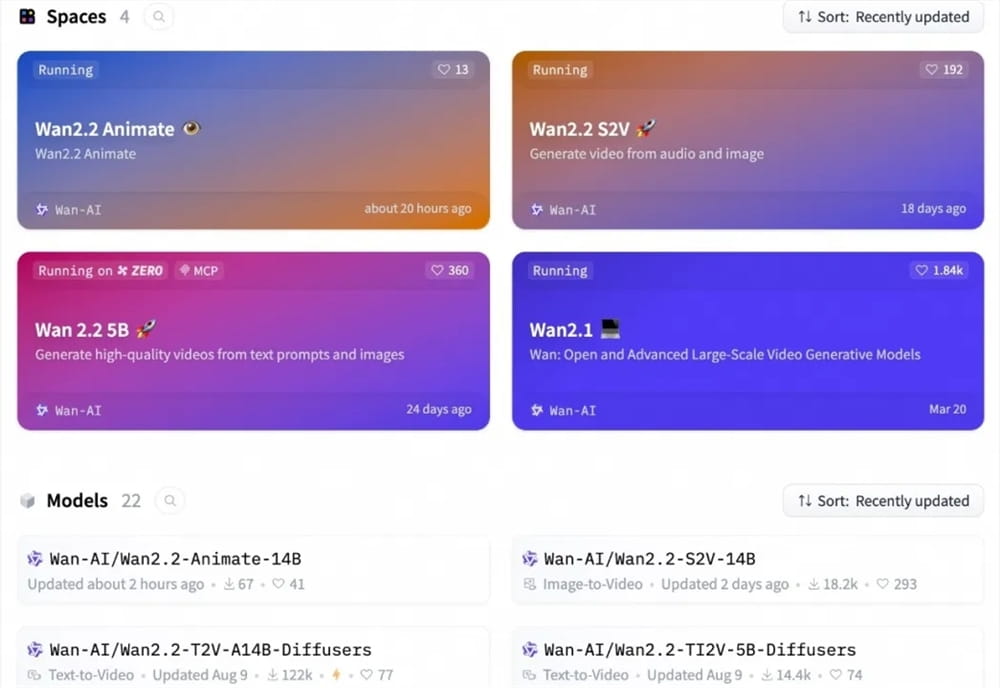

2025年9月19日,阿里云通义万相团队正式宣布其最新研发的动作生成模型Wan2.2-Animate全面开源,此举无疑在全球AI内容创作领域投下了一颗重磅炸弹。作为人工智能视觉技术的前沿探索者,通义万相此次开源不仅是技术实力的彰显,更预示着AI驱动的动态内容生成将进入一个全新的发展阶段。Wan2.2-Animate以其卓越的性能和广泛的应用潜力,正重新定义数字内容创作的边界,为艺术家、开发者和内容创作者提供了前所未有的工具和可能性。

核心技术突破:从Animate Anyone到Wan2.2-Animate的跃升

Wan2.2-Animate并非凭空出现,它是基于此前广受关注的Animate Anyone模型进行的一次全面而深刻的升级。此次升级并非简单的迭代,而是在人物一致性、动作流畅度以及最终生成质量等核心指标上实现了质的飞跃。模型通过深度优化,极大地解决了以往AI动作生成中常见的“鬼影”、“抖动”以及角色特征丢失等问题,使得生成的视频内容更加自然、真实。

Wan2.2-Animate最引人注目的创新之一是其同时支持“动作模仿”和“角色扮演”两种模式。在动作模仿模式下,用户只需提供一张静态的角色图片和一段参考动作视频,模型便能将视频中角色的复杂动作和细微表情精准迁移到图片角色上,赋予其生动的动态表现力。这种模式对于短视频平台的内容创作者而言,意味着可以将任何静态形象转化为跳舞、唱歌或表演的动态角色,极大地丰富了内容形式。而在角色扮演模式下,模型则能在保留原始视频场景、动作及表情的基础上,将视频中的主角替换为用户指定的图片角色。这意味着用户可以轻松将自己或动漫形象置入电影片段、舞蹈教程或任何视频场景中,实现高度个性化的内容创作。

模型架构与创新机制解析

Wan2.2-Animate的卓越表现得益于其精巧的模型架构和一系列创新机制。通义万相团队为此构建了一个涵盖说话、面部表情和身体动作的超大规模人物视频数据集,这为模型的训练提供了丰富而高质量的数据支撑。在此基础上,模型基于通义万相图生视频模型进行后训练,确保了其在视频生成方面的基础能力。

技术核心在于其对角色信息、环境信息和动作的统一表示格式设计。这种设计使得单一模型能够高效且兼容地处理两种推理模式,避免了多模型切换带来的复杂性。为了实现动作和表情的精准复刻,Wan2.2-Animate巧妙地结合了骨骼信号和隐式特征。骨骼信号负责捕捉和传递身体的大尺度运动信息,而隐式特征则专注于面部表情和肢体细节的微观变化。配合专门设计的动作重定向模块,模型能够确保目标角色以高度逼真的方式执行参考视频中的动作和表情。

在角色扮演模式中,团队还特别设计了一个独立的“光照融合LoRA(Low-Rank Adaptation)”模块。这个模块的关键作用在于保证替换后的角色与原始视频场景的光照条件完美融合,消除因光照不一致导致的不自然感,从而实现无缝的角色替换效果。这些技术细节的融合,共同构成了Wan2.2-Animate领先业界的强大实力。

性能标杆:超越开源与闭源模型的卓越表现

在严格的实测评估中,Wan2.2-Animate在视频生成质量、主体一致性和感知损失等多个关键指标上均展现出压倒性优势。数据表明,它显著超越了当前市场上的主流开源动作生成模型,如StableAnimator和LivePortrait。这意味着在输出视频的清晰度、动作的连贯性以及角色形象的稳定性方面,Wan2.2-Animate树立了新的行业标杆。

更令人振奋的是,在专业人士和普通用户参与的人类主观评测中,Wan2.2-Animate的综合性能甚至超越了以Runway Act-two为代表的商业闭源模型。这一成就不仅证明了通义万相在AI动作生成领域的技术领先地位,也为整个开源社区注入了强大的信心,预示着开源力量在未来AI竞争中将发挥越来越重要的作用。

广阔应用前景与行业影响

Wan2.2-Animate的开源将对多个行业产生深远影响:

- 短视频与社交媒体:用户可以轻松创作出个性化、高质量的动态内容,降低创作门槛,极大地丰富平台内容生态。

- 影视动画与游戏开发:模型能够快速生成角色动画,大幅缩短制作周期和成本,尤其适用于角色动作预演、虚拟偶像动画和非玩家角色(NPC)行为生成。

- 广告营销与虚拟人交互:品牌可以利用Wan2.2-Animate为虚拟代言人生成定制化的动作和表演,提升互动体验;在虚拟直播、虚拟客服等场景中,也能赋予虚拟形象更自然的动态表现。

- 教育与娱乐:在教育领域,可用于制作生动形象的教学动画;在娱乐方面,用户可以参与创作,将自己喜爱的角色融入到各种场景中,实现更深度的互动。

Wan2.2-Animate的开源,意味着这些高级的AI动作生成技术将不再是少数大型企业独有的资源,而是向全球开发者和创新者开放,必将激发更为广泛的创新应用和商业模式。

未来展望:AI动作生成的挑战与方向

尽管Wan2.2-Animate取得了显著突破,AI动作生成技术仍面临诸多挑战。例如,在处理极其复杂、精细的动作细节时,如何进一步提升真实感和微表情的准确性;如何在实时应用中保持高性能,并降低计算资源消耗;以及如何确保生成内容的伦理合规性和防止滥用等。未来的研究方向可能包括:

- 多模态融合:结合语音、文本等信息,实现更智能、更自然的动作生成。

- 高精度控制:提供更精细的动作参数调整接口,满足专业创作者的定制需求。

- 场景感知与交互:使生成的角色能更好地与复杂环境进行交互,并根据场景变化做出合理反应。

- 效率与泛化:进一步优化模型效率,提高其在不同风格、不同分辨率素材上的泛化能力。

通义万相Wan2.2-Animate的开源,不仅提供了一个强大的工具,更重要的是,它推动了AI动作生成技术的普及与发展,鼓励全球开发者共同参与到这一领域的探索中。随着社区的持续贡献与迭代,我们有理由相信,AI动作生成技术将以更快的速度演进,解锁更多前所未有的数字创意可能。