引言:科技产业迎来新一轮爆发期

2025年科技产业呈现出前所未有的活力与变革,人工智能领域尤为突出。从Google发布性能碾压竞品的Gemini 3 Pro,到微软与英伟达联合向Anthropic注资150亿美元,再到全球首个AI外教产品斑马口语的上线,AI技术正以前所未有的速度渗透各行各业。与此同时,传统科技巨头如苹果也在积极布局新兴技术,而小米等企业则通过AI赋能实现业务快速增长。本文将全面剖析近期科技领域的重大突破与动态,展现科技产业最新发展态势。

Gemini 3 Pro:AI性能新标杆

Google于11月19日正式在Google AI Studio上线了Gemini 3 Pro的Preview版,并同步开放API。这款新旗舰模型以全面领先的性能表现,成为目前全球最强的AI大模型之一,标志着AI竞赛进入新阶段。

性能指标全面领先

根据Google公布的Model Card数据,Gemini 3 Pro在多个关键标准上实现"碾压"式领先。在极高难度的数学竞赛基准MathArena中,其他模型仍停留在1%左右正确率,而Gemini 3 Pro直接达到23.4%;在Humanity's Last Exam(人类最终大考)上,它以37.5%的成绩远超GPT-5.1和Claude Sonnet 4.5。Google还透露,未公开的Deep Think深度推理模式可进一步提升其表现。

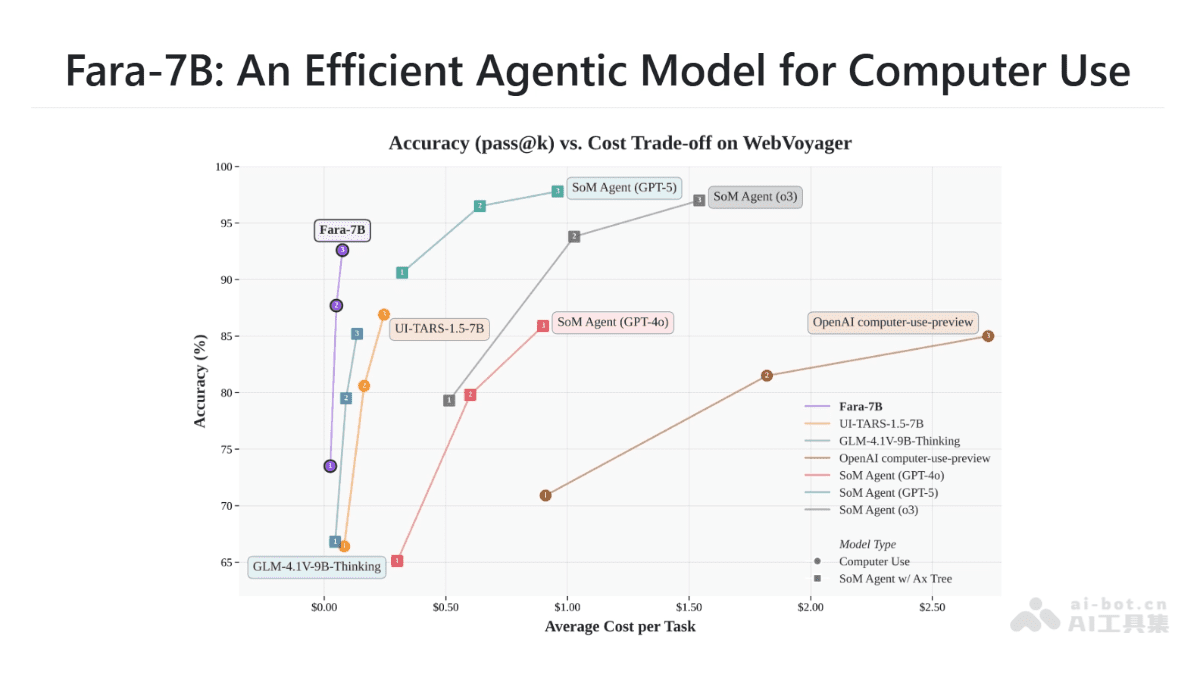

视觉智能实现突破性进展

最具突破性的是Gemini 3 Pro的视觉智能。在屏幕理解(ScreenSpot-Pro)测试中,它达到72.7%,几乎是GPT-5.1的20倍。这意味着AI Agent能第一次"真正看懂屏幕",大幅提升自动化操作电脑的能力。这一突破将为AI在图像识别、视频分析等领域带来革命性应用。

"智能体优先"编程范式

除了模型本身,Google同时发布了全新的Agentic编程平台Antigravity。这一平台提出"智能体优先"的编程范式,可让多个AI Agent并行执行任务,例如自动写代码、运行终端测试、打开浏览器验证UI,并能自主修复错误。这不仅提高了开发效率,也为AI在软件开发领域的应用开辟了新路径,被视为对Cursor等AI编程工具的直接挑战。

AI产业资本再掀热潮

微软与英伟达联手投资Anthropic

11月18日,微软、英伟达和Anthropic宣布建立新的战略合作伙伴关系。作为合作的一部分,英伟达和微软承诺分别向Anthropic投资至多100亿美元和50亿美元。声明称,Anthropic已承诺购买价值300亿美元的Azure计算能力。这一合作不仅体现了科技巨头对AI技术的信心,也反映了AI产业资本市场的持续升温。

Intuit与OpenAI深化合作

同日,商业和财务管理解决方案提供商Intuit已与OpenAI签署一份为期多年的合作协议,合同总价值逾1亿美元。该合作将使Intuit旗下的税务与财务应用集成至ChatGPT平台,并进一步扩大OpenAI大语言模型在其全线产品中的应用范围。用户可通过ChatGPT直接调用Intuit的各项工具,完成如估算退税金额、评估信贷方案等任务,展现了AI在垂直领域的应用潜力。

AI泡沫与理性思考

谷歌CEO警示AI投资风险

在AI投资热潮中,理性声音同样值得关注。11月18日,谷歌CEO桑德尔·皮查伊警告,如果当前的AI投资泡沫破裂,其影响将波及每一家公司,包括Alphabet自身。他指出,尽管AI投资的增长标志着一个"非凡的时刻",但目前的AI热潮中也存在一些"不理性"的现象。

历史经验与未来展望

皮查伊回顾互联网历史,指出行业在投资周期中可能会出现"过度扩张",但他强调,AI将对工作产生深远影响,并呼吁人们在使用AI工具时不要"盲目相信",因为这些模型容易出错。此外,皮查伊也对AI的巨大能源需求发出警告,指出去年AI消耗的电量已占全球总电力消耗的1.5%,强调需要开发新的能源来源和扩大能源基础设施。

科技企业业绩与AI赋能

小米汽车及AI业务实现突破

11月18日,小米集团发布2025年第三季度财报,显示该季度总收入达1131亿元,同比增长22.3%,连续4个季度突破千亿;经调整净利润为113亿元,同比大增80.9%,创历史新高。其中,小米汽车业务及AI等创新业务三季度收入飙升至290亿元,同比增长199.2%,并首次实现单季度经营盈利,达到7亿元。

成功因素分析

小米汽车的成功得益于多方面因素:三季度共交付108,796辆新车,创历史新高,大规模生产使得单车的制造成本分摊降低;高附加值产品Xiaomi SU7 Ultra交付占比提升,拉高了整体收入及利润水平;汽车ASP从25.37万元提升至26.01万元。小米集团合伙人卢伟冰透露,小米汽车预计将于本周完成全年35万台的年度交付目标。

小米手机市场表现强劲

卢伟冰还透露,小米17系列手机销量已破200万,是双十一期间唯一能对抗苹果iPhone的产品。小米17 Pro Max在各大平台均获得6K+价位段国产手机销量、销售额双冠军。财报显示,2025年第三季度小米智能手机出货量为4330万台,同比增长0.5%,连续9个季度实现同比增长。

拼多多稳健增长

拼多多2025年第三季度营收1082.8亿元,同比增长9%,调整后净利润313.8亿元,同比增长14%。本季度,拼多多"千亿扶持"继续加大对生态建设的投入,持续为商家减免服务费,提供流量和资源扶持,展现了电商平台在激烈竞争中的稳健发展策略。

AI技术在垂直领域的创新应用

斑马口语:全球首个AI外教一对一产品

11月18日,斑马口语正式上线。作为全球首个AI外教一对一产品,斑马口语推出超人类AI外教,面向儿童提供系统化口语训练。该产品基于猿力大模型打造,具备超人类教学能力、记忆力、知识储备和超温暖人格,能实现低延迟实时对话、精准发音纠错,并根据学生兴趣动态调整教学内容。

教育领域的AI突破

斑马口语通过"2+1+1"学习模式和生活化场景设计,让孩子在真实语境中提升表达能力,有效解决了传统外教行业水平参差不齐、教学效果难以保障的痛点。作为教育领域首个实现规模化落地的AI Agent产品,斑马口语为AI在教育产业的深耕树立了新标杆,展现了AI技术在教育垂直领域的商业化潜力。

Kosmos:AI科研新范式

11月17日,非营利研究机构FutureHouse发布AI科研系统Kosmos,单次12小时运行即可阅读1500篇论文、生成并执行4.2万行分析代码,输出可溯源报告,工作量相当于人类团队半年产出。系统基于结构化世界模型,在超1000万token上下文中保持逻辑连贯,已在神经科学、材料学等领域完成7项发现,其中4项为首次报道。

自主循环架构实现科研突破

Kosmos采用自主循环架构:并行启动文献检索与数据分析任务→更新内部知识图谱→再规划下一轮探索,平均一次运行迭代166次数据分析与36次文献综述,结论引用精确到代码片段或原文,支持完整审计。实测中,Kosmos独立复现三项尚未发表的研究,包括确认核苷酸代谢为低温脑处理关键通路,并发现钙钛矿太阳能电池60g/m³以上绝对湿度失效阈值。

传统科技企业的创新尝试

苹果3D打印技术应用

11月18日,苹果宣布Apple Watch Series 11和Ultra 3的钛金属表壳全面采用3D打印工艺制造。该技术相较传统工艺减少一半原材料使用,今年已节省400吨钛原料。苹果历时十年攻克规模化生产难题,通过精密控制粉末粒径、含氧量及每层60微米的打印精度,实现高效低碳制造。成品经20小时900层打印后,还需脱粉、切割与光学检测。

可持续发展新举措

此工艺亦应用于iPhone Air的USB-C接口外壳,助力苹果2030年碳中和目标。苹果在3D打印技术上的突破,不仅提高了生产效率,降低了成本,还体现了科技企业在可持续发展方面的积极探索。

iPhone掉色问题引发关注

iPhone 17 Pro Max被湿巾擦掉色的相关话题登上热搜,引发网友热议。有用户发帖称,其购买的iPhone 17 Pro Max星宇橙配色在使用普通湿巾擦拭后,镜头边缘及边框涂层大面积脱落,露出银色铝合金基材。

苹果官方回应

苹果客服对此表示,普通湿巾擦拭是不会影响机器颜色的,但是如果是含高浓度酒精或是其他含腐蚀性液体的湿巾则有可能造成掉漆。苹果客服还称,用普通自来水之类的是不会受影响的。媒体分析认为,该问题或源于生产工艺缺陷,推测在生产后盖时,没有完全密封阳极氧化保护层,导致铝材暴露在空气中氧化变色。

云服务中断引发安全思考

Cloudflare全球网络故障

11月18日,美国网络安全服务商Cloudflare遭遇波及全球的大规模网络故障,导致ChatGPT、社交媒体平台X等多家网站部分用户无法正常访问。美股盘前,Cloudflare股价跌近4%。这家总部位于旧金山的企业在其官网公告称,正就"可能影响多个客户"的问题展开调查。

故障影响分析

Cloudflare的软件服务全球数十万家企业,扮演着网站与终端用户之间的"缓冲器"角色,旨在保护客户网站免受大流量攻击导致瘫痪的威胁。据网络故障监测平台Downdetector.com数据显示,截至美东时间早上6:41,X平台已收到超过11500份问题报告。截至北京时间晚上九点,ChatGPT、X等平台的许多用户依旧无法正常使用相关应用。

安全警示意义

颇具讽刺意味的是,Cloudflare自身的故障状态页面一度也无法打开。这一事件引发了业界对云服务基础设施安全可靠性的深刻思考,提醒企业在数字化转型过程中,不能忽视底层基础设施的稳定性和安全性。

结语:科技产业未来展望

当前科技产业正处于AI驱动的重大变革期,从通用AI模型的突破到垂直领域的创新应用,从科技巨头的战略布局到新兴企业的快速崛起,无不展现出科技产业的蓬勃活力。然而,我们也应保持理性思考,警惕AI投资泡沫,关注AI技术带来的能源消耗、就业结构变化等挑战。未来,随着技术的不断进步和应用场景的持续拓展,科技产业将迎来更加广阔的发展空间,为人类社会带来更多可能性。