在人工智能技术飞速发展的今天,音频领域正经历着前所未有的变革。AI不仅改变了我们创作、处理和消费音频的方式,更在语音合成技术方面取得了突破性进展。2026年3月,上海将迎来一场聚焦AI+语音合成的技术盛宴——GAS26·音频技术快闪活动,作为2026中国国际音频产业大会(GAS)的重要组成部分,这场活动将为行业带来哪些创新与启示?

AI语音合成技术的革命性进展

AI语音合成技术已经从简单的文本转语音(TTS)发展到了能够模拟人类情感、语调和个性化特征的复杂系统。现代AI语音合成系统能够理解上下文语境,调整语速、音调和情感,使合成语音更加自然流畅。这种技术进步为多个行业带来了革命性变化。

技术突破的三大方向

自然度提升:最新的神经网络模型能够捕捉人类语音的细微差别,包括呼吸、停顿和情感变化,使合成语音几乎无法与真人语音区分。

个性化定制:通过少量样本即可克隆特定人物的声音,实现高度个性化的语音合成,这一技术在有声读物、虚拟助手等领域具有广泛应用前景。

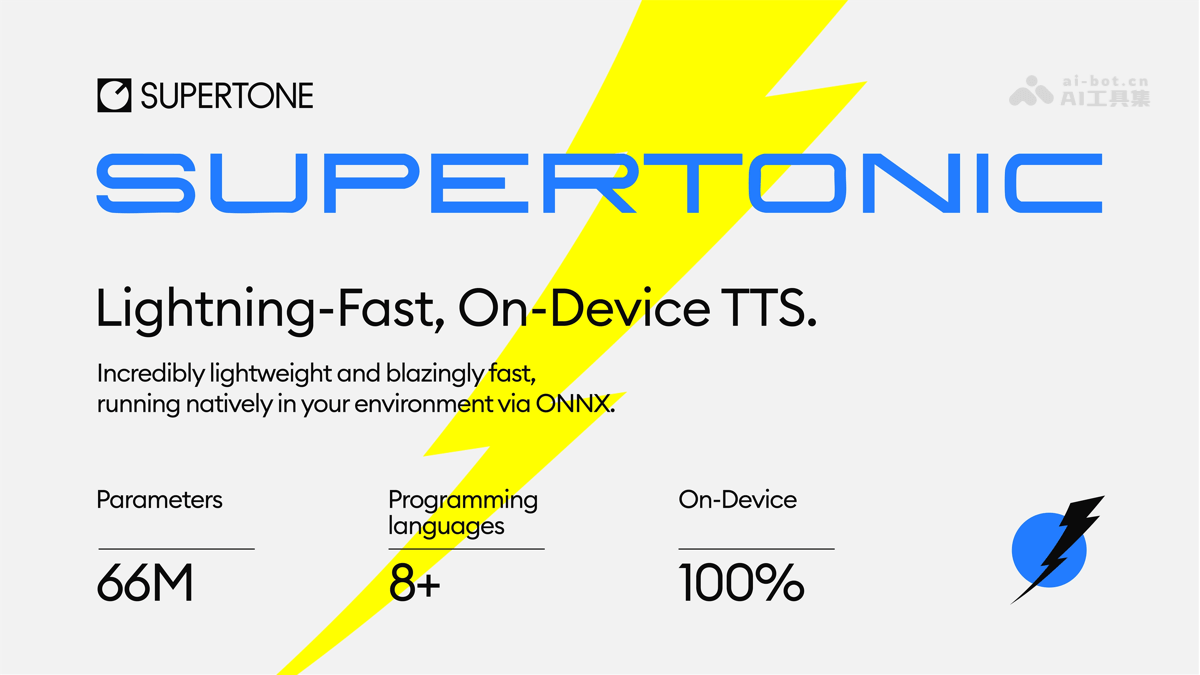

实时性能优化:低延迟的语音合成技术使得实时交互成为可能,为车载系统、智能客服等场景提供了流畅的用户体验。

GAS26·音频技术快闪:行业交流的璀璨舞台

GAS26·音频技术快闪「AI+语音合成」活动不仅是一场技术分享会,更是一个充满活力、开放包容的知识交流平台,为年轻技术先锋提供了展示才华的舞台。活动将于2026年3月25日09:30-12:00在上海浦东张江科学会堂二楼举行,采用免费开放模式,欢迎所有对AI语音合成感兴趣的技术爱好者参与。

活动亮点与价值

- 15分钟极速演讲:每位嘉宾有15分钟分享时间,确保内容精炼、信息密度高。

- 一站体验最新技术:参与者可以近距离了解TTS、VC、语音克隆、实时低延迟方案等前沿技术。

- 与顶尖算法团队面对面:提供难得的行业交流机会,促进技术合作与创新。

- 解锁AI音频落地新场景:探索AI语音合成技术在各行业的创新应用。

演讲嘉宾的权益与机遇

成为GAS26·音频技术快闪的演讲嘉宾,不仅能分享专业知识,还能获得多项实质性权益,为个人职业发展和行业影响力提升创造有利条件。

官方认可与荣誉

演讲嘉宾证书:由中国电子音响行业协会、上海市浦东新区先进音视频技术协会联合颁发,是对专业能力的权威认可。

大会赠票:演讲嘉宾本人可获得价值2560元的大会两日赠票,全面参与GAS2026的各项活动。

招待晚宴:享受大会首日的特别招待晚宴,与行业精英面对面交流。

专属优惠码:获得大会门票专属优惠码,可用于未来参会或推荐他人参会。

影力提升与资源对接

官方媒体宣传:通过GAS大会的官方媒体渠道获得多重宣传与曝光,提升个人和团队的行业影响力。

媒体采访机会:如愿意,可接受大会合作媒体采访,进一步扩大个人影响力。

商业对接与人脉拓展:获得更多商业对接机会,拓展行业人脉,为未来发展奠定基础。

演讲主题与内容要求

为确保活动质量与专业度,GAS26·音频技术快闪对演讲主题和内容有明确要求,旨在分享真正有价值的实践经验和前沿思考。

主题契合度要求

- 大会主题:声态+AI

- 快闪活动主题:AI+语音合成

- 演讲内容:需紧密贴合上述主题,特别是AI+语音合成在消费电子、医疗、音乐、车载等领域的应用探索。

内容质量标准

专业性与实践指导价值:演讲内容应专业深入,具有实践指导意义,帮助参会者积累知识和经验。

思考深度与决策逻辑:深度提炼实践背后的思考过程和决策出发点,为参会者提供有价值的启示和学习点。

案例导向:鼓励分享真实的实践案例,而非纯理论或市场化公关演讲。

原创性与时效性:谢绝半年内在其他大会重复的演讲主题,确保内容的新鲜度和独特性。

AI语音合成技术的应用前景

AI语音合成技术的快速发展为多个行业带来了前所未有的机遇。从消费电子到医疗健康,从音乐创作到车载系统,AI语音正深刻改变着我们的生活方式和工作模式。

消费电子领域的创新应用

在消费电子领域,AI语音合成技术已成为智能设备的核心功能之一。智能手机、智能音箱、智能电视等设备通过高质量的语音合成技术,为用户提供更加自然、个性化的交互体验。未来,随着技术的进一步发展,我们有望看到更多创新的消费电子产品涌现,如具有情感表达能力的虚拟助手、多语言实时翻译设备等。

医疗健康领域的突破

在医疗健康领域,AI语音合成技术正在发挥重要作用。一方面,它可以帮助医生高效记录病历和医嘱,提高工作效率;另一方面,它可以为视障人士提供阅读辅助,让信息获取更加便捷。此外,AI语音合成还在心理健康治疗、语言障碍康复等方面展现出巨大潜力。

音乐创作的新可能

AI语音合成技术为音乐创作开辟了新的可能性。音乐人可以利用这项技术创作独特的声音效果,或者与虚拟歌手合作创作音乐。同时,AI语音合成也为音乐教育和创作民主化提供了工具,让更多人能够参与音乐创作过程。

车载系统的用户体验革新

在车载系统中,AI语音合成技术正成为提升驾驶安全性和舒适度的关键。自然流畅的语音交互可以让驾驶员在行车过程中保持注意力集中,减少分心驾驶的风险。未来,随着技术的进步,车载语音系统将更加智能化,能够理解复杂指令,提供个性化服务,成为真正的智能出行伙伴。

如何参与GAS26·音频技术快闪

对于希望参与GAS26·音频技术快闪「AI+语音合成」活动的技术爱好者和专业人士,活动组委会提供了便捷的报名渠道和清晰的参与流程。

报名方式

参与者可通过扫描二维码,在线填写报名表单。提交完成后,建议保持手机畅通,以便组委会在审核通过后及时联系。活动同时提供中文版和英文版报名表单,方便不同背景的参与者申请。

审核流程

大会组委会将对每一位应邀演讲嘉宾提交的信息进行综合评估,评估标准包括演讲主题的相关性、内容的创新性和实践价值、演讲者的专业背景和行业影响力等。通过评估审核的应邀者将收到正式大会邀请函,确认参与资格。

2026中国国际音频产业大会(GAS)概览

GAS26·音频技术快闪是2026中国国际音频产业大会的重要组成部分,了解整个大会的背景和安排,有助于参与者更好地规划参会体验。

大会基本信息

- 时间:2026年3月25-26日

- 地点:上海张江科学会堂

- 主题:声态+AI

- 主办单位:中国电子音响行业协会、上海市浦东新区先进音视频技术协会

- 承办单位:上海国展展览中心有限公司

大会价值与意义

2026中国国际音频产业大会(GAS)作为音频行业的重要盛会,汇聚了全球顶尖的音频技术专家、企业代表和行业决策者。大会以"声态+AI"为主题,旨在探讨人工智能技术如何重塑音频产业生态,推动行业创新发展。通过参与大会,行业人士可以了解最新技术趋势、拓展商业合作机会、提升个人影响力,共同推动音频产业的繁荣发展。

结语:共同探索AI音频的无限可能

AI语音合成技术正处于快速发展的黄金时期,GAS26·音频技术快闪「AI+语音合成」活动为行业提供了一个展示创新、交流思想、合作共赢的平台。无论您是技术专家、产品经理、行业决策者还是音频爱好者,这场活动都将为您带来宝贵的知识和人脉资源。

加入GAS26·音频技术快闪「AI+语音合成」,共同探索AI音频的无限可能!GAS大会,等你来发声!