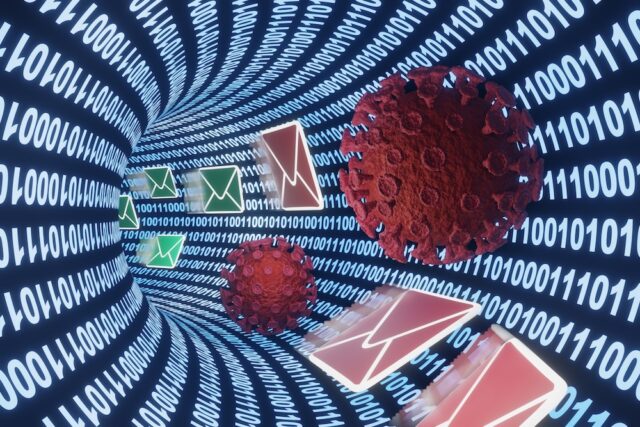

在人工智能技术飞速发展的今天,关于"AI生成恶意软件"的警告不绝于耳。多家安全公司和AI厂商纷纷发布报告,声称AI技术正在被恶意行为者用于开发更先进、更难以检测的恶意软件。然而,谷歌最新的一项研究却给出了截然不同的结论——他们分析的五款AI生成的恶意软件样本不仅表现欠佳,而且极易被检测到。

研究发现:AI恶意软件表现平平

谷歌在11月6日发布的一份报告中详细分析了五款最近出现的AI生成恶意软件样本:PromptLock、FruitShell、PromptFlux、PromptSteal和QuietVault。研究结果表明,这些由生成式AI开发的恶意软件与专业开发的恶意软件相比,表现远低于预期。

以PromptLock为例,这款恶意软件曾被安全公司ESET誉为"首款AI驱动的勒索软件"。然而,谷歌的分析显示,该样本存在明显局限性:它缺乏持久性能力、横向移动能力和高级规避技术。实际上,它更像是一个概念验证,展示了AI在恶意软件开发中的可行性,而非一个真正的威胁。

检测难度低,创新性不足

谷歌的研究人员发现,这五款AI生成的恶意软件样本极易被检测到,即使是依赖静态签名的端点保护解决方案也能轻松识别。所有样本都使用了先前已见过的恶意软件技术,使防御者能够轻松应对。

独立研究员凯文·博蒙特(Kevin Beaumont)在接受采访时表示:"这表明在生成式AI热潮持续三年多后,威胁开发进展缓慢。如果你为这些恶意软件支付了费用,你会愤怒地要求退款,因为这并不显示出可信的威胁或向可信威胁发展的趋势。"

另一位匿名恶意软件专家也认同这一观点:"AI并没有制造出比正常情况更可怕的恶意软件。它只是帮助恶意软件开发者完成他们的工作。没有什么新颖之处。AI肯定会变得更好。但何时以及提高多少程度,谁也说不准。"

质疑行业过度炒作

谷歌的报告对AI公司宣扬的"AI生成恶意软件泛滥论"提出了强有力的反驳。许多AI公司寻求新一轮风险投资,声称AI生成的恶意软件已广泛存在,并构成对传统防御的新范式威胁。

以Anthropic公司为例,他们最近报告称发现一个威胁行为者使用其Claude LLM"开发、营销和分发多种变体的勒索软件,每种都具有高级规避功能、加密和反恢复机制"。该公司还声称:"没有Claude的帮助,他们无法实现或排除恶意软件的核心组件,如加密算法、反分析技术或Windows内部操作。"

然而,这些说法与谷歌和其他安全公司的实际观察形成鲜明对比。谷歌在报告中明确指出,在分析用于开发命令控制通道管理和操作混淆的AI工具时,"我们没有看到成功自动化的证据或任何突破性能力"。

AI公司在安全威胁报告中的角色

值得注意的是,许多AI公司在发布安全威胁报告时,往往强调AI被滥用的可能性,而淡化其局限性。这种做法在一定程度上加剧了市场对AI威胁的恐慌。

例如,初创公司ConnectWise最近声称生成式AI"降低了威胁行为者进入游戏的门槛"。该公司引用了OpenAI的一份报告,该报告发现20个不同的威胁行为者使用其ChatGPT AI引擎开发恶意软件,用于识别漏洞、开发漏洞利用代码和调试代码。BugCrowd也表示,在其对自选个体的调查中,"74%的黑客同意AI使黑客更容易接触,为新人打开了大门"。

AI安全防护机制与绕过尝试

谷歌的报告还提供了另一个有价值的发现:一个威胁行为者通过冒充参与夺旗游戏的白帽黑客,成功绕过了其Gemini AI模型的安全防护措施。

这类竞争性演练旨在向参与者和观察者教授和展示有效的网络攻击策略。所有主流大语言模型都内置了防护措施,防止它们被恶意使用,如网络攻击和自残等。

谷歌表示,他们已经更好地调整了对抗措施,以抵抗此类策略。这表明,尽管恶意行为者正在尝试利用AI技术,但安全研究人员也在不断改进防护机制。

当前威胁仍以传统手段为主

目前出现的AI生成恶意软件大多仍处于实验阶段,结果并不令人印象深刻。值得持续关注的是,AI工具是否能产生以前未知的新能力。

然而,目前最大的威胁仍然主要依赖于传统手段。即使有AI参与,恶意软件开发者也未能突破传统防御机制。这表明,尽管AI技术在不断发展,但在恶意软件开发领域的应用仍处于初级阶段。

未来展望

尽管当前的AI生成恶意软件表现不佳,但这并不意味着未来不会出现更高级的威胁。随着AI技术的不断进步,恶意软件开发者可能会找到更有效的方法来利用这些技术。

安全研究人员需要保持警惕,持续监控AI在恶意软件开发中的应用,并开发相应的防御措施。同时,AI公司也需要负责任地报告安全威胁,避免过度炒作,以免误导公众和行业。

结论

谷歌的研究为我们提供了一个关于AI生成恶意软件现状的客观视角。与行业内的过度炒作不同,实际证据表明,AI在恶意软件开发中的应用仍处于初级阶段,尚未对传统安全防御构成实质性威胁。

然而,这并不意味着我们可以高枕无忧。随着AI技术的不断发展,恶意软件开发者可能会找到更有效的方法来利用这些技术。安全研究人员需要保持警惕,持续监控这一领域的发展,并开发相应的防御措施。

最终,AI技术在恶意软件开发中的应用将如何发展,仍需时间和实践来检验。但可以肯定的是,过度炒作和恐慌无助于我们应对真正的安全挑战。