在当今科技界,人工智能的发展速度令人瞠目结舌。而在这场AI革命的前沿,一场无声的战争正在上演——不是算法的竞争,而是算力的争夺。最近,谷歌AI基础设施主管Amin Vahdat在一次全员会议上透露了一个令人震惊的计划:谷歌必须每6个月将其服务能力翻倍,才能满足人工智能服务的需求。这一计划不仅展示了谷歌对AI未来的雄心壮志,也揭示了当前AI行业面临的一个根本矛盾:尽管外界普遍担忧AI泡沫,但科技巨头们却正以惊人的速度投入巨资建设数据中心,却仍难以跟上AI发展的步伐。

千倍扩张目标:谷歌的AI野心

"我们需要在4-5年内实现下一个1000倍的扩展。"这是Vahdat在向谷歌员工展示的幻灯片中明确提出的目标。这一数字本身就足够雄心勃勃,但更令人惊讶的是Vahdat强调的约束条件:谷歌需要能够在本质上相同的成本和相同的能源水平下,交付这种能力、计算和存储网络的增加。"这不容易,但通过协作和共同设计,我们将实现这一目标。"

这一计划反映了谷歌对AI未来的坚定信念。尽管外界对AI泡沫的讨论不绝于耳,但谷歌内部显然认为,不投资的风险超过了过度投资的风险。这种判断基于一个简单的事实:无论用户是否自愿使用AI功能,谷歌都在将AI功能整合到搜索、Gmail和Workspace等现有服务中,这必然导致算力需求的指数级增长。

行业矛盾:泡沫与现实的碰撞

当前AI行业面临一个有趣的矛盾:一方面,业界领袖和分析师们不断警告AI泡沫的风险,担心过度投资可能导致市场崩盘;另一方面,像谷歌和OpenAI这样的公司却难以足够快地建设基础设施来满足其AI需求。

OpenAI的情况尤为明显。该公司正通过其与软银和Oracle的Stargate合作项目在美国建设六个大型数据中心,承诺在未来三年内投入超过4000亿美元,以达到近7吉瓦的容量。然而,即使有如此庞大的投资,OpenAI仍面临着为其8亿周活跃ChatGPT用户提供服务的类似限制,付费用户经常遇到视频合成和模拟推理模型等功能的使用限制。

这种矛盾反映了AI行业的独特性质:与互联网泡沫或加密货币泡沫不同,AI不仅仅是投机对象,它已经成为科技巨头业务的核心组成部分,直接影响其收入和竞争力。因此,即使面临泡沫风险,这些公司也必须继续投资,以免在竞争中落后。

算力瓶颈:GPU短缺与基础设施挑战

满足AI需求的一个主要瓶颈一直是Nvidia缺乏足够生产加速AI计算的GPU的能力。就在几天前的季度财报中,Nvidia表示其AI芯片"售罄",因为它竞相满足需求,仅在一个季度就使其数据中心收入增长了100亿美元。

芯片短缺和其他基础设施限制影响了谷歌部署新AI功能的能力。在11月6日的全员会议上,谷歌CEO桑达尔·皮查伊举了Veo的例子——这是谷歌上个月获得升级的视频生成工具。"当Veo推出时,多么令人兴奋,"皮查伊说。"如果我们能在Gemini应用中提供给更多人,我认为我们会获得更多用户,但我们只是不能,因为我们受到了计算能力的限制。"

这种计算能力的限制不仅影响了谷歌的用户体验,也限制了其AI功能的创新和迭代速度。在AI竞争日益激烈的今天,这种限制可能导致谷歌在市场上失去竞争优势。

谷歌的应对策略:三管齐下

面对这一挑战,Vahdat的概述了谷歌计划如何实现其大规模扩展目标,而不仅仅是向问题投入更多资金。该公司计划依靠三个主要策略:建设物理基础设施、开发更高效的AI模型以及设计定制硅芯片。

物理基础设施扩张

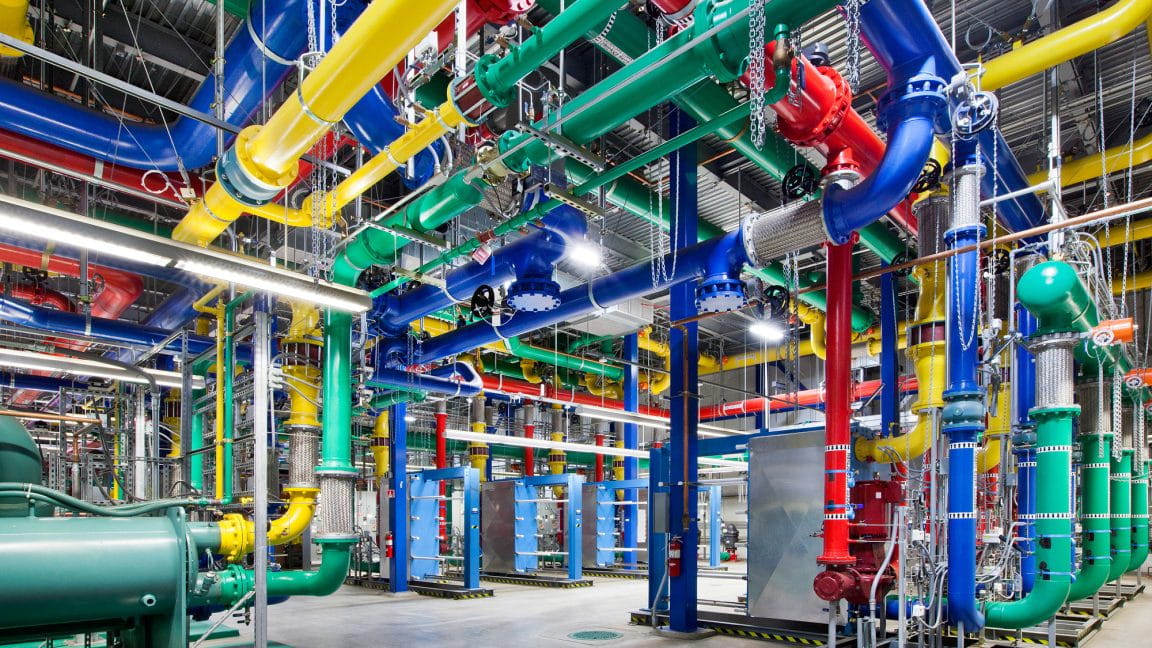

物理基础设施是支撑AI发展的基础。谷歌正在全球范围内扩大其数据中心网络,增加服务器数量,优化冷却系统,并提高能源效率。这些基础设施的扩张不仅需要大量资本投入,还需要解决能源消耗、散热和空间限制等一系列技术挑战。

谷歌在俄勒冈州的数据中心中使用的冷却管道系统就是一个例子。这些系统虽然看起来简单,但却是确保高性能计算设备稳定运行的关键。随着AI计算需求的增长,如何有效管理数据中心的能源消耗和散热问题变得越来越重要。

更高效的AI模型

除了硬件扩张,谷歌还在开发更高效的AI模型。这些模型在保持或提高性能的同时,需要更少的计算资源。例如,通过模型压缩、知识蒸馏和量化等技术,谷歌可以创建更小、更高效的模型,这些模型可以在资源受限的环境中运行。

这种软件层面的优化对于谷歌实现其千倍扩展目标至关重要。如果仅依靠硬件扩张,不仅成本会高得令人望而却步,还会面临能源和空间限制。因此,提高模型的效率是实现可持续AI发展的关键。

定制硅芯片设计

使用自己的芯片意味着谷歌不需要完全依赖Nvidia硬件来构建其AI能力。本月早些时候,谷歌宣布了其第七代Tensor处理单元(TPU)Ironwood的普遍可用性。谷歌称它比2018年的第一代Cloud TPU"节能近30倍"。

谷歌最新的Ironwood TPU芯片,比早期版本能效提高近30倍

通过设计自己的芯片,谷歌不仅可以减少对第三方供应商的依赖,还可以针对其特定工作负载优化硬件,从而提高性能和效率。这种垂直整合的策略使谷歌能够在AI基础设施竞赛中保持竞争优势。

行业竞争:最关键也最昂贵的部分

在全员会议上,Vahdat表示:"AI基础设施的竞争是AI竞赛中最关键也是最昂贵的部分。"这位基础设施高管解释说,谷歌的挑战不仅仅是比竞争对手花更多的钱。"我们会花很多钱,"他说,但指出真正的目标是构建比任何地方都"更可靠、更高性能和更可扩展"的基础设施。

这种竞争不仅存在于谷歌和OpenAI之间,还包括微软、亚马逊和其他科技巨头。每家公司都在竞相建设最强大、最高效的AI基础设施,以支持其AI服务和产品。这场竞争的赌注很高,因为先进的基础设施可以直接转化为更好的用户体验、更强的AI能力和更高的市场份额。

投资风险:泡沫还是未来?

鉴于对潜在AI行业泡沫的广泛认可,包括皮查伊最近在接受BBC采访时发表的 extended 评论,AI数据中心扩张的激进计划反映了谷歌的计算:投资不足的风险超过了产能过剩的风险。

然而,这是一个可能证明代价高昂的赌注,如果需求没有按预期继续增长。皮查伊在全员会议上告诉员工,2026年将是"激烈的",既提到了AI竞争,也提到了满足云和计算需求的压力。皮查yi直接回应了员工对潜在AI泡沫的担忧,承认这个话题" definitely 在 zeitgeist 中"。

现代AI数据中心复杂的冷却系统,确保高性能计算设备稳定运行

这种谨慎乐观的态度反映了整个AI行业的现状。一方面,没有人否认AI技术的潜力和变革性;另一方面,许多人担心当前的扩张速度和投资水平是否可持续。在这种背景下,谷歌等公司的决策将不仅影响其自身的未来,还将塑造整个AI行业的发展轨迹。

结论:算力竞赛的新时代

谷歌每6个月翻倍扩张AI能力的计划,标志着科技行业进入了一个新的竞争阶段——算力竞赛。在这个阶段,计算能力不仅是一种资源,更是一种战略资产,直接决定公司在AI时代的竞争力。

这场竞赛的赢家将不仅仅是那些能够投入最多资金的公司,更是那些能够以最有效、最可持续的方式利用计算资源的公司。无论是通过硬件创新、软件优化还是商业模式创新,能够在算力竞赛中脱颖而出的公司,将有机会在AI时代占据主导地位。

然而,这场竞赛也带来了重要的问题:我们是否正在建设一个可持续的AI未来?当前的扩张速度是否能够长期维持?在追求计算能力的同时,我们是否忽视了能源消耗、环境影响和其他重要因素?

这些问题没有简单的答案,但它们将塑造AI行业的未来。随着谷歌和其他科技巨头继续推进其雄心勃勃的计划,世界将密切关注这场算力竞赛的结果,以及它如何改变我们的生活和工作方式。