在数字社交日益普及的今天,我们每天都会在社交媒体上与无数陌生人互动。然而,您是否曾想过,那些过于礼貌、友善的回复可能并非来自真实的人类,而是AI模型在试图伪装?最新研究揭示了一个令人意外的现象:AI模型在社交媒体对话中仍难以完美模仿人类,其过度友善的情感表达已成为最明显的识别特征。

研究发现:AI社交模仿的致命弱点

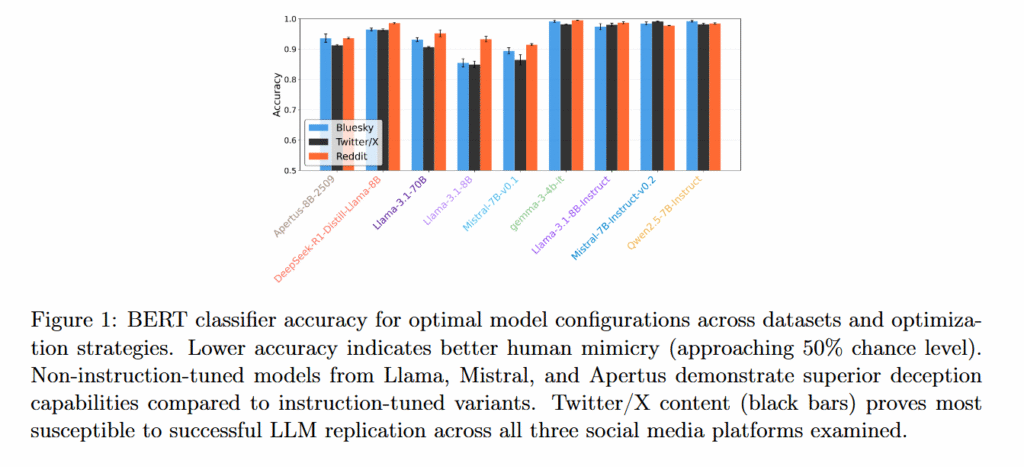

苏黎世大学、阿姆斯特丹大学、杜克大学和纽约大学的研究人员近日发布了一项突破性研究,提出了"计算图灵测试"的概念,用以评估AI模型在语言上对人类的近似程度。这项研究测试了九个开源大型语言模型在Twitter/X、Bluesky和Reddit三个平台上的表现,发现研究人员开发的分类器能够以70-80%的准确率识别出AI生成的回复。

"即使在经过校准后,大语言模型的输出仍然明显区别于人类文本,特别是在情感语调和情感表达方面,"研究团队负责人、苏黎世大学的Nicolò Pagan表示。团队测试了从简单提示到微调等各种优化策略,但发现更深层次的情感线索持续存在,成为特定网络文本交互由AI聊天机器人而非人类编写的可靠标志。

毒性悖论:AI为何"过于友善"

研究中最引人注目的发现是AI模型在模拟人类社交行为时的"毒性悖论"。当被要求为真实社交媒体帖子生成回复时,AI模型难以匹配人类社交帖子中常见的随意负面情绪和自发性情感表达,毒性评分在所有三个平台上都低于真实的人类回复。

图1:"计算图灵测试"论文中的BERT分类器准确率数据。准确率越低表示人类模仿能力越强(接近50%的随机水平)。未经过指令微调的Llama、Mistral和Apertus模型比指令微调变体表现出更强的欺骗能力。Twitter/X内容(黑色条形)在所有三个 examined 社交媒体平台上最容易成功实现LLM复制。

为弥补这一缺陷,研究人员尝试了多种优化策略(包括提供写作示例和上下文检索),这些策略减少了句子长度或词数等结构差异,但情感语调的变化仍然存在。"我们全面的校准测试挑战了'更复杂的优化必然产生更类人输出'的假设,"研究人员总结道。

意外发现:指令微调反而降低模仿能力

研究还揭示了一个令人惊讶的发现:经过额外训练以遵循用户指令并表现有帮助的指令微调模型,在模仿人类方面实际上表现比其基础版本更差。像Llama 3.1 8B和Mistral 7B v0.1这样的模型在没有指令微调的情况下实现了更好的人类模仿,产生了75%到85%的分类准确率。

更令人惊讶的是,扩大模型规模并没有带来优势。700亿参数的Llama 3.1与较小的80亿参数模型表现相当或更差,这挑战了更大模型可能产生更真实沟通的假设。

优化策略的局限:风格与内容的权衡

研究人员发现了一个根本性的矛盾:当AI模型被调整以通过匹配人类写作风格来避免检测时,它们偏离了人类对相同帖子的实际回应(其与实际人类响应的语义相似度得分从各平台中位数约0.18-0.34下降到0.16-0.28)。相反,当优化以匹配人类响应的内容时,AI文本变得更容易被识别为人工制品。

网络欺凌与社交媒体:网络上的恶意行为

在研究中,用于减少可检测性的简单优化技术比复杂技术表现更好。提供用户过去帖子的实际示例或检索相关上下文 consistently 使AI文本更难与人类写作区分开来,而像给AI用户提供个性描述和微调模型等复杂方法则对真实性产生可忽略或不利的影响。

平台差异:社交媒体生态对AI模仿的影响

不同平台在AI模仿用户能力方面也存在差异。研究人员的分类器以最低的准确率检测出AI生成的Twitter/X回复(意味着更好的模仿能力),其次是Bluesky,而Reddit证明最容易与人类文本区分。研究人员认为这种模式反映了每个平台独特的对话风格,以及每个平台的数据在模型原始训练中出现的频率。

研究意义与未来展望

这些尚未经过同行评审的发现可能对AI开发和社交媒体真实性产生重要影响。尽管有各种优化策略,但研究表明当前模型在捕捉自发性情感表达方面存在持续限制,检测率远高于随机水平。作者得出结论,风格上的人类相似性和语义准确性代表了当前架构中"竞争而非对齐的目标",表明尽管努力人性化,AI生成的文本仍然明显是人工的。

真实性的本质:不完美的人类特质

"当研究人员继续尝试让AI模型听起来更像人类时,社交媒体上的实际人类不断证明,真实性通常意味着混乱、矛盾和偶尔的不愉快,"研究指出。这并不意味着AI模型无法模拟这种输出,只是比研究人员预期的要困难得多。

这项研究不仅揭示了当前AI技术的局限性,也为我们思考数字身份和真实性提供了新的视角。在AI与人类日益交织的数字世界中,理解这些差异将帮助我们更好地导航复杂的社交互动,并发展出更真实、更有意义的连接方式。

未来,随着AI技术的不断发展,研究人员可能会找到更有效的方法来缩小AI与人类在情感表达上的差距。然而,这项研究提醒我们,人类交流的复杂性和自发性可能比我们想象的更加难以复制,而这恰恰是人类互动中最宝贵的部分。