引言:语音识别技术的演进与GLM-ASR的定位

语音识别技术作为人工智能领域的重要分支,近年来随着深度学习模型的快速发展而取得了显著进步。从早期的简单语音命令识别到如今能够理解复杂语境、多语种、多口音的高精度识别,语音识别技术已经渗透到我们生活的方方面面。在这一技术浪潮中,智谱AI推出的GLM-ASR语音识别系列模型凭借其卓越的性能和创新的应用场景,成为行业内的佼佼者。

GLM-ASR系列包括云端模型GLM-ASR-2512和开源模型GLM-ASR-Nano-2512,分别针对不同应用场景和需求提供了最优解决方案。本文将全面解析这两款模型的技术特点、性能表现、应用场景及未来发展方向,为语音识别技术的研究者和应用开发者提供参考。

GLM-ASR模型概述

GLM-ASR是智谱AI精心打造的语音识别模型系列,代表了当前语音识别技术的先进水平。该系列模型通过持续优化和创新,在语音识别的准确性、适用性和功能性方面均取得了显著突破。

模型架构与设计理念

GLM-ASR系列模型基于先进的深度学习架构设计,采用了自回归预训练与多任务学习相结合的方式,使模型能够更好地理解语音的语义和上下文信息。这种设计理念使得GLM-ASR不仅能够准确识别语音内容,还能够理解语音中的情感、语调和说话者的意图,从而提供更加智能化的语音交互体验。

模型组成与定位

GLM-ASR系列包含两款主要模型:

GLM-ASR-2512:云端高性能模型,专注于提供最优质的语音识别服务,支持多场景、多语种、多口音的复杂环境,字符错误率仅为0.0717。

GLM-ASR-Nano-2512:开源端侧模型,参数量为1.5B,在保持较高识别准确率的同时,实现了轻量化设计,适合在本地设备上运行,保护用户隐私并降低延迟。

这两款模型分别针对云端和端侧应用场景,形成了完整的产品矩阵,满足不同用户群体的需求。

GLM-ASR的核心技术特点

GLM-ASR系列模型之所以能够在语音识别领域取得卓越表现,离不开其先进的技术特点和创新的设计理念。以下将详细介绍GLM-ASR的核心技术优势。

高精度语音识别能力

GLM-ASR-2512在复杂环境下的字符错误率(CER)仅为0.0717,处于行业领先水平。这一成绩的取得得益于模型采用了先进的声学模型和语言模型,以及大规模语料的训练优化。模型能够有效处理各种噪声干扰、口音差异和语速变化,确保在真实场景中的高精度识别。

GLM-ASR-Nano-2512虽然参数量仅为1.5B,但在多个基准测试中表现优异,平均错误率仅为4.10%,在开源模型中达到SOTA水平。这一成就表明,通过模型架构优化和知识蒸馏等技术,可以在保证性能的同时实现模型的小型化。

多场景、多语种、多口音支持

GLM-ASR系列模型的一大技术优势是其对多样化场景的适应能力。无论是嘈杂的公共场所、安静的办公室,还是远程会议等不同环境,模型都能保持稳定的识别性能。同时,模型支持多种语言的识别,包括中文、英文等主流语言,以及各种方言和口音,为全球用户提供一致的优质体验。

特别值得一提的是,GLM-ASR对粤语等方言的支持进行了专门优化,使得方言识别的准确率大幅提升。这一特性对于方言地区的用户尤为重要,能够有效解决传统语音识别模型在方言识别上的痛点。

低音量语音捕捉技术

GLM-ASR针对低音量场景(如耳语)进行了特殊优化,能够准确捕捉和转录微弱声音。这一技术突破得益于模型对声学特征的精细提取和增强,以及对低信噪比信号的处理能力。在实际应用中,这一特性使得用户在图书馆、办公室等需要保持安静的场所,仍能够使用语音输入功能,而不影响他人。

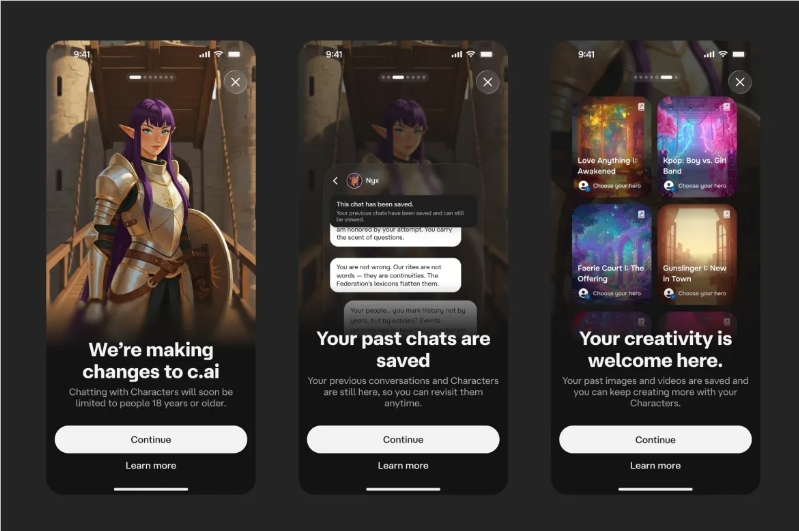

端侧隐私保护机制

GLM-ASR-Nano-2512作为端侧模型,可以在本地设备上运行,无需将语音数据上传到云端,从而有效保护用户隐私。这一特性对于处理敏感信息或对隐私要求极高的场景尤为重要。同时,端侧部署也降低了网络延迟,提供了更快的响应速度,提升了用户体验。

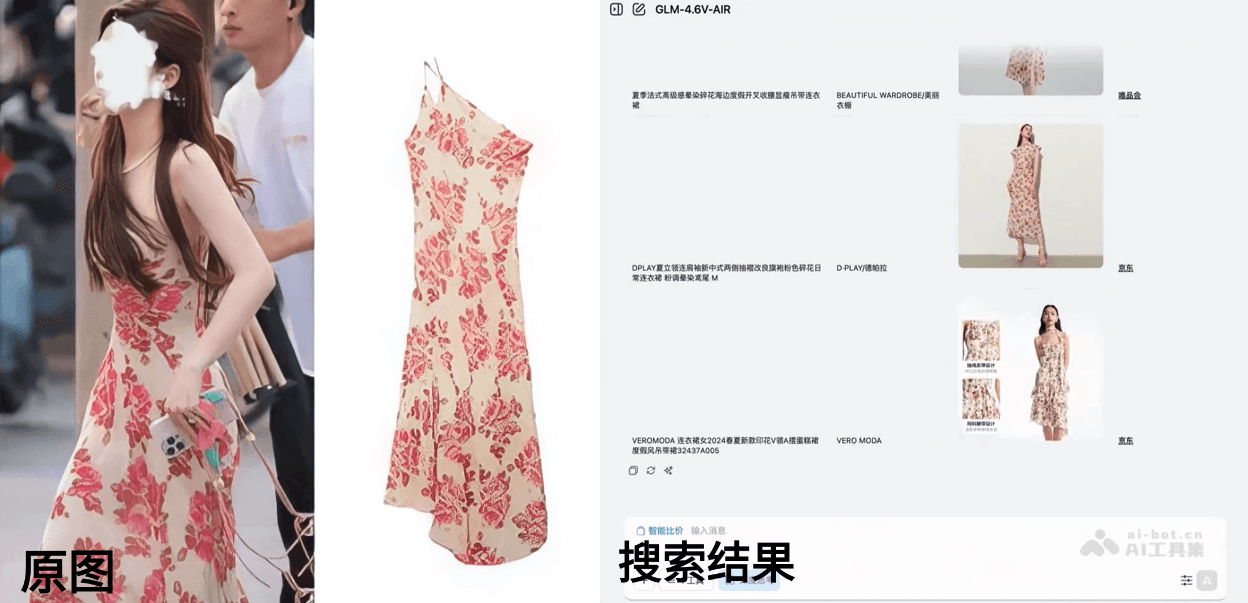

智能交互与功能拓展

基于GLM-ASR的智谱AI输入法不仅实现了基础的语音转文字功能,还拓展了多种智能交互能力。包括翻译、改写、情绪转化等功能,以及"人设