在当今高等教育领域,一场由AI技术引发的静默革命正在悄然改变着学术生态。当伊利诺伊大学的学生们因课堂作弊被教授发现后,他们选择用AI生成道歉信这一行为,不仅暴露了学术诚信的危机,更折射出AI时代教育本质的深刻挑战。

作弊新现象:AI成为学术不端的帮凶

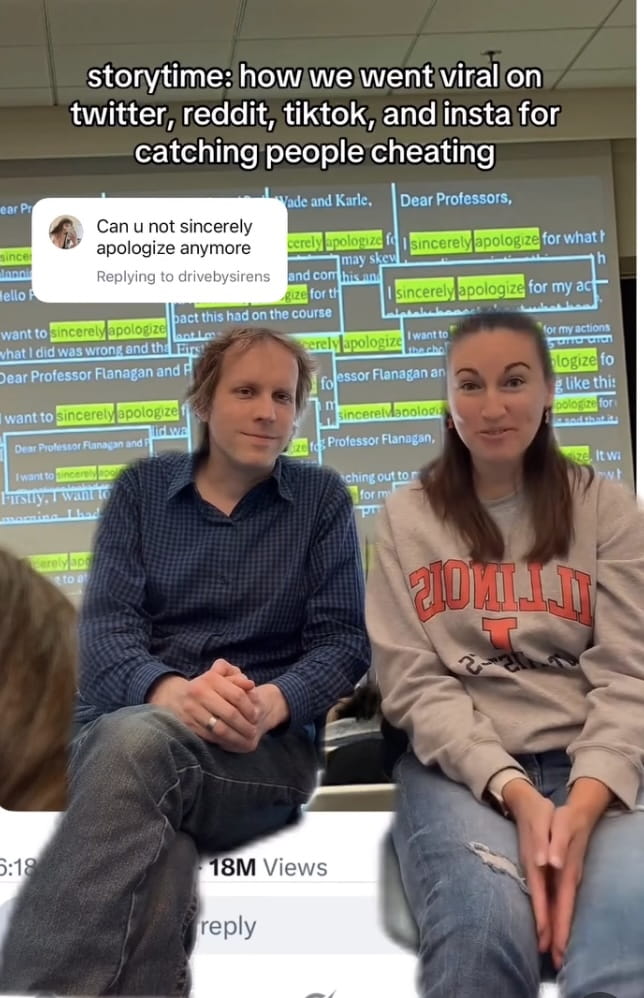

伊利诺伊大学的数据科学导论课程本学期遭遇了一场前所未有的学术诚信危机。这门由统计教授Karle Flanagan和计算机科学家Wade Fagen-Ulmschneider共同教授的大课,拥有超过1000名学生。课程中,教授们使用名为"数据科学点击器"的工具来追踪学生的出勤情况——每天展示一个二维码,学生扫描后需要回答一个个性化选择题,且仅有90秒的作答时间。

然而,教授们很快发现,实际到课人数与系统记录的"出勤"人数严重不符。经过调查,他们发现学生通过共享问题发布时间的方式集体作弊。当教授联系约100名涉事学生要求解释时,收到的道歉信中竟有80%内容高度相似,明显由AI生成。

这一现象并非孤例。在大学校园中,AI已成为学术不端的便捷工具:从生成"个人反思"论文,到解决课程问题,甚至撰写每周75字的简短段落,AI的身影无处不在。一位课程助理抱怨道:"75%的提交作业都充斥着AI生成的垃圾内容。"

AI依赖:思维能力的隐形杀手

当学生将AI视为学习捷径时,他们正在不知不觉中牺牲了最宝贵的能力——批判性思维。教育本质上是思维训练的过程,而AI工具的过度使用恰恰削弱了这一核心功能。

作者Nate Anderson在其关于尼采的新书中深刻指出:"AI生成的摘要风格与ChatGPT的干瘪表达方式,与人类在思想和写作中展现的全新复杂思维相去甚远。" 这种依赖导致学生无法真正消化知识、形成独立见解,更无法培养深度思考的能力。

更令人担忧的是,AI生成的内容往往存在"幻觉"——即编造不存在的信息。当学生依赖这些内容进行学习时,他们接触到的可能是完全错误的知识,这对学术严谨性构成了严重威胁。

检测困境:技术伦理的双向挑战

面对AI滥用的现状,教育工作者面临的最大挑战是检测技术的局限性。现有的AI检测工具准确性不高,经常出现误判:一方面,真正的AI生成内容可能被漏检;另一方面,原创内容可能被错误标记为AI生成。

在伊利诺伊大学的案例中,教授们主要通过分析道歉信的相似性发现问题,而非依赖AI检测工具。这种基于人工判断的方式虽然有效,但在面对大规模课程时显然难以持续。

同时,AI检测技术本身也引发了伦理争议。它可能侵犯学生隐私,并被视为对学生的不信任。如何在维护学术诚信与尊重学生之间找到平衡,成为教育工作者必须面对的难题。

教育转型:重新定义学术诚信

AI时代的学术诚信需要重新定义。传统的学术诚信强调原创性和独立性,而在AI辅助学习的新范式下,我们需要思考:哪些任务应该由学生独立完成?哪些可以合理使用AI工具?

教育专家建议,课程设计应当更加注重AI无法替代的能力培养,如创造性思维、复杂问题解决和情感表达。例如,可以要求学生展示思考过程而非仅提供最终答案,或采用口头答辩、实时写作等AI难以介入的评估方式。

同时,教育机构需要制定明确的AI使用政策,清晰界定何时、何地、何种方式使用AI是合适的,哪些行为构成学术不端。这种明确的指导有助于学生在技术使用与学术诚信之间找到平衡点。

未来展望:人机协作的教育新生态

尽管当前面临诸多挑战,AI技术本身并非教育的敌人。关键在于如何将AI整合为教育工具而非替代品。理想的人机协作教育模式应当:

- 强化元认知能力:教导学生如何评估AI生成内容的质量,培养批判性使用AI的能力;

- 注重过程评估:关注学生的思考过程而非仅看最终成果,鼓励深度学习;

- 个性化学习路径:利用AI分析学生的学习特点,提供针对性的学习资源;

- 培养创造力:设计AI难以替代的创造性任务,鼓励学生发展独特见解。

结语:教育的本质不变

在AI技术飞速发展的今天,教育的核心使命始终未变——培养能够独立思考、批判性分析和创造性解决问题的人。伊利诺伊大学的案例提醒我们,技术应当是教育的助力而非替代品。

对于那些仅将教育视为获取"证书"而非真正学习的学生,AI确实提供了前所未有的便利。然而,对于珍视思维与表达价值的人而言,AI"一键解决"的承诺不过是个虚假的幻象。

最终,教育的价值不在于学生掌握了多少知识,而在于他们如何思考、如何理解世界、如何表达自我。在这个AI日益普及的时代,坚守这一教育本质,或许是我们面对技术变革时最需要的智慧。