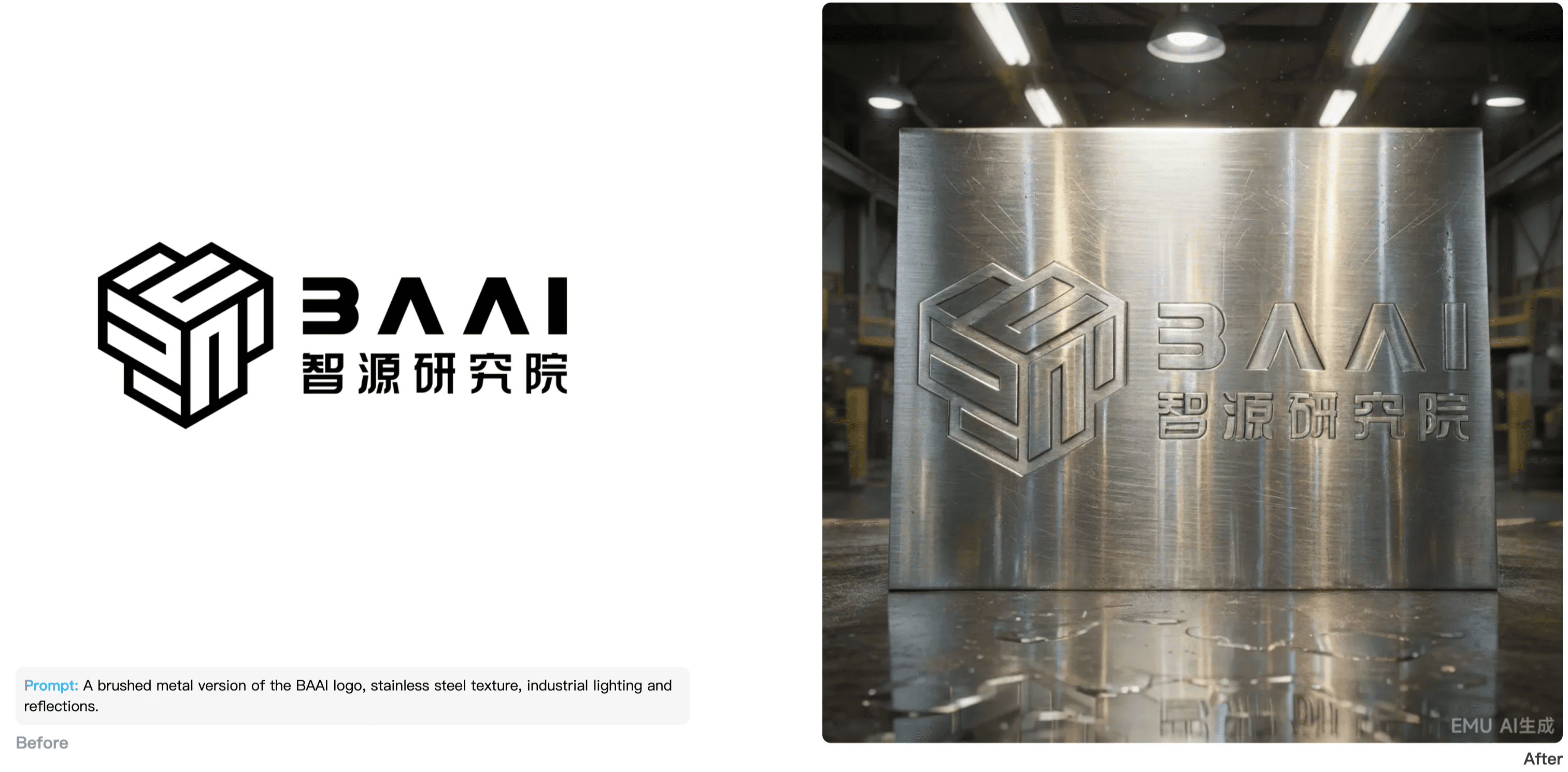

在人工智能领域,大语言模型(LLM)的文本能力逐渐触及天花板,行业迫切寻求新的突破方向。多模态AI,即能够同时处理文本、图像、视频等多种数据类型的智能系统,被视为下一代AI发展的关键赛道。2023年10月30日,智源研究院正式发布的"悟界EMU3.5"多模态世界大模型,不仅解决了多模态领域长期存在的技术难题,更开创了继"语言预训练"和"后训练及推理"之后的"第三种Scaling范式",为AI发展指明了新方向。

多模态AI的统一与效率困境

多模态AI的核心挑战在于如何有效融合不同模态的数据。长期以来,行业存在两种主要技术路径:一种是DiT(Diffusion Transformer)架构,在文生图、文生视频等生成任务上表现出色;另一种则是以智源Emu系列为代表的"原生多模态"架构,尝试从一开始就用统一的模型处理一切。

智源研究院院长王仲远在发布会上表示,EMU3.5的发布标志着人工智能从"语言学习"向"多模态世界学习"演进的新纪元。从一年前验证技术路线的Emu3,到今天宣称"开启新纪元"的EMU3.5,智源研究院解决了多模态AI领域的关键问题。

从"统一"到"高效"的技术突破

智源从Emu3开始就选择了"原生多模态"路线:使用统一的自回归(Autoregressive)架构。自回归架构是目前大语言模型的基石,其范式是"Next-Token Prediction"。智源将其推广到多模态领域,将文本、图像、视频都打散成Token,由模型统一预测。这种方法理论上极其简洁优雅,实现了"图像、文本、视频的大一统"。

然而,这一选择面临着一个致命问题:推理效率太低。当模型生成图像时,需要一个Token一个Token地"吐"出来,过程如同"像素点打印",相较于Diffusion等模型并行的生成方式,速度慢了几个数量级。一个无法高效运行的模型,其"统一"的理论优势很难在实践中落地。

多模态AI的不同技术路径对比

EMU3.5团队提出了一项名为"DiDA(离散扩散自适应)"的创新技术,作为这一难题的解决方案。DiDA是一种高效的混合推理预测方法,它允许自回归模型在推理时并行地预测和生成大规模的Token,从根本上改变了"一个点一个点画"的低效模式。

这一突破带来了显著提升:在不牺牲性能的前提下,每张图片的推理速度提升了近20倍。王仲远谈到,这使得EMU3.5的自回归架构"首次使自回归模型的生成效率媲美顶尖的闭源扩散模型"。

这一工程上的关键突破,补齐了原生多模态路线的核心短板,证明了这条路不仅在理论上可行,在实践中也具备了"可用性"和"可竞争性"。解决了效率枷锁后,通往"规模化"的道路才真正被打开。

第三种Scaling范式的开启

在人工智能领域,"Scaling Law"(规模定律)是过去几年最重要的发现之一。它指的是,只要持续增加模型参数、训练数据和算力投入,模型的性能就会相应地可预期地提升。大模型的成功,正是建立在这一"力大砖飞"的信仰之上。

但在多模态领域,这条路一直不甚明朗。由于技术路线不统一,行业并不确定多模态模型是否存在清晰的Scaling Law。

EMU3.5通过DiDA技术解决效率问题后,智源迅速开始了规模化的验证。从Emu3到EMU3.5的变化清晰地体现了这一点:

- 模型参数:从8B(80亿)跃升至34B(340亿),提升超过4倍;

- 训练数据:累计的视频数据训练时长,从15年猛增到790年,跃升超过50倍;

- 性能:随之获得了显著提升。

基于这一实践,王仲远在发布会上提出了一个大胆的判断:EMU3.5开启了继"语言预训练"和"后训练及推理"之后的"第三个Scaling范式"。

为什么是"新范式"?

智源研究院给出了三个理由来解释为什么称其为"新范式":

- 架构的统一性:EMU的自回归架构能够大一统地处理各种模态的数据,为规模化提供了简洁的基础。

- 设施的可复用性:这一架构可以"大规模复用已有的计算基础设施"。这意味着,所有为训练LLM而构建的昂贵智算集群,几乎都可以无缝迁移过来训练EMU模型,极大降低了Scaling的门槛。

- 强化学习的引入:EMU3.5首次在多模态领域实现了大规模强化学习(RL)。强化学习(尤其是RLHF)是激发LLM高级能力、使其"听话"的关键步骤。如今,智源将这套在语言上被验证过的成熟方案,成功地应用到了更复杂的多模态模型上。

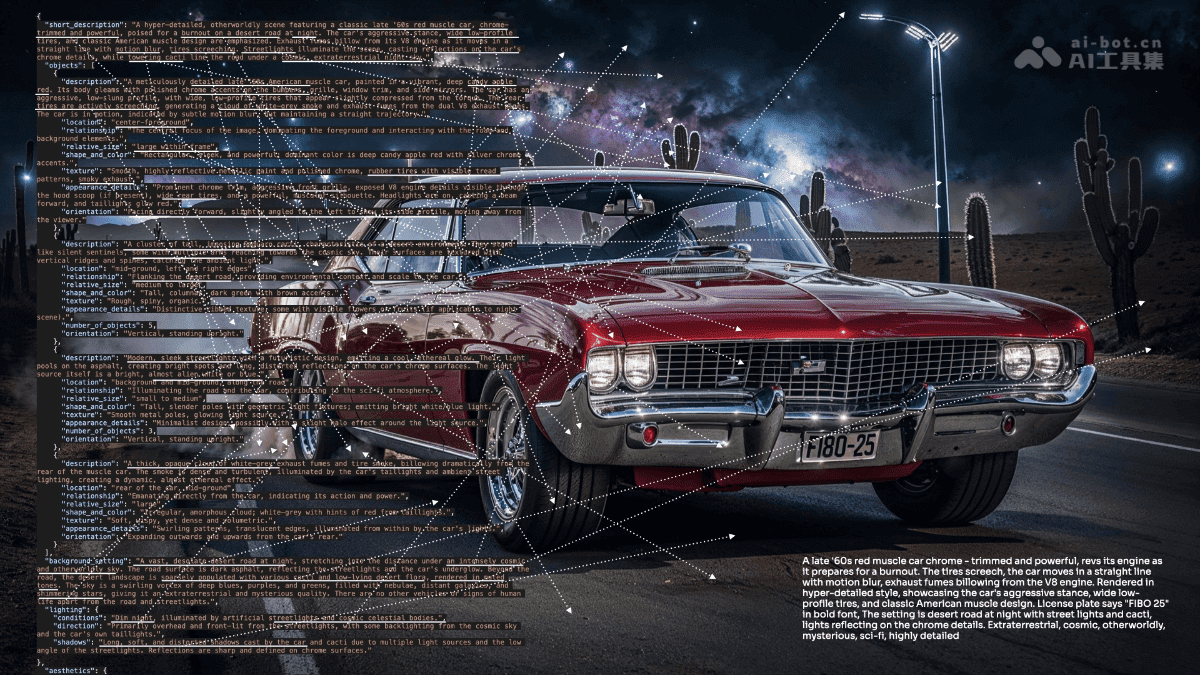

EMU3.5能以精准可控的方式完成文图生成

"Scaling范式"的意义在于"可预期"。而EMU3.5的潜力才刚刚开始释放。王仲远在现场提到,目前34B的参数规模,相比LLM动辄万亿的规模还很小;而790年的视频数据量,"只占全互联网公开视频数据不到1%"。

这意味着,无论是在模型参数还是在数据维度上,这条路都还有着巨大的提升空间。只要沿着这条路继续"力大砖飞",模型能力的上限远未到来。

从"预测Token"到"预测状态"的范式转变

如果说,解决效率问题和开启规模化,回答了"怎么做"的问题,那么EMU3.5的另一大转变,则是在回答"学什么"的问题。

智源团队在发布会上反复强调"第一性原理"(First Principles)。王仲远举了一个观察两岁小女孩的例子:她通过刷短视频,观察视频里的人如何吃糖葫芦,然后在现实世界中模仿、尝试、失败、再尝试,最终自己学会了串糖葫芦。

他强调人类的学习,不是从文本开始的,而是从对这个世界、对物理规律的视觉观察开始的。这也是EMU3.5试图模拟的核心理念:AI不应只学习"语言",更应学习"世界"。

Next-State Prediction(NSP)的提出

为此,EMU3.5提出了一个核心范式的升级:从Emu3的"Next-Token Prediction"(预测下一个词元),升级为"Next-State Prediction (NSP)"(预测下一个状态)。

这个转变意味着模型的目标,不再是机械地"续写"数据(比如预测下一个像素或下一个词),而是要理解事物背后的因果和规律,预测世界在逻辑上的"下一个状态"。

基于此,智源也对"世界模型"这一概念提出了自己的定义。王仲远直言,不完全赞同"世界模型就是视频生成"的观点。他认为,世界模型的核心,是"对于整个世界因果关系、时空、物理建模的能力"。

他用一个"桌边的咖啡"的例子来说明:

- 一个"视频生成模型",也许能预测出"杯子掉落、咖啡洒一地"的逼真画面。

- 但一个"世界模型",首先应该理解"这个杯子放得很危险(状态)",并预测"它很可能会掉落(状态变化)"。

更进一步,当接收到"拿起这杯咖啡"的指令时,这个模型会基于对物理常识(纸杯的力度、重心的位置)的理解,来规划"下一步的行动"。

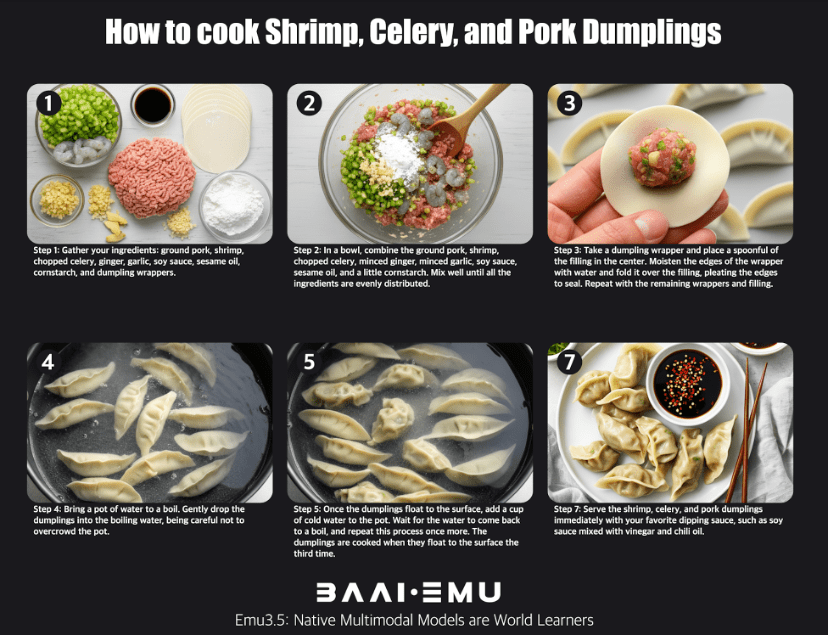

EMU3.5的多模态指导能力:输入"如何做芹菜饺子",模型输出有步骤的图文指导

能力进化:从理解到行动

EMU3.5展现出的许多能力,都在印证这种从"理解"到"行动"的进化:

- 意图规划:当用户输入"如何做芹菜饺子"时,模型输出的不是零散的图片,而是一套图文并茂、步骤清晰的"行动指南"。

- 动态模拟与推理:在一个示例中,模型需要根据图案规律,在"?"处填上合适的颜色。这要求模型必须先"理解"图案的排布规则(一种逻辑状态),才能"生成"正确的红色方块(下一个状态)。

- 时空理解:模型可以将一张建筑的正面图,根据指令转换为"俯视图"。这背后是模型对物体三维空间关系的建模。

这种"预测下一个状态"的能力,最终指向了人工智能的终极应用之一:具身智能(机器人)。

为具身智能提供"大脑"

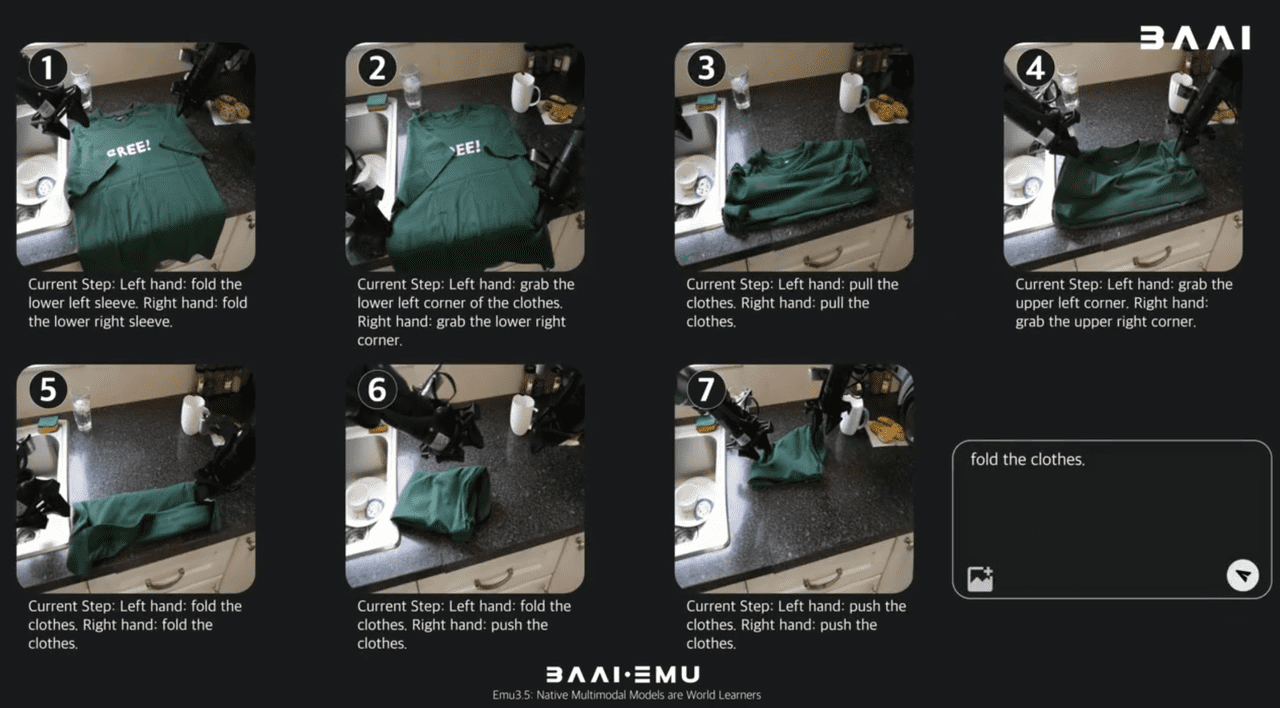

具身智能行业目前面临数据匮乏的瓶颈。而EMU3.5这样的世界模型,可以通过对物理世界的理解和模拟,为机器人生成海量、高质量、且多样化的"仿真训练数据"。例如,在"叠衣服"的演示中,模型自主规划并生成了机器人完成复杂折叠动作的完整序列。

只需一句"叠衣服"的简单指令,Emu3.5便能自主规划、拆解任务,并精确生成机器人完成一整套复杂的折叠动作

王鑫龙博士在交流中提到,利用EMU3.5的世界模型能力,机器人在"没见过的场景"中执行任务,成功率可以"直接(从0%)到70%"。这表明,EMU3.5正在扮演的,是具身智能"大脑"的角色,即提供理解、规划和泛化的核心智能。

多模态AI的未来展望

EMU3.5的发布,首先通过DiDA技术,解决了原生多模态自回归架构最致命的"效率"短板。以此为基础,它得以开启"多模态Scaling"的进程,通过堆叠数据和参数来提升能力,并验证了"第三种Scaling范式"的可能性。

而这种规模化的最终目标,是实现一个更宏大的愿景:从"预测Token"转向"预测状态",让AI真正学习这个世界的物理规律和因果关系,为最终实现能够理解并与物理世界交互的通用人工智能,提供了一条坚实的路径。

目前智源已将技术细节在技术报告里披露,并计划在未来开源模型。这一来自中国的技术创新,或许将在多模态世界模型这条新赛道上,引领全球AI发展的新方向。

随着技术的不断迭代和规模化发展,我们有理由期待,未来的多模态AI将不再局限于生成内容,而是真正理解世界、预测状态,成为人类探索物理规律、解决复杂问题的强大工具。从语言模型到多模态世界模型,AI正在经历一场深刻的范式革命,而EMU3.5正是这场革命的重要里程碑。