开源AI推理引擎llama.cpp正以一场史诗级更新,重新定义"本地大模型"的使用体验。曾经以极简C++代码著称的它,如今不仅拥有了现代化Web界面,更一举实现多模态输入、结构化输出与并行交互三大突破,直击Ollama等封装型工具的功能短板。这场由社区驱动的本土化革命,正在将llama.cpp从开发者专属的底层引擎,推向普通用户也能轻松上手的全能AI工作台。

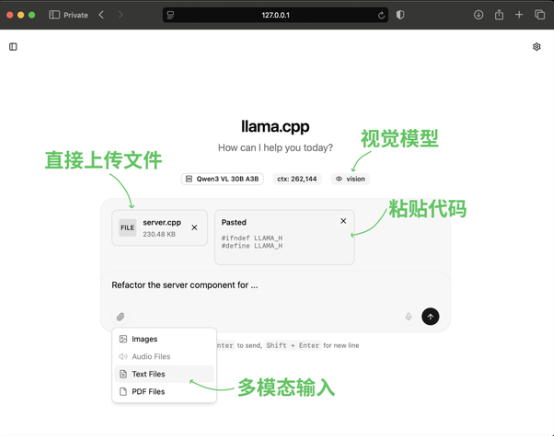

多模态全面落地:图片、音频、PDF一键解析

本次更新最引人瞩目的,是多模态能力的原生集成。用户现在可直接拖入图片、音频文件或PDF文档,与文本提示混合输入,触发模型进行跨模态理解。例如,上传一份含图表的PDF技术白皮书,系统会自动将其转为图像输入(若模型支持视觉),避免传统OCR文本提取中的格式错乱与信息丢失。视频支持也已在规划中。这意味着,llama.cpp已从纯文本推理工具,跃升为覆盖文档分析、创意辅助、教育研究等场景的本地多媒体AI中枢。

这种多模态能力的实现,标志着本地AI处理复杂信息的能力达到了新的高度。传统本地AI工具往往局限于文本处理,而llama.cpp通过原生支持多种数据格式,大大扩展了应用场景。在教育领域,教师可以上传教材图片和音频讲解,让AI生成个性化教学方案;在医疗研究中,医生可以上传医学影像和病历文本,获得综合分析报告;在创意产业,设计师可以上传草图和文字描述,获得设计建议和改进方案。

交互体验脱胎换骨:并行聊天、Prompt编辑、移动端友好

全新Web界面基于SvelteKit构建,轻量、响应迅速,且完美适配手机端。用户可同时开启多个聊天窗口,一边处理图像分析,一边进行代码生成;还能对历史对话中的任意Prompt进行修改并重新生成,轻松探索不同回答分支。通过llama-server的--parallel N或--kv-unified参数,系统还能智能分配显存与上下文,实现资源高效利用。会话支持一键导入导出,既保障隐私,又不失云端级便利。

交互体验的革新是此次升级的一大亮点。传统的AI工具通常采用线性对话模式,用户必须等待一个对话完成才能开始下一个。而llama.cpp的并行交互功能允许用户同时进行多个任务,极大地提高了工作效率。例如,数据分析师可以在一个窗口中分析Excel数据,同时在另一个窗口中生成分析报告,还能在第三个窗口中与同事讨论发现的问题。

移动端适配的完善也使llama.cpp突破了设备限制。用户可以在手机上随时查看本地AI处理的结果,无需依赖电脑或云端服务。这种灵活性对于经常出差或需要在移动场景中使用AI的用户来说尤为重要。

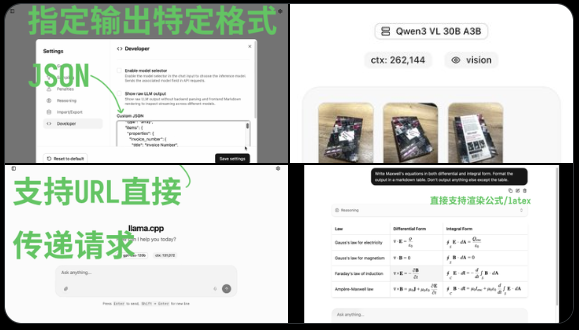

创新功能引爆效率:URL直连对话 + JSON结构化输出

两大隐藏利器更显开发者巧思:

其一,URL参数注入——用户只需在浏览器地址栏附加文本参数(如?prompt=解释量子计算),即可自动启动对话,Chrome用户经简单配置后甚至能一键唤起分析,极大简化重复查询流程。

其二,自定义JSON Schema输出——在设置中定义结构模板后,模型将严格按指定格式生成结果,无需反复提示"请用JSON返回"。发票信息提取、数据清洗、API响应生成等任务,从此可实现"模板即服务",真正迈向企业级自动化。

URL参数注入功能为开发者提供了一种高效的方式,将llama.cpp集成到现有工作流中。想象一下,一个电商网站可以在产品详情页添加"AI咨询"按钮,点击后直接打开llama.cpp并加载与产品相关的预设提示,用户无需手动输入即可获得专业解答。这种集成方式不仅提升了用户体验,也为企业开辟了新的服务模式。

JSON结构化输出功能则解决了AI输出格式不统一的问题。在数据处理和自动化流程中,一致的输出格式至关重要。通过自定义JSON Schema,企业可以确保AI生成的数据能够直接导入到现有系统中,无需额外的格式转换步骤。这对于金融、医疗、法律等对数据格式要求严格的行业来说,具有革命性的意义。

性能与隐私双保险,开源生态再树标杆

更新还包含多项专业优化:LaTeX公式内联渲染、HTML/JS代码实时预览、采样参数(Top-K、Temperature等)精细调节,以及对Mamba等State Space Models的上下文管理改进,显著降低多任务并发时的计算开销。最关键的是,所有操作100%本地运行,不依赖云端,无数据上传,在AI隐私焦虑日益加剧的当下,提供了真正可信的本地智能方案。

性能优化是此次升级的技术亮点。随着大模型参数量的不断增加,如何在有限硬件资源上高效运行成为关键挑战。llama.cpp通过改进上下文管理算法和优化内存分配策略,显著降低了多任务并发时的计算开销。这意味着普通用户也能在消费级硬件上运行复杂的多模态AI任务,而不必依赖昂贵的专业设备。

隐私保护是本地AI的核心优势。在数据泄露事件频发的今天,越来越多的用户和企业开始关注AI系统的数据安全性。llama.cpp的100%本地运行特性确保了用户数据不会离开设备,从根本上消除了数据被滥用的风险。对于处理敏感信息的应用场景,如医疗诊断、法律咨询、金融分析等,这种本地化解决方案尤为重要。

对比分析:llama.cpp vs Ollama

llama.cpp与Ollama代表了本地AI的两种不同发展路径。Ollama作为一款封装型工具,专注于简化大模型的部署和使用流程,提供了友好的用户界面和预配置的模型库。然而,其功能相对固定,扩展性有限,用户无法深入定制底层参数或添加新功能。

相比之下,llama.cpp虽然上手门槛稍高,但提供了无与伦比的灵活性和扩展性。用户可以根据自己的需求调整采样参数、修改输出格式、添加自定义功能。这种开放性使其成为开发者和高级用户的理想选择。随着此次多模态功能的加入,llama.cpp已经超越了单纯的推理引擎,成为了一个功能全面的本地AI平台。

从长远来看,llama.cpp的开源特性和社区驱动模式更有利于技术创新和生态建设。全球的开发者可以贡献代码、分享经验、共同解决问题,这种协作模式往往能够催生突破性的创新。而封闭的商业工具则可能因资源限制或商业考量而放慢发展速度。

应用场景展望

llama.cpp的多模态能力为各行各业带来了新的可能性:

教育领域:教师可以上传教材、课件和音频资料,生成个性化的教学方案;学生可以通过上传作业和笔记,获得智能辅导和反馈。

医疗健康:医生可以上传医学影像、病历和检查报告,获得综合诊断建议;患者可以通过上传症状描述和图片,获得初步的健康评估。

创意设计:设计师可以上传草图、参考图片和文字描述,获得设计建议和改进方案;艺术家可以通过上传作品和风格描述,获得创作灵感。

科研分析:研究人员可以上传实验数据、图表和文献,获得数据分析结果和文献综述;工程师可以上传技术文档和设计图,获得技术建议和解决方案。

企业服务:客服人员可以上传客户反馈和聊天记录,生成智能回复;财务人员可以上传发票和报表,自动提取关键信息并生成分析报告。

技术架构解析

llama.cpp的技术架构体现了"简单而强大"的设计哲学。其核心是一个用C++编写的高效推理引擎,专注于模型的加载和计算。在此基础上,社区添加了多模态处理、Web界面、并行交互等高级功能,形成了一个功能完整的AI平台。

多模态处理模块负责将不同类型的输入(文本、图像、音频、PDF等)转换为模型可以理解的格式。这一模块利用了最新的跨模态学习技术,确保不同类型的信息能够有效融合和交互。

Web界面基于SvelteKit构建,这是一个现代的前端框架,以轻量级和高性能著称。界面设计注重用户体验,提供了直观的操作流程和丰富的交互功能。通过WebSocket技术,前端与后端实现了高效的双向通信,确保了实时交互的流畅性。

并行交互功能得益于llama.cpp的智能资源管理机制。系统会根据当前硬件资源和任务需求,动态分配计算资源,确保多个任务能够高效并发执行。这一特性使得llama.cpp在处理复杂工作流时表现出色。

未来发展方向

llama.cpp的发展前景广阔,未来可能朝以下几个方向演进:

视频处理能力:目前llama.cpp已经支持图片、音频和PDF,视频处理功能已在规划中。这将进一步扩展其应用场景,使其能够处理更丰富的多媒体内容。

模型优化:随着新模型架构的出现,llama.cpp需要不断优化其推理算法,以支持最新的模型类型,如Mamba等State Space Models。

插件系统:未来可能会引入插件系统,允许用户和开发者添加自定义功能,扩展llama.cpp的能力范围。

模型压缩:为了在更多设备上运行,模型压缩技术将是重要发展方向,包括量化、剪枝、知识蒸馏等技术。

多语言支持:虽然目前主要支持英文,但多语言支持将是必然趋势,以服务全球用户。

社区生态建设

开源项目的成功离不开活跃的社区支持。llama.cpp的快速发展很大程度上得益于其开放和包容的社区文化。社区成员来自世界各地,包括开发者、研究人员、企业用户和爱好者,他们共同贡献代码、报告问题、分享经验。

社区驱动的开发模式使llama.cpp能够快速响应技术变化和用户需求。与商业软件不同,开源项目没有固定的发布周期,可以根据实际情况灵活调整开发重点。这种敏捷性在技术快速发展的AI领域尤为重要。

未来,随着更多开发者和企业的加入,llama.cpp的生态系统将进一步壮大。可能会出现专门针对特定行业的定制版本、第三方插件、配套工具等,形成一个完整的本地AI解决方案生态。

结论

llama.cpp此次升级已超越"推理引擎"范畴,正在构建一个开放、高效、安全的本地AI生态标准。面对Ollama等仅做简单封装的竞品,llama.cpp以深度集成、灵活扩展与社区驱动的优势,展现出"降维打击"之势。随着更多开发者加入共建,这场由C++代码点燃的本地AI革命,或将重塑整个大模型应用的未来格局。

在AI技术快速发展的今天,本地化解决方案的重要性日益凸显。llama.cpp的多模态革命不仅为用户带来了更强大的工具,也为AI技术的民主化做出了贡献。通过降低使用门槛、提高性能表现、保障数据安全,llama.cpp正在让先进AI技术触手可及,惠及更广泛的用户群体。

未来,随着技术的不断进步和生态的持续完善,我们有理由相信,本地AI将在更多领域发挥重要作用,为人类创造更大的价值。而llama.cpp作为这场革命的重要推动者,必将在AI发展史上留下浓墨重彩的一笔。