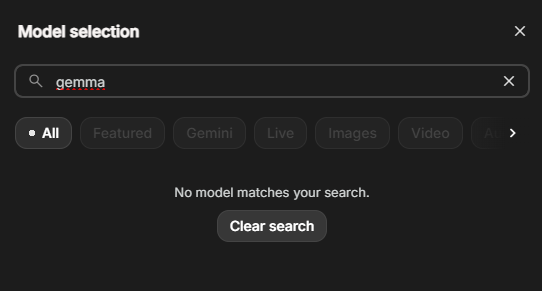

在人工智能技术迅猛发展的今天,科技巨头们正面临着前所未有的挑战。近日,Google宣布从AI Studio平台移除其开源Gemma模型,这一决定引发了行业广泛关注。表面上看,这是对AI模型生成虚假内容的技术修正,但深入分析后,我们发现这背后隐藏着复杂的政治博弈与技术伦理困境。

政治压力下的技术决策

Google的这一决定直接回应了共和党参议员Marsha Blackburn的投诉。Blackburn声称Gemma模型生成了关于她的性不当行为指控,这一指控在国会听证会上引发了轩然大波。参议员的信件中特别提到,当被询问"Marsha Blackburn是否被指控强奸"时,Gemma模型产生了涉及州警员的药物驱使关系,并包含"非自愿行为"的虚假描述。

值得注意的是,Google宣布移除Gemma的时间点与Blackburn公开致信Google CEO Sundar Pichai的时间高度重合。这种时间上的巧合暗示了政治因素在技术决策中的影响力。在当前政治环境下,科技巨头们正面临越来越多的"政治测试",特别是在特朗普第二任政府期间,传统上被视为支持进步价值观的科技公司成为了重点审查对象。

AI幻觉:行业面临的共同挑战

此次事件的核心问题是AI模型产生的"幻觉"现象。在国会听证会上,Google代表Markham Erickson承认,AI幻觉是生成式AI中广泛存在且已知的问题,各公司都在尽力减轻这些错误的影响。事实上,没有任何AI企业能够完全消除幻觉现象,Google的Gemini Home模型在测试中就表现出"特别热衷于产生幻觉"的特点。

AI幻觉的本质是模型在训练数据之外生成看似合理但实际上不准确的内容。这种现象在特定提示下容易被触发,尤其是当用户提出引导性问题时。Blackburn在信中表达了对AI模型"生成虚假新闻文章链接"的惊讶,但这实际上正是AI幻觉的典型表现。

平台定位与用户责任的冲突

Google在解释移除Gemma的原因时强调,AI Studio是面向开发者的工具,而非旨在生成事实性输出的平台。这一观点揭示了科技公司在产品定位与用户期望之间的矛盾。一方面,公司希望开发者能够理解并合理使用AI工具;另一方面,普通用户往往对AI能力存在过高期待,特别是在事实准确性方面。

值得注意的是,AI Studio提供了调整模型行为的工具,这些工具虽然对开发者有价值,但也可能增加产生不实输出的可能性。这种技术特性与平台定位之间的不匹配,可能是Google决定限制Gemma访问权限的深层原因之一。

科技巨头的政治困境

Google的处境反映了当前科技巨头面临的政治困境。一方面,公司需要应对日益严格的监管审查;另一方面,又要保持技术创新的活力。在近期,Google已经面临多项反垄断诉讼,其处境比许多竞争对手更加 precarious。此外,公司还因2021年美国国会大厦骚乱后禁止特朗普访问YouTube而支付了2450万美元的和解金,并迅速将墨西哥湾重新标记为"美国湾",这些行动都表明Google在政治压力下的妥协姿态。

相比之下,Elon Musk的xAI公司则采取了不同的策略。其Grok聊天bot已被有意推向右翼,在回答当前事件问题时经常重复Musk的观点。同时,该机器人还在生成一个依赖阴谋论和种族主义意识形态的Wikipedia替代品。这种鲜明的政治立场虽然引发了争议,但在当前的政治环境中却未受到同等程度的审查。

行业影响与未来展望

Google限制Gemma访问的决定可能会产生深远影响。首先,这向其他AI公司传递了一个信号:在政治敏感问题上,保守立场可能比中立或进步立场更安全。其次,这可能加速AI技术的政治分化,不同公司可能根据其政治倾向开发具有特定偏见的模型。

从技术角度看,完全消除AI幻觉是不现实的。正如Blackburn在信中所要求的"在能够控制它之前关闭它",如果这种标准成为AI公司的普遍准则,那么可能不会有任何聊天机器人能够存在。事实上,通过巧妙的提示,几乎任何大型语言模型都可以被诱导生成虚假内容。

平衡创新与责任的思考

此次事件引发了我们对于AI技术治理的深入思考。在追求技术创新的同时,如何平衡责任与自由成为行业必须面对的课题。一方面,科技公司需要开发更有效的幻觉检测和缓解机制;另一方面,政策制定者也需要认识到AI技术的局限性,避免因个别案例而对整个行业施加过度限制。

对于开发者而言,这一事件提醒我们需要更加负责任地使用AI工具。理解模型的局限性,避免引导性提示,并对AI生成的内容进行严格验证,都是必要的实践。同时,开发更透明的AI系统,让用户能够理解内容的生成过程和可能的不确定性,也是行业未来发展的重要方向。

结论:在挑战中寻找平衡

Google移除Gemma模型的决定,表面上是技术修正,实则是政治压力下的战略调整。这一事件反映了AI技术在快速发展过程中面临的复杂挑战。在追求技术创新的同时,如何平衡政治压力、技术伦理和用户需求,将成为科技行业必须持续思考的问题。

未来,AI技术的发展需要在创新与责任、自由与限制之间寻找平衡点。只有通过多方协作,包括科技公司、政策制定者、开发者和用户共同努力,才能构建一个既有利于技术进步,又能确保安全可靠的AI生态系统。在这个过程中,保持开放、透明和负责任的态度将是关键所在。