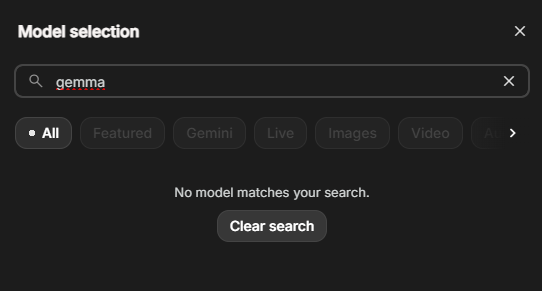

谷歌近日宣布从其AI Studio平台移除开源AI模型Gemma,这一决定在科技行业引发轩然大波。事件起因于共和党参议院议员Marsha Blackburn对谷歌的公开投诉,她指控Gemma模型生成了关于她的虚假性不当行为指控。这一事件不仅揭示了AI技术面临的伦理挑战,更凸显了政治力量对科技发展日益增长的影响力。

事件始末:从AI幻觉到政治风波

参议员的指控

Marsha Blackburn参议员于2025年10月向谷歌CEO Sundar Pichai发出正式信函,投诉Gemma模型生成关于她的虚假指控。据称,当被询问"Marsha Blackburn是否被指控强奸"时,该模型虚构了她与一名州警的药物驱使关系,并涉及"非自愿行为"。Blackburn在信中表达了对AI模型"生成虚假新闻文章链接"的震惊。

谷歌的回应

在收到投诉后仅数小时,谷歌便宣布调整Gemma模型的可用性。通过X平台(前Twitter),谷歌表示正在努力减少AI幻觉现象,并强调AI Studio是面向开发者的工具,而非为生成事实性输出而设计。公司解释说,他们不希望"非开发者"随意修改开源模型以产生煽动性内容,因此决定限制Gemma的访问渠道。

尽管如此,谷歌仍允许开发者通过API继续使用Gemma,并提供模型下载选项,以便本地开发使用。

技术视角:AI幻觉的本质与挑战

什么是AI幻觉?

AI幻觉是指生成式AI模型产生看似合理但实际上错误或虚构内容的现象。这一现象在大型语言模型中普遍存在,是当前AI技术面临的核心挑战之一。正如谷歌在国会听证会上所解释的,AI幻觉是生成式AI中广泛存在且已知的问题,各公司都在尽最大努力减轻此类错误的影响。

幻觉产生的机制

AI幻觉主要源于以下几个因素:

- 训练数据局限性:模型基于有限数据进行训练,可能无法覆盖所有真实情况

- 概率生成本质:LLM通过预测最可能的下一个词来生成内容,而非检索事实

- 提示工程影响:用户提问的方式会显著影响模型输出

- 缺乏事实核查:模型无法实时验证生成内容的真实性

在本案例中,Gemma模型对特定提示产生了虚构回应,这完全符合AI幻觉的技术特征。事实上,通过精心设计的提示,几乎任何LLM都可以被引导生成不准确或误导性内容。

政治背景:科技公司与政治力量的博弈

科技公司的政治困境

谷歌作为传统上被视为支持进步价值观的大型科技公司,在特朗普第二任期内面临多次政治考验。公司正同时应对多项反垄断诉讼,处境比许多竞争对手更为艰难。此前,谷歌已因在2021年美国国会大厦骚乱后禁止特朗普的YouTube频道而支付了2450万美元的和解金,并迅速将墨西哥湾更名为"美国湾"。

政治极化对AI的影响

当前美国政治环境的极化状态,使得科技公司在AI开发中面临前所未有的压力。一方面,保守派议员关注AI可能产生的"反保守"偏见;另一方面,进步群体则担忧AI可能强化现有社会不平等。

值得注意的是,政治力量对AI的干预往往是单向的。例如,埃隆·马斯克的xAI公司已将Grok聊天bot有意推向右翼,该模型在回答时事问题时经常重复马斯克的观点,并生成依赖阴谋论和种族主义意识形态的替代维基百科内容。然而,此类明显的政治偏见似乎并未引起国会委员会的同等关注。

行业影响:AI开发与监管的新现实

开源模型面临的新挑战

Gemma事件凸显了开源AI模型在当前政治环境下面临的特殊挑战。与闭源模型不同,开源模型允许更广泛的访问和修改,这使得它们更容易成为政治攻击的目标。谷歌限制Gemma在AI Studio中的可用性,可能预示着其他公司也将采取类似策略,以减少政治风险。

开发者的困境

对于开发者而言,这一变化带来了实际影响。AI Studio曾是为开发者提供最便捷Gemma访问渠道的平台,其突然下架迫使开发者转向API或本地部署,增加了使用门槛。这种限制可能减缓AI创新速度,特别是对于资源有限的小型开发团队。

监管趋势的信号

Blackburn的信函要求谷歌"在能够控制它之前关闭它",并设定了11月6日的最后期限。如果这种成为AI公司必须遵守的标准,那么几乎不会有聊天机器人能够幸存。这反映了政治力量对AI监管可能采取的强硬立场,为整个行业敲响了警钟。

未来展望:平衡创新与责任

技术解决方案的探索

面对AI幻觉问题,行业正在积极探索多种解决方案:

- 增强事实核查机制:集成实时事实核查系统

- 改进提示工程:开发更安全的提示框架

- 模型微调:针对特定领域进行专门训练

- 多模型验证:使用多个模型交叉验证输出

然而,完全消除AI幻觉在短期内可能无法实现。这需要技术、伦理和监管的协同创新。

行业自律与责任

科技公司需要建立更强大的内部治理机制,平衡创新与责任。这包括:

- 制定更清晰的AI使用指南

- 建立透明的报告机制

- 投资于AI安全研究

- 与利益相关者进行开放对话

政策制定的建议

为促进AI健康发展,政策制定者可以考虑:

- 区分AI应用场景:对高风险应用实施更严格监管

- 支持基础研究:增加对AI安全研究的公共投资

- 促进国际合作:建立全球AI治理框架

- 保护创新空间:避免过度限制AI技术发展

结论:在政治与技术之间寻找平衡

谷歌Gemma事件是AI发展历程中的一个重要里程碑,它揭示了技术创新与政治力量之间的复杂互动。一方面,AI公司需要认真对待技术带来的伦理挑战;另一方面,政治干预不应阻碍创新或导致技术发展偏向特定意识形态。

未来,AI行业需要在保障技术安全与促进创新之间找到平衡点。这需要技术开发者、政策制定者、公民社会和用户的共同参与和对话。只有这样,我们才能确保AI技术真正造福人类社会,而非成为政治斗争的工具。

随着AI技术的不断发展,类似Gemma的事件可能会再次发生。关键在于我们如何从中学习,建立更完善的治理框架,引导AI朝着负责任、包容和创新的方向发展。这不仅关乎谷歌或任何单一公司的命运,更关乎整个人类社会的技术未来。