在人工智能领域,大型语言模型(LLMs)正扮演着越来越重要的角色。它们不仅能够生成流畅的文本,还能执行复杂的推理任务。然而,LLMs的内部运作机制对于用户来说往往是一个黑盒子。为了解决这个问题,ReasonGraph应运而生,它是一款开源的可视化与分析LLMs推理过程的AI工具。本文将深入探讨ReasonGraph的功能特点、技术原理、应用场景以及未来的发展前景,旨在帮助读者全面了解这一强大的AI工具。

ReasonGraph:揭开LLMs推理过程的神秘面纱

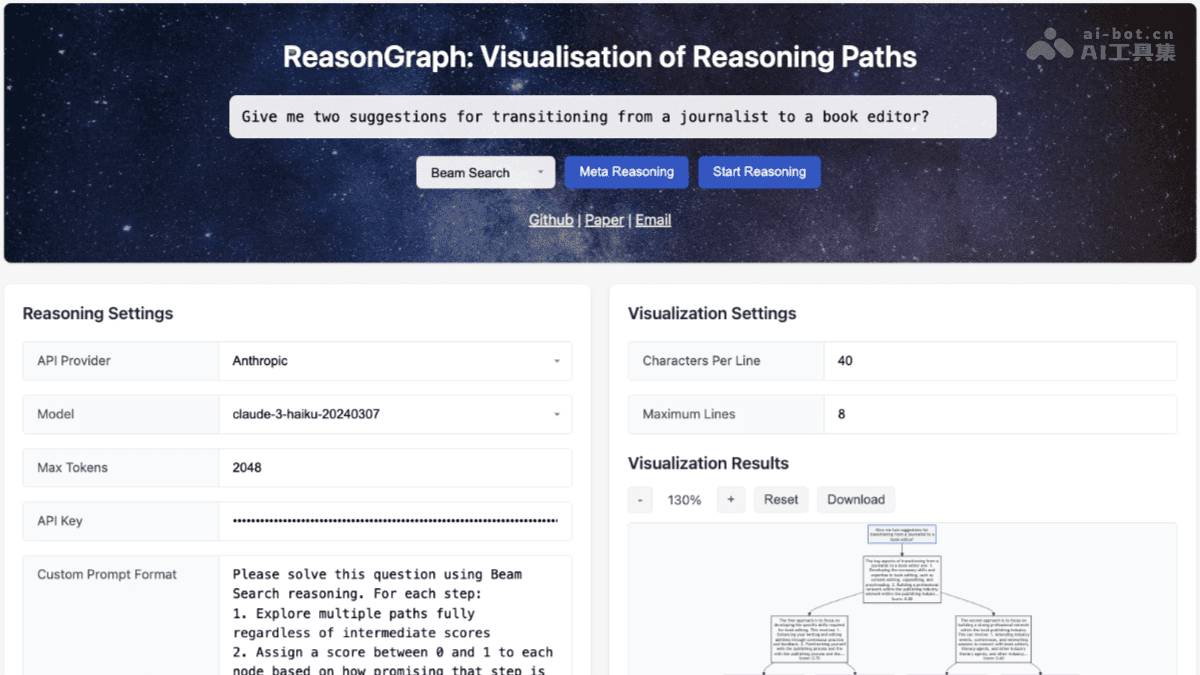

ReasonGraph是一个基于Web平台的开源项目,专门用于可视化和分析大型语言模型(LLMs)的推理过程。它支持超过50种主流模型,涵盖多种推理方法,包括顺序推理和树形推理。通过直观的用户界面,ReasonGraph将复杂的推理路径转化为清晰的图表,实时更新推理过程,帮助用户快速理解AI的思考逻辑,检测错误并优化模型表现。ReasonGraph的模块化设计支持新方法和模型的快速集成,使其能够广泛应用于学术研究、教育和开发领域。

ReasonGraph的主要功能:一览

ReasonGraph提供了一系列强大的功能,旨在帮助用户深入了解LLMs的推理过程:

- 推理路径可视化:ReasonGraph可以将LLM的推理过程以直观的图表形式展示出来,无论是树形推理还是顺序推理,都能清晰呈现。

- 多种推理方法支持:ReasonGraph涵盖了包括顺序推理方法和基于树的推理方法在内的主流推理方法,满足不同场景的需求。

- 兼容多种LLM模型:ReasonGraph支持50+主流模型,如OpenAI、Google、Anthropic等,具有广泛的适用性。

- 交互式可视化:ReasonGraph可以实时更新推理路径图,并支持参数调整、缩放、重置和导出为SVG格式,方便用户进行个性化分析。

- 用户友好界面:ReasonGraph提供直观的UI设计,方便用户选择推理方法、配置模型和查看结果,降低了使用门槛。

ReasonGraph的技术原理:深入剖析

ReasonGraph的技术原理主要包括以下几个方面:

- 推理路径解析:ReasonGraph基于规则化的XML解析方法从LLM的输出中提取推理路径,能够以接近100%的准确率解析格式良好的推理输出。解析后的推理路径被转换为适合可视化的结构,例如树形结构或有向图。

- 动态可视化技术:ReasonGraph的前端使用Mermaid.js实现动态图形渲染,支持实时更新推理路径的可视化。用户可以通过界面调整可视化参数,如节点密度、布局优化等,以适应不同的推理方法和模型。

- 模块化后端框架:ReasonGraph的后端基于Flask构建,分为三个核心模块:

- Configuration Manager:负责状态更新和配置管理。

- API Factory:提供统一的API接口,支持多种LLM提供商。

- Reasoning Methods Module:封装不同的推理方法,提供标准化的解析和可视化接口。 基于RESTful API层实现前后端的通信和错误处理。

- 实时交互与更新:ReasonGraph的前端使用异步事件处理模块响应用户的操作,如推理方法选择和参数配置。后端根据用户的输入调用相应的LLM模型,将推理结果实时反馈到前端进行可视化。

- 开源与扩展性:ReasonGraph采用开源模式,支持开发者使用标准化的API接口扩展新的推理方法和模型。模块化设计使得平台能够灵活适应不同LLM的能力和推理方法的变化。

ReasonGraph的应用场景:无限可能

ReasonGraph的应用场景非常广泛,涵盖了学术研究、教育、模型调试与优化、应用开发以及推理方法研究等多个领域:

学术研究:ReasonGraph可以帮助研究人员分析和比较不同推理方法的效果,评估模型在复杂任务中的表现,从而推动LLM推理能力的研究进展。例如,研究人员可以使用ReasonGraph来比较不同模型的推理路径,分析其优缺点,并提出改进方案。

一个案例是,研究人员利用ReasonGraph分析了GPT-3和LaMDA在解决同一道逻辑推理题时的推理路径。通过可视化图表,他们发现GPT-3在推理过程中更容易出现“思维跳跃”,而LaMDA则更倾向于逐步推理。这一发现为改进GPT-3的推理能力提供了有价值的参考。

教育领域:ReasonGraph可以作为教学工具,帮助学生直观理解逻辑推理过程,展示LLM的决策机制,提升对AI推理原理的学习兴趣和理解效率。教师可以使用ReasonGraph来演示LLM如何解决问题,并引导学生分析推理过程中的关键步骤。

例如,在教授自然语言处理课程时,教师可以使用ReasonGraph来展示LLM如何进行文本摘要。通过可视化推理路径,学生可以清晰地看到LLM如何从原始文本中提取关键信息,并生成简洁的摘要。

模型调试与优化:ReasonGraph可以帮助开发者快速发现推理路径中的错误或低效环节,从而辅助优化LLM的推理效果,提升模型性能。开发者可以使用ReasonGraph来诊断模型在特定任务上的表现,并针对性地进行改进。

一个实际的例子是,一位开发者在使用LLM进行机器翻译时,发现模型在处理长句时容易出现翻译错误。通过ReasonGraph,他发现模型在处理长句时的推理路径过于复杂,容易出现信息丢失。针对这一问题,他优化了模型的训练数据和推理算法,最终提高了翻译的准确性。

应用开发:ReasonGraph可以支持开发者在开发LLM应用时选择最优推理方法,并基于可视化推理路径优化应用逻辑,提升用户体验。开发者可以使用ReasonGraph来评估不同推理方法在特定应用场景下的表现,并选择最适合的方法。

例如,在开发智能客服应用时,开发者可以使用ReasonGraph来比较不同推理方法在处理用户咨询时的效果。通过可视化推理路径,开发者可以了解不同方法在理解用户意图、生成回复等方面的优缺点,并选择最适合的方法来提高客服的响应速度和准确性。

推理方法研究:ReasonGraph可以为研究新的推理方法提供可视化支持,帮助研究者探索和改进LLM的推理策略,推动技术创新。研究人员可以使用ReasonGraph来验证新的推理方法是否有效,并分析其优缺点。

例如,一位研究人员提出了一种新的基于知识图谱的推理方法,旨在提高LLM在知识密集型任务上的表现。通过ReasonGraph,他可以清晰地看到模型如何利用知识图谱进行推理,并分析其在不同任务上的表现。这一分析结果为他改进推理方法提供了重要的依据。

ReasonGraph的优势与局限

ReasonGraph作为一款开源的可视化与分析LLMs推理过程的AI工具,具有以下优势:

- 开源免费:ReasonGraph以开源的形式发布,用户可以免费使用,并根据自己的需求进行定制和扩展。

- 功能强大:ReasonGraph提供了丰富的可视化和分析功能,可以帮助用户深入了解LLMs的推理过程。

- 易于使用:ReasonGraph提供了直观的用户界面,降低了使用门槛。

- 广泛的适用性:ReasonGraph支持多种主流模型和推理方法,具有广泛的适用性。

然而,ReasonGraph也存在一些局限性:

- 依赖于LLM的输出格式:ReasonGraph的推理路径解析依赖于LLM的输出格式,如果LLM的输出格式不规范,可能会导致解析失败。

- 可视化效果受限于推理过程的复杂性:对于非常复杂的推理过程,ReasonGraph的可视化效果可能会受到影响。

- 需要一定的技术背景:虽然ReasonGraph提供了直观的用户界面,但用户仍然需要一定的技术背景才能充分利用其功能。

ReasonGraph的未来展望

随着LLMs的不断发展,ReasonGraph作为一款可视化与分析工具,将在未来发挥越来越重要的作用。未来的ReasonGraph可能会朝着以下几个方向发展:

- 支持更多的模型和推理方法:ReasonGraph将不断扩展其支持的模型和推理方法,以适应不断变化的LLM landscape。

- 提供更强大的分析功能:ReasonGraph将提供更深入的分析功能,例如推理路径的性能分析、错误诊断等,以帮助用户更好地优化模型。

- 与更多的AI工具集成:ReasonGraph将与更多的AI工具集成,例如模型训练平台、评估平台等,以提供更全面的解决方案。

- 提供更友好的用户界面:ReasonGraph将不断改进其用户界面,使其更加易于使用,降低使用门槛。

结论

ReasonGraph是一款功能强大、易于使用且具有广泛适用性的开源AI工具,它可以帮助用户深入了解LLMs的推理过程,从而更好地利用LLMs解决实际问题。随着LLMs的不断发展,ReasonGraph将在未来发挥越来越重要的作用,成为AI研究人员、开发者和教育工作者的必备工具。