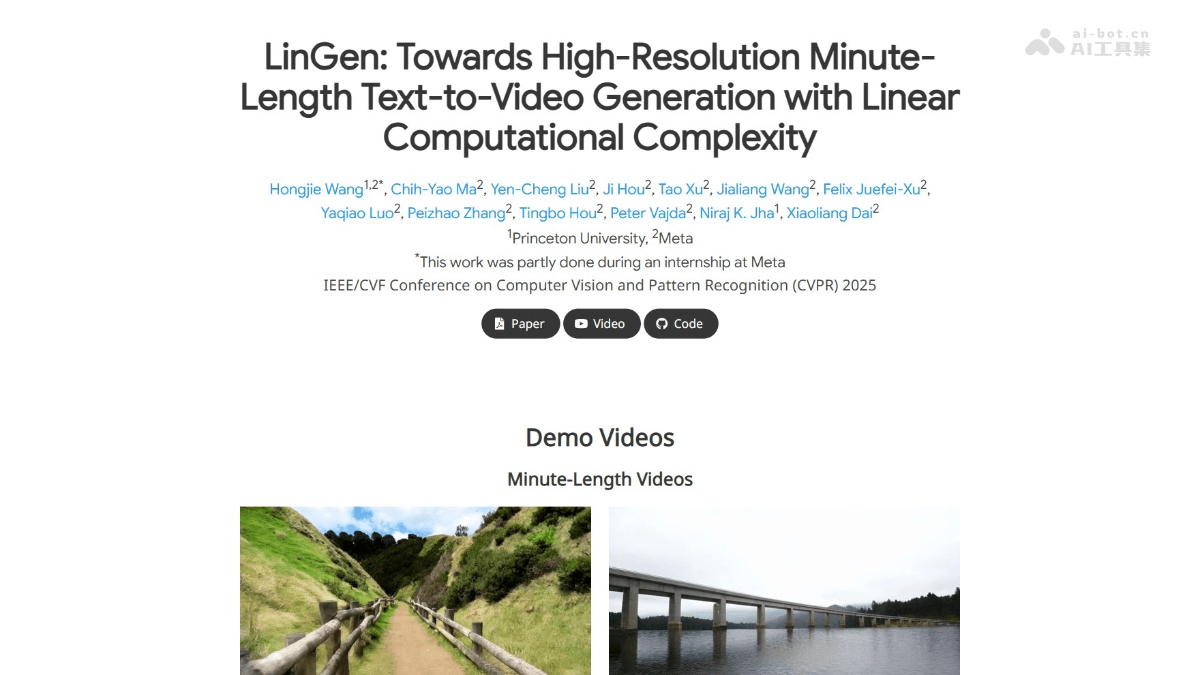

在人工智能领域,文本到视频的生成技术一直备受关注。近日,Meta与普林斯顿大学联合推出了一款名为LinGen的创新框架,为这一领域带来了新的突破。LinGen以其独特的线性复杂度MATE模块为核心,在保证视频质量的同时,显著提升了生成效率,为长视频生成和实时交互式视频应用开辟了新的可能性。

LinGen:文本到视频生成的新范式

LinGen的出现,打破了传统Diffusion Transformers在处理高分辨率、长时长视频时面临的计算瓶颈。传统的自注意力模块在计算复杂度上呈现二次方增长,这使得生成高质量、长时长的视频变得异常困难。而LinGen通过引入线性复杂度的MATE模块,有效地解决了这一问题。MATE模块包含MA-branch(多尺度注意力分支)和TE-branch(时间注意力分支),二者协同工作,实现了高效的视频生成。

LinGen的核心功能

LinGen框架具备以下几个核心功能:

- 高分辨率视频生成:LinGen支持生成高达1024p的高分辨率视频,这使得生成的视频在细节表现上更加出色,能够满足高质量内容创作的需求。高分辨率的视频意味着更多的像素信息,能够呈现更加细腻的画面,让观众获得更好的视觉体验。

长时长视频生成:传统的文本到视频生成模型往往只能生成10-20秒的短视频,这在很大程度上限制了其应用场景。LinGen突破了这一限制,能够生成分钟级的长视频,为内容创作者提供了更大的创作空间。更长的视频时长意味着可以讲述更完整的故事,呈现更丰富的内容。

线性计算复杂度:LinGen采用的MATE模块,其计算复杂度与生成视频中的像素数量呈线性关系,而不是传统的二次关系。这意味着,随着视频分辨率和时长的增加,LinGen的计算成本增长更加缓慢,从而能够在单个GPU上高效运行。线性复杂度是LinGen实现高效视频生成的关键所在。

高质量视频输出:LinGen在保证生成效率的同时,也注重视频的质量。生成的视频在视觉质量和文本对齐方面与现有的先进模型相当,并且能够保持帧间的一致性,避免出现画面跳跃或失真的情况。高质量的视频输出是LinGen赢得用户认可的重要因素。

实时交互式视频生成:LinGen为实时交互式视频生成和编辑提供了可能。用户可以通过实时调整文本描述,来控制视频的生成过程,从而实现更加个性化的内容创作。实时交互式视频生成是未来视频创作的重要趋势。

LinGen的技术原理

LinGen之所以能够实现高效、高质量的视频生成,离不开其独特的技术原理。MATE模块是LinGen的核心,它通过MA-branch和TE-branch协同工作,实现了对视频内容的高效建模和生成。

MA-branch(多尺度注意力分支):MA-branch主要负责捕捉视频中的长距离依赖关系和全局信息。它采用了以下几种关键技术:

双向Mamba2模块:Mamba2是一种高效的线性复杂度序列模型,它基于双向设计,能够同时捕捉序列中的前向和后向依赖关系。这使得MA-branch能够更好地理解视频内容的上下文信息。

Rotary Major Scan(RMS):RMS基于不同的扫描方式(如空间行优先、空间列优先、时间行优先、时间列优先)重新排列3D视频token张量。这种重排方式能够增强短距离相关性,同时减少计算延迟。通过不同的扫描方式,RMS能够从多个角度捕捉视频中的局部信息。

Review Tokens:在序列处理前,MA-branch会添加平均池化的token序列,这些token提供了对整个序列的全局概览。这有助于增强长距离相关性,使得模型能够更好地理解视频内容的整体结构。

TE-branch(时间注意力分支):TE-branch主要负责捕捉视频中的局部时间和空间信息。它将3D视频token张量划分为小窗口,并在窗口内计算自注意力。TESA能够捕捉空间上相邻和时间上中等距离的token之间的相关性。窗口在不同层之间交替移动,扩大感受野并增强视频的一致性。通过这种方式,TE-branch能够有效地捕捉视频中的动态变化。

LinGen的训练策略

LinGen采用了渐进式的训练策略,以提高模型的性能和稳定性。具体的训练步骤如下:

文本到图像任务预训练:首先,LinGen在低分辨率的文本到图像任务上进行预训练。这有助于模型学习文本和图像之间的对应关系,为后续的视频生成任务打下基础。

视频分辨率和长度递增预训练:在完成文本到图像任务的预训练后,LinGen逐步增加视频的分辨率和长度,进行预训练。这使得模型能够逐渐适应更高分辨率和更长时长的视频生成任务。

文本-图像对混合训练:在文本到视频预训练阶段,LinGen结合文本-图像对进行混合训练。这有助于提高生成视频的一致性,避免出现画面和文本描述不符的情况。

高质量视频数据集微调:最后,LinGen在高质量视频数据集上进行微调,以进一步提升生成视频的质量。通过微调,模型能够更好地学习真实视频的特征,从而生成更加逼真的视频。

LinGen的应用场景

LinGen的应用场景非常广泛,几乎涵盖了所有需要视频内容的领域。

内容创作:LinGen可以用于快速生成高质量的视频内容,如广告、电影、电视剧等。这可以显著缩短创作周期和成本,提高内容生产效率。

娱乐行业:LinGen可以用于生成游戏中的过场动画和背景视频,增强游戏的视觉效果和沉浸感。高质量的过场动画和背景视频能够提升游戏的整体品质,吸引更多的玩家。

教育与培训:LinGen可以用于生成教育视频,如课程讲解和实验演示,提高教学的趣味性和互动性。生动的教育视频能够帮助学生更好地理解知识,提高学习效果。LinGen还可以用于生成培训视频,帮助员工快速理解和掌握知识,提升培训效果。

广告视频:LinGen可以用于快速生成广告视频,满足不同广告场景的需求,提高广告制作的效率和效果。高效的广告视频生成能力能够帮助企业更快地推出新产品,抢占市场先机。

艺术创作:LinGen可以用于生成艺术视频,为艺术家提供新的创作工具,激发创意。艺术家可以利用LinGen探索新的艺术表现形式,创作出独具风格的作品。

LinGen的出现,为文本到视频生成领域带来了新的活力。它以其高效的生成效率、高质量的视频输出和广泛的应用场景,赢得了业界的广泛关注。随着技术的不断发展,LinGen有望在未来成为视频内容创作的重要工具,推动视频产业的创新和发展。

LinGen的局限性与未来发展方向

尽管LinGen在文本到视频生成领域取得了显著进展,但仍然存在一些局限性。例如,对于复杂场景和细致动作的模拟,LinGen的表现还有待提高。此外,如何进一步提升生成视频的真实感和自然度,也是未来需要重点研究的方向。

未来,LinGen的发展方向可能包括以下几个方面:

- 提升生成视频的真实感:通过引入更先进的生成模型和训练技术,提高生成视频的真实感,使其更加接近真实世界的视频。

- 增强对复杂场景的模拟能力:提升模型对复杂场景的理解和模拟能力,使其能够生成更加复杂的视频内容。

- 支持更多语言和文化:扩展模型对不同语言和文化的支持,使其能够生成更加多样化的视频内容。

- 开发更多交互式功能:开发更多交互式功能,例如允许用户通过手势或语音控制视频的生成过程。

- 优化计算效率:进一步优化计算效率,使其能够在更多设备上运行,并支持实时视频生成。

LinGen的开源项目地址:

- 项目官网:https://lineargen.github.io/

- GitHub仓库:https://github.com/jha-lab/LinGen

- arXiv技术论文:https://arxiv.org/pdf/2412.09856

LinGen的出现,为我们展示了文本到视频生成技术的巨大潜力。随着技术的不断进步,我们有理由相信,在不久的将来,人工智能将能够帮助我们轻松创作出高质量、个性化的视频内容,为我们的生活带来更多便利和乐趣。