在人工智能音乐创作领域,腾讯AI Lab推出的SongGeneration模型无疑是一项重要的突破。它不仅解决了音质、音乐性以及生成速度等关键问题,更通过其独特的技术架构和功能,为音乐创作带来了全新的可能性。本文将深入探讨SongGeneration的技术原理、功能特点、性能表现以及应用场景,以期全面了解这一AI音乐生成模型的价值与潜力。

SongGeneration:技术架构与核心功能

SongGeneration模型的核心在于其LLM-DiT融合架构,这一架构的创新之处在于能够显著提升音质表现和生成速度。通过这种架构,生成的歌曲在多个维度上都超越了大多数开源模型,甚至在某些指标上能够与商业闭源模型相媲美。

该模型的主要功能包括:

- 文本控制:用户可以通过输入关键词文本来引导AI生成特定风格和情绪的音乐作品。例如,输入“开心 流行”,AI便能快速生成符合这些描述的音乐。

- 风格跟随:通过上传一段10秒以上的参考音频,SongGeneration可以学习并生成风格一致的全长新曲,支持多种音乐流派。

- 多轨生成:模型能够自动生成分离的人声与伴奏轨道,保证旋律、结构、节奏与配器的高度匹配,为后期编辑和混音提供便利。

- 音色跟随:基于参考音频的音色跟随技术,SongGeneration能够实现高质量的人声表现,达到“音色克隆”的水平,使生成的人声更加自然且富有情感。

技术原理:LeLM、音乐编解码器与多偏好对齐

SongGeneration的技术原理主要包括LeLM(Language Model)、音乐编解码器以及多偏好对齐三个方面。

- LeLM:LeLM采用混合标记(Mixed Tokens)和双轨标记(Dual-Track Tokens)来代表人声和伴奏的组合音频。混合标记用于捕捉歌曲的整体结构和节奏,确保人声与伴奏的和谐;双轨标记则分别编码人声和伴奏,用于生成高质量的音频细节。LeLM能够并行预测混合标记和双轨标记,避免不同标记类型之间的干扰,从而提高生成质量和效率。

- 音乐编解码器:编码器(Encoder)将音乐音频提取为混合标记和双轨标记;解码器(Decoder)则将双轨标记重建为高保真的音乐音频,确保生成的歌曲具有高质量的音频表现。

- 多偏好对齐:通过直接偏好优化(DPO),SongGeneration能够处理多样化的人类偏好,提高模型在音乐性、指令遵循以及人声与伴奏和谐方面的表现。多维度偏好支持歌词对齐、提示一致性、音乐性等多个维度的偏好对齐,从而提升生成歌曲的整体质量。

三阶段训练范式

SongGeneration采用了三阶段训练范式,包括预训练、模块扩展训练以及多偏好对齐。

- 预训练:在大规模音乐数据上进行预训练,对齐不同输入模态和混合标记,为后续的训练奠定基础。

- 模块扩展训练:进一步训练AR解码器,建模双轨标记,提升音质和音乐性。

- 多偏好对齐:基于DPO后训练,优化模型在多维度偏好上的表现,使其更符合人类的审美和偏好。

SongGeneration的开源项目与资源

SongGeneration作为腾讯AI Lab的开源项目,为研究者和开发者提供了丰富的资源和工具。以下是该项目的主要地址:

- GitHub仓库:https://github.com/tencent-ailab/SongGeneration

- HuggingFace模型库:https://huggingface.co/tencent/SongGeneration

- arXiv技术论文:https://arxiv.org/pdf/2506.07520

- 在线体验Demo:https://huggingface.co/spaces/tencent/SongGeneration

通过这些资源,开发者可以深入了解SongGeneration的技术细节,并在此基础上进行二次开发和应用。

核心优势:低比特率、并行预测与偏好对齐

SongGeneration的核心优势在于其低比特率音乐编解码、多类别token并行预测以及多维度人类偏好对齐。

- 低比特率音乐编解码:SongGeneration实现了25Hz极低码率和0.35kbps超低比特率下的高质量音乐重建,减轻了语言模型建模的负担,使其能够更专注于音乐的结构和情感表达。

- 多类别token并行预测:基于“混合优先,双轨其次”的策略,SongGeneration避免了token之间的相互干扰,提升了音质和音乐性。这种并行预测的方法不仅提高了生成效率,还使得生成的音乐更加自然流畅。

- 多维度人类偏好对齐:通过对齐音乐性、歌词对齐以及提示一致性等偏好,SongGeneration提升了模型的效果和鲁棒性,使其能够更好地满足用户的需求。

性能表现:主客观测评与用户反馈

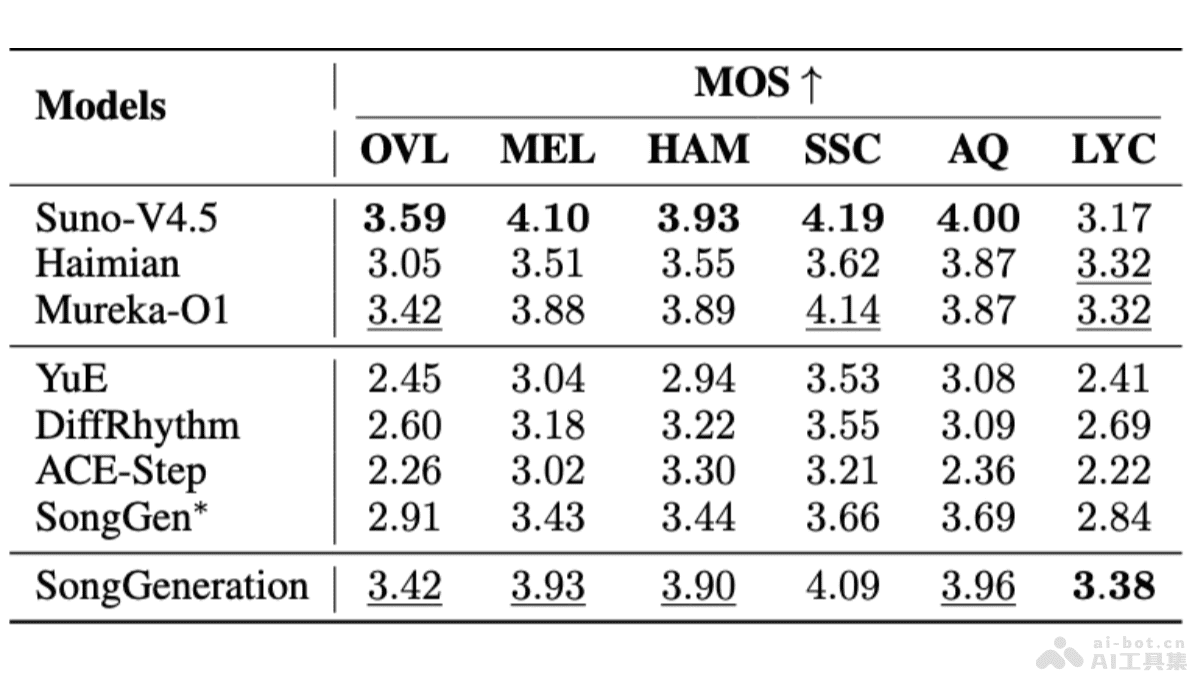

SongGeneration在性能表现方面经过了全面的主客观测评,结果显示其在开源模型中稳居第一,在商业模型中也位列前茅,展现出显著的竞争优势。

- 主客观整体测评:在与Suno v4.5、海绵音乐、Mureka O1等商业模型以及YuE、DiffRhythm、ACE-Step、SongGen等开源模型的对比中,SongGeneration在多个维度上都表现出色,证明了其在音乐生成领域的领先地位。

- 客观测评(第三方开源模型评测):在内容欣赏度(CE)、内容实用性(CU)和制作质量(PQ)三个关键维度上,SongGeneration均位列榜首,制作复杂度(PC)也处于领先位置。这些数据表明,SongGeneration不仅能够生成高质量的音乐,还具有很高的实用价值。

- 主观评测(普通用户 + 专业音乐人评测):在主观评测中,SongGeneration在歌词准确度上超越了包括Suno在内的众多大模型,体现了其在语音与文本对齐能力上的显著优势,以及在内容生成细节处理方面的成熟度。用户和专业音乐人的积极反馈进一步验证了SongGeneration的卓越性能。

应用场景:音乐创作、娱乐产业与教育领域

SongGeneration的应用场景非常广泛,涵盖了音乐创作、娱乐产业、教育领域、广告和营销以及个人娱乐等多个方面。

- 音乐创作:SongGeneration为音乐人和制作人提供高质量的歌曲草稿,节省了创作时间,使其能够更专注于核心创作,激发创意。通过SongGeneration,音乐人可以快速生成各种风格的音乐,从而更好地探索和实现自己的音乐 vision。

- 娱乐产业:在影视、游戏、广告等娱乐领域,SongGeneration可以快速生成契合需求的配乐,增强作品的沉浸感与吸引力,丰富音乐内容。例如,游戏开发者可以使用SongGeneration为游戏的不同场景生成背景音乐,从而提升游戏的整体体验。

- 教育领域:作为音乐教育工具,SongGeneration可以帮助学生理解音乐基础知识,激发创造力,辅助在线课程提供示例歌曲,提升教学效果。教师可以使用SongGeneration来演示音乐创作的过程,帮助学生更好地理解音乐的结构和原理。

- 广告和营销:SongGeneration可以为广告和品牌生成贴合主题的音乐,提升广告吸引力和品牌认同感,助力品牌营销。通过定制化的音乐,品牌可以更好地传递其核心价值和理念,从而吸引更多的目标受众。

- 个人娱乐:普通用户可以使用SongGeneration创作个性化歌曲,表达情感,分享到社交平台,增添娱乐互动乐趣。例如,用户可以使用SongGeneration为自己的生活片段创作配乐,从而更好地记录和分享自己的生活。

总结

腾讯AI Lab的SongGeneration模型在AI音乐生成领域取得了显著的成就。通过其独特的技术架构、强大的功能以及广泛的应用场景,SongGeneration为音乐创作带来了革命性的变革。随着技术的不断进步和应用场景的不断拓展,SongGeneration有望在未来成为音乐创作领域的重要力量,推动AI音乐创作从“辅助工具”迈向“智能共创”的新阶段。