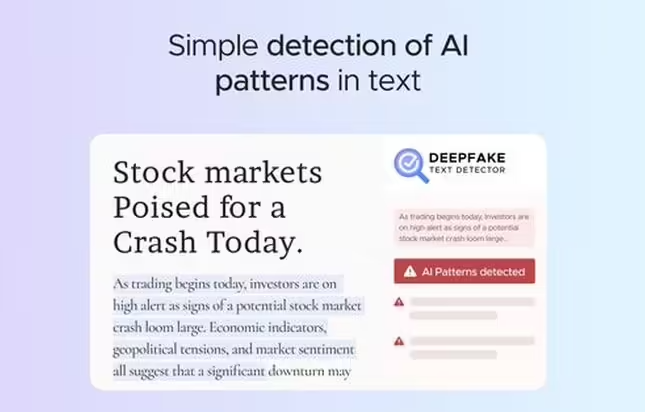

在科技日新月异的浪潮中,人工智能(AI)技术的发展正以惊人的速度渗透到我们生活的方方面面。然而,正如硬币的两面,AI在带来便利与创新的同时,也引发了一系列新的挑战与问题。其中,AI生成内容的识别与鉴别,成为了一个备受关注的焦点。近日,Mozilla公司宣布即将停止运营其AI内容检测扩展程序“Deep Fake Detector”,无疑给这一问题再添波澜。

据悉,这款名为“Deep Fake Detector”的工具,旨在帮助用户辨别由AI技术所生成的内容。它主要依赖于ApolloDFT和Binocular等开源模型,通过对内容进行深入分析,从而判断其是否为AI创作。在AI内容日益泛滥的今天,这款工具的出现,无疑为用户提供了一条辨别真伪的有效途径。相较于一些商业化的检测服务,Mozilla的开源工具更因其透明度和开放性而受到一部分用户的青睐。

然而,令人遗憾的是,这款工具的受欢迎程度并未达到预期。根据Mozilla官方商店的数据显示,其活跃用户数量仅有约3300人。这一数字,与Mozilla的庞大用户基数相比,显得微不足道。或许正是由于用户数量的不足,以及维护和更新成本的考量,Mozilla最终做出了停止运营“Deep Fake Detector”的决定。

科技媒体omgubuntu对此发表评论,认为Mozilla关闭这一检测工具的举动,可能暗示着该公司对AI生成内容的默认接受态度。这一观点,无疑引发了人们对于AI内容监管的担忧。在当前AI内容日益普及的背景下,内容的质量把控变得尤为重要。如果不对AI生成内容进行有效的鉴别和管理,那么互联网信息的真实性和可靠性将面临严峻的挑战。

Mozilla的Firefox浏览器,作为一款备受欢迎的开源浏览器,一直以来都以其安全性和用户体验而著称。然而,随着AI生成内容的涌入,Firefox浏览器也可能面临质量下降的风险。大量的低质量、虚假信息,可能会降低用户的使用体验,进而影响公司的生存与发展。因此,如何平衡创新与用户需求,将是Mozilla未来需要面对的重要课题。

对于Mozilla的这一决定,官方并未给出详细的解释。然而,对于那些依赖于高质量内容的用户来说,这无疑是一个令人失望的消息。在信息爆炸的时代,用户需要更加有效的工具来辨别内容的真伪。Mozilla的这一举措,可能会使得这种需求更加迫切。用户们开始思考,在“Deep Fake Detector”停止运营后,他们应该如何保护自己,免受AI生成虚假信息的侵害?

AI内容检测的困境与挑战

事实上,AI内容检测一直以来都是一个充满挑战的领域。AI技术的快速发展,使得AI生成内容越来越难以辨别。传统的检测方法,往往难以跟上AI技术的迭代速度。与此同时,AI生成内容的多样性,也给检测带来了很大的困难。AI可以生成文本、图像、音频、视频等各种形式的内容,每一种形式的内容都需要不同的检测方法。这无疑增加了AI内容检测的复杂性和难度。

此外,AI内容检测还面临着一些伦理和法律方面的挑战。例如,如何平衡检测的准确性和用户的隐私?如何防止AI内容检测被用于不正当的目的?这些问题都需要在AI内容检测的发展过程中加以考虑和解决。

开源社区的责任与担当

作为开源领域的领军企业,Mozilla一直以来都致力于推动互联网的开放和创新。然而,在AI内容检测这一问题上,Mozilla的举动似乎有些令人费解。停止运营“Deep Fake Detector”,是否意味着Mozilla放弃了对AI内容监管的责任?

事实上,开源社区在AI内容检测方面可以发挥更大的作用。开源社区可以共同开发和维护AI内容检测工具,分享检测经验和技术,从而提高AI内容检测的整体水平。同时,开源社区还可以推动AI内容检测的标准化和规范化,为AI内容监管提供技术支持。

用户在AI时代的自保之道

在AI内容日益普及的时代,用户需要提高自身的防范意识,学会辨别AI生成内容。以下是一些建议:

- 多方验证信息来源:不要轻信单一来源的信息,尤其是那些未经证实的消息。通过多个渠道验证信息的真实性,可以有效降低被虚假信息误导的风险。

- 关注内容的情感色彩:AI生成的内容往往缺乏真实的情感和个性。如果发现内容过于煽情或夸张,需要保持警惕。

- 注意内容的逻辑性和连贯性:AI生成的内容有时会出现逻辑混乱或前后矛盾的情况。仔细分析内容的逻辑性,可以帮助你判断其是否为AI创作。

- 利用专业的检测工具:虽然Mozilla的“Deep Fake Detector”即将停止运营,但市面上仍然存在一些其他的AI内容检测工具。利用这些工具,可以辅助你进行内容辨别。

- 保持批判性思维:在信息爆炸的时代,保持批判性思维至关重要。不要盲目接受任何信息,要学会独立思考和判断。

AI内容监管的未来展望

AI内容监管是一个复杂而长期的过程,需要政府、企业、社会组织和个人共同努力。以下是一些可能的未来发展方向:

- 加强技术研发:继续投入研发更先进的AI内容检测技术,提高检测的准确性和效率。

- 完善法律法规:制定完善的法律法规,明确AI内容生成的责任和义务,规范AI内容传播行为。

- 加强行业自律:鼓励行业协会制定行业规范,引导企业合规经营,共同维护良好的AI内容生态。

- 提高公众意识:加强公众教育,提高公众对AI生成内容的认知和防范意识。

总之,AI内容监管是一个需要全社会共同参与的系统工程。只有通过共同努力,才能有效应对AI带来的挑战,确保AI技术健康发展,为人类社会创造更大的价值。

随着AI技术的不断进步,未来的内容生成将更加智能化和个性化。AI不仅可以生成高质量的文本、图像和视频,还可以根据用户的喜好和需求进行定制化创作。这种个性化内容生成,将为用户带来更加丰富和便捷的体验。然而,与此同时,也需要警惕AI生成内容可能带来的伦理和社会问题。

AI生成内容在教育领域的应用也日益广泛。AI可以辅助教师进行教学,例如自动生成课件、批改作业等。同时,AI还可以为学生提供个性化学习资源和辅导,帮助他们更好地掌握知识。然而,需要注意的是,AI在教育领域的应用不能取代教师的作用。教师的引导和启发,以及师生之间的互动,是AI无法替代的。

在新闻传播领域,AI可以自动生成新闻报道,提高新闻生产的效率。然而,AI生成的新闻报道可能缺乏深度和客观性。因此,新闻从业者需要对AI生成的内容进行审核和编辑,确保新闻报道的质量和真实性。此外,还需要警惕AI生成虚假新闻的风险,防止其对社会造成不良影响。

AI技术在医疗领域的应用也备受关注。AI可以辅助医生进行诊断和治疗,例如分析医学影像、预测疾病风险等。然而,医疗领域的特殊性要求AI应用必须高度可靠和安全。因此,在医疗领域应用AI技术需要经过严格的评估和验证,确保其不会对患者造成伤害。

随着AI技术的不断发展,AI生成内容将在越来越多的领域得到应用。然而,在享受AI带来的便利的同时,需要对其潜在的风险保持警惕,并采取有效的措施加以防范。只有这样,才能确保AI技术真正服务于人类,为社会发展做出贡献。