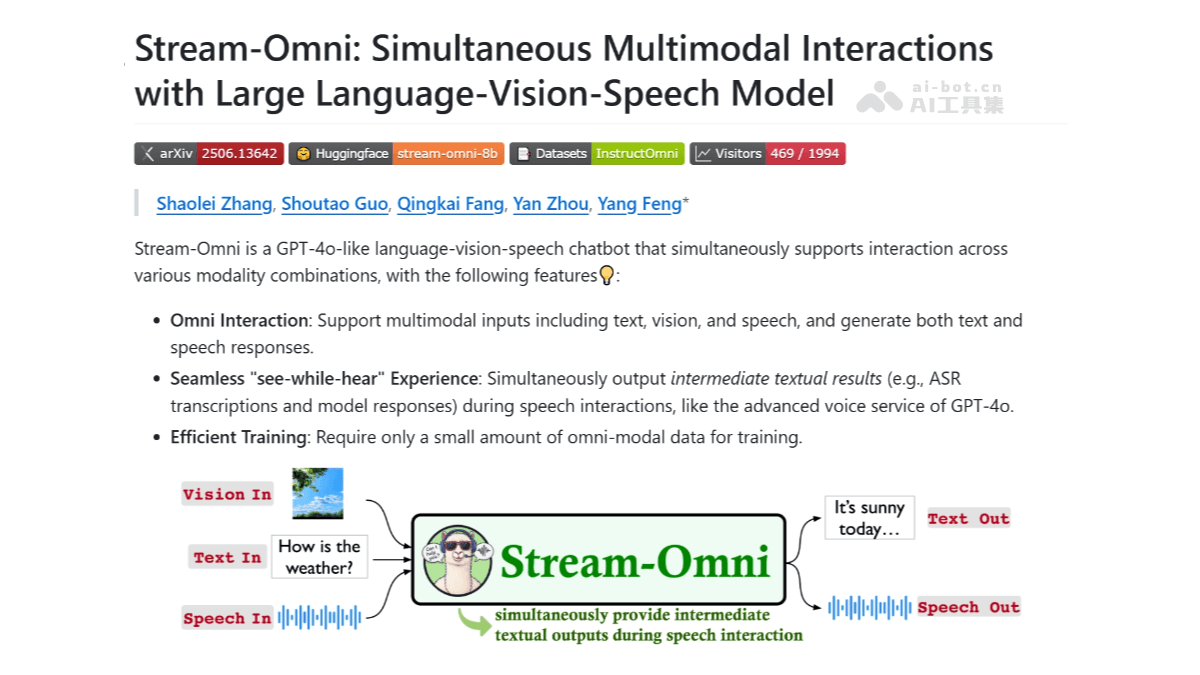

在人工智能领域,多模态交互正逐渐成为发展的新趋势。Stream-Omni,这款由中国科学院计算技术研究所、人工智能安全重点实验室以及中国科学院大学联合推出的大型语言视觉语音模型,正是在这一趋势下的重要成果。它类似于OpenAI的GPT-4o,但又具有自身的独特之处,尤其是在多模态交互的效率和灵活性方面。本文将深入探讨Stream-Omni的技术原理、功能特性及其潜在应用场景,希望能为读者提供一个全面而深入的了解。

Stream-Omni:多模态交互的新星

Stream-Omni的核心优势在于其能够同时处理和整合多种模态的信息,包括文本、视觉(图像)和语音。这种多模态融合能力使得Stream-Omni在人机交互方面具有更强的适应性和表现力。与传统的单一模态模型相比,Stream-Omni能够更全面地理解用户的意图,并以更自然、更丰富的方式进行反馈。

Stream-Omni的主要功能

Stream-Omni的功能十分强大,主要体现在以下几个方面:

- 多模态输入与输出:Stream-Omni支持文本、视觉和语音等多种模态的输入,并且能够生成文本和语音两种形式的响应。这种多模态的输入输出能力,使得Stream-Omni能够应对各种复杂的交互场景。

- 无缝“边听边看”体验:在语音交互过程中,Stream-Omni能够实时输出中间文本结果,例如自动语音识别(ASR)转录和模型响应。这种“边听边看”的体验,极大地提升了用户交互的效率和便捷性。

- 高效训练:Stream-Omni仅需少量全模态数据即可完成训练,例如23000小时的语音数据。相比于其他需要大量数据的模型,Stream-Omni在数据需求上更具优势,训练效率更高。

- 灵活的交互模式:Stream-Omni支持多种模态组合的交互,包括文本+视觉→文本、文本+视觉→语音、语音+视觉→文本、语音+视觉→语音等。这种灵活的交互模式,使得Stream-Omni能够满足不同场景下的交互需求。

- 视觉理解与语音交互:Stream-Omni在视觉理解和语音交互任务上表现出色,能够准确理解和生成与视觉内容相关的文本和语音信息。这种能力使得Stream-Omni在处理涉及视觉信息的交互任务时,具有更高的准确性和效率。

Stream-Omni的技术原理

Stream-Omni之所以能够实现如此强大的功能,得益于其独特的技术原理:

- 基于LLM的骨干架构:Stream-Omni以大型语言模型(LLM)为核心,利用LLM强大的语言理解和生成能力,为多模态交互提供基础支持。LLM能够处理和理解复杂的语言结构,从而保证Stream-Omni在文本处理方面的准确性和流畅性。

- 视觉文本对齐:Stream-Omni基于序列维度拼接的方式,将视觉编码器提取的视觉特征与文本输入进行拼接,然后共同输入到LLM中,从而实现视觉和文本模态的对齐。这种对齐方式能够有效地将视觉信息融入到文本处理中,使得模型能够更好地理解和生成与视觉内容相关的文本。

- 语音文本对齐:Stream-Omni引入了基于CTC(Connectionist Temporal Classification)的层维度映射,在LLM的底部和顶部添加语音层,从而实现语音到文本的映射和文本到语音的生成,最终实现语音模态与文本模态的对齐。这种对齐方式能够有效地将语音信息融入到文本处理中,使得模型能够更好地理解和生成与语音内容相关的文本。

- 多任务学习:Stream-Omni基于多任务学习策略,同时训练视觉文本、语音文本以及全模态(视觉+文本+语音)的任务,从而让模型更好地理解和生成多模态内容。这种多任务学习的方式,能够有效地提升模型的泛化能力和鲁棒性。

- 实时语音生成:Stream-Omni基于特殊的语音层设计和层维度映射,在生成文本的同时,实时生成对应的语音输出,从而实现流畅的语音交互。这种实时语音生成的能力,使得Stream-Omni在语音交互方面具有更高的效率和自然性。

- 数据驱动与监督学习结合:Stream-Omni依赖少量多模态数据进行训练,并基于精心设计的对齐机制和多任务学习,从而在有限的数据上实现高效的模态对齐和交互能力。这种数据驱动与监督学习相结合的方式,使得Stream-Omni在数据资源有限的情况下,依然能够取得良好的性能。

Stream-Omni的应用场景

Stream-Omni的多模态交互能力,使其在众多领域具有广泛的应用前景:

- 智能车载系统:在智能车载系统中,司机可以通过语音指令查询路线、获取路况,系统结合视觉信息(例如导航地图、路况摄像头图像)实时显示文本提示和语音反馈,从而提升驾驶安全性和交互效率。Stream-Omni能够根据司机的语音指令,结合视觉信息,提供准确、及时的反馈,从而提升驾驶体验。

- 教育辅助工具:在教育场景中,学生可以通过语音提问,系统依据教材视觉内容(例如图表、图片)给出详细的文本解释和语音回答,从而帮助学生更好地理解和学习知识。Stream-Omni能够根据学生的提问,结合教材内容,提供个性化的学习辅导,从而提升学习效果。

- 智能家居控制:作为智能家居助手,用户可以通过语音指令控制家电设备,系统结合视觉输入(例如摄像头捕捉的环境信息)提供文本或语音反馈,从而实现更智能、便捷的家居控制。Stream-Omni能够根据用户的语音指令,结合环境信息,智能控制家电设备,从而提升生活品质。

- 医疗辅助诊断:医生在查看患者病历时,可以通过语音指令查询关键信息,系统结合视觉报告(例如X光片、CT图像)提供详细的文本分析和语音解释,从而辅助医生更准确地做出诊断。Stream-Omni能够根据医生的指令,结合病历信息,提供专业的医疗辅助,从而提升诊断效率。

- 智能客服服务:在客服领域,客服人员可以通过语音与客户交流,系统实时显示相关文本信息和视觉提示(例如产品图片、操作流程图),从而帮助客服人员快速理解客户需求并提供准确解答,提升服务质量和效率。Stream-Omni能够根据客户的语音,结合产品信息,提供专业的客服支持,从而提升服务体验。

Stream-Omni的未来展望

Stream-Omni作为一款新兴的多模态交互模型,无疑具有巨大的发展潜力。随着技术的不断进步和应用场景的不断拓展,Stream-Omni有望在人机交互领域发挥更大的作用,为人们的生活和工作带来更多的便利和价值。未来,我们可以期待Stream-Omni在以下几个方面取得更大的突破:

- 更强大的多模态融合能力:随着深度学习技术的不断发展,Stream-Omni有望实现更深层次的多模态融合,从而更好地理解和生成多模态内容。

- 更广泛的应用场景:随着应用场景的不断拓展,Stream-Omni有望在更多领域发挥作用,例如智能制造、智慧城市等。

- 更智能的人机交互体验:随着人机交互技术的不断进步,Stream-Omni有望实现更自然、更智能的人机交互体验,从而更好地满足用户的需求。

结语

Stream-Omni的出现,标志着多模态交互技术进入了一个新的阶段。它不仅在技术上有所突破,更在应用上展现出巨大的潜力。相信在不久的将来,Stream-Omni将会在各个领域得到广泛应用,为人们带来更加智能、便捷的生活体验。