AI 时代的认知挑战:过度依赖人工智能对思维与记忆的影响

人工智能(AI)的快速发展正在深刻地改变着我们的生活和工作方式。然而,一项来自麻省理工学院媒体实验室的最新研究提醒我们,过度依赖 AI 工具可能会带来意想不到的认知成本。这项研究由 Nataliya Kosmyna 及其团队主导,深入探讨了在论文写作任务中使用大型语言模型(LLM),如 OpenAI 的 ChatGPT,对人类认知能力的影响。研究发现,尽管 LLM 产品为我们带来了诸多便利,但其广泛应用可能会导致大脑积累“认知负债”,长远来看甚至会削弱个体的学习技能。

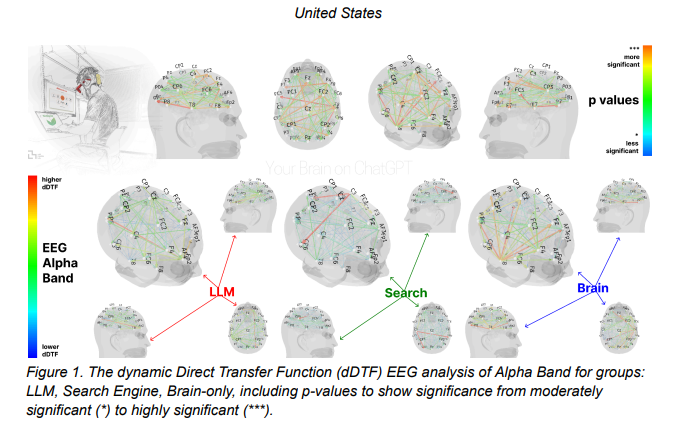

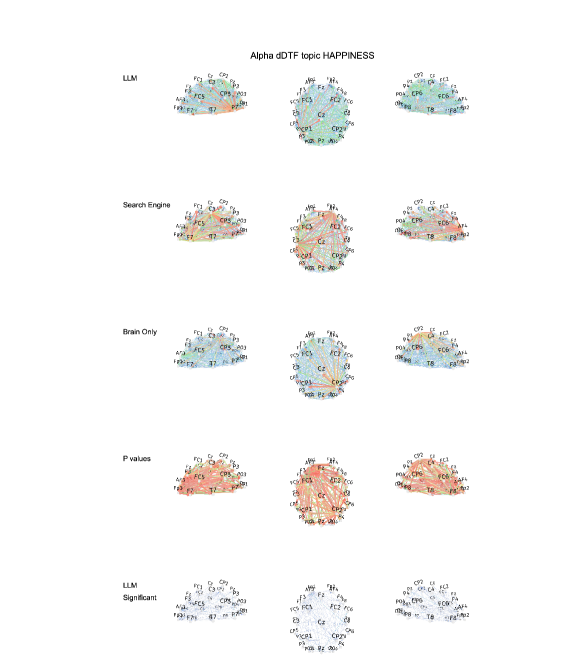

这项研究招募了 54 名参与者,并将他们分为三组:LLM 组(仅使用 ChatGPT)、搜索引擎组(使用传统搜索引擎,禁用 LLM)和纯脑力组(不使用任何工具)。研究共进行了四次会话。在第四次会话中,LLM 组的参与者被要求不使用任何工具(被称为“LLM 转纯脑力组”),而纯脑力组的参与者则开始使用 LLM(被称为“纯脑力转 LLM 组”)。研究团队通过脑电图(EEG)记录了参与者的大脑活动,以评估其认知投入和负荷,并深入理解论文写作任务期间的神经激活模式。此外,研究还进行了自然语言处理(NLP)分析,并在每次会话后对参与者进行了访谈,同时邀请人类教师和 AI 评判员对论文进行打分。

研究的核心发现集中在大脑连接性、记忆和所有权感知三个方面。研究结果表明,LLM、搜索引擎和纯脑力组的神经网络连接模式存在显著差异,反映了不同的认知策略。大脑连接性与外部支持的程度呈系统性下降:纯脑力组表现出最强、范围最广的连接网络,搜索引擎组居中,而 LLM 辅助则引发了最弱的整体耦合。

尤其值得关注的是,在第四次会话中,“LLM 转纯脑力组”的参与者表现出较弱的神经连接性,以及阿尔法(alpha)和贝塔(beta)网络的投入不足。阿尔法波段连接性通常与内部注意力、语义处理和创造性构思相关,而贝塔波段则与主动认知处理、专注注意力和感觉运动整合相关。这些结果表明,过去依赖 LLM 的使用者,在脱离工具后,其大脑在内容规划和生成方面的神经活动有所减少,这与认知卸载的报告相符,即依赖 AI 系统可能导致被动方法和批判性思维能力的减弱。换句话说,过度依赖 AI 可能会使我们的大脑变得“懒惰”,降低其自主思考和解决问题的能力。

在记忆方面,LLM 组的参与者在引用自己刚写完的论文时表现出明显障碍,甚至无法正确引用。这直接映射到 LLM 组较低的低频连接性,特别是与情景记忆巩固和语义编码密切相关的西塔(theta)和阿尔法波段。这表明 LLM 用户可能绕过了深层记忆编码过程,被动地整合了工具生成的内容,而没有将其内化到记忆网络中。这意味着,我们可能会因为过于依赖 AI 而难以记住和理解我们所写的内容,从而影响学习效果和知识的积累。

此外,LLM 组对自己论文的所有权感知度普遍较低,而搜索引擎组拥有较强的所有权感,但仍低于纯脑力组。这种行为上的差异与神经连接性模式的变化相吻合,凸显了 LLM 使用对认知能动性的潜在影响。当我们不再完全依靠自己的能力完成任务时,我们可能会对自己的工作失去一种主人翁感,从而降低工作满意度和成就感。

这项研究还提出了“认知负债”的概念。研究指出,尽管 LLM 在初期提供了显著的效率优势并降低了即时认知负荷,但随着时间的推移,这种便利可能以牺牲深度学习成果为代价。报告强调,重复依赖外部系统(如 LLM)取代了独立思考所需的努力认知过程,短期内延迟了脑力投入,但长期却导致批判性探究能力下降、更容易被操纵以及创造力减退。

纯脑力组的参与者,尽管面临更高的认知负荷,却展现出更强的记忆力、更高的语义准确性和对其作品更坚定的主人翁意识。而“纯脑力转 LLM 组”在首次使用 AI 辅助重写论文时,大脑连接性显著增加,这可能反映了将 AI 建议与现有知识整合时的认知整合需求,暗示了 AI 工具引入的时机可能对神经整合产生积极影响。

这些发现对教育领域具有深远意义。过度依赖 AI 工具可能无意中阻碍深层认知处理、知识保留以及对书面材料的真实投入。如果用户过度依赖 AI 工具,他们可能会获得表面的流畅度,但却无法内化知识或对其产生所有权感。因此,如何在教育中合理地使用 AI 工具,是一个值得我们深入思考的问题。

研究团队建议,教育干预应考虑将 AI 工具辅助与“无工具”学习阶段相结合,以优化即时技能转移和长期神经发展。在学习的早期阶段,全面的神经参与对于发展强大的写作网络至关重要;而在后续练习阶段,有选择性的 AI 支持可以减少无关的认知负荷,从而提高效率,同时不损害已建立的网络。这意味着,我们应该在培养学生独立思考和解决问题的能力的基础上,适当地引入 AI 工具,而不是完全依赖它们。

研究人员强调,随着 AI 生成内容日益充斥数据集,以及人类思维与生成式 AI 之间的界限变得模糊,未来研究应优先收集不借助 LLM 协助的写作样本,以发展能够识别作者个人风格的“指纹”表示。这将有助于我们更好地理解 AI 对人类认知的影响,并找到应对这些影响的方法。

总而言之,这项研究呼吁我们在 LLM 整合到教育和信息情境中时,必须谨慎权衡其对认知发展、批判性思维和智力独立性的潜在影响。LLM 虽然能减少回答问题的摩擦,但这种便利性也带来了认知成本,削弱了用户批判性评估 LLM 输出的意愿。这预示着“回音室”效应正在演变,通过算法策划内容来塑造用户接触信息的方式。

案例分析:AI 写作工具在新闻行业的应用

为了更具体地说明 AI 对认知的影响,我们可以考虑 AI 写作工具在新闻行业的应用。许多新闻机构正在使用 AI 工具来生成新闻稿、撰写报告和编辑文章。这些工具可以帮助记者更快地完成工作,并提高新闻报道的效率。

然而,过度依赖 AI 写作工具也可能带来一些问题。例如,记者可能会变得不那么注重事实核查和独立思考,而是简单地复制粘贴 AI 生成的内容。这可能会导致新闻报道出现错误和偏见,从而损害新闻的公信力。

此外,AI 写作工具可能会减少记者进行深入调查和采访的机会,从而降低新闻报道的质量。记者可能会变得更加依赖 AI 工具提供的信息,而不是亲自去了解事实的真相。这可能会导致新闻报道缺乏深度和洞察力。

因此,新闻机构在使用 AI 写作工具时,应该采取一些措施来避免这些问题。例如,新闻机构可以要求记者对 AI 生成的内容进行仔细核查和编辑,并鼓励记者进行独立思考和调查。新闻机构还可以为记者提供培训,帮助他们更好地使用 AI 写作工具,并了解其局限性。

数据佐证:AI 对学生写作能力的影响

除了新闻行业,AI 写作工具也在教育领域得到广泛应用。许多学生正在使用 AI 工具来完成作业、撰写论文和准备考试。

一些研究表明,使用 AI 写作工具可以提高学生的写作效率和质量。例如,AI 工具可以帮助学生更快地找到相关资料、组织思路和修改语法错误。

然而,也有一些研究表明,过度依赖 AI 写作工具可能会对学生的写作能力产生负面影响。例如,学生可能会变得不那么注重写作技巧和语言表达,而是简单地依赖 AI 工具生成的内容。这可能会导致学生的写作水平下降,并影响其未来的学习和工作。

一项针对大学生的研究发现,经常使用 AI 写作工具的学生在写作测试中的表现明显低于不使用 AI 写作工具的学生。这项研究还发现,使用 AI 写作工具的学生在写作时更容易出现抄袭行为。

这些数据表明,过度依赖 AI 写作工具可能会对学生的写作能力产生负面影响。因此,教育机构应该采取一些措施来帮助学生合理地使用 AI 写作工具,并避免对其产生过度依赖。

应对策略:如何在 AI 时代保持认知活力

既然过度依赖 AI 可能会带来认知风险,那么我们应该如何应对呢?以下是一些建议:

- 保持批判性思维:在使用 AI 工具时,不要盲目相信其生成的内容,而是要对其进行批判性评估,并进行独立思考。

- 注重深度学习:不要满足于浅层的信息获取,而是要深入研究问题,并尝试理解其本质和内在联系。

- 培养自主学习能力:不要完全依赖 AI 工具提供的答案,而是要主动寻找学习资源,并培养自主解决问题的能力。

- 适度使用 AI 工具:不要过度依赖 AI 工具,而是要将其作为辅助工具,并在必要时进行人工干预。

- 保持好奇心和求知欲:不断学习新知识,并保持对世界的好奇心和求知欲,以激发大脑的活力。

总之,AI 时代的认知挑战 требует我们更加注重培养自身的认知能力,并合理地使用 AI 工具。只有这样,我们才能在享受 AI 带来的便利的同时,保持认知活力和创造力。

未来展望:AI 与人类智能的和谐共生

未来,AI 将会继续发展,并渗透到我们生活的方方面面。我们应该积极拥抱 AI,并将其作为提升自身能力和改善生活质量的工具。

同时,我们也应该警惕 AI 可能带来的认知风险,并采取相应的应对策略。只有这样,我们才能实现 AI 与人类智能的和谐共生,共同创造美好的未来。

未来的研究方向可以包括:

- 探索 AI 对不同年龄段人群认知能力的影响。

- 研究不同类型的 AI 工具对认知能力的影响。

- 开发能够评估和提升认知能力的 AI 工具。

- 制定关于 AI 使用的伦理规范和法律法规。

通过深入研究和有效应对,我们可以最大限度地发挥 AI 的潜力,并最大限度地减少其负面影响,从而实现人类与 AI 的共同进步。