Dive3D:北京大学与小红书联合推出的文本到3D生成框架深度解析

在人工智能领域,文本到3D模型的生成技术一直是研究的热点。近日,北京大学与小红书公司联合推出了一款名为Dive3D的创新框架,该框架旨在通过文本描述直接生成高质量、多样化的3D模型。Dive3D的出现,无疑为游戏开发、影视制作、建筑设计等多个领域带来了新的可能性。

Dive3D的核心功能

Dive3D框架的核心在于其强大的功能,主要体现在以下几个方面:

多样化3D内容生成

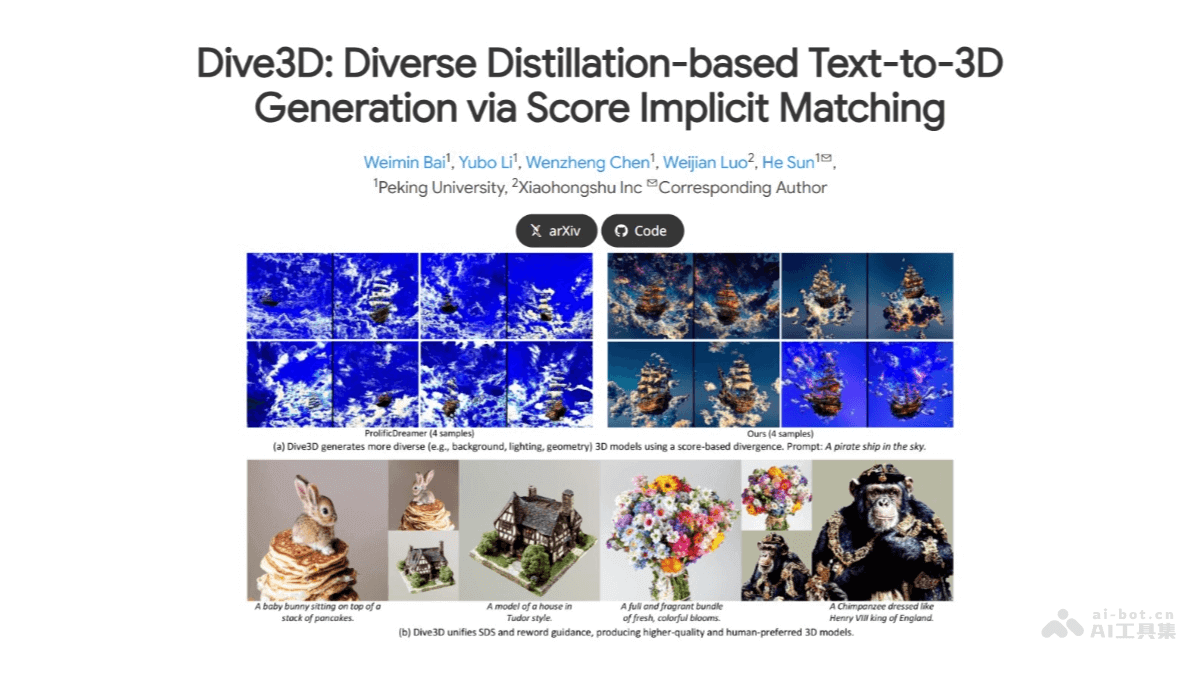

传统的文本到3D模型生成方法常常面临“模式坍塌”的问题,即生成的结果过于单一和相似。Dive3D通过采用独特的算法,能够根据文本提示生成多种风格和细节的3D模型,有效避免了这一问题。这意味着用户可以通过简单的文本描述,获得各种各样、独具特色的3D模型,极大地丰富了创作的可能性。

高质量3D模型生成

Dive3D不仅能够生成多样化的3D模型,还注重模型的质量。生成的3D模型具有较高的视觉保真度,包括精细的纹理细节、逼真的几何形状和合理的光照效果等。这些高质量的特性使得Dive3D生成的模型可以直接应用于各种专业领域,无需进行额外的后期处理。

良好的文本对齐能力

文本对齐能力是衡量文本到3D模型生成框架优劣的重要指标。Dive3D在这方面表现出色,能够确保生成的3D模型与输入的文本描述高度匹配,准确地反映文本中提到的各种元素和特征。这意味着用户可以通过精确的文本描述,获得符合预期的3D模型,实现真正的“所见即所得”。

支持多种3D表示形式

为了满足不同应用场景和用户的需求,Dive3D支持生成不同类型的3D表示,如神经辐射场(NeRF)、高斯点云(Gaussian Splatting)和网格(Mesh)等。这些不同的3D表示形式各有优势,可以应用于不同的领域。例如,神经辐射场擅长于生成逼真的场景,高斯点云适用于实时渲染,而网格则常用于游戏开发。

Dive3D的技术原理

Dive3D之所以能够实现上述功能,离不开其独特的技术原理。以下将详细介绍Dive3D的几个关键技术:

分数隐式匹配(Score Implicit Matching,SIM)损失

SIM损失是Dive3D的核心技术之一,它用于替代传统的KL散度目标。传统的基于KL散度的损失函数(如在Score Distillation Sampling,SDS中使用)会导致模式寻求行为,让生成模型倾向于生成高密度区域的样本,限制生成的多样性。而SIM损失直接匹配生成内容的概率密度梯度场(分数)和扩散先验的分数,避免了KL散度的问题,鼓励模型探索多个高概率区域,从而在保持保真度的同时提高生成的多样性。

为了更深入地理解SIM损失,我们可以将其类比为寻找宝藏的过程。传统的KL散度损失就像是只允许在已知的宝藏区域挖掘,而SIM损失则鼓励挖掘者探索未知的区域,从而发现更多的宝藏。这种探索精神使得Dive3D能够生成更多样化的3D模型。

统一的散度视角框架

Dive3D将扩散蒸馏和奖励引导优化整合到一个基于散度的框架中。该框架包括三个核心的散度损失:条件扩散先验损失(CDP)、无条件扩散先验损失(UDP)和奖励损失(ER)。通过合理地组合和调整这些损失的权重,Dive3D能够在生成的多样性、文本对齐和视觉质量之间取得平衡。

条件扩散先验损失(CDP)用于确保生成的3D模型与输入的文本描述相符,无条件扩散先验损失(UDP)用于提高生成的多样性,而奖励损失(ER)则用于优化模型的视觉质量。这三个损失相互配合,共同作用,使得Dive3D能够生成高质量、多样化的3D模型。

基于扩散模型的优化

Dive3D利用预训练的2D扩散模型(如Stable Diffusion)作为先验知识,基于多视图渲染将3D表示优化为与文本提示相匹配的2D图像。在优化过程中,迭代地对3D模型进行渲染、计算损失并更新模型参数,让生成的3D模型的渲染图像逐渐接近预训练扩散模型所期望的图像分布。

扩散模型是一种强大的生成模型,它通过逐步添加噪声的方式将图像转化为随机噪声,然后再通过学习逆向过程将随机噪声转化为图像。Dive3D利用扩散模型作为先验知识,可以有效地提高生成3D模型的质量和真实感。

高效的优化算法

为了提高优化效率,Dive3D采用了高效的优化算法和策略。例如,引入分类器自由引导(Classifier-Free Guidance,CFG)技术,在优化过程中更好地平衡文本条件和无条件的生成效果;基于合理设置噪声时间表和优化步长等参数,加快优化收敛速度,减少生成时间。

分类器自由引导(CFG)是一种常用的技术,它可以提高生成模型的文本对齐能力。通过合理设置噪声时间表和优化步长等参数,Dive3D可以有效地提高优化效率,减少生成时间。

Dive3D的应用场景

Dive3D的应用场景非常广泛,几乎可以应用于所有需要3D模型的领域。以下将详细介绍Dive3D在几个典型领域的应用:

游戏开发

在游戏开发中,Dive3D可以用于快速生成游戏中的角色、道具和场景。传统的游戏开发需要耗费大量的时间和精力进行美术设计,而Dive3D可以根据游戏剧本中的描述,自动生成具有不同风格和细节的游戏角色模型,从而大大减少美术设计的工作量。

例如,游戏开发者可以使用Dive3D生成各种各样的游戏角色,如战士、法师、弓箭手等。他们还可以使用Dive3D生成游戏中的道具,如武器、盔甲、药品等。此外,Dive3D还可以用于生成游戏场景,如森林、城市、城堡等。

影视制作

在影视制作中,Dive3D可以为电影、电视剧和动画制作提供创意原型和概念设计。传统的影视制作需要耗费大量的时间和精力进行概念设计,而Dive3D可以根据剧本描述生成场景和角色的3D模型,帮助导演和美术师更好地进行创意构思。

例如,电影导演可以使用Dive3D生成电影中的场景,如外星球、未来城市、古代战场等。他们还可以使用Dive3D生成电影中的角色,如外星人、机器人、历史人物等。此外,Dive3D还可以用于生成电影中的道具,如宇宙飞船、高科技武器、古代文物等。

建筑设计

在建筑设计中,Dive3D可以根据文本描述生成建筑模型,帮助建筑师快速展示设计概念,进行方案比较和优化。传统的建筑设计需要耗费大量的时间和精力进行建模,而Dive3D可以根据文本描述自动生成建筑模型,从而大大减少建模的工作量。

例如,建筑师可以使用Dive3D生成各种各样的建筑模型,如住宅、商业建筑、公共建筑等。他们还可以使用Dive3D生成建筑的内部结构,如房间、楼梯、电梯等。此外,Dive3D还可以用于生成建筑的外部环境,如花园、街道、广场等。

虚拟场景构建

在虚拟场景构建中,Dive3D可以为VR和AR应用生成逼真的虚拟场景和物体。传统的虚拟场景构建需要耗费大量的时间和精力进行建模,而Dive3D可以根据文本描述自动生成虚拟场景和物体,从而大大减少建模的工作量。

例如,在虚拟旅游应用中,Dive3D可以根据用户输入的地点描述生成相应的3D场景,让用户身临其境地体验虚拟环境。在虚拟购物应用中,Dive3D可以根据商品描述生成相应的3D模型,让用户更好地了解商品的细节。

科学教育

在科学教育中,Dive3D可以生成复杂的科学模型,如生物细胞、分子结构等,帮助学生更好地理解抽象的科学概念。传统的科学教育常常使用静态的图片或模型,而Dive3D可以生成动态的3D模型,让学生更加直观地了解科学概念。

例如,教师可以使用Dive3D生成生物细胞的3D模型,让学生更好地了解细胞的结构和功能。他们还可以使用Dive3D生成分子结构的3D模型,让学生更好地了解分子的构成和性质。

总结

Dive3D作为北京大学与小红书联合推出的文本到3D生成框架,凭借其强大的功能和独特的技术原理,为3D模型生成领域带来了新的突破。它不仅能够生成多样化、高质量的3D模型,还具有良好的文本对齐能力和高效的优化算法。Dive3D的应用场景非常广泛,可以应用于游戏开发、影视制作、建筑设计、虚拟场景构建、科学教育等多个领域。相信在未来,Dive3D将会在更多的领域发挥重要作用,为人们的生活和工作带来便利。

Dive3D的出现,标志着文本到3D模型生成技术进入了一个新的阶段。它不仅提高了3D模型生成的效率和质量,还降低了3D模型生成的门槛。相信随着技术的不断发展,文本到3D模型生成技术将会越来越成熟,为人们带来更多的惊喜。