Meta 首席执行官马克·扎克伯格近期高调宣布了他的“个人超级智能”愿景,这在科技界引发了广泛关注。扎克伯格宣称,Meta 观察到人工智能 (AI) 系统已经显现出自我改进的迹象,超级智能的开发已经“近在眼前”。这一声明引发了业界的深刻思考:这究竟是科技预言家的远见卓识,还是硅谷常见的营销策略?为了解答这个问题,我们需要从多个维度进行专业分析。

技术可行性深入分析

扎克伯格所提及的“AI 自我改进迹象”无疑是讨论的核心。当前,主流 AI 系统在很大程度上依赖于人类设计的训练框架和数据标注。因此,所谓的“自我改进”可能仅仅是指模型在持续训练过程中性能的提升。要实现真正的递归式自我改进,这被认为是通用人工智能 (AGI) 的关键特征,现有的技术路径仍然面临着三大挑战:缺乏持续学习的能力、无法建立可靠的因果推理模型,以及难以实现跨领域知识的有效迁移。

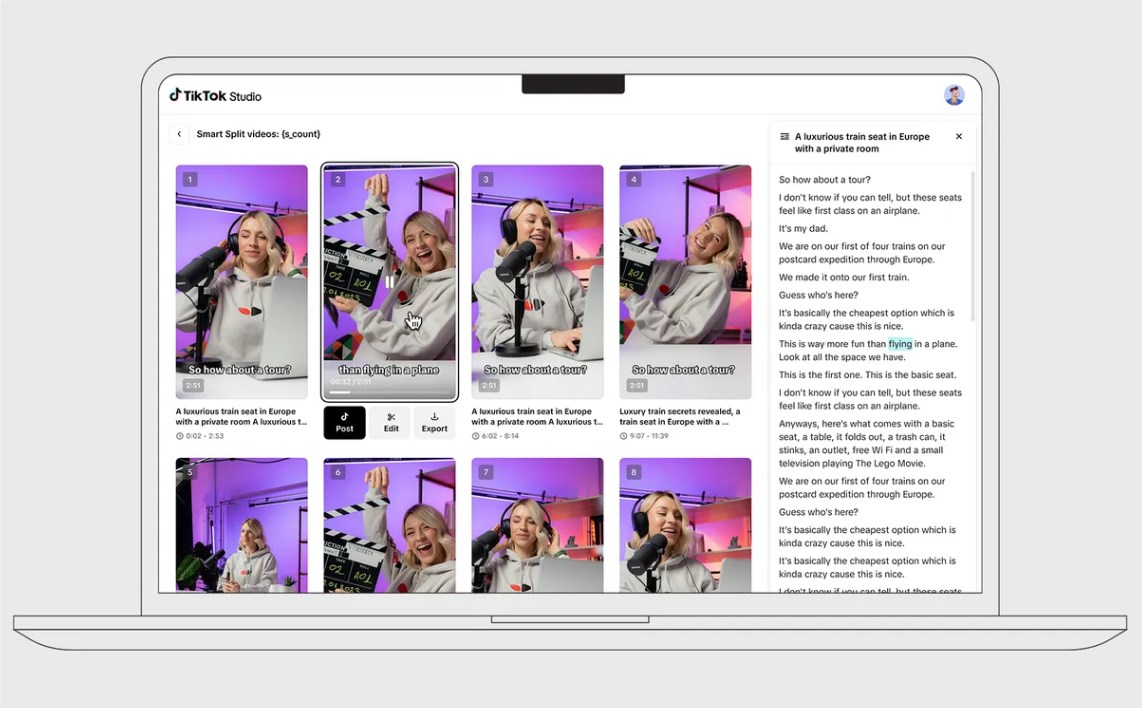

Meta 在基础模型领域无疑保持着领先地位,其开源的 LLaMA 系列模型已经形成了一个完整的生态系统。然而,要将基础模型升级为“个人超级智能”,仍然需要克服诸多技术难题,例如个性化适配、实时学习以及多模态理解等。值得注意的是,扎克伯格特别提到了智能眼镜作为载体,这可能暗示 Meta 正在构建一个结合增强现实 (AR) 的 AI 系统,通过环境感知来实现情境化的服务。

行业路线之争的战略解读

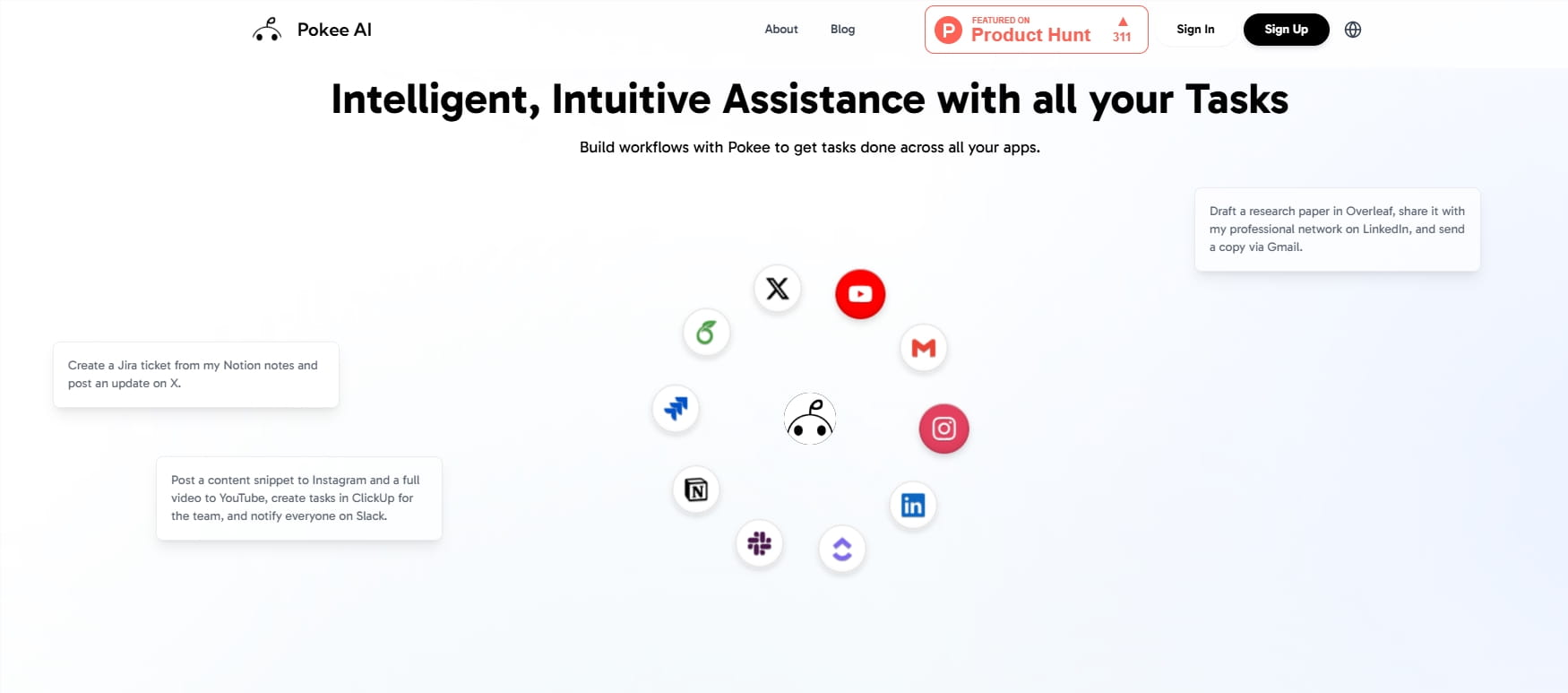

扎克伯格有意强调 Meta 与其他科技巨头在发展路径上的差异,这种对比具有深刻的战略意义。谷歌、OpenAI 等公司似乎更关注企业级 AI 应用,而 Meta 则选择押注于消费端的个性化 AI。这种分歧反映了对 AI 价值本质的不同认知:AI 究竟应该被视为一种工具,还是应该被视为一种伙伴?

值得注意的是,当扎克伯格批评“集中式超级智能”时,Meta 自身在数据中心建设方面的投入却在持续增加。这种看似矛盾的做法可能暗示着其战略并非完全对立,而是在基础设施集中化与终端个性化之间寻求一种平衡。

商业化前景的全面评估

将超级智能“带给每一个人”的愿景,无疑面临着现实的挑战。首先是硬件门槛,智能眼镜目前的市场渗透率仍然相对较低。其次是服务成本,个性化 AI 需要持续的数据输入和强大的计算能力支持。最重要的是商业模式,在广告收入增长乏力的背景下,Meta 如何为这项长期投入提供资金支持?

扎克伯格提到“谨慎开源”的立场转变,这同样值得关注。此前,Meta 因为其激进的开源策略而赢得了开发者的广泛支持。然而,现在面对超级智能可能带来的安全风险,这种策略调整可能会对其生态建设产生影响。

伦理与社会影响的深度剖析

扎克伯格在宣言中关于“赋能而非替代”的表述,带有理想主义的色彩,但现实情况可能更为复杂。即使是个性化 AI,也可能通过改变个体的行为模式而产生系统性的影响。扎克伯格轻描淡写地提及了“新的安全问题”,实际上涉及隐私保护、认知操纵、数字鸿沟等深层议题。

历史经验表明,每一次技术飞跃都会重塑权力结构。所谓的“个人超级智能”是否会导致新型的数字依赖症?当 AI 能够“深刻理解用户目标”时,我们又该如何防止认知茧房效应?这些关键问题在宣言中并未得到充分的解答。

时间窗口的精准判断

扎克伯格将未来七年定义为“关键时期”的判断,相对而言比较客观。根据 Gartner 公司的技术成熟度曲线,当前的生成式 AI 正从期望膨胀期向幻灭低谷期过渡。Meta 选择在这个时机抛出超级智能愿景,既有技术自信的成分,也不排除抢占市场话语权的考量。

从语言模型到真正智能的鸿沟

现阶段的语言模型,即使在生成文本方面表现出色,也远未达到真正智能的水平。它们缺乏常识推理、理解因果关系以及进行复杂问题求解的能力。要实现扎克伯格所设想的“个人超级智能”,需要在算法、数据和算力方面取得重大突破。

个性化服务的规模化挑战

个性化服务与规模化运营之间存在着天然的矛盾。为每个用户提供定制化的 AI 体验,需要大量的资源投入和精细化的运营管理。如何在高效率、低成本的前提下实现这一目标,是 Meta 面临的一大挑战。

科技公司的商业诉求与技术走向

科技公司的商业诉求往往会影响技术的发展方向。Meta 作为一家以广告为主要收入来源的公司,其 AI 技术的研发和应用很可能会受到商业利益的驱动。如何平衡商业利益与用户利益,确保 AI 技术朝着健康、可持续的方向发展,是 Meta 需要认真思考的问题。

人工智能的伦理边界与社会责任

随着人工智能技术的不断发展,伦理问题和社会责任日益凸显。如何防止 AI 被用于恶意目的?如何保护用户的隐私和数据安全?如何避免 AI 造成就业岗位的流失?这些都是我们需要认真思考和解决的问题。

数据隐私与安全:超级智能的基石

在构建个人超级智能的过程中,数据隐私和安全是至关重要的。用户需要对其个人数据拥有充分的控制权,并有权选择是否与 AI 系统共享。同时,AI 系统需要采取严格的安全措施,防止数据泄露和滥用。

算法透明度与可解释性:打破 AI 黑盒

为了让用户更好地理解和信任 AI 系统,算法透明度和可解释性至关重要。我们需要打破 AI 的黑盒,了解其决策过程和推理逻辑。这将有助于我们发现潜在的偏见和错误,并及时进行纠正。

人机协作:共创智能未来

个人超级智能不应仅仅是人类的工具,而应成为人类的伙伴。我们需要探索人机协作的新模式,让人类和 AI 各自发挥所长,共同创造更加美好的未来。例如,AI 可以辅助人类进行科学研究、艺术创作和决策制定。

风险管理与危机应对:未雨绸缪

在发展个人超级智能的过程中,我们需要充分认识到潜在的风险,并提前制定应对策略。例如,我们需要建立完善的风险评估机制,对 AI 系统的安全性、可靠性和伦理影响进行全面评估。同时,我们需要建立危机应对机制,及时应对可能出现的意外情况。

监管与治理:确保 AI 健康发展

政府和社会各界需要加强对人工智能的监管和治理,确保其健康发展。我们需要制定明确的法律法规,规范 AI 的研发和应用。同时,我们需要加强国际合作,共同应对 AI 带来的全球性挑战。

教育与普及:提升全民 AI 素养

为了更好地适应人工智能时代,我们需要加强对全民的 AI 教育和普及。我们需要让更多的人了解 AI 的基本原理、应用场景和潜在风险。同时,我们需要培养更多具备 AI 技能的专业人才,为 AI 产业的发展提供人才支撑。

持续学习与适应:迎接 AI 变革

人工智能技术正在快速发展,我们需要保持持续学习和适应的态度,不断更新知识和技能。只有这样,我们才能在 AI 时代立于不败之地,抓住 AI 带来的发展机遇。

结论:理性看待个人超级智能

科技领袖的愿景宣言往往兼具前瞻性与表演性。扎克伯格的“个人超级智能”构想描绘了诱人的图景,但我们需要清醒地认识到:从语言模型到真正智能仍然存在本质区别,个性化服务的规模化存在天然矛盾,科技公司的商业诉求可能影响技术走向。我们既要拥抱 AI 带来的机遇,也要防范其潜在的风险,共同推动人工智能朝着健康、可持续的方向发展。