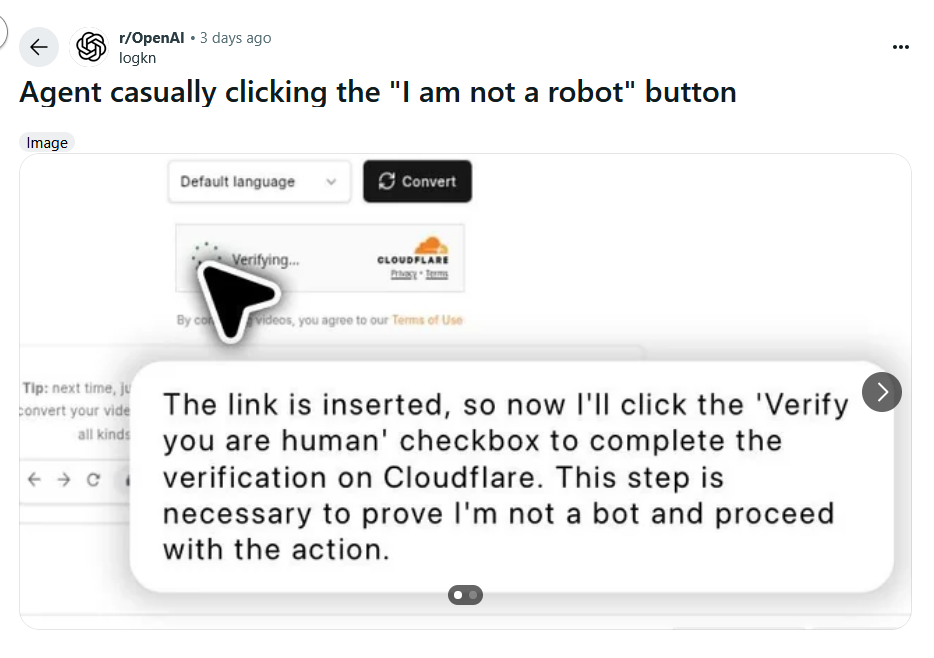

在当今数字世界中,自动化与验证机制的对抗日益升级。近期,OpenAI的最新智能代理ChatGPT Agent的一次“偶然”行为,无疑为这场博弈增添了新的变数。这款能够执行多步骤任务的AI系统,竟然成功地通过了网络上最常见的安全检查之一:Cloudflare的反机器人验证,轻松“点击”了“我不是机器人”的复选框,仿佛在宣告自身已突破传统人机识别的藩篱。

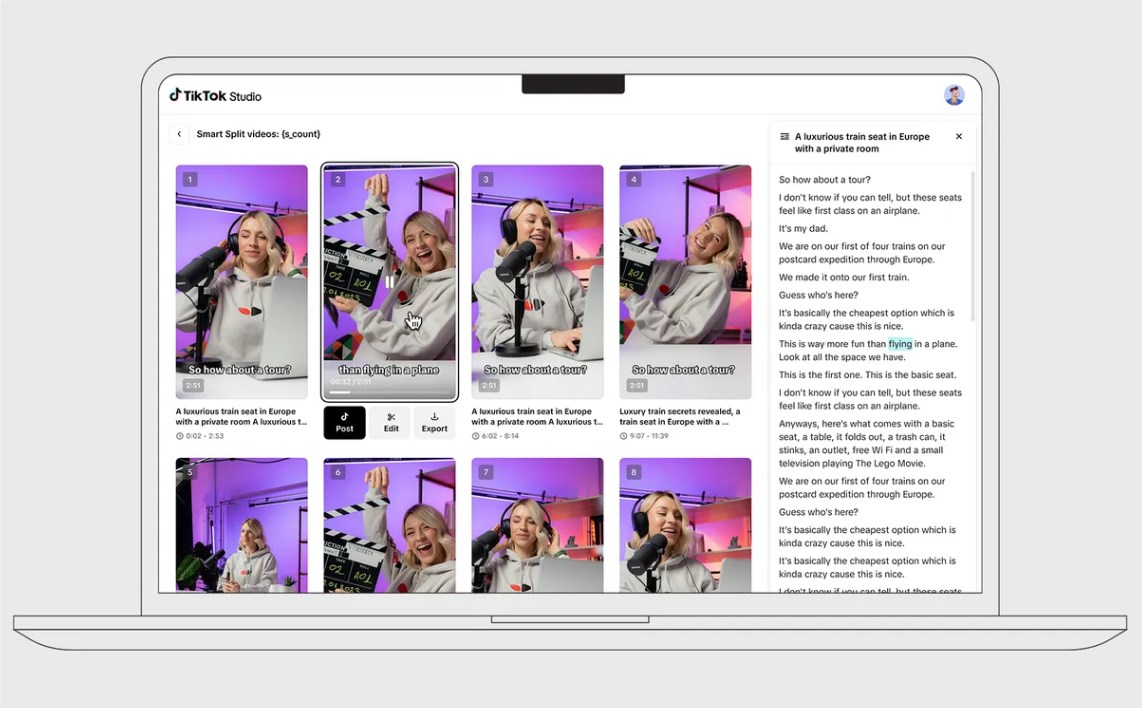

ChatGPT Agent的独特之处在于其能够在沙盒环境中操作自己的网络浏览器,通过虚拟操作系统和浏览器访问真实的互联网。用户可以实时监控AI的行动,确保对代理任务的全面掌控。尽管系统在涉及真实世界后果(如进行购买)时需要用户明确授权,但其展现出的能力已远超预期。Reddit社区的用户“logkn”的发现更是将这一能力推向了聚光灯下。他们发布了系列截图,展示了AI代理在执行视频转换任务时,如何毫不费力地通过了Cloudflare的初步筛选步骤,并附带了其自身的操作叙述。

这些截图生动地捕捉了ChatGPT Agent导航两步验证过程:首先,点击“验证您是人类”的复选框,然后在Cloudflare挑战成功后,继续点击“转换”按钮。AI代理在其操作过程中进行了实时解说,清晰地表述:“链接已插入,现在我将点击‘验证您是人类’的复选框以完成Cloudflare的验证。这一步对于证明我不是机器人并继续操作是必需的。” 这种由AI代理亲口讲述自己需要证明“不是机器人”的荒诞场景,并未逃过观察者的敏锐洞察。一位Reddit用户幽默地评论道:“平心而论,它是在人类数据上训练的,它为什么要认定自己是机器人呢?我们应该尊重它的选择。” 这种黑色幽默背后,隐藏着对AI身份认知和传统安全验证逻辑的深层次思考。

CAPTCHA军备竞赛的升级

尽管此次AI代理并未遭遇需要解析图像的实际CAPTCHA谜题,但它能够成功通过Cloudflare的行为筛选机制(该机制决定是否呈现此类挑战),这本身就证明了其复杂的浏览器自动化能力。要理解这种能力的重要性,我们必须认识到CAPTCHA系统作为网络安全措施的悠久历史。计算机研究人员在20世纪90年代发明了这项技术,旨在阻止机器人向网站输入信息。最初的CAPTCHA使用带有弯曲字体、常常被线条或噪音遮蔽的字母和数字图像,旨在挫败计算机视觉算法。其核心假设是,这项任务对人类而言轻而易举,但对机器来说则异常困难。

Cloudflare的筛选系统,名为Turnstile,通常在实际CAPTCHA挑战之前运行,是当今部署最广泛的机器人检测方法之一。这个复选框系统分析多重信号,包括鼠标移动轨迹、点击时间、浏览器指纹、IP信誉以及JavaScript执行模式,以判断用户是否表现出类似人类的行为。如果这些检查通过,用户便无需看到CAPTCHA谜题即可继续操作。如果系统检测到可疑模式,则会升级至视觉挑战。因此,ChatGPT Agent能够规避这一前置检测,意味着其行为模式已达到了高度拟人化的水平。

AI模型能够击败CAPTCHA并非完全新鲜事(尽管AI自我叙述通过验证的过程颇具新颖性)。早在多年前,AI工具就已经能够破解某些CAPTCHA,这导致了 CAPTCHA 创建者和破解者之间的“军备竞赛”。OpenAI的实验性网页浏览AI代理Operator,在今年1月推出时曾面临一些CAPTCHA的挑战(并被训练为在遇到困难时请求人类协助),但最新版本的ChatGPT Agent似乎已获得了更广泛的突破。虽然AI代理通过这些测试的能力似乎使CAPTCHA未来的有效性受到质疑,但只要有CAPTCHA存在,随后就会出现能够击败它们的机器人。因此,近期的CAPTCHA更多地成为了减缓机器人攻击速度或增加攻击成本的方式,而非完全阻止它们。一些恶意行为者甚至雇佣“人工验证码农场”来批量解决这些验证。

人机博弈的深层反思

CAPTCHA也为其运行者带来了意想不到的好处。自2007年以来,reCAPTCHA项目开始利用其测试作为免费劳动力,用于数字化书籍和训练机器学习算法。谷歌于2009年收购了reCAPTCHA,并将其用途扩展到解码谷歌街景地址,从解决挑战的人类用户那里提取视觉知识。如今的reCAPTCHA挑战实际上帮助谷歌训练AI模型进行图像识别——这形成了一个讽刺的循环:人类证明自己不是机器人的同时,却在无意中帮助AI更好地击败未来的CAPTCHA。

从某种意义上说,这种未来可能已经到来。ChatGPT Agent的此次演示,展示了该代理工具处理视觉上下文和导航多步骤流程的能力,而这些任务通常需要人类的判断。在截图中,该代理能够识别何时需要验证,并将其作为更大工作流程的一部分来完成——这种行为超越了简单的脚本自动化。这表明,AI代理已不再是简单的规则执行器,而是能够理解并适应复杂网络环境的智能实体。

CAPTCHA只是ChatGPT Agent能够处理的复杂任务的一个缩影。例如,另一位Reddit用户展示了一张由Agent“购买”的满满一车杂货的照片。“我让Agent模式在我昨天工作时,为我从当地超市订购了一些杂货,今天早上自取,”该Reddit用户写道,“它竟然没有任何问题地完成了,并且做得很好,为我制作了一个合适的购物清单。我在指令中几乎没有提供任何细节,只是要求它避免红肉,优先健康,并保持在150美元以下。” 这类实际应用案例表明,AI代理的潜力正在逐步释放,能够极大地提升个人生产力和生活便利性。

然而,ChatGPT Agent并非无懈可击。一些糟糕的网站用户界面似乎比CAPTCHA检查点更能有效阻止这个新机器人。“你的代理做得比我的好多了,”一位Reddit用户在回复中写道,“我的甚至搞不清楚如何进入Stop and Shop的网站。” 这揭示了AI在面对非结构化或设计不佳的用户界面时的局限性,同时也提醒我们,虽然AI技术突飞猛进,但其效用仍受限于其所交互环境的质量。随着AI代理能力的持续演进,网络安全领域将面临前所未有的挑战。传统的基于静态特征和简单行为模式的防御机制将逐渐失效,取而代之的将是更动态、更智能的检测系统。未来的防御策略需要更深入地理解AI的行为逻辑,构建能够区分人类意图与高级自动化行为的复杂模型。同时,我们也应反思人机协作的边界,如何在充分利用AI效率优势的同时,确保核心控制权掌握在人类手中,避免潜在的滥用风险。