AI驱动的价格与工资设定:技术进步的边界与监管困境

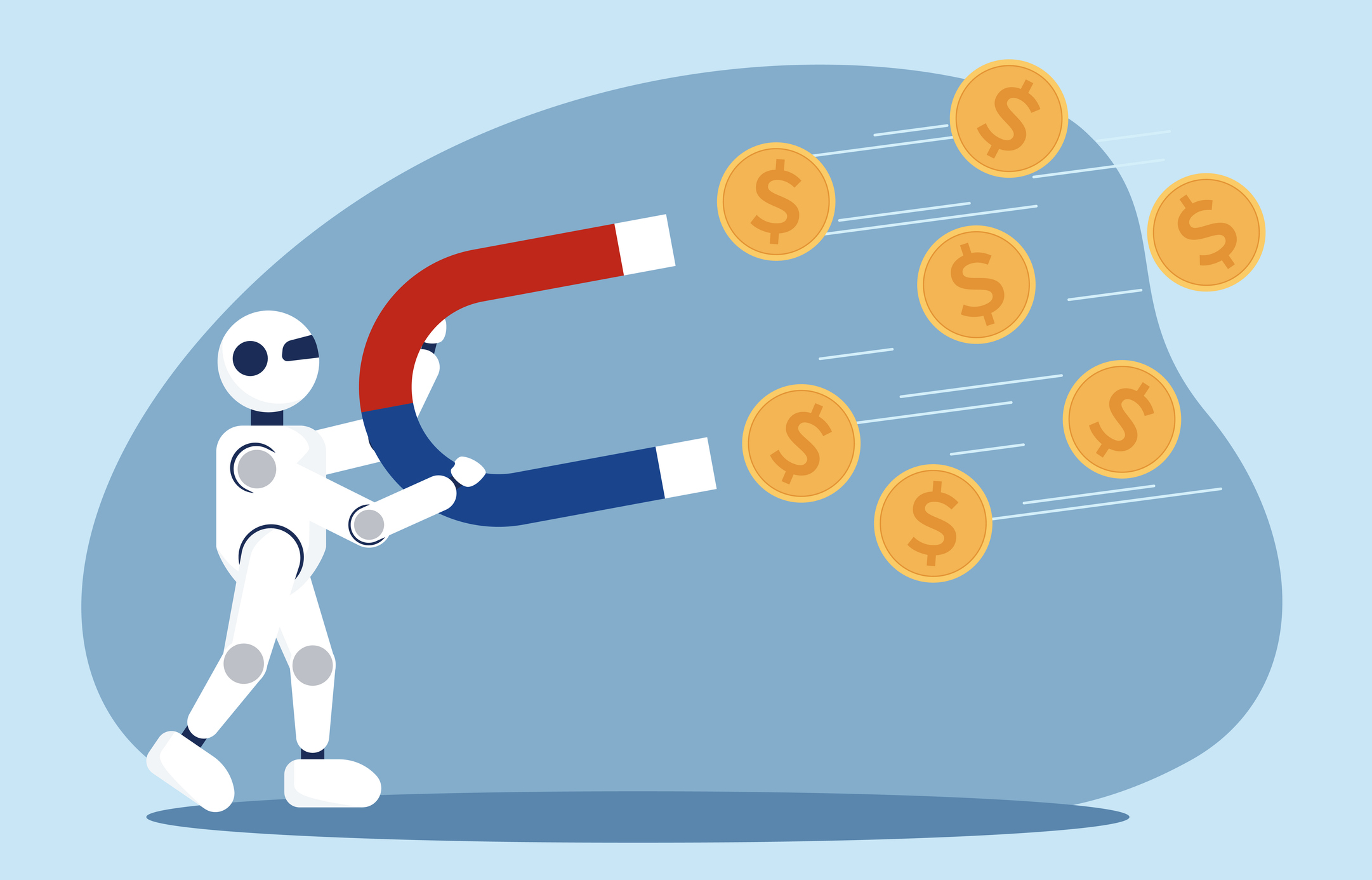

人工智能(AI)技术在全球范围内的迅速发展,正以前所未有的速度重塑各行各业的运营模式,从提升生产效率到优化客户体验,其潜力无疑是巨大的。然而,正如每一项颠覆性技术一样,AI的应用也伴随着复杂的伦理、社会和经济挑战。近年来,尤其是在动态定价和员工薪酬设定领域,AI的“智能”决策能力引发了关于公平性、透明度和潜在剥削的深刻讨论。例如,航空业巨头达美航空(Delta)对其AI定价系统的扩展测试,便如同投入了一枚石子,在平静的市场水面激起了千层浪,其核心争议在于:AI究竟是市场效率的助推器,还是价格歧视与工资压榨的新工具?

智能定价的本质:效率提升抑或隐形操纵?

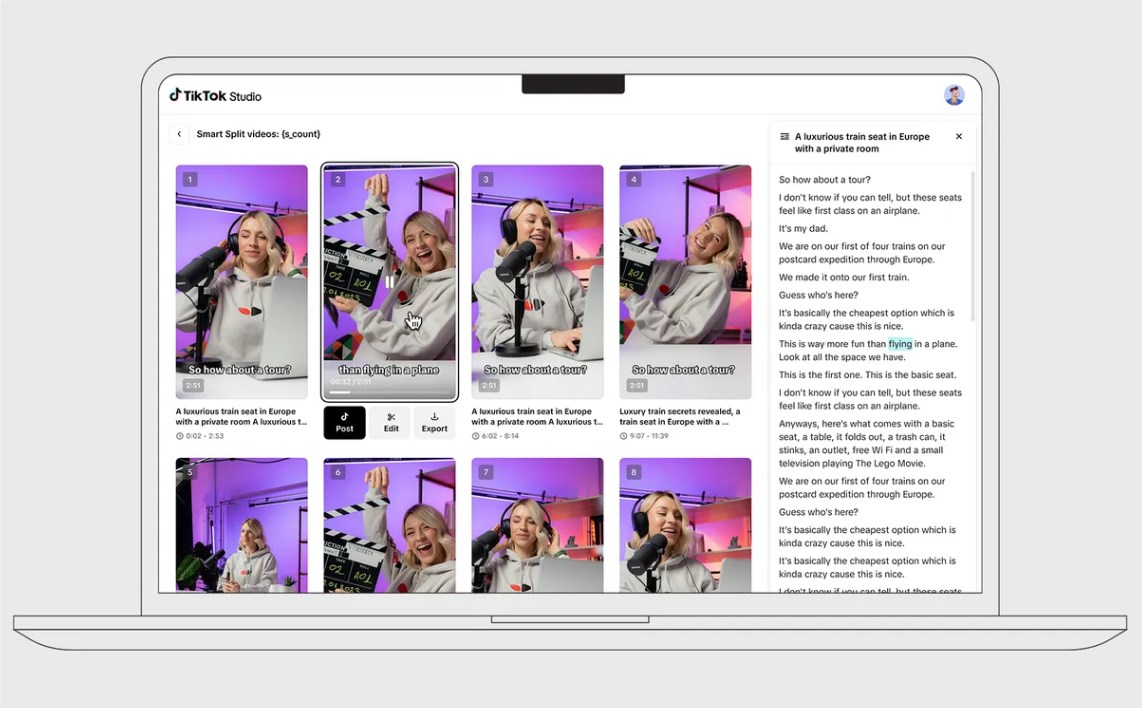

长期以来,动态定价模型在航空、酒店等行业已是常态,其核心是根据需求、供给、时间等多种变量来调整价格,以实现收益最大化。AI的引入,无疑将这一过程推向了更高的精细化水平。达美航空声称其AI系统主要用于预测航班需求、适应市场变化(如燃油成本)以及从历史定价决策中学习,且不针对个人数据进行“定制化”报价。然而,批评者与立法者普遍担忧,AI系统通过分析用户的购买行为、历史需求模式、甚至是其他竞争性报价的偏好等“广泛变量”,实质上构建了对用户支付意愿的深度画像,进而实现了隐形的个性化定价——即根据“消费者对某产品的迫切程度以及其愿意支付的最高金额”来设定价格。

这种模式的潜在风险在于,它可能打破了传统市场中“一价定律”的公平性,使每个消费者都可能面临不同的报价,而这些报价并非基于公开透明的成本或市场供需,而是基于AI对个人“绝望程度”或“经济状况”的算法判断。例如,一些案例显示,共享出行应用会根据用户手机电量低的情况提供更高报价,这无疑利用了消费者当下的“困境”。这种AI定价的“黑箱”操作,正是引发社会广泛争议和监管关注的根本原因。

立法锋芒:美国《制止AI哄抬物价和固定工资法案》解析

为了应对AI在定价和工资设定中可能引发的滥用问题,美国国会议员格雷格·卡萨尔(Greg Casar)和拉什达·特莱布(Rashida Tlaib)联手推出了《制止AI哄抬物价和固定工资法案》(Stop AI Price Gouging and Wage Fixing Act)。该法案的核心目标是明确禁止公司利用“基于监控的”AI系统来提升利润率,无论是通过提高消费者价格还是降低员工工资。

该法案的关键亮点在于其赋予受害者直接起诉企业的权利。如果公司被发现不公平地使用AI,受影响的消费者或员工可以要求赔偿,赔偿金额将是AI系统推荐的不公平交易差额或3000美元中的较高者;而对于恶意违规行为,赔偿金可提高至三倍。这一规定无疑为受AI算法剥削的个体提供了有力的法律武器。

法案中特别指出,AI对工人薪酬的影响同样不容忽视。例如,送货服务公司可能根据司机的接单模式来降低其工资,而医疗保健公司则可能基于“算法操纵的竞价战”而非实际工作表现来设定护士工资。这些案例清晰地揭示了AI在劳动力市场中可能造成的“工资固定”问题,使工人薪资与绩效脱钩,进一步加剧了职场不公。

行业实践与监管审视:FTC的警告与市场乱象

《制止AI哄抬物价和固定工资法案》的出台,并非空穴来风,它与美国联邦贸易委员会(FTC)在2025年1月启动的一项调查紧密相关。FTC向万事达(MasterCard)、Revionics、Bloomreach、摩根大通(JPMorgan Chase)等多家提供AI定价服务的公司发出信息请求,揭示了一个“影子市场”的存在。这些公司为至少250家从杂货店到服装零售商的各类企业提供AI定价解决方案。FTC的初步结论指出,“这种做法的广泛采纳可能从根本上颠覆消费者购买产品的方式以及公司竞争的方式。”

消费者权益保护组织“公共公民”(Public Citizen)和反垄断倡导团体“美国经济自由项目”(American Economic Liberties Project)均对该法案表示支持。他们强调,自疫情期间线上购物激增以来,美国杂货价格已上涨26%,这与旨在从消费者身上榨取每一分钱的新技术“不谋而合”。这种趋势不仅加剧了美国的“负担能力危机”,也使得许多人难以负担基本生活用品。

市场公平性的核心在于信息对称和透明定价。当AI能够根据消费者个体特征和支付意愿来调整价格时,“好交易”的概念便不复存在,因为每个消费者都可能支付不同甚至更高的价格。这种“算法歧视”不仅损害了消费者的基本权益,也扭曲了正常的市场竞争秩序。

伦理边界与技术向善:AI治理的深层思考

AI定价的争议,实际上是更广泛的AI治理问题的一个缩影。它要求我们深入思考,在追求技术效率和商业利益的同时,如何坚守伦理底线,确保技术发展的方向符合社会公平和公共利益。

- 透明度与可解释性: AI定价系统的“黑箱”操作是其饱受诟病的主要原因。未来立法和监管应强制要求AI定价模型具备更高透明度,让消费者了解价格形成的基本逻辑,而非仅仅面对一个“算法推荐”的最终数字。

- 数据隐私与滥用: AI定价的精准性很大程度上依赖于对用户个人数据的深度分析。法案提及的“基于监控的定价”,正是指向了对用户行为、财务状况乃至人口统计学信息的过度收集和利用。这要求更严格的数据隐私保护法律,限制企业对敏感数据的采集、存储和使用。

- 反垄断与市场竞争: AI定价可能导致市场共谋或变相垄断。当少数几家大型企业都使用相似的AI算法优化价格时,它们可能在无意中形成一种“算法卡特尔”,共同推高价格,损害市场竞争活力。因此,反垄断机构需密切关注AI技术对市场结构和竞争格局的潜在影响。

- 社会公平与经济包容性: AI定价如果导致特定弱势群体(如低收入者、老年人)因算法判断而支付更高价格或获得更低工资,将进一步加剧社会不平等。构建一个包容性的数字经济,要求AI设计和应用必须充分考虑其对不同社会群体的影响,避免“数字鸿沟”演变为“算法鸿沟”。

展望未来:在AI洪流中划定清晰界线

目前,该法案能否获得共和党足够支持尚不明朗,尤其考虑到共和党FTC委员此前曾对相关报告的发布表示异议。但这并不影响其作为一项重要立法尝试的意义。它在AI技术发展的关键时期,试图为商业实践划定一条清晰的界线:企业可以提供折扣和公平的工资,但绝不能通过“监视人民”来实现。

技术是中性的,但其应用则带有价值判断。我们正站在一个十字路口,AI的巨大潜能正等待被释放,但同时也面临着被滥用的风险。正如提案者所言,“大型公司不应被允许利用监控所得数据来提高您的价格或降低您的工资。” 消费者和工人可能在不知不觉中被AI“剥削”,而这个问题若不加以干预,恐将演变为一场“全面危机”。

因此,立法者、监管机构、企业以及社会各界,都需要共同努力,在创新与责任之间寻求平衡。通过构建健全的法律框架、强化伦理审查、提升技术透明度,并鼓励负责任的AI开发和应用,我们才能确保AI真正成为促进社会进步和福利的工具,而非加剧不平等和剥削的推手,最终实现AI与人类社会和谐共存的未来。