人工智能(AI)技术的飞速发展正深刻改变全球产业格局,然而,随之而来的监管议题也日益成为焦点。在欧美两大经济体中,对待AI监管的态度截然不同。美国政府倾向于鼓励创新,对AI规制持谨慎态度,甚至有尝试限制州级层面AI立法的举动。与此形成鲜明对比的是,欧盟则积极推动构建全面的AI监管框架,以应对潜在的风险与挑战。这种差异化策略,特别是欧盟在AI治理上的先行实践,为全球AI治理提供了重要的参考范本。

谷歌的战略抉择:从犹豫到拥抱

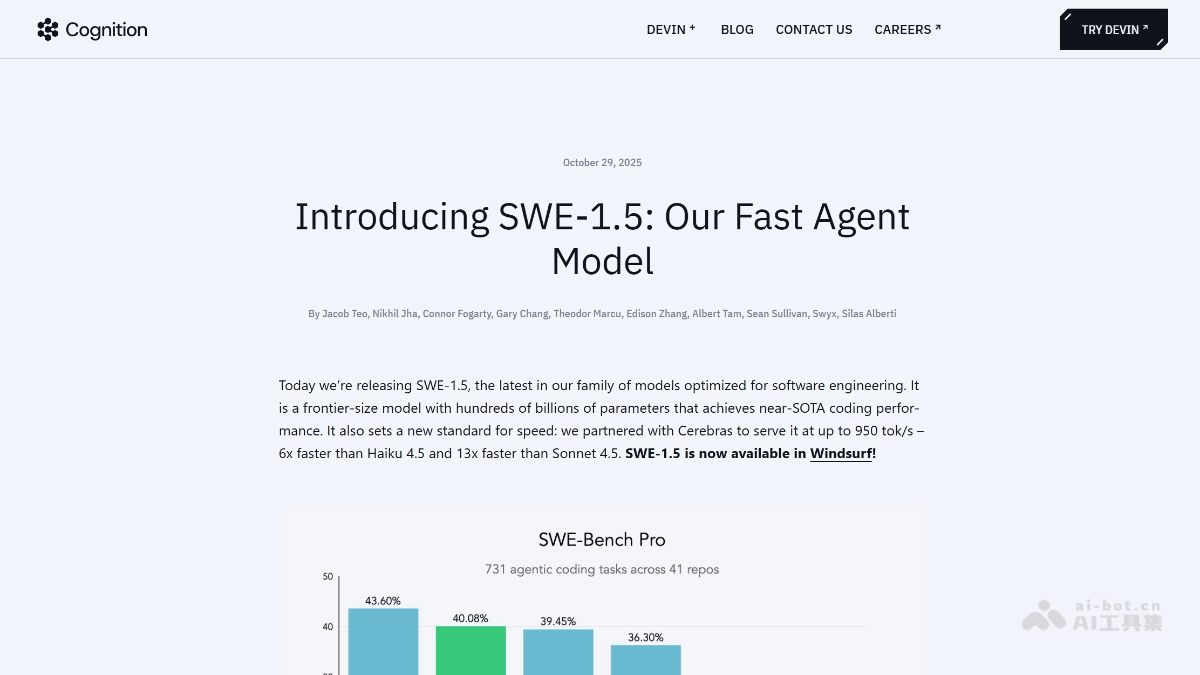

此前,许多科技巨头对AI监管表现出抵触情绪,尤其是在版权合规和训练数据披露方面。谷歌在早期也曾对欧盟的《AI行为准则》(AI Code of Practice)持保留态度,认为其可能过于严苛,有扼杀创新之虞。然而,谷歌近期却正式确认将签署该准则,这一转变不仅是其在欧洲市场策略的重大调整,更反映出其对全球AI监管趋势的深刻洞察。谷歌全球事务主管肯特·沃克(Kent Walker)指出,公司通过与欧盟委员会的积极沟通,确保了最终准则能为欧洲市场提供“安全、一流的AI工具”。谷歌甚至预测,AI工具在欧洲的普及,有望在2034年前每年为欧洲经济贡献约8%的增长,即约1.8万亿欧元。这种对经济效益的强调,无疑是谷歌试图在欧洲市场争取更多商业利益支持的重要策略。

谷歌此举的目的显然不仅仅是合规。通过主动签署并积极参与《AI行为准则》的制定和实施,谷歌得以“入局”核心治理圈,拥有在政策执行层面施加影响力的机会。这比完全拒绝合规,任由监管机构单方面决策要明智得多。谷歌依然关注版权指南的收紧和强制披露可能涉及商业秘密的数据,担忧这些规定可能减缓创新步伐。因此,保持“一席之地”便成为其在未来监管博弈中争取有利位置的关键。这种策略与Meta公司的立场形成鲜明对比,Meta坚决拒绝签署该准则,声称其可能对前沿模型开发施加过多限制,这与其加速其“超智能”项目的野心不谋而合。而微软仍在权衡,ChatGPT的开发者OpenAI则已表示将签署该准则,显示出头部企业在面对监管时的不同考量和策略分化。

欧盟的AI监管框架:前瞻性与严谨性

欧盟在AI监管方面的积极探索,为全球提供了独特的视角。相比于美国在AI监管上的保守与迟疑,欧盟展现了对AI潜在负面影响的严肃态度。其快速演进的监管框架旨在为AI企业提供更明确的法律环境,尤其是在技术发展日新月异的背景下,这种确定性显得尤为重要。

《AI行为准则》的诞生凝聚了广泛的社会共识,超过1000个公民团体、学术机构和行业专家参与了意见征集与研讨。欧盟委员会强调,自愿采纳该准则的企业将享有较低的行政负担,从而更容易遵守已于去年生效的《欧盟AI法案》(EU AI Act)。这一激励机制旨在鼓励企业积极参与,共同构建负责任的AI生态。

根据《AI行为准则》的条款,签署企业,如谷歌,将需公布其模型训练数据的摘要,并向监管机构披露额外的模型特性。准则还就企业如何管理安全和保障以符合《AI法案》提供了指导,并为企业模型开发如何与欧盟的AI版权法保持一致指明了路径。这些规定无疑触及了谷歌等公司的一些“痛点”,特别是关于数据透明度和版权合规性的要求。

对于像Meta这样未签署《AI行为准则》的公司,也无法逃避监管。所有在欧洲运营的AI公司都必须遵守《欧盟AI法案》。该法案是目前全球针对生成式AI系统最详细的监管框架之一,禁止高风险的AI应用,例如故意的欺骗或操纵用户、社会评分系统以及公共场所的实时生物识别扫描。违反《AI法案》的企业将面临严厉处罚,罚款最高可达3500万欧元(约4010万美元),或高达其全球营收的7%。如此高额的罚款,足以让任何企图规避监管的企业三思。

行业影响与未来展望

谷歌签署《AI行为准则》的举动,不仅仅是其自身合规性提升的表现,更是对整个AI行业发出了一个明确信号:在全球范围内,AI的监管时代已经到来。特别是欧盟这种“先发制人”的监管模式,可能促使其他司法管辖区效仿,形成一套更加统一和严谨的全球AI治理标准。

从更深层次来看,科技巨头对AI监管态度的转变,反映了其在面对公众担忧和潜在法律风险时,从单纯的技术驱动转向更注重社会责任与可持续发展的考量。这种转变将促使AI公司在设计、开发和部署AI系统时,更加关注公平性、透明度、可解释性和安全性,从而推动AI技术朝着更加负责任的方向发展。

然而,监管与创新之间的平衡始终是横亘在AI发展道路上的核心难题。过于严苛的监管可能抑制技术探索和市场活力,而缺乏有效监管又可能导致技术滥用和社会风险的激增。欧盟《AI行为准则》和《AI法案》的实施,将是检验这种平衡能否实现的试金石。未来的发展将取决于监管机构、行业企业、学术界以及公民社会之间的持续对话与协作,共同探索出一条既能激发AI潜力,又能有效管控风险的道路。AI技术的未来,正是在这种复杂而动态的监管环境中不断演进,其对社会和经济的深远影响,将在全球范围内持续发酵。