移动智能的突破:MiniCPM-V4.0如何定义下一代边缘AI

随着人工智能技术的飞速发展,将复杂AI能力部署到移动设备端已成为业界焦点。传统大型AI模型虽然性能卓越,但其庞大的参数量和高昂的计算需求,使得在资源受限的智能手机、平板电脑等边缘设备上运行面临巨大挑战。这不仅限制了AI应用的普及,也阻碍了本地化、低延迟智能服务的实现。在此背景下,追求轻量化与高性能兼备的多模态模型,成为推动移动AI革新的关键方向。

近期,一款名为MiniCPM-V4.0的创新性多模态大模型正式亮相,凭借其精巧的架构设计和在移动设备上的出色表现,被业界誉为“手机上的GPT-4V”。它的发布,预示着移动端人工智能即将迎来一场深刻的变革,为用户带来前所未有的智能交互体验,并为开发者开启了广阔的应用前景。

核心架构:轻量与强大的完美平衡

MiniCPM-V4.0的成功并非偶然,其背后是深思熟虑的架构设计哲学。该模型基于SigLIP2-400M和MiniCPM4-3B构建,参数总量仅为4.1亿。这种独特组合的核心在于,它巧妙地在模型尺寸和理解能力之间找到了一个最佳平衡点。SigLIP2-400M作为高效的视觉编码器,能够将图像信息转化为紧凑且富有语义的向量表示;而MiniCPM4-3B则作为强大的语言模型,负责处理复杂的逻辑推理和文本生成。两者的有机结合,使得MiniCPM-V4.0能够在极小的体积下,实现对图像、多图像关联内容乃至视频片段的深度理解,远超同等参数量级模型的能力边界。

这种设计不仅有效降低了模型的内存占用和计算复杂度,也为模型在边缘设备上的高效运行奠定了基础。它挑战了“越大越好”的传统观念,证明了通过结构创新和优化,可以在不牺牲核心性能的前提下,实现模型的高度精简。

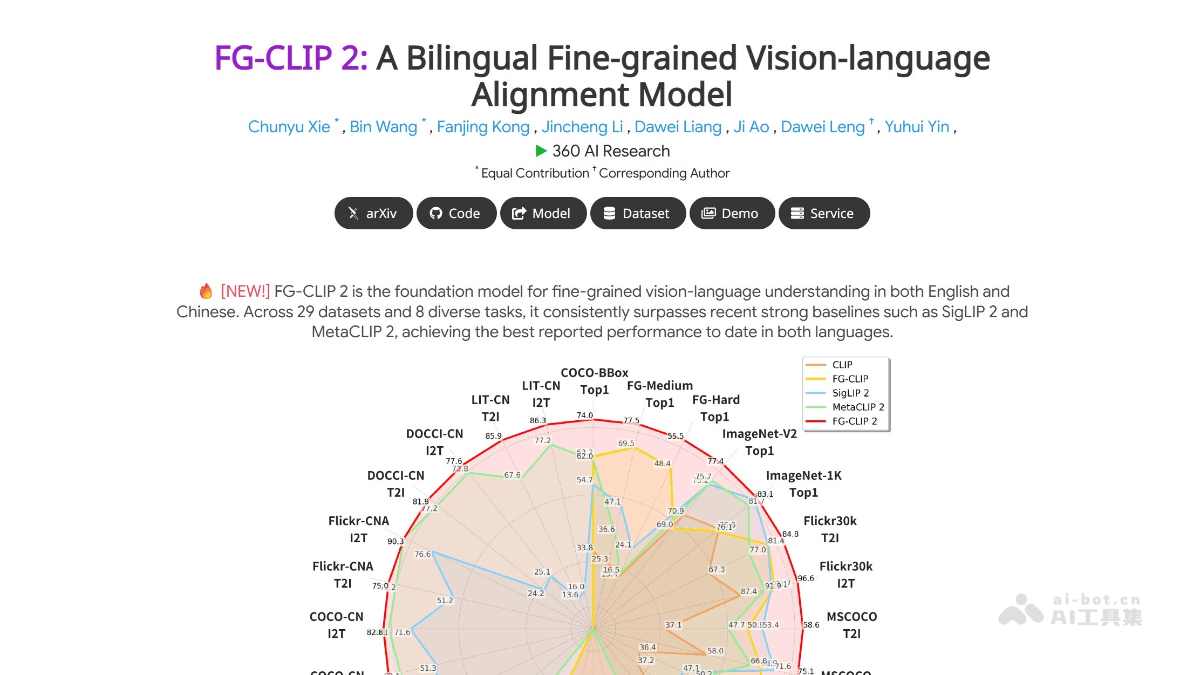

卓越性能:OpenCompass评测的验证

尽管参数量小巧,MiniCPM-V4.0在性能方面的表现却令人瞩目。在权威的OpenCompass八大主流评测基准上,该模型取得了高达69.0的平均得分。这一成绩具有里程碑意义,因为它超越了包括GPT-4.1-mini和Qwen2.5-VL-3B在内的众多知名竞争对手。

这意味着MiniCPM-V4.0在处理各类复杂视觉理解任务时,展现出卓越的准确性和深度分析能力。无论是在图像识别、对象定位,还是在理解图像中蕴含的复杂语义关系、进行多模态推理方面,该模型都表现出了一致的高水平。尤其是在资源受限的移动环境下,其能够达到甚至超越大型云端模型的某些性能指标,无疑为行业带来了新的启示。这一数据不仅是模型实力的证明,更是移动AI未来发展潜力的有力佐证。

深度优化:移动设备端的无缝体验

MiniCPM-V4.0的一大核心优势在于其针对移动设备的深度优化。在最新的iPhone16Pro Max上的实际测试结果令人印象深刻:该模型首次响应延迟低于2秒,解码速度超过每秒17个token。更值得一提的是,在持续运行中,它能够有效控制设备发热,确保了长时间使用的流畅性和稳定性。这些性能指标对于移动端AI应用至关重要,它们直接关系到用户体验的即时性和舒适性。

实现这些优化并非易事,它涉及到复杂的模型量化、剪枝以及运行时推理引擎的深度定制。通过这些技术手段,模型能够在有限的移动硬件算力下,最大化地发挥效能。例如,低延迟响应使得用户能够实时获得AI的反馈,而高解码速度则确保了生成内容的流畅输出。同时,对设备发热的有效控制意味着AI应用不再是电量杀手或烫手山芋,真正实现了在日常使用中的“隐形”运行,为本地化AI服务提供了坚实的技术支撑。

生态支持与普惠化愿景

为进一步降低开发者的使用门槛,加速模型的应用落地,MiniCPM-V4.0提供了全面的生态支持。它兼容llama.cpp、Ollama和vllm_project等主流推理框架,为不同开发背景的工程师提供了灵活多样的部署选择。这种广泛的兼容性,使得开发者可以根据自身的技术栈和项目需求,快速集成和部署模型,大大缩短了开发周期。

此外,为推动模型在移动端的直接应用,该模型还专门开发了iOS应用程序,支持在iPhone和iPad等苹果设备上直接运行,这为移动应用开发者提供了极大的便利。配套发布的详细Cookbook,提供了完整的教程和代码示例,进一步赋能开发者社区,确保他们能够充分利用MiniCPM-V4.0的强大能力。这种开放和支持的态度,不仅展现了AI团队对技术普惠化的承诺,也为全球开发者共同探索移动端多模态技术的创新应用,构建了坚实的基础。

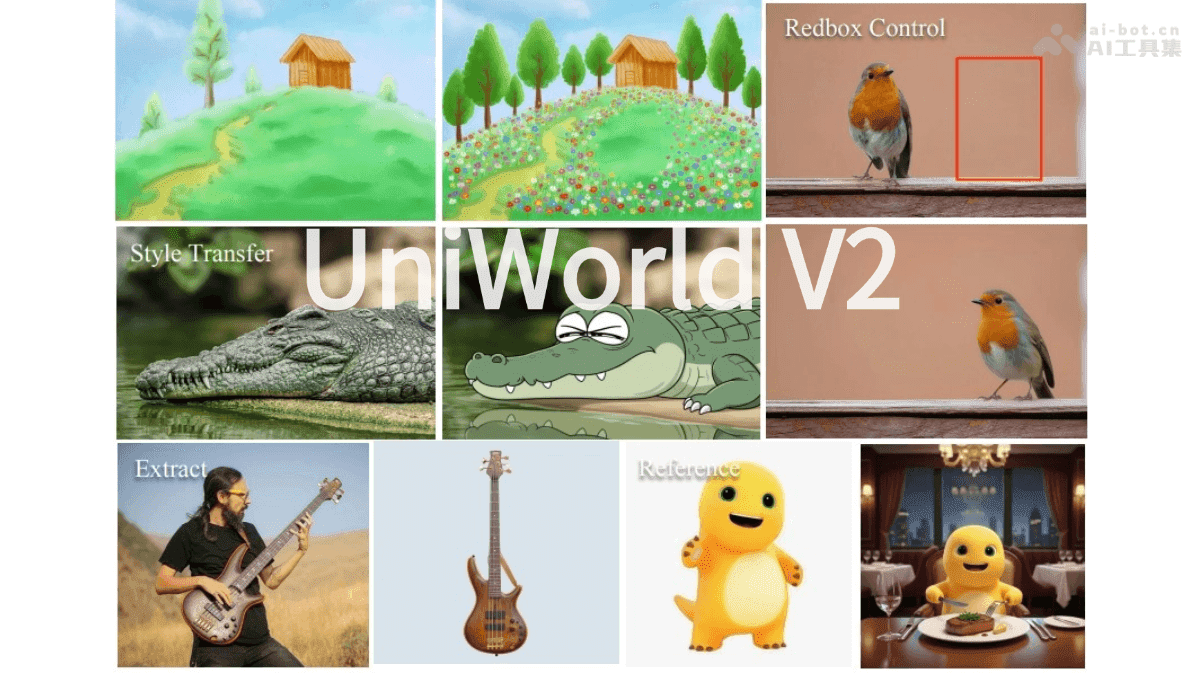

多模态能力:赋能广泛应用场景

MiniCPM-V4.0的强大多模态理解能力使其在诸多实际应用场景中展现出巨大潜力:

图像分析与多轮对话: 用户可以上传一张图片,模型不仅能精确识别图片中的主体、场景和细节,还能在此基础上与用户进行深度、上下文关联的连续对话。例如,在电商领域,用户上传商品图片后,模型可提供详细的产品信息、搭配建议;在医疗领域,辅助医生分析医学影像,并进行病理讨论。

视频内容理解: 模型能够分析动态视频流的内容,识别视频中的人物、动作、事件和场景变化。这为智能安防、内容审核、体育赛事分析、教育视频摘要等领域提供了全新的解决方案。通过对视频的深度理解,可以实现异常行为检测、精彩瞬间捕捉或自动生成视频描述。

OCR(光学字符识别)与数学推理: 模型具备识别图片中复杂文字信息的能力,包括手写体、表格和图表中的数据。更重要的是,它能够在此基础上进行数学问题的推理和求解,这对于自动化办公、智能文档处理、教育辅助工具(如拍照解题)等场景具有突破性意义。例如,学生可以拍摄数学题目图片,模型将识别题目并给出详细的解题步骤。

展望:边缘智能的未来图景

MiniCPM-V4.0的开源发布,不仅展示了国内AI团队在轻量级多模态模型研发上的卓越实力,更代表了人工智能向边缘计算深度融合迈出的坚实一步。它有力证明了在有限资源下实现高性能AI的可能性,为AI技术的大规模普及和本地化应用奠定了基础。随着更多轻量级、高能效模型的涌现,未来的智能手机、智能穿戴设备乃至智能家居终端,都将能够运行复杂的AI应用,真正实现“AI无处不在”。这一趋势将极大地拓展人工智能的应用边界,推动社会各领域进入一个更加智能、高效且个性化的新时代。