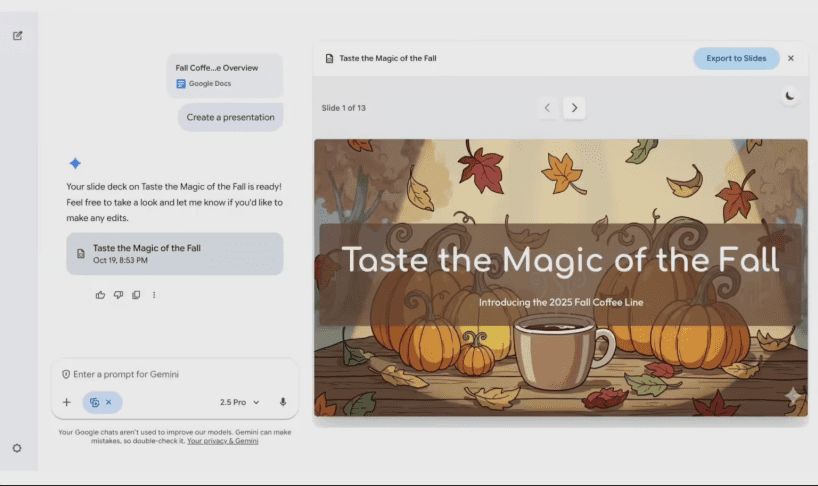

AI编码工具:信任滑坡与效用增长并存的开发者困境

近年来,人工智能(AI)在软件开发领域的应用呈现爆发式增长。从代码自动补全到错误诊断,AI工具正深刻地改变着开发者的日常工作流程。然而,伴随这种普及趋势的,却是开发者对AI工具准确性的信任度显著下降。这一看似矛盾的现象,揭示了AI在软件开发中日益复杂且充满挑战的角色。由知名开发者社区和信息枢纽Stack Overflow最新发布的一项覆盖49000名专业开发者的调查报告,为我们深入剖析这一趋势提供了关键洞察。

信任与使用率的悖论:深度剖析Stack Overflow调查

Stack Overflow的调查结果显示,截至2025年,已有高达五分之四的开发者在其工作流程中频繁使用AI工具,这一比例在过去几年中呈现快速增长态势。然而,与此形成鲜明对比的是,开发者对AI准确性的信任度却从往年的40%骤降至今年的29%。这种使用率高企与信任度下滑之间的巨大鸿沟,反映出GitHub Copilot、Cursor等AI工具对软件开发职业的复杂且不断演变的影响。开发者们普遍认为AI工具具备实用价值,但如何最大化其效用并规避潜在风险,仍然是他们亟待解决的问题。

调查进一步揭示,45%的受访者将“AI解决方案几乎正确,但不够完美”列为其在使用AI工具时面临的最大痛点。这种“差一点”的特性比那些明显错误的输出更具危害性,因为它们往往会引入难以立即察觉的隐蔽性错误或问题。对于经验不足的初级开发者而言,这种虚假的信心可能导致他们在后期调试上耗费更多时间。值得注意的是,超过三分之一的受访开发者表示,他们访问Stack Overflow的很大一部分原因正是为了解决与AI相关的代码问题——这意味着他们所采纳的AI工具生成的代码建议最终导致了需要人工介入解决的难题。

“几乎正确”的固有挑战与“随性编码”的审慎态度

尽管当前推理优化模型已取得显著进步,但“几乎正确”的不可靠性可能永远无法完全消除,这与预测性技术的工作原理密不可分。AI模型通过学习大量现有数据来生成新的内容,其本质是概率性的预测,而非确定性的逻辑推理。这使得AI在面对复杂、微妙或需要深度上下文理解的编程问题时,仍可能出现细微偏差。正是基于对这种固有局限性的认知,72%的受访开发者明确表示,“随性编码”(vibe coding,即不经严格验证地接受AI建议)并非其专业工作的一部分。他们认为这种方式不仅不可靠,还可能引入不适合生产环境的、难以调试的问题。

开发者为何仍坚持使用AI工具?

既然AI工具存在诸多挑战和不确定性,为何开发者依然对其趋之若鹜?部分原因是管理层的推动和强制要求。但更普遍且重要的原因在于,这些工具无疑具有显著的实用价值。关键在于如何正确、恰当地使用它们。

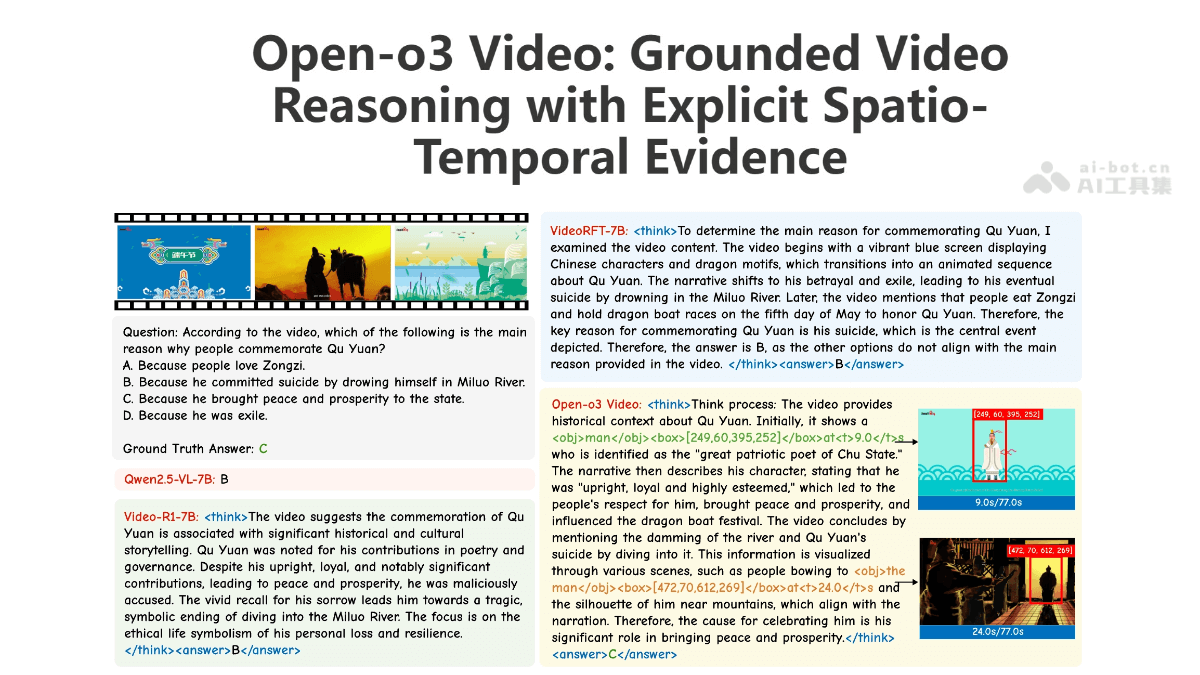

将AI工具整合到工作流程中,必须伴随着系统化的培训,以确保开发者对最佳实践有深刻理解。这样可以避免因误用而导致的问题比解决的问题更多,或者耗费的时间比节省的时间更长。开发者需要对Copilot等工具的自动补全建议保持更低的信任度,将其视为一个起点而非最终答案。这些工具最适合充当一种“有限的结对编程”伙伴关系:向LLM(大型语言模型)提问以发现潜在问题或建议更优雅的解决方案,然后开发者需要批判性地审视这些建议,而非照单全收。

AI工具在辅助学习方面也展现出巨大潜力。对于许多开发者而言,通过不断学习新的语言、框架和方法来提升技能是职业吸引力的一部分。LLM可以通过更具针对性的方式回答问题,有效减少这一过程中的摩擦,这比通过耗时且常常不完整的技术文档进行繁琐搜索要高效得多。从历史角度看,这正是开发者过去利用Stack Overflow寻求帮助的典型场景。

Stack Overflow首席产品与技术官Jody Bailey在给VentureBeat的评论中表示:“尽管我们观察到流量有所下降,但绝不像某些人所声称的那样剧烈。”Stack Overflow计划投入部分资源,致力于提升开发者对AI工具的理解和应用能力,并促进围绕AI工具工作流中特定问题的社区讨论。这表明,即便面临AI带来的冲击,Stack Overflow仍在积极调整策略,以适应并服务于开发者生态系统的演变。

展望未来:人机协作的精妙平衡

开发者与AI编码工具的关系正在经历一个从盲目乐观到审慎协作的转变。随着AI技术的不断成熟,以及开发者对其优缺点认识的日益加深,未来的趋势将是实现人机协作的精妙平衡。AI作为强大的辅助工具,能够加速重复性任务、提供创新思路和辅助学习,但最终的代码质量和系统稳定性仍需依赖经验丰富的开发者进行严格的审查和调试。行业白皮书式的研究表明,真正的生产力提升并非来自完全依赖AI,而是通过将AI融入一个高技能、高警惕性的人类监督循环中,确保AI的产出经过严格验证和优化。未来的软件开发领域,将是人类智慧与AI效能深度融合的时代,而信任的重建与效用的最大化,将是这场变革持续演进的关键。

开发者们需要超越简单地接受AI建议,而是将其视为一个起点。图片来源:Samuel Axon