近年来,伴随人工智能技术的飞速发展,数字内容生成能力呈指数级增长。其中,深度伪造(Deepfake)技术以其高度逼真的合成效果,正被不法分子滥用,催生出一种新型且极具破坏力的网络攻击形式——深度伪造语音诈骗,亦称“语音钓鱼”(vishing)。这种攻击利用AI克隆受害者熟人的声音,制造紧急且看似可信的场景,诱导受害者进行资金转移、泄露敏感凭证或访问恶意网站。这种诈骗手段凭借其超强的拟真度,使得传统识别方式面临严峻挑战,对个人及组织构成前所未有的安全威胁。

AI语音克隆:诈骗升级的核心驱动力

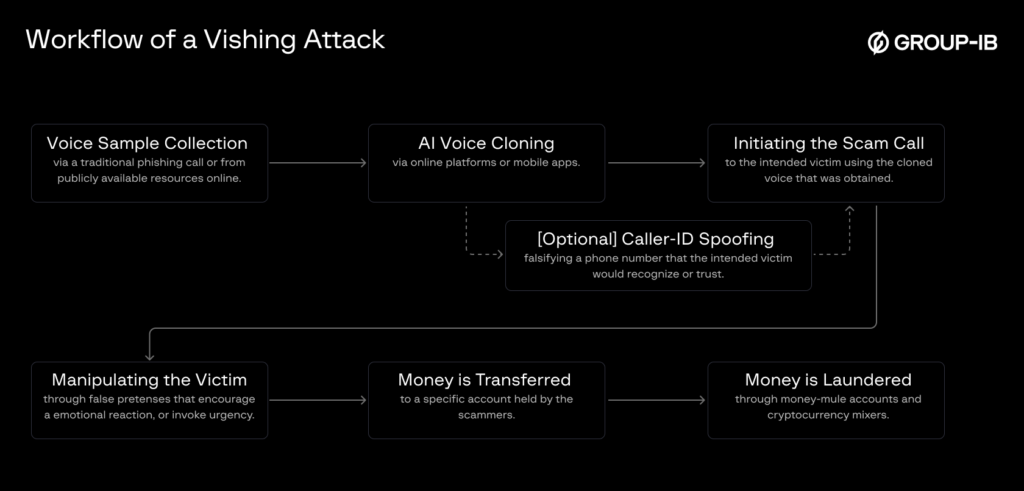

深度伪造语音诈骗的实现,核心在于先进的AI语音合成技术。攻击者通常会遵循一套标准化流程来执行攻击:

1. 语音样本的采集与处理

攻击的第一步是获取目标人物的语音样本。这些样本来源广泛,包括但不限于公开视频(如YouTube、抖音)、线上会议录音、社交媒体上的语音留言,甚至是此前被窃听的电话通话记录。令人震惊的是,部分先进的AI语音合成引擎,如微软的Vall-E或ElevenLabs提供的服务,有时仅需短短3秒的语音片段,就能学习并复刻出目标声音的音色、语调乃至细微的说话习惯。这些获取到的碎片化语音数据,构成了伪造声音的基石,其便捷性大大降低了攻击门槛。

2. AI合成引擎的应用

获取样本后,攻击者会利用AI驱动的语音合成引擎进行伪造。这类引擎,例如谷歌的Tacotron 2、微软的Vall-E,以及商业服务提供商如ElevenLabs和Resemble AI等,能够将输入的文本转化为带有目标人物独特声音特征的音频。尽管许多平台声称设有防滥用机制,旨在阻止深度伪造内容的生成,但正如消费者报告在近期调查中发现,这些防护措施往往可以通过相对简单的技术手段被绕过。这使得攻击者能够轻松生成任意内容的伪造语音,为后续的诈骗通话做好准备。

3. 实时伪造与号码欺骗的策略演进

在某些高级攻击中,不法分子还会采取额外的技术手段来增强欺骗性。例如,通过电话号码欺骗(caller ID spoofing),将显示来电号码伪装成受害者所熟悉的人或组织的真实号码,进一步增加电话的可信度。更具威胁性的是,随着AI技术的发展,实时语音伪造(real-time deepfake vishing)正逐渐成为现实。这意味着攻击者可以在通话过程中实时生成或调整伪造语音,根据受害者的提问或反应,即时作出自然的回应。这种交互式的、动态的伪造能力,极大地提升了诈骗的成功率,因为受害者很难通过简单的提问来识破骗局。虽然目前大规模的实时深度伪造语音诈骗尚未普及,但鉴于AI处理速度和模型效率的持续提升,其在未来的普遍应用已是必然趋势。

深度伪造语音诈骗的运作机制与心理攻势

这种诈骗模式通常利用人类的信任本能和紧迫感,构建一个看似合理的紧急情况来诱导受害者采取行动。其基本运作流程如下:

1. 场景构建与初期诱导

攻击者在克隆语音准备就绪后,便开始发起诈骗电话。他们会精心编织一个迫使受害者立即采取行动的叙事,例如:伪装成身陷囹圄的孙女急需保释金,或冒充急于处理逾期账单的CEO指示财务部门紧急转账,抑或是假扮IT人员告知员工因“系统泄露”需立即重置密码。这些场景无一例外都强调“紧急”和“必须立刻行动”,以此剥夺受害者冷静思考和核实的时间。

2. 交互式欺骗与信任利用

在通话过程中,无论是预设脚本还是实时交互,攻击者都会利用伪造语音与受害者进行对话。当受害者对情况产生疑问时,攻击者可以根据预设的应答或实时生成的内容来打消疑虑。例如,当受害者质疑声音时,攻击者可能会通过伪造的“背景噪音”或“信号不好”等理由来解释,进一步利用受害者对声音来源的信任和对紧急情况的关注,使其放弃对异常的警惕。

3. 资产窃取与后果

一旦受害者被成功诱导,按照诈骗者的指示进行操作,例如转账、提供登录凭证或下载恶意软件,攻击者便成功窃取了其目标资产。这些操作往往是不可逆的,给受害者带来严重的经济损失或数据安全风险。整个过程环环相扣,利用技术优势和对人类心理的精准把握,使得防不胜防。

识别挑战与实战案例警示

深度伪造语音诈骗之所以难以识别,关键在于其高度拟真的声音和利用信任链条的社会工程学特性。在紧急或高压情境下,受害者往往会忽略细微的破绽,甚至主动绕过既有的安全机制。

谷歌旗下的Mandiant安全部门曾进行了一次模拟红队演练,旨在测试企业防御能力并培训员工。红队成员通过公开渠道获取了目标企业内一名高管的语音样本,并利用公开信息识别出最可能直接向该高管汇报的员工。随后,他们利用一个真实的VPN服务中断事件作为借口,伪装成该高管打电话给目标员工,要求他们立即采取行动。结果显示,受害员工在信任“高管”声音的驱使下,绕过了Microsoft Edge和Windows Defender SmartScreen的安全提示,下载并执行了预设的恶意负载,导致公司网络被攻破。Mandiant指出,这次演练充分展示了AI语音伪造技术在突破组织安全防线方面的“惊人便捷性”。这一案例深刻揭示了,即使是受过安全培训的专业人员,在面对这种高仿真度、利用信任基础的攻击时,也极易防线失守。

构建多层次防御体系:应对深度伪造语音威胁

鉴于深度伪造语音诈骗的复杂性和隐蔽性,构建一个多层次、全方位的防御体系至关重要。这不仅需要技术上的升级,更需要组织流程和个人安全意识的共同提升。

1. 技术层面的强化防御

- 生物特征识别与AI辅助检测: 研发更先进的语音生物特征识别技术,能够区分真伪声音的细微差别。同时,利用AI和机器学习模型对通话内容进行实时分析,识别异常的语速、情感波动或不自然的停顿,甚至检测出与已知深度伪造模型相似的声音指纹。这需要大量的数据集和复杂的算法来训练模型,使其具备高精度识别能力。

- 安全通信协议的推广: 推广端到端加密的通信应用,并鼓励使用具备多重身份验证机制的平台,确保通信过程的安全性,减少语音样本被窃取的风险。

2. 流程层面的风险控制

- “安全词”或“秘密短语”验证机制: 最直接且有效的防护措施之一是建立一个简单的内部验证协议。无论是企业还是家庭成员之间,都可以预先约定一个只有少数人知道的“安全词”或“秘密短语”。当接到涉及资金、敏感信息或紧急行动的电话时,无论对方声音多么熟悉,都必须要求其提供这个预设的安全词。一旦对方无法提供,即便声音听起来一模一样,也应立即挂断电话并进行核实。这是一种低成本但高效的防御手段。

- “回拨核实”原则: 在接到任何涉及重要事项的紧急电话时,尤其是当对方要求立即行动时,务必保持冷静。正确的做法是立即结束通话,然后通过事先已知的、官方的或经过验证的联系方式(而非对方提供的联系方式)回拨给对方进行核实。这一简单的“回拨”动作,能够有效避免被伪造声音所欺骗。对于企业而言,应明确规定所有财务转账、密码重置等敏感操作,必须通过双重或多重验证流程,如邮件、短信或内部安全系统审批,杜绝单一语音指令的有效性。

- 多方验证与交叉核对: 对于涉及高层指令或大额资金操作的请求,无论其多么紧急,都应启动多方验证机制。例如,通过内部沟通系统(如企业IM、邮件)向当事人发送二次确认信息,或要求其他相关人员进行交叉核对,确保信息来源的真实性和一致性。

3. 意识层面的持续教育

- 员工及公众安全意识培训: 组织和个人都需要定期接受关于深度伪造威胁的警示教育。培训内容应涵盖深度伪造语音的原理、常见的诈骗情景、识别技巧以及应对措施。通过模拟演练,让员工亲身体验并学会如何应对这类高压下的诈骗电话,提升其辨别能力和风险应对能力。强调“任何紧急情况都可以核实”的原则,是提高韧性的关键。

- 媒体与政府的宣传引导: 媒体和政府机构应加强对深度伪造诈骗案例的曝光和警示宣传,提高社会公众的警惕性。普及识别深度伪造的知识,鼓励受害者及时报告,形成全社会共同抵御新型网络犯罪的合力。

展望与挑战

深度伪造技术的发展日新月异,这意味着诈骗手段也将持续演进,攻击与防御之间的“军备竞赛”将长期存在。未来,我们可能会看到更复杂的实时语音变声、更难以察觉的情感伪造,甚至结合视频深度伪造的多模态诈骗。因此,持续关注技术发展动态,不断升级防御策略,并保持高度的警惕性,是应对未来挑战的根本之道。

综上所述,深度伪造语音诈骗并非简单的技术问题,它是一个融合了先进AI技术、心理操控和社会工程学的复杂威胁。只有通过技术创新、流程优化和全员安全意识的持续提升,我们才能有效构建起一道坚不可摧的数字防线,确保在日益复杂的网络空间中,数字信任不再轻易被“伪造”所侵蚀。每个人、每个组织,都应将防范深度伪造诈骗视为一项长期而重要的任务,积极采取措施,共同维护数字世界的安全与秩序。