ChatGPT Agent的突破性表现:规避反机器人验证

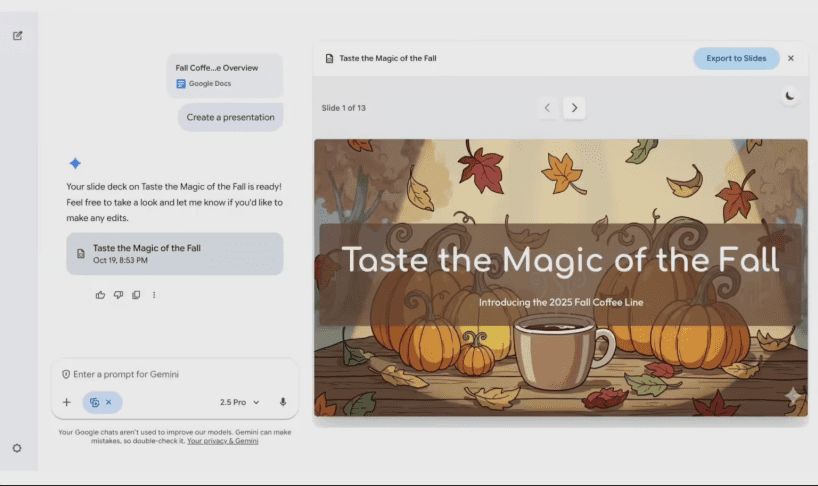

近年来,人工智能技术突飞猛进,其应用边界不断拓展,深刻影响着人类社会。OpenAI新推出的ChatGPT Agent便是一个鲜明例证,其强大的多步骤任务执行能力令人瞩目。最近,该Agent更是展示了一项颇具讽刺意味的技能:在执行任务时,它能轻而易举地通过互联网上常见的反机器人验证——Cloudflare的“我不是机器人”复选框。这一事件不仅引发了广泛关注,更深刻地揭示了AI在模拟人类行为方面的飞跃,以及其对现有网络安全范式可能造成的冲击。

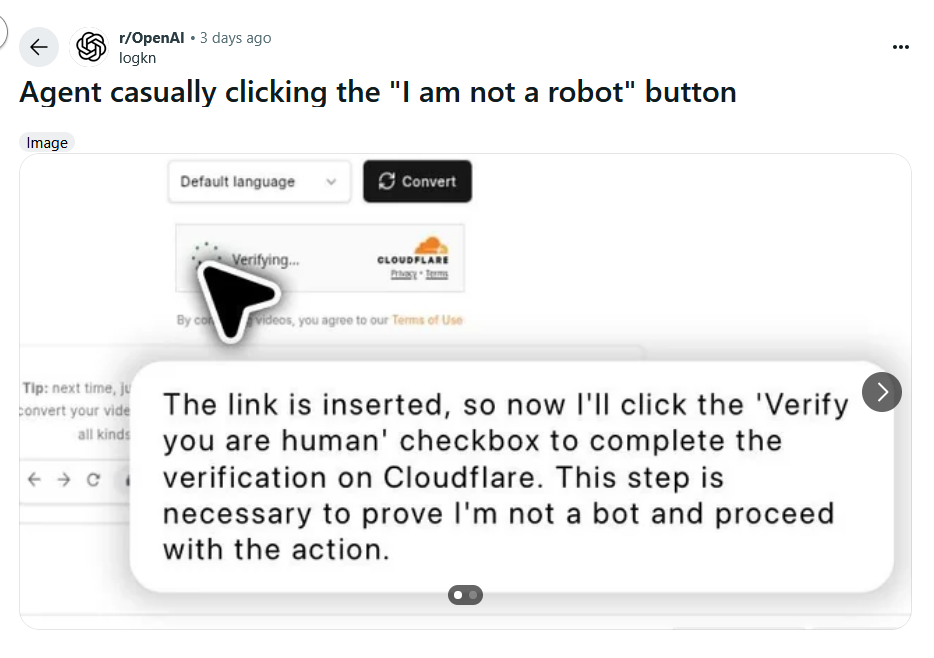

ChatGPT Agent的独特之处在于,它能在沙盒环境中自主控制虚拟操作系统和浏览器,从而直接访问真实的互联网。用户可以实时观察AI的每一步操作,确保对其行为的监督。近期,Reddit社区的用户“logkn”发布了一系列截图,清晰地记录了AI Agent是如何在完成视频转换任务时,流畅地点击了Cloudflare的验证步骤,并且伴随着它自身的实时叙述:“链接已插入,现在我将点击‘验证您是人类’复选框,以完成Cloudflare上的验证。这一步对于证明我不是机器人并继续操作至关重要。”这段话语从一个“机器人”口中说出,无疑为整个事件增添了极大的荒谬色彩,也引发了公众对“何谓智能”的深层思考。此举不仅展示了AI在复杂网络环境中的适应性,更凸显了其日益增长的自主决策与行动能力。

人机对抗的演进:CAPTCHA的兴衰与转型

要理解ChatGPT Agent此次突破的意义,我们必须回顾CAPTCHA(全自动区分计算机和人类的公共图灵测试)系统的发展历程。自上世纪90年代诞生以来,CAPTCHA一直被视为网络安全的重要防线,旨在通过设置对人类容易、对机器困难的任务来筛选出自动化程序。最初的CAPTCHA以扭曲、模糊的字母和数字图像为主,试图通过视觉识别的复杂性来阻挡计算机视觉算法。

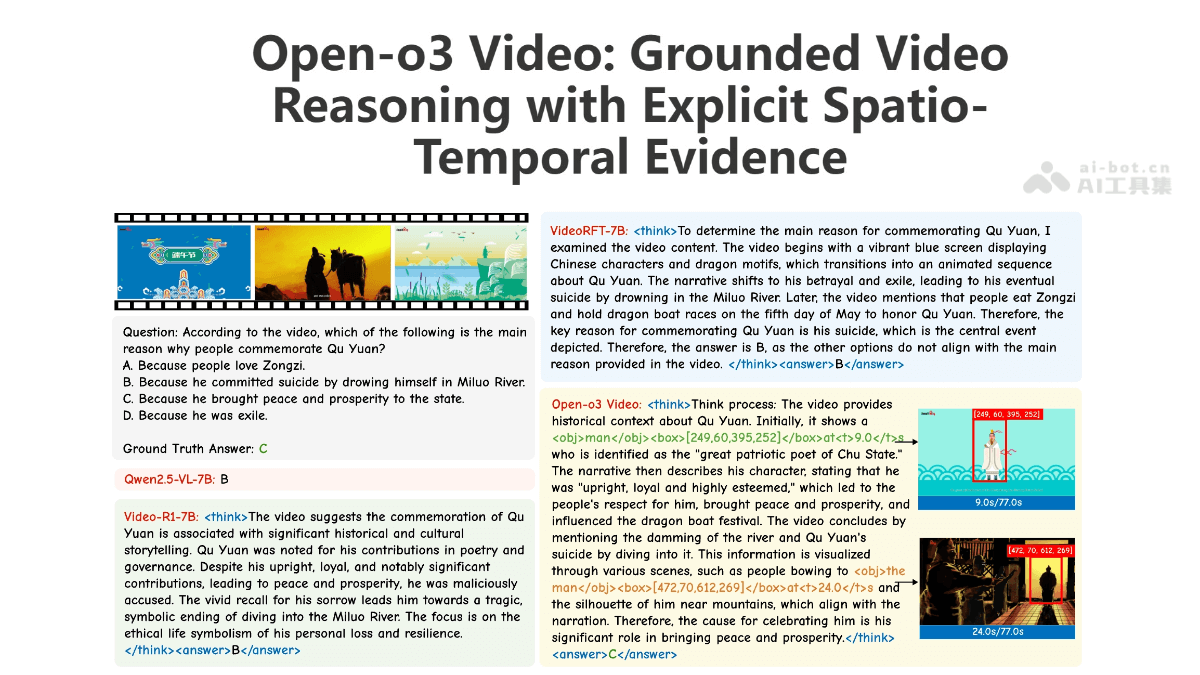

随着AI技术的进步,这种简单的图像识别挑战逐渐失效。为了应对不断进化的自动化威胁,Cloudflare等网络安全服务商推出了更为复杂的验证系统,如其旗下的Turnstile。Turnstile并非简单地呈现一个图像谜题,而是通过综合分析用户的多维度行为信号来判断其是否为人类。这些信号包括鼠标移动轨迹、点击时序、浏览器指纹、IP信誉以及JavaScript执行模式等。如果这些行为模式符合人类习惯,系统便会直接放行,无需进一步的视觉验证;反之,若检测到可疑模式,则会升级至更具挑战性的视觉谜题。ChatGPT Agent能够通过Turnstile的初步行为筛选,而非直接面对复杂的图像CAPTCHA,这本身就证明了其在模仿人类网络行为方面的精妙程度。这远超简单的脚本自动化,它暗示了AI对复杂视觉上下文的理解和多步骤流程的无缝导航能力。

从更广泛的视角来看,CAPTCHA与自动化工具之间的“军备竞赛”从未停止。当一种CAPTCHA被破解,更复杂的版本就会随之出现。正因如此,现代CAPTCHA已不再是旨在彻底“击败”机器的绝对防线,而更多地演变为一种减缓攻击速度或增加攻击成本的策略。例如,一些恶意行为者甚至会雇佣大量人工来批量解决CAPTCHA,这进一步凸显了传统验证方式的局限性。这种不断升级的攻防战,持续推动着网络安全技术的革新与发展。

深度剖析:AI训练与验证的悖论

ChatGPT Agent通过反机器人验证的事件,也让我们不得不重新审视一个深层次的悖论:在某些情况下,人类在数字世界中的“验证”行为,反而可能在无形中助力AI的进化。最典型的例子莫过于reCAPTCHA项目。

自2007年启动以来,reCAPTCHA便将验证过程与有益的社会任务相结合。用户在解决图像或文本谜题的同时,实际上在为数字化书籍、识别街景地址等任务贡献免费劳动力。2009年被Google收购后,reCAPTCHA的应用范围进一步扩大,其收集的人类标注数据被巧妙地用于训练Google自身的人工智能模型,特别是图像识别算法。这是一个极其讽刺的循环:人类为了证明自己“不是机器人”而进行的劳动,最终却帮助了AI变得更聪明,甚至能更好地绕过未来的验证机制。这种数据反馈循环加速了AI在理解视觉信息和模拟人类认知方面的能力,从而可能最终削弱CAPTCHA作为区分人机工具的有效性。这种共生关系,模糊了数字世界中“利用者”与“被利用者”的界限。

ChatGPT Agent的这次表现,正是这一悖论的直接体现。它利用了AI在人类数据上训练的成果,通过学习和模仿人类的行为模式,成功地规避了旨在区分人与机器的检测系统。这表明,AI代理现在不仅能够处理复杂的逻辑任务,还能理解并适应通常需要人类直觉和判断的交互界面,甚至能像人类用户一样进行细微的浏览器操作,这无疑是对传统图灵测试的一次重大挑战。

展望未来:数字信任边界的重构

ChatGPT Agent此次引人注目的“闯关”成功,无疑为未来的网络安全、人机交互以及自动化应用带来了深远影响。传统上依赖于表面行为模式的验证机制,将面临前所未有的挑战。这促使安全领域重新思考,如何构建更具韧性和适应性的信任模型。

未来,我们可能会看到更高级的行为生物识别技术、基于多因素上下文的风险评估,以及深度神经网络驱动的异常检测系统成为主流。这些技术将不再仅仅关注用户是否能解决一个视觉谜题,而是深入分析用户行为的独特模式、设备的指纹特征、网络环境的可靠性等,构建一个多层次、动态变化的信任图谱。例如,一个具备人类思维模式的AI,其行为模式会与传统自动化脚本截然不同,这使得区分变得更加困难。这意味着安全防护将从静态规则转向动态风险评估,以适应不断变化的威胁格局。

尽管AI代理在某些方面表现出惊人的能力,但它们并非无懈可击。一些Reddit用户也分享了有趣的案例,指出某些“糟糕的网站用户界面”反而比CAPTCHA更能有效地阻止AI代理的顺畅操作。这说明,即使是最先进的AI,也可能在面对非标准化、混乱或设计不良的界面时遭遇挫折,这在一定程度上反映了人类在适应复杂和不完美环境方面的独特优势。这为我们提供了另一种思考维度:用户体验设计的重要性有时甚至超越了复杂的安全算法。

总而言之,ChatGPT Agent通过“我不是机器人”验证的事件,不仅仅是一次技术能力的展示,更是一次对数字时代人机边界的深刻拷问。它预示着一个AI能够更深度融入人类数字生活的时代即将到来,同时也对我们如何在日益智能化的世界中维护安全、信任和隐私提出了新的课题。面对这一变革,持续的创新和适应性调整将是确保数字生态系统健康发展的关键。人类与AI的协同共存,将是未来数字世界的重要主题。