AI领域前沿突破:智能创新如何重塑产业格局

当前,人工智能技术正以前所未有的速度发展,持续渗透并革新各行各业。从多模态交互到高效开发工具,再到具身智能的突破,2025年的AI创新浪潮正深刻影响着我们的生产与生活。本文将深度剖析近期一系列关键技术进展,揭示其背后的技术原理与对未来产业发展的深远影响。

多模态AI的融合与效率跃升

在多模态AI领域,小米近期推出的MiDashengLM-7B多模态大模型无疑是一项里程碑式的成就。该模型不仅在音频理解方面刷新了22个公开评测集的最佳记录,更在推理效率上实现了质的飞跃,其单样本首Token延迟仅为业界先进模型的四分之一,数据吞吐效率更是提升了20倍以上。这项突破的意义在于,它有效解决了传统音频处理中,如环境噪声、口音多样性以及语境复杂性等挑战。通过其独特的双核心架构设计,MiDashengLM-7B能够实现语音、环境声音和音乐的统一理解,极大地提升了跨域音频识别的准确性与鲁棒性。这种高效率的推理能力,使得多模态大模型在边缘设备上的离线部署成为可能,从而显著降低了应用成本,并拓宽了智能语音助手、智能家居控制、车载信息系统等领域的应用边界,推动了AI普惠化的进程。

与此同期,腾讯旗下AI知识管理工具ima也推出了一系列实用新功能,进一步提升了用户的知识获取与管理体验。其中,AI播客生成功能尤其引人注目,它能够将长篇文章或报告快速转化为易于消化的音频播客,极大地解放了用户的阅读时间,适应了碎片化学习的需求。此外,一键导入文件夹、Xmind脑图导入以及知识库内容置顶等功能,则显著优化了文档管理和信息检索的效率,使得知识工作者能够更便捷地整理、获取和利用信息,从而提升了整体工作流程的顺畅性与智能化水平。这些功能共同构建了一个更加智能、高效的知识管理生态系统,体现了AI在赋能个体生产力方面的巨大潜力。

生成式AI的图像与文本新篇章

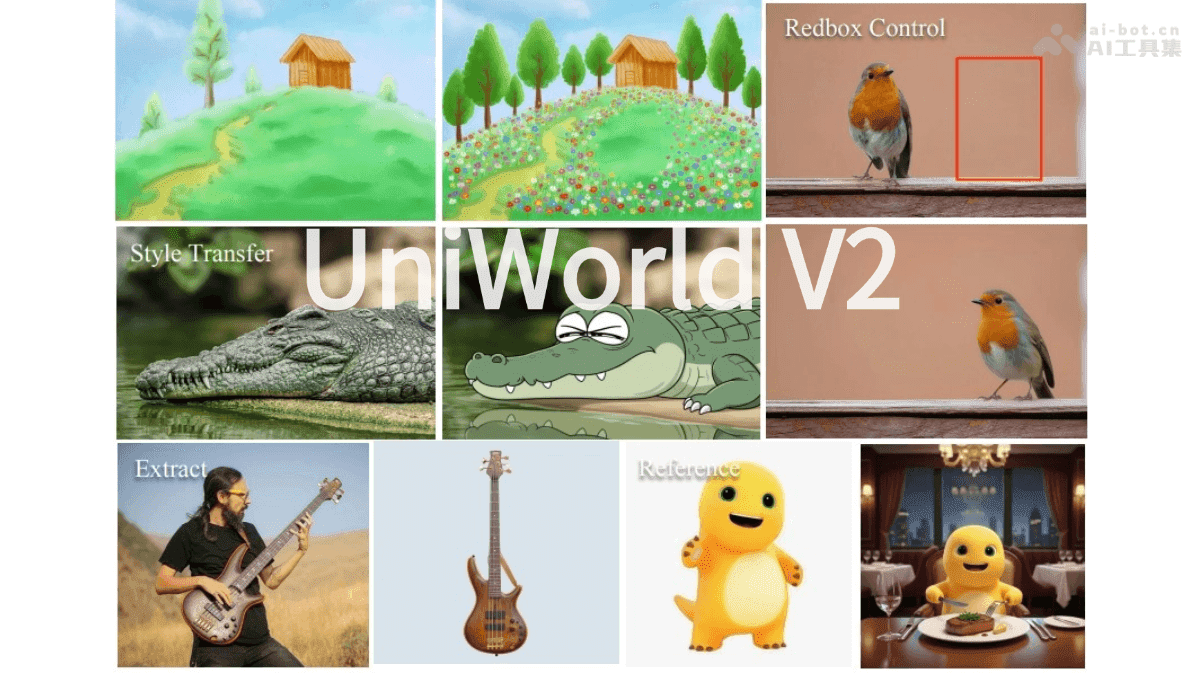

在生成式AI领域,阿里通义千问开源的Qwen-Image文生图模型,展现了其在图像生成与编辑方面的卓越能力。该模型不仅支持多行布局、段落级文本生成,还能呈现细粒度的细节,例如精准渲染宫崎骏风格的动漫场景和中文对联书法效果,这解决了以往文生图模型在文本细节处理上普遍存在的挑战,尤其是在处理中文文本时的笔画、结构和整体美感问题。在图像编辑方面,Qwen-Image具备风格迁移、物体增减、细节增强等多项高级功能,使得即便是非专业用户也能轻松实现专业级的图像编辑效果。Qwen-Image在多个公开基准测试中表现出色,特别是在中文文本渲染上大幅领先现有先进模型,预示着生成式AI在视觉内容创作领域正迈向更高精度和更广阔的应用空间,对广告、设计、媒体等行业将带来革命性的影响。

同时,xAI推出的Grok Imagine4在文生图和图生视频方面也取得了显著进展。其文生图功能以极快的生成速度著称,能够接近实时地提供视觉反馈,极大提升了创作者的迭代效率。尽管其图生视频功能在效率上有所提升,但在画面细节和流畅性方面仍有进一步优化的空间。值得注意的是,Grok Imagine4原生支持NSFW(不适宜工作场所)内容创作,这一特性引发了业界对于AI伦理与内容监管的广泛讨论。这不仅是技术边界的拓展,更是对社会责任与合规性的持续挑战,促使我们深思AI技术应用的规范与边界。

AI大模型驱动的开发与推理效率提升

大语言模型(LLM)的持续迭代正深刻改变着软件开发与信息处理的范式。据统计,OpenAI的ChatGPT周活跃用户已达到7亿,同比增长超过四倍,其年化收入更是飙升至120亿美元,远超市场预期。这一数据不仅印证了生成式AI的巨大市场潜力和用户接纳度,也预示着AI技术商业化路径的成熟。同时,有消息称GPT-5即将发布,预示着AI能力将迎来新的飞跃,这也加剧了与谷歌等科技巨头在AI领域的激烈竞争。OpenAI在产品优化上也不遗余力,例如新增的休息提醒功能,体现了其对用户健康与体验提升的关注,这在高速发展的AI产品中尤为重要,反映了行业对负责任AI的思考。

Anthropic也正对其下一代大语言模型Claude Opus 4.1进行内部测试,其内部代号“claude-leopard-v2-02-prod”暗示了模型在推理能力上的重大升级。新模型主打“问题解决能力”的显著提升,这意味着它在逻辑推理、复杂任务处理和多步骤规划方面将有更卓越的表现。在竞争日益激烈的LLM市场中,模型理解和解决复杂问题的能力是衡量其实用价值的关键指标。这种“豹子”般的速度和精准分析能力,将使Claude Opus 4.1在处理法律文书、科研报告、金融分析等高复杂度专业场景中发挥更大作用,进一步巩固其在企业级应用市场的地位。

智谱AI推出的Zread.ai开发效率工具,搭载了其最新的GLM-4.5模型,旨在显著提升开发者的工作效率。Zread.ai提供一站式代码理解与文档生成服务,能够帮助开发者快速掌握项目结构、自动生成技术文档,并优化团队协作流程。其核心功能包括对复杂代码库的深度分析与理解、自动生成详尽的项目导读(涵盖架构解析、模块说明等),以及高效的技术问答支持。GLM-4.5模型出色的代码理解能力和低误判率,确保了所生成文档的准确性与实用性。这项工具的出现,无疑将大幅缩短新项目成员的上手周期,降低文档撰写的负担,并促进团队间知识的有效共享与沉淀,为软件开发的工业化生产注入新的动能。

具身智能与机器人技术的突破

在具身智能领域,视频大模型的压缩技术是实现高效部署的关键。阿里巴巴通义实验室与南开大学计算机科学学院联合开发的LLaVA-Scissor,正是一种创新的视频大模型压缩方法。该技术通过基于图论的SCC(强连通分量)算法,有效减少了token数量,同时巧妙地保留了视频中的关键语义信息。在传统的视频处理中,token数量的激增是导致计算成本高昂的主要原因。LLaVA-Scissor通过识别并聚合语义相关性强的token,显著提升了视频处理效率。这项技术在低token保留率下仍展现出显著的性能优势,尤其在视频问答和长视频理解任务中表现优异,为视频内容的实时分析、智能监控以及具身智能系统的视觉输入处理提供了高效且实用的解决方案。

北京人形机器人创新中心近期发布的Humanoid Occupancy视觉感知系统,标志着全球人形机器人3D视觉系统领域的重大突破。该系统引入了语义占用表征技术,实现了对三维空间环境的精准建模,并通过多传感器数据(如激光雷达、深度相机、RGB相机)的高效融合,解决了人形机器人在复杂、动态环境中进行感知和决策的难题。语义占用表征不仅提供了空间几何信息,更融入了环境中物体和场景的语义理解,使得机器人能够“理解”其所处的环境,而不仅仅是“看到”。这种高精度、多模态的感知能力,为人形机器人在工业生产、服务场景乃至复杂救援等领域的实际应用奠定了坚实基础,是推动具身智能迈向实用化的关键一步。

此外,OpenMind公司正致力于开发名为OM1的机器人操作系统,目标是成为机器人领域的“Android”。其创新性的FABRIC协议,使得不同制造商、不同功能的机器人能够验证身份并安全地共享信息,从而构建一个开放、信任的协作网络。这一愿景旨在打破机器人间的“信息孤岛”,促进机器人群体智能的进化与学习。通过标准化的操作系统和通信协议,OM1能够加速机器人应用生态的建设,降低开发者门槛,并推动机器人技术在更广泛场景中的普及与应用,尤其是在对人性化交互需求较高的家庭服务场景中,OM1的开放生态将激发无限的创新潜力。它预示着一个机器人可以互联互通、协同工作的未来,为智能制造、智慧物流、公共服务等领域带来革命性的变革。

这些前沿技术进展共同描绘了一幅AI赋能百业的宏伟蓝图。从算法创新到工程实现,从效率提升到伦理考量,人工智能的每一步发展都蕴含着巨大的机遇与挑战。随着多模态、具身智能和高效计算能力的持续演进,我们有理由相信,AI将在更深层次、更广阔的维度上重塑产业格局,引领人类社会进入一个全新的智能时代。