在数字内容日益丰富的当下,人工智能(AI)视频生成技术正逐步从新奇体验迈向实用工具。然而,现有AI模型在生成长视频、实现自然人机交互以及呈现多样化镜头语言方面,仍面临诸多挑战。例如,早期AI视频在模拟人物进行商品讲解或歌曲演绎时,尽管唇形对齐已有所改善,但一旦视频时长拉长,人物的肢体动作往往显得僵硬不自然,手部与物体的互动缺乏真实感,画面质量随时间推移易出现伪影或“崩坏”,且镜头视角通常固定单一,难以满足专业内容制作的需求。这些局限使得AI生成的视频往往停留在“猎奇”或“片段化”的层面,难以支撑长时间、高沉浸度的内容消费,例如一场完整的直播带货或一部音乐视频。对于内容创作者而言,克服这些技术瓶颈是实现AI视频广泛应用的关键。

解决AI视频生成的核心挑战

针对当前AI视频制作的痛点,新一代模型致力于在以下关键领域实现突破:

突破数字人与实物交互的界限

让数字人在视频中自然地拿起、展示或操作商品,是提升AI视频真实感与实用性的重要一步。传统的AI模型在处理手部动作与物体交互时,常出现变形、穿模或不连贯等问题,导致观众的沉浸感大打折扣。新一代AI视频模型通过深度优化手部动作交互,并针对特定业务场景(如广告主播、商品展示)构建了高质量的数据集。这包括收集大量真实世界中的手部与商品互动案例,并通过多样的训练策略(如使用不同随机种子和检查点生成大量候选结果)来增强模型对细节的把握。更进一步地,模型通过引入奖励模型(Reward Model)对生成结果进行自动评估,筛选出最优与最差样本,再利用直接偏好学习(Direct Preference Learning)机制对模型进行迭代优化,从而显著提升了数字人手部动作的自然度和与物体的交互准确性。这种精细化的训练方法,使得数字人能够流畅地拿起桌游盒子、自然地握持麦克风进行演唱,极大地拓宽了AI视频在直播电商、产品演示及虚拟演艺等领域的应用空间。

该示例展示了数字人主播与桌游盒子的自然互动,背景中的产品细节也保持了良好的一致性。

实现长时视频的稳定生成与美学表达

AI视频生成面临的另一大挑战是长时间视频的稳定性问题。由于模型在逐帧生成过程中可能积累误差,导致画面质量随时间推移而劣化,出现视觉伪影或人物形象“崩坏”的现象。这种“误差累积”效应限制了AI视频的长度和一致性,使其难以用于需要连续、稳定画面的场景。

为解决这一难题,先进的视频扩散模型采用了一种创新的插帧与预测策略。该策略不再是简单地依据前一帧推测后一帧,而是能够预先设定未来的“关键帧”作为锚点,然后高质量地填充并补全中间的视频片段。这种机制显著增强了视频长时间生成时的人物面部及整体画面的高度一致性。从技术架构层面分析,这种方法理论上支持生成“无限长度”的视频,尽管实际产品部署可能会根据计算资源或音频文件大小对单次生成时长进行限制,但生成分钟级别的单镜头视频已不再是难题。这为电影预告片、短剧片段、教育课程等长周期内容生产提供了前所未有的可能性。

除了稳定性,视觉美感是专业视频不可或缺的要素。早期数字人视频常受限于固定视角,缺乏电影感。新模型则内置了基于ControlNet的镜头控制模块,赋予创作者如同专业导演般的运镜能力。通过预设的推镜(push in)、拉镜(push out)、左摇(pan left)、右摇(pan right)等八种常见专业运镜,并支持0到100的强度连续调节,AI视频能够展现出丰富的视觉叙事语言。例如,通过左右摇摄可模拟直播带货中对商品的全方位展示,而手持镜头效果则能复刻Vlog的真实感与亲近度。这些运镜能力的引入,使AI视频不再是简单的“大头贴”式呈现,而是具备了专业级视频的艺术表现力和叙事感染力。

示例展示了从左到右的运镜效果,增强了直播带货场景的自然感。

技术指标与未来展望

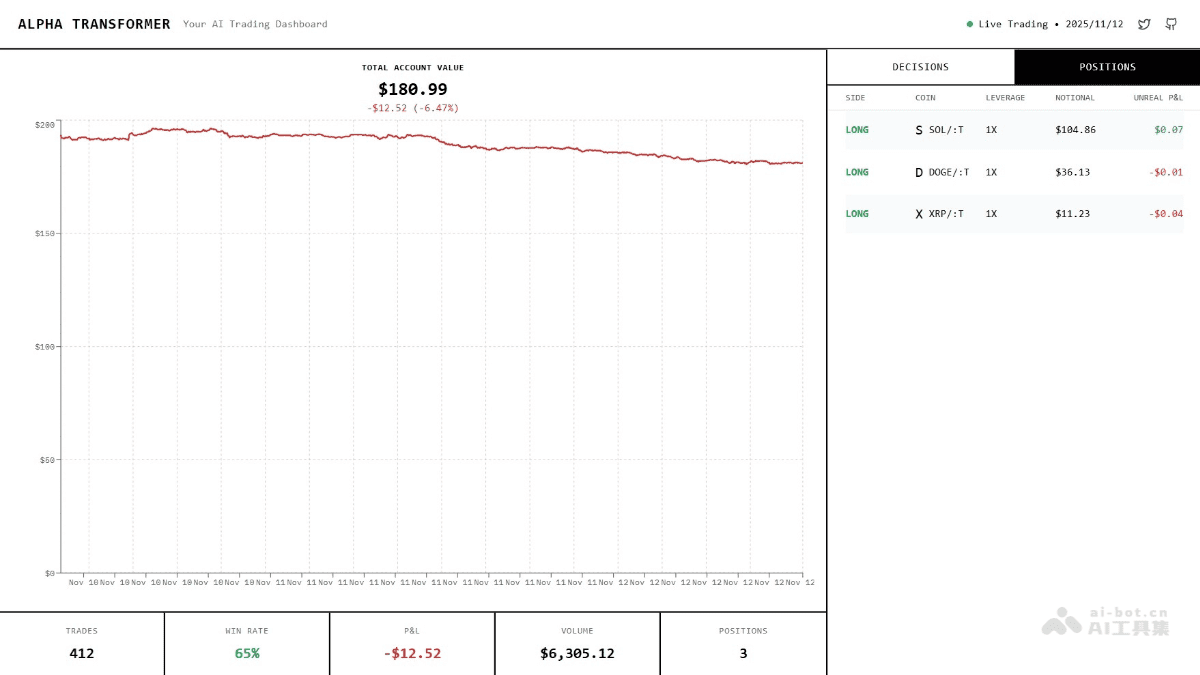

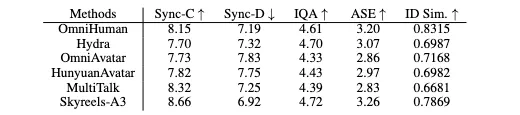

AI视频生成模型的性能评估至关重要,这通常涉及多个维度。例如,Sync-C和Sync-D指标用于精确衡量生成视频中唇部动作与音频的同步程度,确保“口型对齐”的准确性。IQA(Image Quality Assessment)和ASE(Aesthetic Score Estimation)则通过专门训练的多模态大型语言模型(MLLM)评估视频画面的质量和艺术性,反映生成内容的视觉吸引力。ID Similarity(身份相似度)通过余弦相似度计算,用于评估生成视频中人物面部与参考图像/视频的相似度,确保数字人形象的连续性和准确性。在这些关键指标上,最新模型已达到行业领先水平,特别是在唇部同步精准度、画面艺术性和人脸相似度方面表现突出。

该图表展示了SkyReels-A3在多个基准测试中的性能表现,体现其在唇部同步、图像质量和身份保持方面的先进性。

AI视频技术对行业的影响与未来方向

AI视频技术的飞速发展正深刻改变内容创作与分发模式。随着数字人与现实世界交互能力的提升,以及长时稳定视频生成和动态镜头控制的实现,AI视频的应用场景将呈爆炸式增长。

在商业领域,这将直接赋能虚拟主播和直播电商。商家可以利用AI数字人进行全天候、多语言的直播带货,定制化展示商品,甚至实现个性化互动。这不仅能大幅降低人力成本,提高运营效率,还能通过创新的视觉体验吸引消费者,形成新的营销范式。例如,品牌可以为不同市场或受众群体,快速生成符合其文化偏好的数字人讲解员,实现营销内容的本地化与规模化。

在娱乐内容创作方面,AI视频技术将解放创作者的生产力。虚拟偶像的MV制作将变得更加高效,音乐人可以尝试更多元的视觉表达。短剧、动画乃至电影的预可视化阶段,都可以借助AI快速生成初稿,缩短制作周期。AI驱动的视频工具将使得独立创作者也能产出高品质的视觉内容,降低行业门槛,激发更多元的创意涌现。

此外,在教育培训、新闻传播、虚拟客服等领域,AI视频同样潜力巨大。例如,AI教师可以根据学生个体差异生成定制化的教学视频;新闻机构能够利用AI主播实时播报资讯,提高时效性;企业则可以部署AI客服,通过生动的视频形式提供问答服务,提升用户体验。

未来,AI视频技术将继续朝着更高真实感、更强可控性、更低成本和更广普适性的方向发展。这包括提升数字人全身动作的自然度,实现更精细的面部表情与情绪表达,以及支持更为复杂的场景交互和多数字人协同。同时,如何将AI视频技术无缝集成到现有内容创作流程中,并开发出更易用的创作平台,将是行业关注的重点。随着技术的不断成熟,AI视频有望成为数字内容生产的基础设施,推动文化娱乐、商业营销乃至社会交流迈向一个全新的智能时代。