在全球人工智能的浪潮中,大型模型(LLMs)以其强大的生成能力和复杂推理逻辑占据着主导地位。然而,这些模型往往需要庞大的计算资源和云端基础设施支持,这在一定程度上限制了AI的普适性和数据隐私性。正是在这样的背景下,谷歌最新发布的Gemma 3 270M模型,以其“微型”的姿态,为人工智能的未来发展指明了新的方向。这款模型不仅体积极小,更彰显了在边缘设备上运行AI的巨大潜力,预示着一个更加普惠、高效且注重隐私的智能时代正在加速到来。

突破算力边界:迷你模型的非凡能力

传统观念认为,AI模型的性能与参数规模成正比,参数越多,模型越智能。谷歌早前发布的Gemma 3系列模型,其参数量从10亿到270亿不等,旨在满足不同规模的应用需求。然而,Gemma 3 270M的出现,彻底颠覆了这一认知。这款模型仅拥有2.7亿参数,相较于其“前辈”们甚至市场上大多数主流模型而言,规模仅是冰山一角。但正是这种精巧的设计,使得它能够摆脱对昂贵GPU集群的依赖,直接在智能手机、平板电脑乃至Web浏览器等本地设备上流畅运行,这无疑是AI技术普及道路上的一大里程碑。

在本地运行AI模型的优势显而易见。首先是隐私保护。数据在设备本地处理,无需上传至云端,极大地降低了数据泄露的风险,对于个人助理、健康监测等敏感应用场景尤为关键。其次是低延迟。免除了网络传输的耗时,模型响应速度显著提升,为用户带来更为即时、流畅的交互体验。再者,成本效益也得到了优化,企业和开发者无需支付高昂的云服务费用,从而降低了AI应用的部署门槛。

谷歌在Pixel 9 Pro手机上进行的测试结果令人印象深刻:Gemma 3 270M在Tensor G4芯片上运行25次对话,仅消耗设备电量的0.75%。这一数据充分证明了其卓越的能效比,使其成为Gemma系列中迄今为止最高效的模型。这种极致的优化,不仅有助于延长设备电池寿命,更符合当前绿色计算的趋势,为可持续AI发展提供了新的思路。

性能表现:小身材蕴含大能量

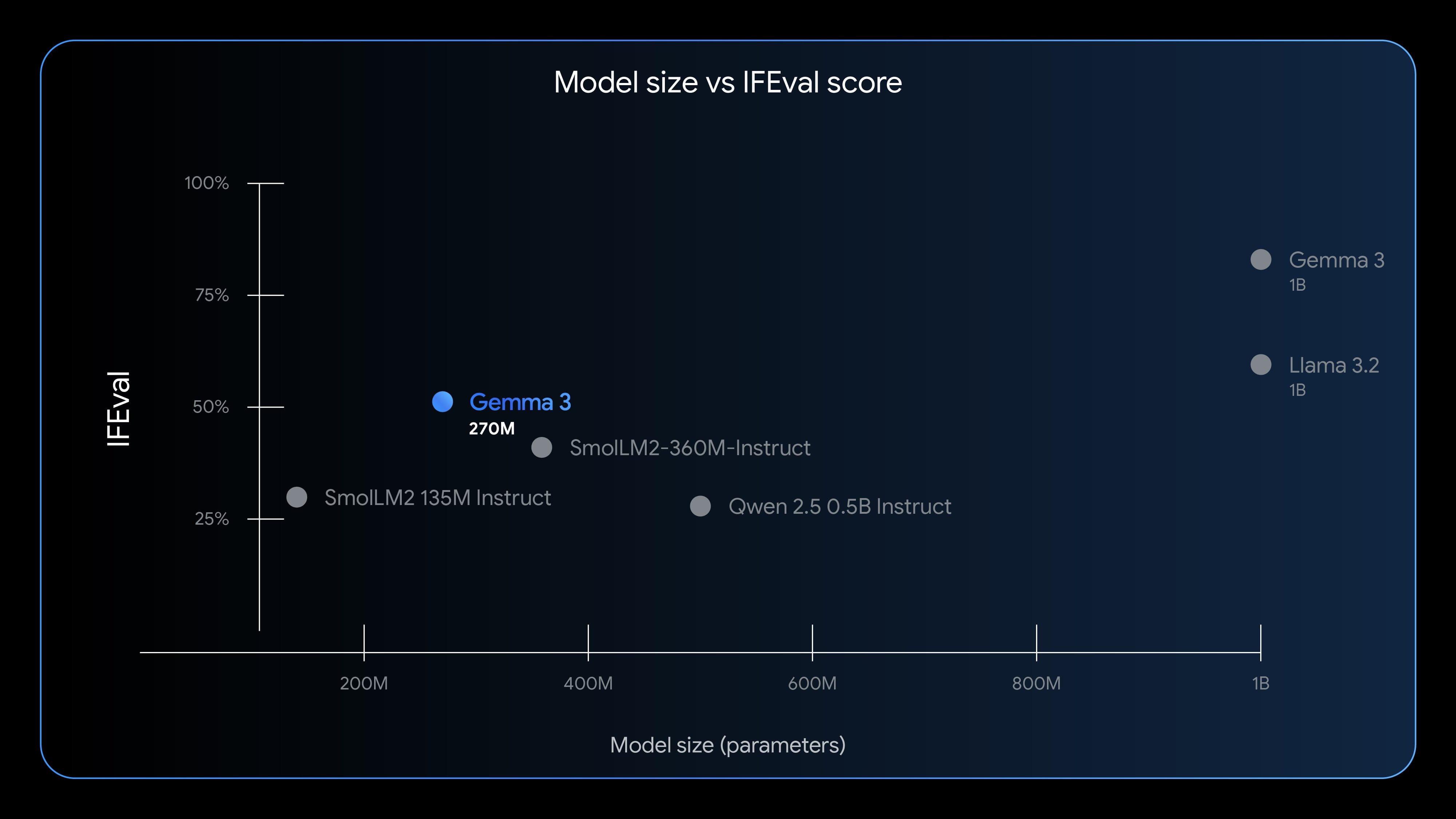

尽管Gemma 3 270M的参数量远低于数十亿级的大模型,但其在特定任务上的表现却令人惊喜。谷歌采用了IFEval基准测试来评估模型理解和遵循指令的能力。Gemma 3 270M在该测试中取得了51.2%的成绩,这一分数不仅超越了某些参数更多的轻量级模型,也展现了其“以小博大”的实力。当然,它在复杂性上仍无法与Llama 3.2这类参数过亿的模型相提并论,但在其目标应用领域内,其表现已足够出色。

这种在有限资源下实现高效指令遵循的能力,归因于谷歌在模型架构设计和优化算法上的深耕。它可能采用了更紧凑的网络结构、高效的量化技术以及剪枝策略,旨在最大化每2.7亿参数的潜力。对于开发者而言,Gemma 3 270M的另一大吸引力在于其快速且低成本的微调能力。由于模型体积小巧,开发者可以迅速根据特定业务需求对其进行训练和优化,大大缩短了开发周期并降低了资源投入。

应用场景:解锁边缘AI的无限可能

Gemma 3 270M的特性使其在诸多场景下拥有广阔的应用前景。谷歌最初设想的应用包括文本分类和数据分析,这些任务对推理速度和本地处理能力有较高要求。然而,其潜力远不止于此。我们可以预见以下几种典型应用:

- 个性化设备助理:在本地处理用户语音指令,提供高度个性化的建议和服务,无需担忧数据外泄。

- 离线内容生成:在无网络环境下进行文本摘要、文章续写或创意生成,例如浏览器内置的故事生成器。

- 智能家居设备:实现本地化的语音控制、环境感知和智能决策,提升响应速度和隐私安全性。

- 工业物联网(IIoT):在边缘网关进行实时数据预处理和异常检测,减少云端负载和带宽需求。

- 教育辅助工具:在学生设备上提供即时语言学习反馈、作文批改建议等,保护学生隐私。

这些应用无不体现了边缘AI的独特价值:将智能推向数据源头,实现更安全、更快速、更经济的计算模式。

“开放”的边界:构建负责任的AI生态

谷歌将Gemma模型定义为“开放”,这与传统的“开源”概念有所区别,但实际上在多数方面提供了类似的自由度。开发者可以免费下载Gemma 3 270M,获取模型权重,并且无需单独的商业许可协议,即可修改、发布和部署基于Gemma 3 270M的衍生工具。这意味着广大开发者和研究者能够深入模型内部,进行创新实践。

然而,这种“开放”并非毫无限制。所有使用Gemma模型的用户都必须遵守谷歌的使用条款,明确禁止将模型用于生成有害内容或故意侵犯隐私。此外,开发者有责任详细说明对模型的修改,并确保所有衍生版本都附带谷歌的自定义许可条款。这种有条件的开放策略,旨在平衡技术传播与伦理责任,确保AI技术在可控且负责任的框架下发展。这反映了行业在推动AI普及的同时,对潜在风险的审慎考量和积极应对。

Gemma 3 270M目前已在Hugging Face和Kaggle等主流AI平台上线,提供了预训练和指令微调版本,方便开发者快速上手。同时,它也整合至谷歌的Vertex AI平台,方便企业级用户进行测试和部署。谷歌还通过Transformer.js构建了一个完全基于浏览器的故事生成器,向公众展示了这一轻量级模型的强大能力,让即便非专业开发者也能体验到AI的魅力。

边缘智能的未来展望

Gemma 3 270M的发布,不仅是谷歌在小型AI模型领域的一次成功探索,更是对整个AI行业发展方向的一次深刻启示。它证明了高效、实用的AI能力并非大型模型的专属,通过精妙的设计和优化,即使是“小而美”的模型也能在特定场景下发挥关键作用。未来,随着硬件技术(如NPU、TPU等边缘AI芯片)的不断进步,以及模型压缩、量化等技术的日益成熟,我们有理由相信,像Gemma 3 270M这样的边缘智能模型将成为主流,渗透到我们日常生活的方方面面。

这将推动AI从集中式云服务向分布式、普适性智能的转变,形成云边协同的混合AI架构。大型模型负责复杂、耗时的推理任务,而轻量级边缘模型则处理即时、高频的本地交互。这种协同工作模式,将最大化AI的效能和覆盖范围,同时兼顾隐私、效率和成本。Gemma 3 270M正是这一变革的先驱,它为AI的未来描绘了一幅更加智能、更加个性化、更加触手可及的图景。