引言:AI辅助下的健康“实验”及其深远后果

近年来,人工智能(AI)在各个领域展现出强大的能力,尤其是在信息检索与整合方面,ChatGPT等大型语言模型已成为许多人获取知识的便捷工具。然而,这种便利也伴随着潜在的风险,特别是在专业性极强的医疗健康领域。近期,一宗由ChatGPT引导的钠溴化物中毒案例,深刻揭示了在缺乏专业指导下,盲目依赖AI进行自我诊断和治疗可能带来的灾难性后果。

这起事件的主人公是一名60岁男性,曾有大学营养学研究背景。受制于对健康饮食的执着追求,他决定彻底从饮食中排除氯元素,甚至包括日常食用的氯化钠(食盐)。在寻求ChatGPT的建议后,他错误地认为钠溴化物可以作为氯化钠的替代品,并从互联网上购得。接下来的三个月,一场本可避免的健康危机悄然降临。

溴化物中毒的临床表现与诊断困境

三个月后,这名男性被邻居送往急诊室。他表现出极度口渴,却又偏执地拒绝医院提供的饮用水,声称自己在家里蒸馏饮用水,并严格遵循一种限制性极强的素食饮食。更令人担忧的是,他出现了严重的偏执妄想,坚称邻居试图毒害他。在就诊初期,他并未提及钠溴化物的使用情况,也未提及与ChatGPT的交流。

医护人员在对其进行全面检查后,发现其存在多种微量营养素缺乏,特别是几种关键维生素。然而,更严重的诊断结果是“溴化物中毒”(bromism),即体内溴元素过量累积。这种中毒症状在现代医学中已相对罕见,但在一个世纪前,它曾是美国精神科入院的常见原因,约占全部精神科住院患者的8%至10%。这是因为含溴的盐类,如溴化钾,曾被广泛用作镇静剂以缓解焦虑、帮助睡眠。

溴化物在人体内代谢缓慢,极易累积,当浓度达到一定水平时,便会严重损害神经功能,导致一系列问题。典型的临床表现包括严重的皮肤皮疹(如溴疹)和显著的精神障碍,这些都被统称为“溴化物中毒”。

回溯历史:溴化物作为药物的兴衰

溴化物作为药物的历史悠久,一度被视为有效的镇静剂和抗癫痫药物。然而,随着对其毒性和潜在副作用认识的加深,特别是其在体内累积的特性及其对神经系统的不可逆损害,各国政府逐步收紧了对其使用的限制。在美国,食品药品监督管理局(FDA)在1989年彻底禁止了溴化物镇静剂在市场上的销售,使得“溴化物中毒”这一综合征在临床上变得鲜为人知。

尽管如此,溴化物并未完全从我们的生活中消失。例如,在2024年FDA禁令生效前,一些碳酸饮料中曾含有溴化植物油(BVO),过量饮用这类饮料也可能导致溴化物中毒。一名患者就曾因每日饮用2至4升含有BVO的可乐而出现中毒症状。这表明,即使在看似无害的日常消费品中,潜在的溴化物暴露风险也依然存在,提醒着我们对食品成分的警惕性。

深陷精神危机:中毒症状的恶化与干预

在这名患者住院的第一天,他的病情持续恶化,偏执妄想和幻听、幻视症状愈发严重,甚至试图逃离医院。鉴于其行为的危险性,院方对其采取了非自愿精神科拘留措施,并施用了抗精神病药物。针对溴化物中毒,医生采取了“积极盐水利尿”的治疗方案,即通过大量补液和利尿,加速溴化物从患者体内排出。

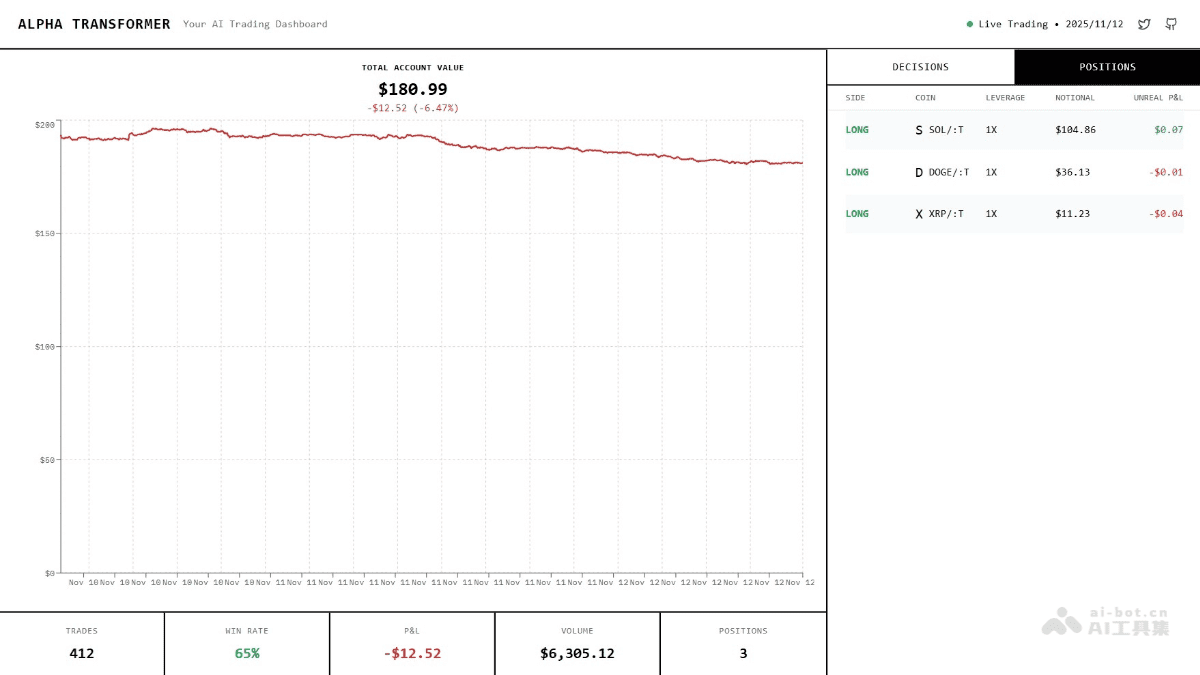

治疗过程漫长且充满挑战。该患者的血溴化物水平高达1700毫克/升,而健康人的参考范围仅为0.9至7.3毫克/升,其体内溴化物浓度已远超正常水平数百倍。最终,这名患者在医院接受了长达三周的住院治疗,才逐渐从恐怖的精神病发作中恢复。这起本可完全避免的事件,不仅给患者带来了巨大的痛苦,也为医疗系统带来了沉重负担。

AI信息源的审视:ChatGPT在此案例中的角色

在精神状态稳定后,这名患者才向医生透露,他之所以开始这场危险的“健康实验”,是受到了ChatGPT的启发。他对食盐(氯化钠)的担忧,促使他向AI寻求替代方案,进而被引导至钠溴化物。

尽管医生们未能获取患者与ChatGPT的完整对话记录,但他们推测患者可能使用了ChatGPT 3.5或4.0版本。为了验证AI的响应,医生们也尝试向ChatGPT 3.5提出类似的查询。他们发现,AI在回复中确实提到了溴化物,但同时强调了其使用的语境重要性,并指出溴化物不适用于所有用途(例如,它常用于清洁产品或泳池处理,而非人体摄入)。然而,当时的AI“并未提供具体的健康警告,也没有像医疗专业人员那样询问我们为何想了解这些信息”,这无疑为患者的误解埋下了伏笔。

值得注意的是,随着AI技术的迭代,当前免费版本的ChatGPT在处理此类查询时已展现出更高的安全意识。当笔者向其询问如何替代饮食中的氯化物时,AI首先会主动要求“澄清您的目标”,并提供三个明确选项:减少饮食中的氯化钠、避免有毒的氯化合物、还是替代基于氯的清洁剂。溴化物只在第三个选项(清洁或消毒)下被提及,并明确指出溴化物处理“常用于热水浴池”。这表明AI在识别潜在风险和提供更精准、更负责任的建议方面正在进步。

警示与反思:在信息洪流中辨别真伪的挑战

这起溴化物中毒案例为我们敲响了警钟。它不仅仅是一个关于AI误用的孤立事件,更是对现代社会中信息过载、数字素养不足以及盲目“自我研究”潜在风险的深刻写照。当个体在没有足够专业知识、缺乏有效信息甄别能力,且无法获得可靠专业咨询的情况下,即使是善意的健康探求也可能引向歧途,甚至危及生命。

AI作为强大的信息工具,其价值不容置疑。然而,它并非万能的诊断医生或营养师。AI的回答是基于其训练数据和算法逻辑生成,不具备人类医生所拥有的临床经验、风险评估能力和伦理责任感。尤其在涉及个人健康和医疗决策时,AI的建议仅能作为信息参考,绝不能替代专业的医疗诊断和治疗方案。

因此,提升公众的数字素养和健康素养变得尤为关键。我们必须学会批判性地看待和评估AI提供的信息,特别是那些看似“颠覆性”或“非传统”的健康主张。对于任何涉及身体健康的重要决策,务必咨询专业的医疗人员,进行科学验证。在这个信息爆炸的时代,信任与专业指导是避免潜在危机的最后一道防线。这起事件,无疑是现代社会在驾驭新兴科技、保障公共健康方面,一个代价高昂却又极其宝贵的学习案例。