在数字内容生产日益繁荣的当下,音视频内容的创作效率与质量已成为产业升级的关键考量。尤其在多模态融合的复杂语境中,如何高效、精准且富有表现力地生成适配各类输入形式的音频内容,长期以来是人工智能领域的一项核心挑战。腾讯AI Lab近期发布的AudioGenie,凭借其前瞻性的多模态音频生成范式,正为解决此项难题提供了一条富有潜力的路径,有望重塑未来的音视频内容生产工作流。

AudioGenie:多模态音频生成的新定义

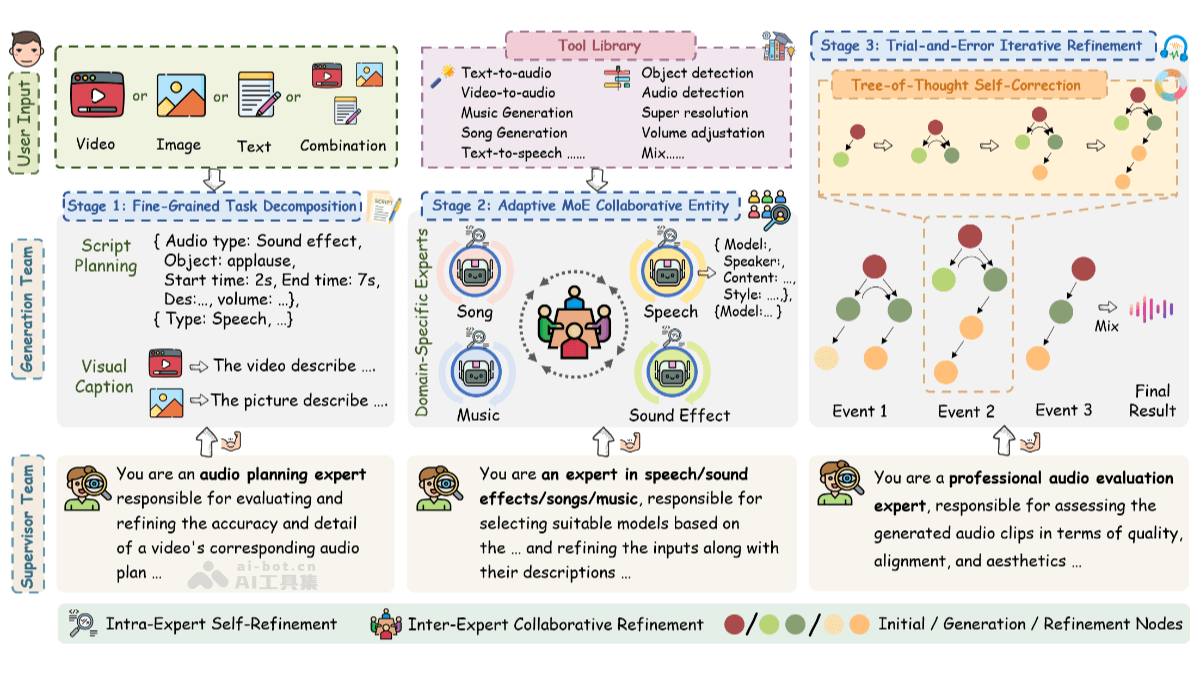

AudioGenie并非简单的音频生成器,它被设计为一个能够从视频、文本、图像等多元输入中,智能提炼信息并生成音效、语音乃至背景音乐的多功能系统。其核心创新在于采用了一种无训练的多智能体框架,这彻底颠覆了传统深度学习模型对海量标注数据的高度依赖,显著提升了系统的泛化能力与适应性。在这一框架内,AudioGenie构建了一个独特的双层协作架构:生成团队负责创意与执行,而监督团队则专注于质量控制与迭代优化,两者协同作用,确保最终输出的音频内容不仅丰富多样,而且高度可靠。

卓越功能:深度解析AudioGenie的核心能力

AudioGenie的强大功能首先体现在其卓越的多模态输入与多音频输出能力。无论是电影片段中的特定情境,一段描述性文字,还是一幅静态图像,系统都能根据其内在语义,智能匹配并生成相应的环境音效、角色对白或情感音乐。这种跨模态的理解与生成能力,极大拓展了内容创作的可能性。其次,其无训练的多智能体框架是其高效运作的基石。在生成任务的初期,系统能够将复杂的输入信息智能分解为一系列具体的音频子事件,例如精确识别视频中某个动作发生的时间点,并为此生成对应的音效,或是根据文本语境,为虚拟角色匹配恰当的语气和情感。这种精细化的任务分解,为后续的精确生成奠定了基础。

值得关注的是,AudioGenie引入了基于“思维树”(Tree of Thought)的试错与迭代优化机制。当生成团队完成初步的音频输出后,监督团队会立即介入,从音质、与输入内容的对齐度、整体美学体验等多个维度进行严谨评估。一旦发现任何瑕疵,系统将自动触发修正或重试流程,直至生成结果完全符合预设的高标准。这种闭环式的自我纠错能力,保证了AudioGenie在复杂场景下也能产出高质量且高度一致性的音频内容,展现出接近人类专家水平的判断与调整能力。

技术揭秘:AudioGenie的创新架构

在技术深层,AudioGenie的双层多智能体架构是其成功的关键。生成团队包含一系列专业的生成模块,它们并非孤立运作,而是通过自适应混合专家(MoE)协作机制实现动态调度。这意味着系统能够根据当前音频子任务的具体需求,智能地选择最适合的预训练模型或算法组合进行生成,并能通过专家间的反馈与修正机制,不断优化生成方案。这种灵活性与适应性,使得AudioGenie无需针对特定任务进行大规模训练,从而有效规避了数据稀缺、过拟合等传统AI模型常见的问题,极大提升了系统的泛化能力与部署效率。

监督团队则承担着核心的质量保障职能。它运用先进的感知与分析算法,对生成团队产出的音频进行时空一致性验证。这不仅包括检查音频内容与视频画面在时间轴上的同步性,也包括确保音效的空间定位、语音的情感表达与文本语义的高度契合。这种严苛的反馈循环机制,是AudioGenie能够持续自我纠错并最终输出高度可靠音频的关键所在。正是这种生成与监督的有机结合,构建了一个自我进化、自我优化的智能系统。

性能验证:MA-Bench基准测试的卓越表现

为了量化AudioGenie的性能,腾讯AI Lab还专门构建了全球首个针对多模态到多音频生成(MM2MA)任务的基准测试集MA-Bench。该测试集包含了198个经过精细多类型音频注释的视频样本,为评估此类复杂生成任务提供了标准化平台。在MA-Bench的严格测试中,AudioGenie在涵盖9项关键指标和8项核心任务的综合评估中,均展现出达到或超越当前最先进水平的卓越性能。尤其在音质纯净度、内容对齐准确性、以及整体美学体验方面,AudioGenie的表现尤为突出,有力证明了其技术架构的优越性与实用价值。

广阔应用:AudioGenie如何赋能数字内容产业

AudioGenie的应用前景极为广阔,其突破性的能力有望深刻影响多个行业。

影视制作

它能显著简化后期制作流程。例如,系统可以根据视频画面中的场景与动作,自动生成精确匹配的背景音乐、环境音效(如风声、雨声、人群喧哗),甚至是角色细微的情绪语音。这不仅大幅提升了制作效率,降低了成本,更能帮助创作者快速迭代,实现更具沉浸感的视听体验,使观众仿佛置身其中。

虚拟人物配音

无论是虚拟主播、客服机器人还是数字偶像,它都能根据预设的文本内容或实时互动,生成自然流畅、情感丰富、富有表现力的语音。这种高拟真度的人声,能够极大增强虚拟角色的真实感与互动性,打破人机交互的界限,为虚拟IP的商业化运营提供强劲支撑。

游戏开发

沉浸式的音频体验是提升玩家代入感的关键。AudioGenie能够根据复杂的游戏场景、玩家行为和剧情发展,实时生成动态变化的背景音乐、逼真的环境音效(如森林鸟鸣、城市喧嚣、战斗轰鸣)以及个性化的角色语音。这将使游戏世界更加生动立体,为玩家带来前所未有的视听盛宴。

播客制作

播客制作也将迎来效率革命。传统的播客配乐和音效添加往往依赖人工挑选与剪辑,耗时耗力。AudioGenie能根据播客内容的叙事节奏、情绪起伏,自动生成符合情境的背景音乐与音效,例如在紧张情节处自动加入悬疑音效,在轻松对话时切换到轻快旋律。这不仅提升了播客的专业度与吸引力,也极大地解放了创作者的生产力。

广告片剪辑

对于广告片剪辑而言,AudioGenie能快速匹配并生成符合品牌调性、产品特点的音效和背景音乐。从产品介绍的激昂音乐到情感营销的温馨旋律,系统都能精准把握。这不仅能大幅节省制作时间和成本,更能通过听觉元素的精准加持,有效提升广告的吸引力、感染力与传播效果,助力品牌高效触达目标受众。

展望未来:AI音频生成的新篇章

总而言之,AudioGenie不仅是腾讯AI Lab在多模态AI领域的一次重要突破,更代表了人工智能在内容生成方向的深远潜力。通过其独特的无训练多智能体架构、精细化的任务分解以及高效的迭代优化机制,AudioGenie成功地将复杂的多模态输入转化为高质量、高一致性的音频输出,极大地拓宽了AI在创意产业的应用边界。展望未来,随着AI技术的持续演进,像AudioGenie这样的智能工具将不仅仅是辅助性存在,它们有望成为驱动数字内容产业变革的核心引擎,赋能全球创作者,共同构建一个更加丰富多彩、高效智能的数字视听新生态。其所展现出的自主学习与协同能力,也为通用人工智能的未来发展提供了宝贵的实践经验与思考方向。