近来,一位热衷于构建AI语言模型的大学生海克·格里戈里安,意外地从其最新的AI创作中获得了一堂生动的历史课。他的AI模型专为模拟维多利亚时代的英语风格而设计,却在输出中提及了1834年伦敦发生的真实抗议活动——而在此之前,格里戈里安本人对此段历史并不知情。

格里戈里安,作为美国马赫伦伯格学院的计算机科学专业学生,对AI能够重构历史事件感到非常惊喜。他表示,在模型提到1834年伦敦的抗议后,他通过谷歌搜索确认了事件的真实性。在过去的一个月里,他致力于开发TimeCapsuleLLM,这是一个小型AI语言模型,其数据来源仅限于1800年至1875年间伦敦出版的文本。他的核心目标是让AI模型能够以地道的维多利亚时代腔调进行文本输出,因此,模型的生成内容充满了圣经引用和那个时代的修辞风格。

格里戈里安的项目与当前日益增长的“历史大型语言模型”(HLLM)研究领域相契合。这些研究探索如何利用大型基础模型处理特定历史时期的文本。例如,MonadGPT模型训练了1400年至1700年间的11,000篇文本,能够用17世纪的知识框架讨论主题;而XunziALLM则致力于生成符合古代韵律规则的古典中文诗歌。这些模型为研究人员提供了一个与过去时代的语言模式进行交互的独特视角。

根据格里戈里安的描述,TimeCapsuleLLM最引人注目的输出出现在一个简单的测试中。当他输入“时值吾主1834年”时,这个被训练成能够延续文本的AI模型生成了如下内容:

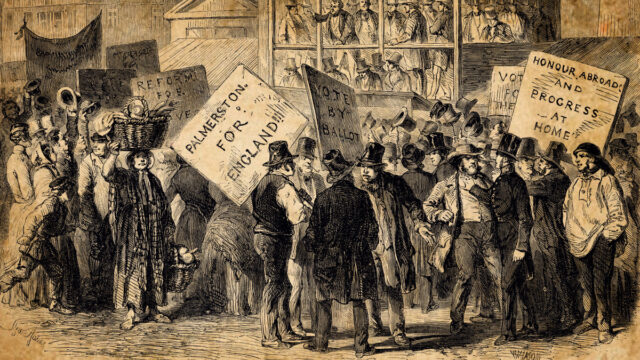

时值吾主1834年,伦敦街头充满了抗议与请愿之声。正如许多人所复述,其因并非私事,然于当日,在帕默斯顿勋爵之日,公众将得知关于法律之日降临我等所面临困境之简短声明。深感遗憾,世事之当前进展历历在目,因而必将广为人知。最初于耶路撒冷传福音之人,其兴旺与繁荣拥有如此广阔而有趣的记载,此言非虚。

对这段文本的准确性感到好奇,格里戈里安进行了事实核查。他发现,AI的输出提到了帕默斯顿勋爵,并在谷歌搜索后得知,正是帕默斯顿的某些行动导致了1834年的抗议活动。AI生成文本中提及的细节与历史事实确有吻合:1834年,英国因《1834年济贫法修正案》而引发了严重的社会动荡,而帕默斯顿在这一动荡时期担任英国外交大臣。

从表面上看,这种输出并不令人意外。AI研究人员早已认识到,语言模型能够从学习的文本中合成信息,生成逼真的文本排列组合,这是现代AI助手的基本工作原理。然而,这次事件的特别之处在于,一个由个人训练的小型模型,似乎在没有明确被告知这些关系的情况下,从数千份文档的零散参考中,重构了一个连贯的历史时刻,将特定年份与实际事件和人物联系起来。格里戈里安并未专门针对1834年抗议事件的文档训练模型;AI只是从维多利亚时代6.25GB书面材料的整体模式中,自主地建立了这些联系。

格里戈里安在Reddit上写道:“这仅仅来自5-6GB的数据。想象一下如果数据量达到30GB或更多,结果会怎样。我不确定仅仅扩大数据量是否能产生推理能力,但即便现在,这感觉也像是一种数字时间旅行。”

统计学驱动的语言时间旅行

与传统上在现代文本源上进行微调不同,开发者海克·格里戈里安采用了一种名为“选择性时间训练”(Selective Temporal Training,STT)的独特方法,从零开始训练他的AI模型。他专门使用了1800年至1875年间在伦敦出版的超过7,000本书籍、法律文件和报纸作为语料库。为此,他创建了一个自定义的分词器,该分词器将单词分解为简化的表示形式以方便处理,并完全排除了现代词汇。格里戈里安解释道,如果他微调像GPT-2这样的模型,其预训练的信息将无法消除现代数据污染。而从头开始训练,语言模型将不会“假装”是旧时代的,而是“本身就是”旧时代的。

格里戈里安利用nanoGPT和微软Phi 1.5等“小型语言模型”的架构,迄今已训练了三个AI模型,每个版本在历史连贯性上都有所提升。最初的0版本,仅通过187MB数据训练,产生了维多利亚风格的乱码。0.5版本实现了语法正确的时代散文,但仍存在事实“幻觉”。目前这个拥有7亿参数的版本,是在租赁的A100 GPU上训练的,它已经开始生成像上述那样的历史参考。

格里戈里安发现,随着高质量训练数据规模的扩大,模型的虚构现象逐渐减少,这在AI研究领域,尤其是对于小型模型而言,是一个广为人知的效应。他在GitHub上写道:“早期的模型(v0和v0.5)可以模仿19世纪的写作风格,但总是会虚构事件、人物和事实。这表明模型已经开始从数据集中记住事物。”

对于历史学家和数字人文研究者来说,这类实验具有重要的潜在价值。在特定时代文本上训练AI语言模型,可以创建交互式的时代语言模型,使研究人员有机会与模拟的已消逝方言或古代语言使用者进行“对话”。尽管由于可能存在虚构,其结果不一定在事实上严谨,但对于研究古代句法或词汇使用的人来说,其在风格上可能具有启发性。

格里戈里安表示,他未来希望尝试不同的城市模型,例如中文、俄语或印度城市模型,并邀请其他人合作开发未来的AI模型。他将所有代码、AI模型权重和工作文档在GitHub上公开,以促进更广泛的协作与研究。在AI“幻觉”频发的时代,一个模型能够意外地揭示过去的真相,无疑令人耳目一新。这几乎是“幻觉”的反义词——一个AI模型意外地做出了正确判断。我们可以称之为“事实性巧合”。