在人工智能技术飞速发展的今天,多模态生成模型已成为AI领域的前沿研究方向。阿里云推出的通义万相2.5(Wan2.5)作为最新一代多模态生成模型,不仅实现了技术上的重大突破,更在实际应用中展现出巨大潜力。本文将全面解析这一创新技术,探讨其如何改变内容创作格局。

Wan2.5:重新定义多模态生成

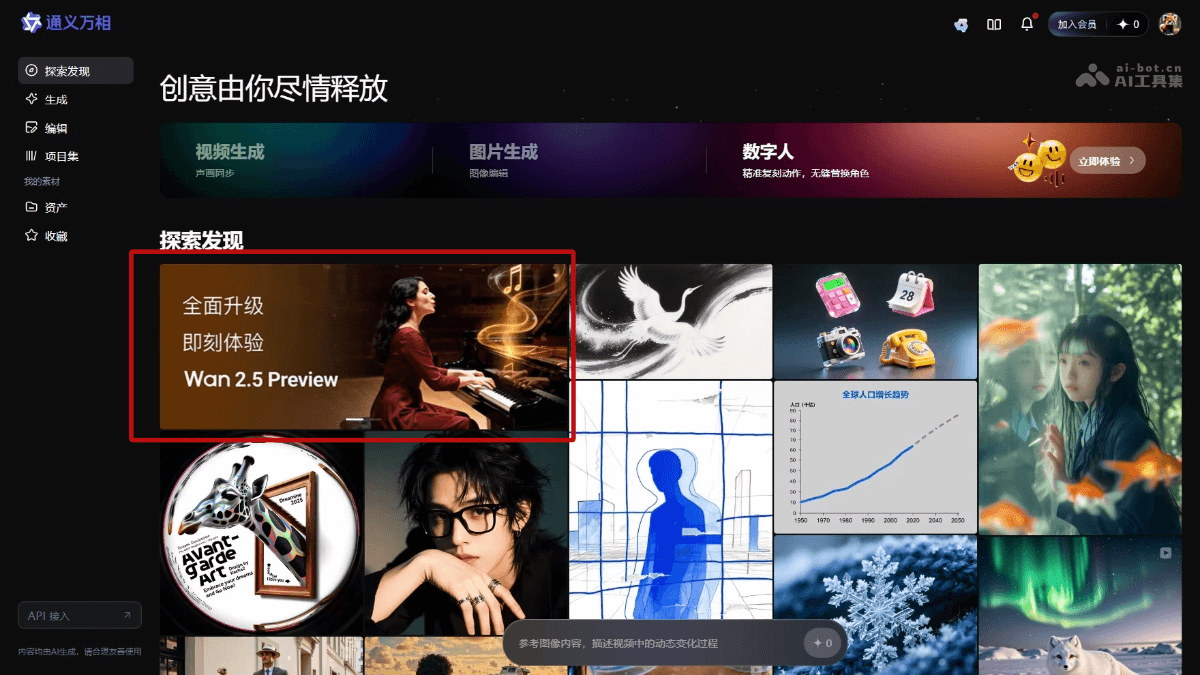

通义万相2.5(Wan2.5)是阿里云基于原生多模态架构开发的最新生成模型系列,作为通义万相2.5 preview版本,它实现了文生视频、图生视频、文生图和图像编辑四大核心功能。与上一代产品相比,Wan2.5在视频生成时长、画质、音画同步等方面实现了质的飞跃,首次实现了音画同步的视频生成能力,支持1080P、24fps的高清视频创作。

Wan2.5的最大突破在于其原生多模态架构设计,用户只需输入提示词或上传音频即可驱动创作,无需复杂的操作流程。这种设计大幅降低了内容创作的技术门槛,使非专业用户也能轻松创作出高质量的视频和图像内容。目前,该模型已上线通义万相和阿里云百炼平台,为用户提供便捷的AI创作服务。

四大核心功能详解

视频生成:从5秒到10秒的飞跃

Wan2.5在视频生成方面实现了三大突破:

音画同步技术:模型能够生成与画面完美匹配的人声(包括多人对话)、音效和背景音乐,支持多种语言,实现了画面与声音的严丝合缝。这一功能解决了传统AI视频生成中音画不同步的痛点,使生成的视频更具真实感和观赏性。

时长提升:视频生成时长从上一代的5秒提升至10秒,虽然看似只是简单的翻倍,但却能实现更完整的剧情表达和叙事结构,为创意内容提供了更广阔的表现空间。

高清画质:支持24帧每秒的1080P高清视频生成,这一参数已达到电影级标准,满足了专业级内容创作的需求。无论是广告、电商还是影视领域,都能获得高质量的视觉体验。

此外,Wan2.5还具备复杂指令理解能力,能够准确理解并执行运镜等复杂连续变化指令,使生成的视频更具专业性和艺术性。

图像生成:从文字到视觉的精准转化

在图像生成方面,Wan2.5展现了强大的文字理解和视觉转化能力:

多语言文字生成:支持中英文、小语种、艺术字、长文本和复杂构图的精准渲染,能够生成从简单标语到复杂海报的各种文字图像,满足不同场景的需求。

结构化图表生成:能够输出科学图表、流程图、数据图、架构图和文字内容表格等结构化图文,这一功能对于教育、科研和商业分析等领域具有重要价值。

图像编辑:一键实现专业级P图效果

Wan2.5的图像编辑功能同样令人印象深刻:

丰富编辑任务:支持换背景、改颜色、加元素、调风格等多种编辑任务,用户无需专业PS技能即可完成复杂的图像处理工作。

精准指令理解:输入一句话即可完成P图,指令理解精准度高,大大简化了图像编辑流程。

一致性保持:支持单图/多图参考垫图,能够保持人脸、商品、风格等视觉元素的一致性,解决了AI编辑中常见的风格不统一问题。

技术创新:原生多模态架构的优势

Wan2.5基于原生多模态架构开发,这一技术路线相比传统多模态模型具有明显优势:

统一表示空间:原生多模态架构将不同模态(文本、图像、音频、视频)映射到统一的表示空间,实现了模态间的深度融合和交互,大大提升了模型对复杂指令的理解能力。

端到端训练:采用端到端训练方式,减少了中间环节的信息损失,使生成的内容更加连贯和一致。

高效推理:通过模型优化和算法改进,Wan2.5在保持高质量输出的同时,实现了更快的生成速度,提升了用户体验。

实际应用场景:从创意到落地的全流程

广告制作:创意加速器

广告公司可以利用Wan2.5快速生成与广告主题相关的创意视频和图像,大大提升广告内容的制作效率和多样性。传统广告制作需要专业的拍摄团队、后期制作团队,周期长、成本高。而使用Wan2.5,创意人员只需输入创意描述,就能在短时间内生成多个创意方案,大大缩短了从创意到成片的时间,降低了制作成本。

电商内容创作:商品展示新方式

电商平台和商家可以利用Wan2.5生成商品展示视频和海报,提升商品的吸引力和用户的购买意愿。传统的商品展示需要专业的拍摄和后期制作,而使用Wan2.5,商家可以轻松生成不同场景、不同风格的产品展示视频,满足不同平台、不同受众的需求。

影视制作:创意验证工具

影视制作团队可以利用Wan2.5生成初步的视频脚本、场景设计和特效预览,帮助导演和编剧快速验证创意,降低制作风险。在传统影视制作中,创意验证往往需要投入大量资源制作样片,而使用Wan2.5,只需输入创意描述,就能快速生成预览效果,大大降低了前期投入。

教育内容创作:知识可视化助手

教育机构和教师可以利用Wan2.5生成教学视频、科学图表和流程图,提升教学内容的生动性和易理解性。传统的教育内容制作需要专业的图像设计和视频制作技能,而使用Wan2.5,教师可以轻松将抽象的知识转化为直观的视觉内容,提高教学效果。

如何使用Wan2.5:简单四步完成AI创作

使用Wan2.5进行内容创作非常简单,只需以下四个步骤:

访问官网:首先访问通义万相官网,完成账号注册和登录。新用户可能需要完成实名认证等流程。

选择功能模块:登录后,进入首页,根据创作需求选择相应的功能模块,如"视频生成"、"图像生成"或"图像编辑"等。

输入指令或上传素材:根据所选功能模块的要求,输入相关指令(如文本描述)或上传素材(如图片、音频等)。对于视频生成,可以输入场景描述、人物动作、对话等内容;对于图像生成,可以输入风格、构图、元素等要求;对于图像编辑,可以上传需要编辑的图片,并输入编辑指令。

生成内容:点击"生成"按钮,等待系统处理。生成完成后,平台会显示生成结果,用户可以查看、下载或分享生成的视频、图片等内容。如果对结果不满意,可以调整指令后重新生成。

行业影响与未来展望

Wan2.5的推出不仅是阿里云在AI多模态领域的重要布局,更是整个AI内容创作行业的一个重要里程碑。它的出现标志着AI多模态技术从理论研究走向大规模实际应用的关键一步。

从行业影响来看,Wan2.5将深刻改变内容创作的生态格局:

创作门槛降低:AI技术的普及使非专业人士也能创作出专业级内容,这将催生大量新的创作者和创作形式。

创作效率提升:AI辅助创作大大缩短了从创意到成片的时间,提高了内容生产的效率。

创作成本降低:减少了对专业设备和人员的依赖,降低了内容创作的成本。

创意边界拓展:AI技术能够理解和实现人类难以直接表达的创意,拓展了创意表达的可能性。

未来,随着技术的不断进步,我们可以期待Wan2.5在以下方面实现进一步突破:

更长时长的视频生成:从目前的10秒逐步扩展到分钟级甚至更长时长的视频生成。

更精细的控制能力:提供更精细的视频控制参数,如运镜速度、转场效果、色彩调整等。

更多元的风格支持:支持更多艺术风格和视觉风格,满足不同场景的创意需求。

更强的交互能力:实现实时交互式视频生成,用户可以边生成边调整,获得更直观的创作体验。

结语

通义万相2.5作为阿里云推出的最新多模态生成模型,不仅在技术上实现了重大突破,更在实际应用中展现出巨大潜力。它的出现标志着AI多模态技术从理论研究走向大规模实际应用的关键一步,将深刻改变内容创作的生态格局。

随着技术的不断进步,我们可以期待AI多模态模型将在更多领域发挥重要作用,为人类创造更丰富、更精彩的内容世界。对于内容创作者来说,掌握AI多模态技术将成为未来竞争力的重要组成部分;对于企业而言,积极探索AI多模态技术的应用场景,将有助于提升创新能力和市场竞争力。

通义万相2.5的推出只是开始,未来我们将看到更多创新的多模态AI技术涌现,推动内容创作进入一个全新的时代。