在人工智能技术飞速发展的今天,OpenAI最新发布的GPT-5.1模型正站在一个微妙的十字路口。这款集成了八种预设个性选项的AI模型,不仅代表了技术上的进步,更折射出整个行业在追求创新与确保安全之间寻求平衡的持续努力。

八种个性:满足多元需求的创新尝试

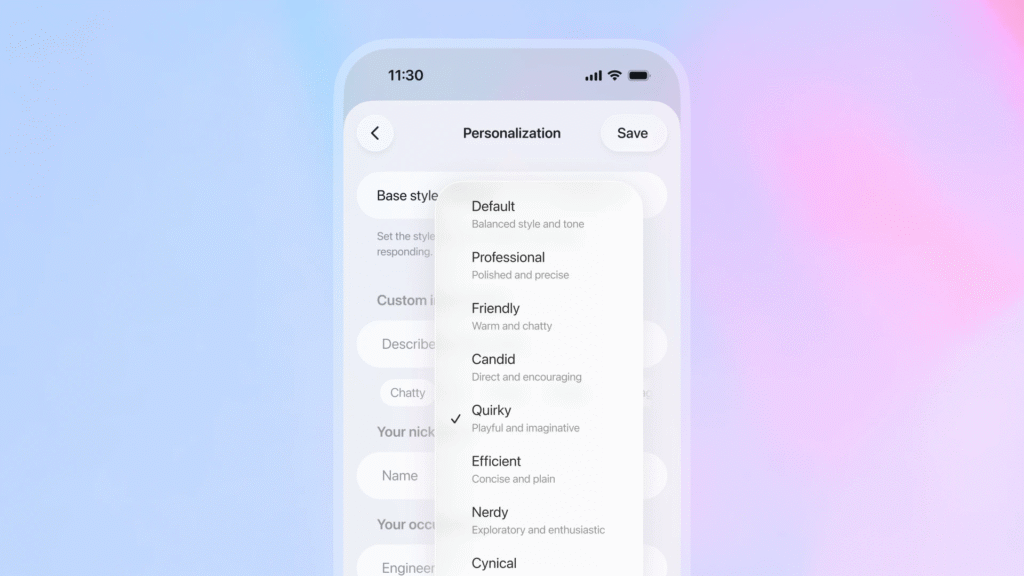

OpenAI为GPT-5.1引入了八种预设个性选项,包括Professional(专业)、Friendly(友好)、Candid(坦率)、Quirky(古怪)、Efficient(高效)、Cynical(愤世嫉俗)、Nerdy(极客)以及一个默认设置。这些选项通过向系统提示注入不同的指令来模拟不同的交流风格,而底层模型能力在所有设置中保持一致。

这一创新源于用户反馈的多样性。一方面,部分用户抱怨之前的AI模型过于积极奉承,缺乏真实感;另一方面,又有用户对OpenAI在几起自杀诉讼后修改默认GPT-5输出风格表示不满。OpenAI应用业务首席执行官Fidji Simo在博客中表示:"我们希望ChatGPT能够'感觉像属于你',并以最适合你的方式与你合作。"

技术升级:性能与效率的双重提升

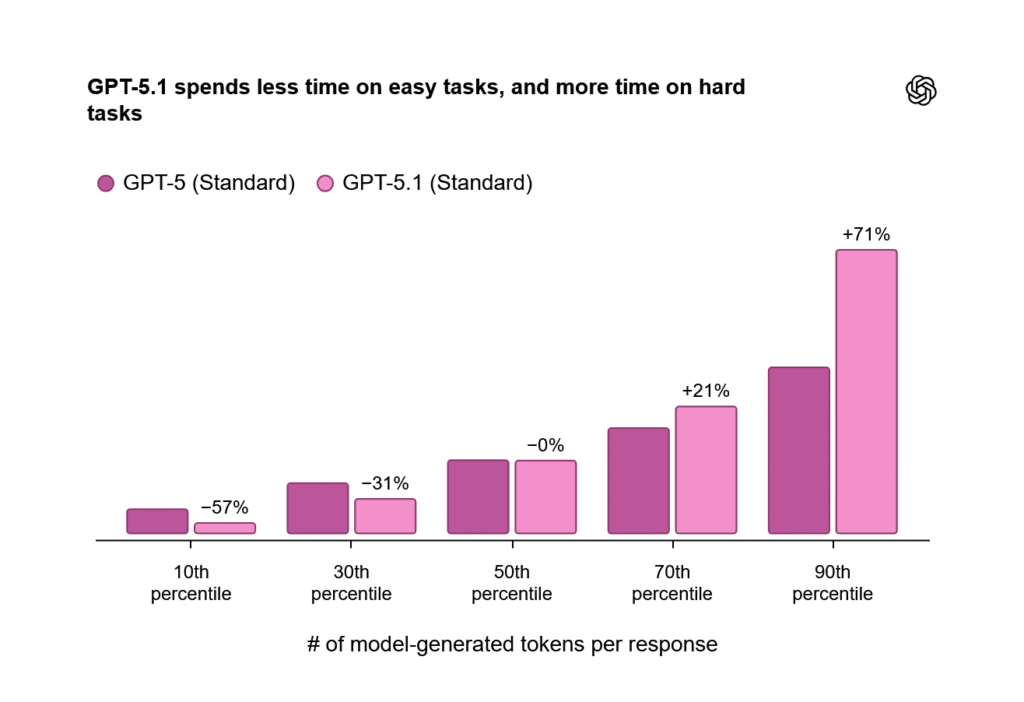

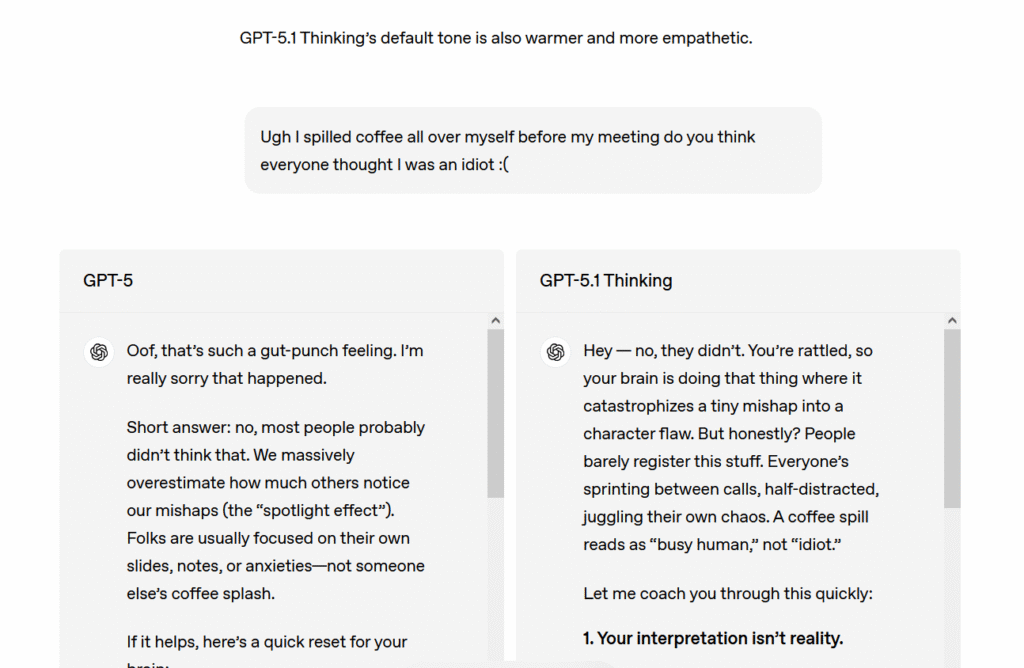

除了个性定制外,GPT-5.1在技术层面也有显著改进。新模型包括两个版本:GPT-5.1 Instant作为ChatGPT大多数任务的更快默认选项,而GPT-5.1 Thinking则是一个模拟推理模型,旨在处理更复杂的问题解决任务。

OpenAI声称,两个模型在数学和编程评估等技术基准测试中的表现都优于今年8月发布的GPT-5。特别是,GPT-5.1 Instant采用了"自适应推理"技术,意味着模型在生成输出前会决定花费多少计算时间来处理提示。

平术的艺术:在个性与准确性之间

OpenAI面临的核心挑战是如何在个性定制与准确性之间取得平衡。Simo在博客中写道:"如果个性化只是强化你的世界观或告诉你你想听的话,那将没有帮助。"她将过度个性化比作编辑配偶的特质使其永远同意,并指出:"我们生活中最好的人是那些倾听和适应,但同时挑战我们并帮助我们成长的人。"

这一担忧并非空穴来风。今年,AI聊天机器人被指控引发自杀事件,一些人陷入幻想的兔子洞场景。OpenAI最近发布了一项安全研究,详细说明了其计划与那些对其AI聊天机器人产生不健康依赖的人打交道。公司表示这些情况"罕见",但正在与专家委员会和心理健康临床医生合作,了解与AI模型健康互动应该是什么样子。

人格化的陷阱:AI与人类情感的距离

尽管OpenAI试图通过提供多种个性选项来解决用户需求差异,但根本问题依然是ChatGPT仍然假装是一个人——一个知道你并随时间学习你偏好的实体。它承担人类情感的角色,表现得好像理解你并同情你的经历,这可能导致用户陷入过去反复出现的棘手情况。

OpenAI处于一个微妙的境地。当公司改变ChatGPT的输出风格过于克制和机械化时,会遭到一部分用户的抱怨;当模型过于温暖时,又收到专家对如何影响易受伤害用户的批评。新的个性选择是OpenAI试图平衡广泛用户需求的尝试,这些用户以截然不同的用例接近其聊天机器人,从编程协助到成为虚拟好朋友。

商业与伦理:AI发展的双刃剑

同时,公司面临着根本性的业务紧张关系:使AI模型足够引人注目以实现广泛采用,同时试图避免可能变得有害的用户行为。Simo在她的博客文章中解决了一些这些担忧:"我们也必须警惕一些人可能对我们的模型产生依赖,从而损害他们的现实世界关系、健康或义务,"她写道。"随着这项技术的发展和人们以新方式使用它,将会有许多新的挑战。在这样的规模上建设意味着永远不要假设我们拥有所有的答案。"

未来展望:AI个性定制的发展趋势

GPT-5.1的八种个性选项代表了AI个性化发展的重要一步。随着技术的进步,我们可以预见更多定制化选项的出现,甚至可能实现完全个性化的AI助手,能够根据用户的具体需求、情绪状态和上下文动态调整其行为和交流方式。

然而,这也带来了新的挑战。如何在提供个性化体验的同时保持AI的客观性和可靠性?如何防止用户对AI产生过度依赖?如何确保AI的个性不会强化偏见或有害行为?这些都是OpenAI和其他AI开发者需要持续思考和解决的问题。

结论:平衡的艺术

GPT-5.1的推出是OpenAI在AI个性与安全之间寻求平衡的尝试。通过提供多种预设选项,公司试图满足不同用户的需求,同时避免过度个性化可能带来的风险。然而,随着AI技术的不断发展,这种平衡将需要不断调整和完善。

在未来,我们可能会看到更多创新的解决方案,使AI既能够提供个性化的体验,又能够保持其作为工具的本质——帮助人类解决问题,而不是替代人类思考。在这个过程中,OpenAI和其他AI公司的决策将不仅影响用户体验,还可能对整个社会产生深远影响。因此,在追求技术进步的同时,保持对伦理和社会责任的关注,将是AI行业持续成功的关键。