人工智能领域在2025年迎来了前所未有的发展浪潮,各大科技公司纷纷推出创新产品和应用,推动AI技术向更深层次、更广领域渗透。从Meta开源的SAM 3D模型到华纳音乐与Udio达成的版权和解,从联想的个人超级智能体到OpenAI为教育领域提供的免费工具,AI技术正在重塑各行各业的工作方式和用户体验。本文将深入探讨这些突破性进展,分析它们对未来的影响,并展望AI技术的发展趋势。

一、空间理解革命:Meta开源SAM 3D模型

Meta AI发布的Segment Anything系列最新模型SAM 3D标志着3D内容生成领域的重要突破。这一创新技术能够仅通过单张2D照片生成高质量的3D资产,彻底改变了传统3D建模的工作流程。在物体和人像重建方面,SAM 3D表现出色,在多个基准测试中优于现有方法,为设计师、游戏开发者和内容创作者提供了前所未有的便利。

技术创新与突破

SAM 3D Objects与SAM 3D Body分别面向通用物体/场景和人像重建,采用了创新的"空间位置-语义"联合编码技术。这一方法为每个像素预测3D坐标与表面法向,显著提升了生成模型的物理正确性。与传统的3D建模技术相比,SAM 3D不仅大幅降低了技术门槛,还将建模时间从数小时缩短至几秒钟,极大地提高了工作效率。

应用场景与行业影响

SAM 3D的推出将对多个行业产生深远影响。在游戏开发领域,开发者可以快速将现实世界中的物体转化为游戏资产;在电子商务中,商家可以轻松创建产品3D展示;在建筑设计中,设计师可以快速将概念转化为可视化模型。Meta已将SAM 3D集成至Quest3与Horizon Worlds创作工具,并计划推出实时手机端推理SDK,这将进一步扩大其应用范围,使更多开发者能够调用这一强大技术。

二、个性化AI助手:联想个人超级智能体

联想在2025/26财年第二财季实现了显著增长,各业务板块均表现亮眼,这为其推出个人超级智能体奠定了坚实基础。联想计划推出的个人超级智能体将实现"听你所听、见你所见、记你所记"的功能,为用户提供前所未有的个性化体验。

技术特点与用户体验

联想的个人超级智能体将深度融合硬件与软件优势,利用联想在PC、移动设备和物联网领域的积累,打造一个全方位的AI助手。与现有的智能助手不同,该智能体将具备更强的情境感知能力,能够根据用户的使用习惯、位置信息和当前任务,提供精准的服务和建议。这种"超级智能体"不仅能够执行简单的指令,还能预测用户需求,主动提供帮助。

市场定位与竞争优势

在AI助手市场日益竞争激烈的背景下,联想凭借其硬件生态系统的优势,有望在个人智能体领域占据一席之地。联想IDG智能设备业务集团营收达1081亿元人民币,同比增长12%,这表明其硬件产品拥有强大的市场基础。杨元庆关于"AI不会出现泡沫,下一阶段将是AI的普及化阶段"的观点,也反映了联想对AI技术长期发展的信心。

三、音乐创作新纪元:华纳音乐与Udio达成版权和解

华纳音乐集团与Udio达成的版权侵权案件和解,标志着AI音乐创作领域的一个重要里程碑。双方计划在2026年推出一个全新的AI音乐创作服务,该平台将利用授权音乐训练生成式AI模型,允许用户使用艺术家的声音和作品进行混音、翻唱及新歌曲创作。

版权与创新的平衡

这一和解协议在保护艺术家权益的同时,也为AI音乐创作开辟了新的可能性。新平台将确保艺术家在使用其声音和作品时获得应有的信用和报酬,解决了AI音乐创作中最敏感的版权问题。这种模式为音乐产业与AI技术的融合提供了可借鉴的范例,有望推动整个行业的创新与发展。

市场反应与投资趋势

Suno完成2.5亿美元融资的消息表明,AI音乐技术正受到投资者的高度青睐。随着各大音乐公司纷纷布局AI音乐创作领域,这一市场有望在未来几年内迎来爆发式增长。华纳音乐与Udio的合作模式,可能会成为行业标准,引领整个行业向更加规范化、合法化的方向发展。

四、教育AI化:OpenAI为K-12教师提供免费ChatGPT

OpenAI推出的专为美国K-12教师设计的免费ChatGPT工具,代表了AI技术在教育领域的重要应用。该工具旨在帮助教育工作者更高效地准备课程材料、进行合作以及掌握人工智能技术,提供了安全的工作环境和隐私保护功能。

实际应用与效果

使用AI工具的教师平均每周节省约6小时的工作时间,这一数据充分展示了AI在教育领域的价值。ChatGPT不仅可以帮助教师快速生成教案和教学材料,还能提供个性化的学习建议,辅助学生完成作业。此外,OpenAI推出的青少年AI素养蓝图,将促进伦理化的人机协作使用,培养学生的AI素养和批判性思维。

长期影响与挑战

免费提供ChatGPT给认证的K-12教师,服务至2027年的承诺,体现了OpenAI对教育领域长期投入的决心。然而,AI在教育中的应用也面临着数据隐私、算法公平性和数字鸿沟等挑战。如何在提高教学效率的同时,确保教育公平和隐私安全,将是教育AI化过程中需要持续关注的问题。

五、多模态AI应用:火山引擎与谷歌地图的Gemini升级

火山引擎凭借豆包大模型与火山方舟平台,在Gartner发布的《AI应用开发平台魔力象限》中位列'挑战者'象限首位,并在'落地能力'维度全球排名第五、中国第一。其优势在于模型-工具-算力-场景闭环完整,已帮助多个行业头部客户构建多模态应用。

火山引擎的技术优势

2025年上半年,火山引擎国内公有云大模型服务市场份额达49.2%,这一数据充分证明了其在市场上的领先地位。火山引擎计划继续扩大多模态应用工具链投入,加速海外落地,这表明其正积极拓展全球市场。火山引擎的成功经验表明,构建完整的AI技术生态,是实现AI技术商业化的关键。

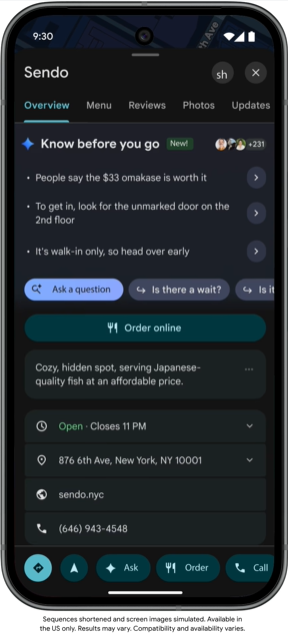

谷歌地图的Gemini升级

谷歌地图引入Gemini模型,推出四项AI功能,包括行前须知、地标导航、充电桩预测和匿名评论,所有功能免费开放。行前须知功能可自动汇总评论与网络信息,提供预订方式、隐藏菜单及最佳停车位提示;地标导航通过实时交叉比对地点数据与街景图像,提供更直观的导航指引;充电桩预测结合历史与实时数据,帮助电动车主避开充电高峰。

六、内容创作革新:Prime Video的AI视频回顾技术

亚马逊Prime Video推出的AI生成功能'Video Recaps',利用大模型自动剪辑、同步旁白与配乐,为观众制作'剧场级'季度精华短片。该功能以Beta形式上线,首批支持《辐射》《杰克·瑞安》等Prime Originals,并计划扩展至更多内容。

技术实现与创意表达

AI模型可识别关键场景、角色弧与高潮冲突,自动生成脚本并匹配套路音乐,这种技术不仅提高了内容创作的效率,还为观众提供了全新的观看体验。与传统的剪辑方式相比,AI视频回顾技术能够从大量素材中精准提取最具代表性的片段,并以专业水准进行剪辑和配乐,大大降低了高质量视频内容的制作门槛。

行业影响与未来展望

当前AI仅用于'回看辅助',不参与正片创作,这一做法有效缓解了艺术家对版权与就业的担忧。随着AI技术的不断发展,未来可能会出现更多创新的内容创作方式,如何在提高创作效率的同时,保护原创者的权益,将是内容产业面临的重要课题。

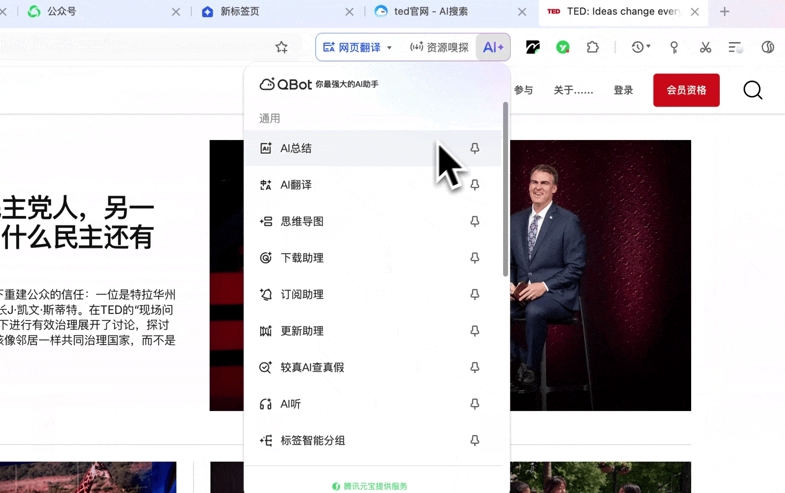

七、浏览器AI化:QQ浏览器的功能升级

QQ浏览器电脑端v19.8.5版本更新,重点优化了菜单布局、AI+小窗功能和标签页管理,同时新增网页语音朗读功能,提升了用户的浏览体验和工作效率。菜单与功能区布局优化,常用工具一键可达;AI+小窗支持多任务处理,提升工作效率;新增网页语音朗读功能,满足多样化需求。

用户体验的全面提升

QQ浏览器的这次更新体现了AI技术在提升用户体验方面的巨大潜力。AI+小窗功能允许用户在不离开当前页面的情况下进行多任务处理,大大提高了工作效率。网页语音朗读功能则为视障用户和希望解放双手的用户提供了便利,体现了科技普惠的理念。

行业趋势与竞争格局

随着AI技术的普及,浏览器正从简单的信息获取工具转变为智能化的工作平台。QQ浏览器的功能升级反映了这一趋势,也预示着浏览器市场的竞争将更加激烈。如何在提供强大功能的同时,保持简洁易用的界面,将是浏览器厂商面临的重要挑战。

八、AI技术发展的未来趋势

综合以上分析,我们可以看到2025年人工智能技术在多个领域取得了显著突破。从技术角度看,多模态AI、空间理解、个性化推荐将成为未来的发展方向;从应用角度看,教育、医疗、娱乐、创意产业等领域将深度融合AI技术;从产业角度看,AI技术与传统行业的结合将创造新的商业模式和价值增长点。

技术融合与创新

未来的AI技术将更加注重多模态融合,结合文本、图像、音频、视频等多种信息形式,提供更全面、更精准的服务。同时,AI与物联网、区块链、5G等技术的结合,将催生更多创新应用,推动数字化转型向更深层次发展。

伦理与监管挑战

随着AI技术的广泛应用,数据隐私、算法公平性、责任认定等伦理问题将日益凸显。如何在推动技术创新的同时,建立健全的监管框架,平衡发展与安全的关系,将是各国政府和国际组织面临的重要任务。

人才培养与教育变革

AI技术的普及将对人才培养和教育模式产生深远影响。未来的教育将更加注重培养学生的创新能力、批判性思维和跨学科知识,以适应AI时代的需求。同时,终身学习将成为常态,成人教育和职业培训将面临新的发展机遇。

结语

2025年,人工智能技术在多个领域取得了突破性进展,从Meta的SAM 3D模型到联想的个人超级智能体,从华纳音乐的AI创作平台到OpenAI的教育工具,AI正在深刻改变我们的生活和工作方式。这些创新不仅展示了AI技术的强大潜力,也为各行业带来了前所未有的发展机遇。然而,AI技术的发展也面临着伦理、监管、人才培养等多方面的挑战,需要政府、企业、学术界和社会各界共同努力,推动AI技术健康、可持续发展,造福人类社会。