在AI技术飞速发展的今天,我们正站在一个历史性的转折点上。当AI的编程能力变得足够强大,一个令人振奋的问题浮现:我们是否即将迎来一个'人人都是创造者'的新时代?蚂蚁集团的全模态通用AI助手'灵光'通过两大创新——'全模态交互'和'30秒闪应用',正在探索一条将AI创造力赋予普通人的道路。

从'信息搜索'到'效用工厂':AI助手的新范式

传统AI助手主要扮演'信息搜索引擎'的角色,而以'灵光'为代表的新一代AI助手则正在经历一场关键的范式转移:从提供信息转向生成可用的工具。这一转变不仅仅是功能的升级,更是AI价值创造方式的革命。

'灵光'的产品组合形成了一个清晰的闭环:'开眼'功能及其代表的实时理解能力,是AI对物理世界的'输入'和'理解';而'闪应用',则是AI对数字世界的'输出'和'创造'。这一进一出,预示着AI助手正在进化为'即时效用工厂',不再只是顾问,更是你的'工匠'和'生产线'。

这种转变的核心价值在于:当用户有一个想法时,AI可以直接交付一个可用的原型,帮助用户将想法迅速实现。这彻底改变了人与技术的关系,从'我该如何使用这个工具'转变为'我想要什么,工具就能帮我创造什么'。

全模态交互:AI不再'废话'的信息美学

'灵光'的第一个创新在于其对'极繁信息'的高度提炼能力。在传统AI助手常常提供冗长文字回答的时代,'灵光'通过多智能体协作架构,实现了基于全代码生成的多模态内容输出,将复杂知识'化繁为简'。

多智能体协作架构的突破

'灵光'在架构上的重大突破是构建了多智能体协作的Agentic架构。在生成可视化内容时,它会动态调用为图像、3D、动画等优化的专用Agent。这些Agent实时协作,共同为用户构建出更完整、更丰富、更沉浸的视图体验。

这种架构的优势在于:当用户提出复杂问题时,如国内核聚变领域的最新进展,'灵光'能在半分钟内读取50个网页链接,并以简明扼要的文字+动态图表的方式呈现结果,而传统方式则需要两三个小时。

移动端高级协作的实现

更令人惊叹的是,'灵光'将这种复杂的协作机制成功落地到了移动端,实现了真正的可交互内容体验。这种能够在'端侧'实现高级Agentic协作的产品,在业内尚属前沿。

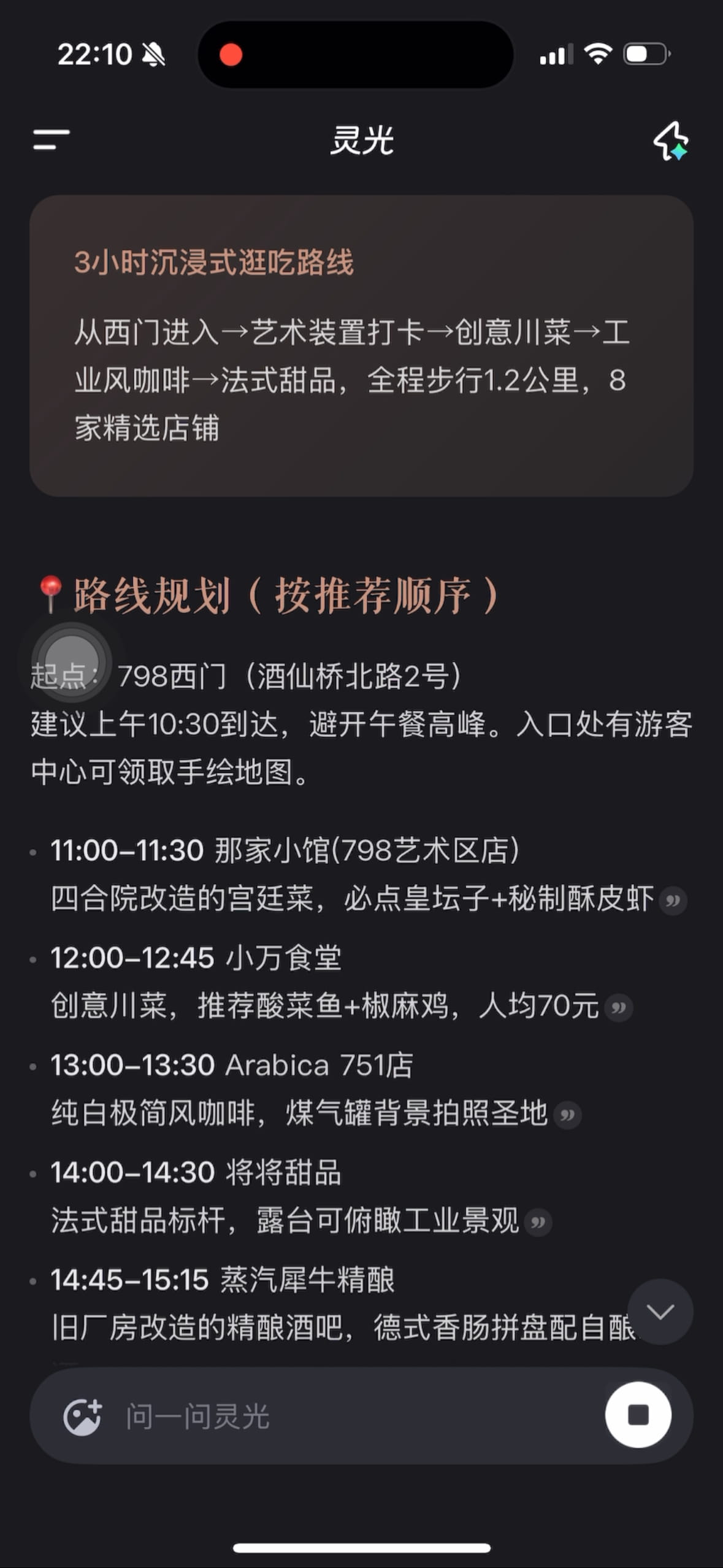

例如,当用户询问798园区美食推荐时,'灵光'能在不到一分钟内读取38个网页,生成一份包含地图导航的'3小时沉浸式逛吃路线',甚至贴心地提供错峰指南、穿搭建议等实用信息。这种'信息美学'的胜利,体现了AI对用户需求的深度理解和精准满足。

30秒闪应用:AI编程的'魔法时刻'

'灵光'的第二个创新——'30秒闪应用',则彻底颠覆了传统软件开发模式,让普通人也能实现'所想即所得'的创造体验。

零门槛的编程体验

传统软件开发需要专业的编程知识和技能,形成了普通人参与数字创造的'技术鸿沟'。而'闪应用'通过对话式AI Coding,铲平了这道门槛,将开发的焦点从'我该怎么实现'拉回到了'我到底想要什么'。

以'emo鼓励大师'应用为例,用户只需简单描述需求——'一个不问为什么,主打直接鼓励的治愈系app','闪应用'就能迅速生成一个可实时交互的应用,包含三种情绪状态和随机鼓励功能。这种即时生成能力,让创意实现不再受限于技术能力。

从简单想法到完整应用

'闪应用'不仅能实现基础功能,还能在交互过程中帮助用户丰富和完善应用。例如,一个简单的'7日健身打卡'想法,通过'闪应用'的引导,最终发展为一个包含打卡提醒、运动完成情况、总运动时长、卡路里消耗等功能的完善应用。

更令人惊喜的是,'闪应用'生成的应用不只是静态的前端页面,而是已经具备了完整的前后端逻辑,可直接调用大模型等后端能力,实时进行交互。同时,它还提供了专业的UI设计,使应用界面简洁美观,色彩协调。

创造力平权:AI应用的终局是'工厂'

'灵光'的创新不仅仅是技术层面的突破,更代表着一种价值观的转变——创造力平权。在传统模式下,好创意与可用产品之间隔着'技术实现'的鸿沟,普通人即使有'产品经理'的视角,也缺乏'工程师'的能力。

快速试错激发创作冲动

'闪应用'的'快'特性是点燃'创作欲'的'催化剂'。传统开发是重决策,而'闪应用'是轻尝试。当一个想法的实现成本(包括时间和金钱)趋近于零时,它带来的就是'即时满足感'。

这种低成本的'手搓'快感,会不断激发普通人心中那股被压抑已久的创作冲动。用户可以随心所欲地试错、迭代,而不必担心失败的成本。这种体验的转变,将释放巨大的创造潜能。

从创作到分享的价值闭环

当一个应用被'手搓'出来,'分享欲'就成了必然的闭环。与分享一张AI图片不同,分享一个自己做出来的应用,其实是在分享一种'效用'和'解决方案'。这种'我造了个工具,你也能用'的成就感,远超简单的内容分享。

这种'快+即时满足+分享欲'的驱动力,正在构建一个超级AI应用工厂的骨架,让每个人都能成为数字世界的创造者,而不仅仅是消费者。

务实主义的AI创新之路

回顾2025年的AI发展,从年初的DeepSeek到年末的'千问'重启,再到'灵光'的功能落地,我们能看到未来的AI创新似乎更倾向于产品落地和用户价值,而非沉溺于AGI的宏大叙事或拟人性的追求。

当行业还在'卷'模型参数和'像不像人'时,这种务实主义成了一股清流,直指AI的商业本质——解决问题。这或许给'百模大战'的下半场提供了另一个答案:AI的终局,可能不是那个最像人、最会聊天的AI,而是那个能让最多的人用最低的门槛创造最大价值的AI。

未来展望:AI与人类创造力的共生

'灵光'的创新代表了AI技术发展的一个重要方向——与人类创造力共生,而非替代。通过降低技术门槛,AI正在将更多人从'使用者'转变为'创造者',这种转变将深刻影响我们的社会结构和经济模式。

未来,随着AI技术的进一步发展,我们可以预见:

- 创意民主化:更多创意将不再受限于技术实现能力,每个人都能将自己的想法转化为实际应用。

- 专业边界模糊:传统上需要专业技能的领域(如软件开发、设计)将变得更加开放,跨领域创新将成为常态。

- 新型社区生态:围绕AI生成应用的社区将蓬勃发展,形成新的知识分享和价值创造模式。

- 教育体系变革:教育重点将从技能传授转向创意培养和问题解决能力。

结语:创造力解放的时代

'灵光'的'全模态交互'和'30秒闪应用'不仅仅是技术产品,更是创造力解放的工具。它们预示着一个新时代的到来——在这个时代,AI不再是高高在上的技术专家,而是每个人身边的创意伙伴;数字创造不再是少数人的专利,而是每个人的基本能力。

这场创造力平权运动的意义,远超技术本身。它关乎人类潜能的释放,关乎创新民主化的实现,关乎我们如何与日益智能化的世界和谐共处。当AI能够理解我们的需求,并将这些需求转化为实用工具时,我们真正迎来了'所想即所得'的魔法时刻。

正如'灵光'所展示的,AI的真正价值不在于它多么智能,而在于它能够释放多少人的创造力。这或许是AI发展最令人振奋的方向——不是取代人类,而是赋能人类,共同创造一个更加丰富多彩的数字世界。