消费电子行业正面临一个普遍的困境:产品迭代速度加快,但创新质量却难以保证。每年层出不穷的新品,往往让消费者陷入选择的迷雾——这些产品到底有何本质区别?这种现象背后,隐藏着一个被广泛忽视的陷阱——「前三代定律」。

「前三代定律」的困局

所谓「前三代定律」,指的是全新品类产品的发展规律:第一代完成品类验证;第二代补强技术短板;第三代在提升参数的基础上优化用户体验。这一阶段,每一代产品都能带来令人眼前一亮的创新。然而,一旦进入第四代,创新步伐往往会放缓,逐渐陷入小修小补的停滞状态。

以智能手机行业为例,iPhone 4之前的每一代产品几乎都能引发全球赞叹。但近年来,创新主要集中在参数层面:CPU性能、面板清晰度、拍照体验等。这些真的是用户最迫切的需求吗?

在这个看似成熟实则「卷成麻花」的行业环境下,发现真问题、找到新解题思路,已成为消费电子行业面临的核心挑战。

百年吸尘器的演进历程

吸尘器的发展历程,堪称一部百年创新史。

从「地毯清扫器」到真空吸尘器

早在1870年代,美国市场就已出现「地毯清扫器」——吸尘器的前身。这类机器利用鼓风机将高压气流吹向地毯,使深层灰尘扬起后回收。有趣的是,它的核心工作原理主要靠「吹」,而非「吸」。

20世纪初,真正的1.0版本吸尘器问世。工程师为其安装了大型密封「集尘袋」,利用真空负压原理实现「吸」尘,这对清洁工而言是重大进步——他们的肺部不再被工作扬起的尘土污染。电动马达的引入也使设备体积大幅减少,从工厂走入家庭。

然而,1.0版本存在明显缺陷:随着灰尘增多,吸力会逐渐减弱,用户需频繁更换和清洁集尘袋。

气旋分离技术带来的革命

1970年代末,气旋分离技术的引入彻底改变了吸尘器行业。这项技术能有效分离空气和灰尘,使吸尘器告别「集尘袋时代」,从需要精细化维护的设备演变为随时可用的家用电器,标志着吸尘器2.0时代的到来。

早期真空吸尘器需要连接巨大的集尘袋 | 图片来源:视觉中国

无线与AI驱动的3.0时代

过去20年,电池和AI技术的快速发展推动吸尘器进入3.0时代。更轻、更小的无线吸尘器和扫地机器人等新品类涌现,使吸尘器在消费端实现跨越式增长,成为大多数家庭的必备清洁工具。

吸尘器的「阿喀琉斯之踵」

尽管历经百年、三代重大迭代,吸尘器仍有一个未解难题:「怕水」。传统吸尘器在处理「干垃圾」(灰尘、毛发、尘螨)时游刃有余,但遇到「湿垃圾」便束手无策。

以生活中常见场景为例:宠物打翻牛奶麦片早餐粥。收拾这种混合粘稠物需要先用毛巾/纸巾处理,再用吸尘器收拾残渣,最后可能还需拖把清洁。这一过程既费时又费力。

大多数用户的清洁流程遵循「先扫(大尘土)、再吸(小毛发)、最后湿拖」的模式,需要频繁更换工具:扫把、吸尘器、拖把/洗地机轮番上阵。

问题在于,工具越来越多,但每个工具能处理的任务却相对有限。消费者真正需要的不是单一功能的专用工具,而是能应对各种复杂场景的多功能清洁设备。

简单说,用户渴望的是便捷的「清洁成果」,而非一张满分的「吸尘」试卷。

突破性创新:可拖地的吸尘器

面对这一痛点,追觅科技近期推出的V30 Pro吸尘器提供了全新思路——一台「可以拖地的吸尘器」。

水气分离技术:解决「怕水」难题

传统吸尘器设计中,液体被吸入后,湿润水汽易导致高速运转电机短路,使机器失效甚至报废。看来,「吸力大」与「应对更多场景」似乎成了相互矛盾的需求。

追觅V30 Pro的创新之处在于其专门研发的刷头。其中集成了一个乒乓球大小的「水气分离装置」——迷宫式气流通道使液体、固体、气体经过时反复碰撞、减速,不同物质在离心力和结构引导下被分离。只有干燥气体能进入后方风道,固液垃圾则留在刷头内的污水箱中。

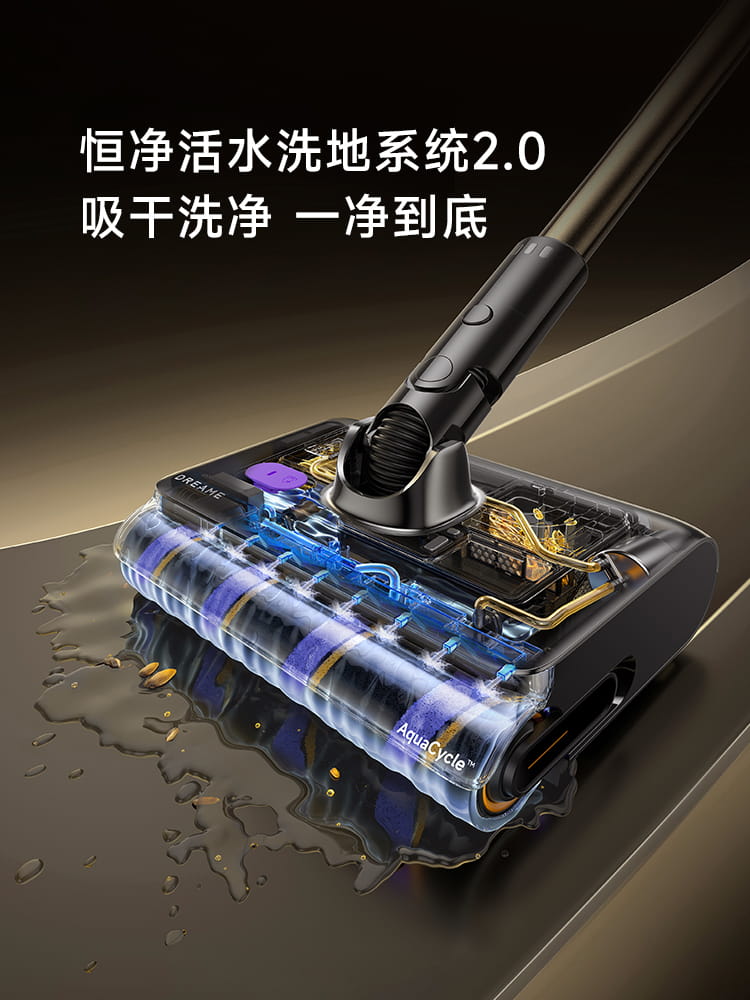

活水洗地系统:实现多功能集成

解决防水问题后,下一步是拓宽服务范围。追觅工程师认为,下一代吸尘器应是「吸尘器+洗地机」的合体,能同时完成地面清洁和湿式清洁。

追觅V30 Pro的解决方案是在刷头内集成小型活水洗地系统,包含清水箱、污水箱、立体喷淋、电动滚刷等,使吸尘器也能完成湿拖工作。这一设计在不改变吸尘器整体结构的基础上,通过极致的集成化处理,在小空间内同时解决防水、除污两大关键问题。

追觅V30 Pro创新刷头设计

用户只需更换两个不同主刷头,就能拥有既能「吸尘」又能「清洁」的新清洁助理,极大拓展了吸尘器的使用场景。

创新逻辑:从参数竞争到用户体验

在已「卷成麻花」的智能清洁赛道中,追觅V30 Pro堪称近年来为数不多的突破性创新。其创新逻辑值得深思:

回归用户视角:没有因参数优势而自鸣得意,而是回到用户视角,找到品类最大痛点——通用性不够、环境适应性不足。

优化工作流程:针对「先扫、再吸、最后湿拖」的繁琐流程,V30 Pro通过更换刷头即可完成两种任务,显著优化工作流程和维护成本。

突破技术瓶颈:重点解决困扰吸尘器已久的技术难题——怕水。通过流体力学和元器件集成化,将混合垃圾中的固、液、气三种物质分离,既保护电机,又便于清理。

追觅V30 Pro实际清洁能力演示

破解「前三代定律」的钥匙

追觅V30 Pro的成功证明:当多数人习惯性蒙眼向前冲时,换一种解题思路会带来意想不到的效果。这种思路转换,或许正是破解消费电子「前三代定律」怪圈的关键。

在技术高度成熟的今天,真正的创新突破不仅是性能参数的提升,更是对用户真实痛点的洞察,以及巧妙落地的工程能力。

结语:科技创新的本质回归

消费电子行业正站在一个十字路口。当参数竞争陷入瓶颈,当创新步伐逐渐放缓,是时候回归科技的本质——解决人类实际问题。

吸尘器从单一功能到多功能集体的演进,正是这一趋势的缩影。未来,那些能真正理解用户需求、通过技术创新解决实际问题的企业,才能穿越周期,赢得用户持久青睐。

这,或许才是科技公司走近用户的真正密钥。