电商江湖的风云变幻中,2025年的双十一故事呈现出前所未有的技术底色。这一年,随着大促周期继续拉长而规则删繁就简,用户参与门槛被极大降低,参与人数攀升至历史峰值6亿。更引人注目的是,这是阿里云首次将芯片、云、PaaS、大模型到顶层agent等全栈AI能力全面接入双十一的世界级实践——全球范围内,从未有过如此大规模生产场景的AI落地。

流量洪峰下的技术保卫战

今年8月,淘宝闪购、飞猪、饿了么并入电商事业群,业务联动产生的化学反应远超预期。原本被视为超级入口降维打击的外卖大战,最终演变为日订单峰值突破1.2亿单的外卖需求,直接拉动手淘日活用户增长20%。这一变化,距离双十一这个电商行业的"春晚"仅剩短短两个月。

与此同时,双十一大促周期提前至十月下旬启动,两大因素叠加导致节点激增、互访增多,云基础设施VPC内的转发网关承载量急剧上升,网元消耗量呈指数级增长。原本看似充裕的180万容量VPC面临崩溃边缘,撞墙风险一触即发。

面对这场无声的基础设施保卫战,阿里云技术团队迅速进入战时状态。摆在团队面前的是两条技术路径:传统的VPC拆分方案,如同将城市按行政区强行割裂,虽能缓解局部压力,但跨域调用需要对集团业务需求做深度梳理,两个月时间显然不够用;另一条路则是打造前所未有的200万VPC级联方案,难度堪比将马路升级为飞机跑道。

阿里云团队选择了更具挑战性的后者,迅速组建攻坚小组,投入技术深海。经过无数次模拟测试与压力验证,团队从软件角度提出了"云网关级联方案":在不影响现有业务的前提下,基于软硬协同技术,通过在网关层扩展多级流表、打通超大VPC的逻辑互联,使网络容量实现弹性扩张,成功将单VPC容量拉升至200万,提前化解了双十一的网络瓶颈。

VPC瓶颈的突破如同打开了算力世界的潘多拉魔盒。基于第八代和第九代ECS实例的业内首个千万核CPU集群得以组网,通过统一资源池+智能调度层,实现了算力的精准分配与高效利用,成功支撑天猫双十一和闪购两大业务双峰的丝般顺滑体验。

随着CIPU(云基础设施处理器)的不断演进和规模化部署,今年双十一上线了千万核CPU算力,规模数量级的扩展标志着阿里云基于CIPU架构的算力进入了全新发展阶段。技术的突破直接换来了用户体验的显著提升:双十一期间,APP打开、操作更顺畅,推荐、营销等核心场景性能提升30%-50%,RT延时降低超30%,每一次添加、删除操作都能即时反馈。

AI全面渗透:首个AI落地的双十一

如果说2023年是大模型元年,那么2025年双十一就是这场AI革命的超级练兵场。它既考验云在海量数据高并发情况下对多元异构算力的高效调度,也考验AI在大规模生产场景的可靠程度与实际效用。

今年双十一,AI全面渗透各个环节,被认为是首个AI全面落地的双十一。从消费者端的"AI万能搜""AI帮我挑",到商家端的智能客服、经营分析,再到平台端的搜索、推荐引擎体系,大模型在整个电商体系中占据了举足轻重的地位。

在商家侧,AI正在成为重要的生产工具。淘宝基于Qwen3家族多款模型打造和升级了生意管家、店小蜜等应用。以生意管家为例,其AI数据分析师为商家提供经营数据分析,可覆盖90%的中小商家核心分析场景,大幅提升分析和决策效率;全新升级的店小蜜能精准连贯理解用户意图、调用平台以及商家工单系统、自动化处理售后问题。

面向商品出海场景,包括通义Qwen-MT在内的多个翻译模型,支持了淘宝出海的商品翻译需求。通过采用混合专家架构与服务调度优化,Qwen-MT单次调用延迟降低40%,为全球用户提供快速、精准、稳定的翻译服务。今年双十一,该模型系统支持了亿级商品的图片、评价、商品详情等翻译任务,单日调用量超14亿次。

这些AI改造不仅提升了用户体验,更让商家经营效率实现了前所未有的提升。从结果来看,大模型在这届天猫双十一中确实打了一场漂亮仗,但这背后的云基础设施能力则是这场仗的另一个胜负手。

要在淘宝这个数亿用户的超级APP上支撑如此大规模的AI应用,并非易事。在这场看不见硝烟的战争中,智算调度成为决胜关键。多级亲和性与拓扑感知调度设计依次上线:多级亲和性调度算法按照NC/交换机/机柜/楼宇/AZ的多层分级,为AI任务规划出最短的算力通勤路线,让GPU卡间的数据传输效率大大提升;拓扑感知技术则时刻扫描网络状态,一旦发现拥塞链路,瞬间为数据重新导航,确保卡时在线率,杜绝任何一丝算力浪费。

灵骏智算深度融合阿里云十余年来在计算、存储与网络虚拟化领域的技术积累,通过系统级的集成与优化,提供稳定、高性能的存储能力与云网络访问能力。最终,灵骏万卡集群在双十一期间实现了业界领先的卡时在线率表现,为首个AI大规模落地的双十一打好了最稳的地基。

全栈AI战略:从双十一到能力溢出

双十一的全栈AI检验对阿里而言只是小试牛刀,事实上阿里描绘的AI蓝图更为宏大。今年,阿里巴巴集团CEO、阿里云智能集团董事长兼CEO吴泳铭在多个场合表态,阿里巴巴正在积极推进三年3800亿的AI基础设施建设计划,并将会持续追加更大的投入。

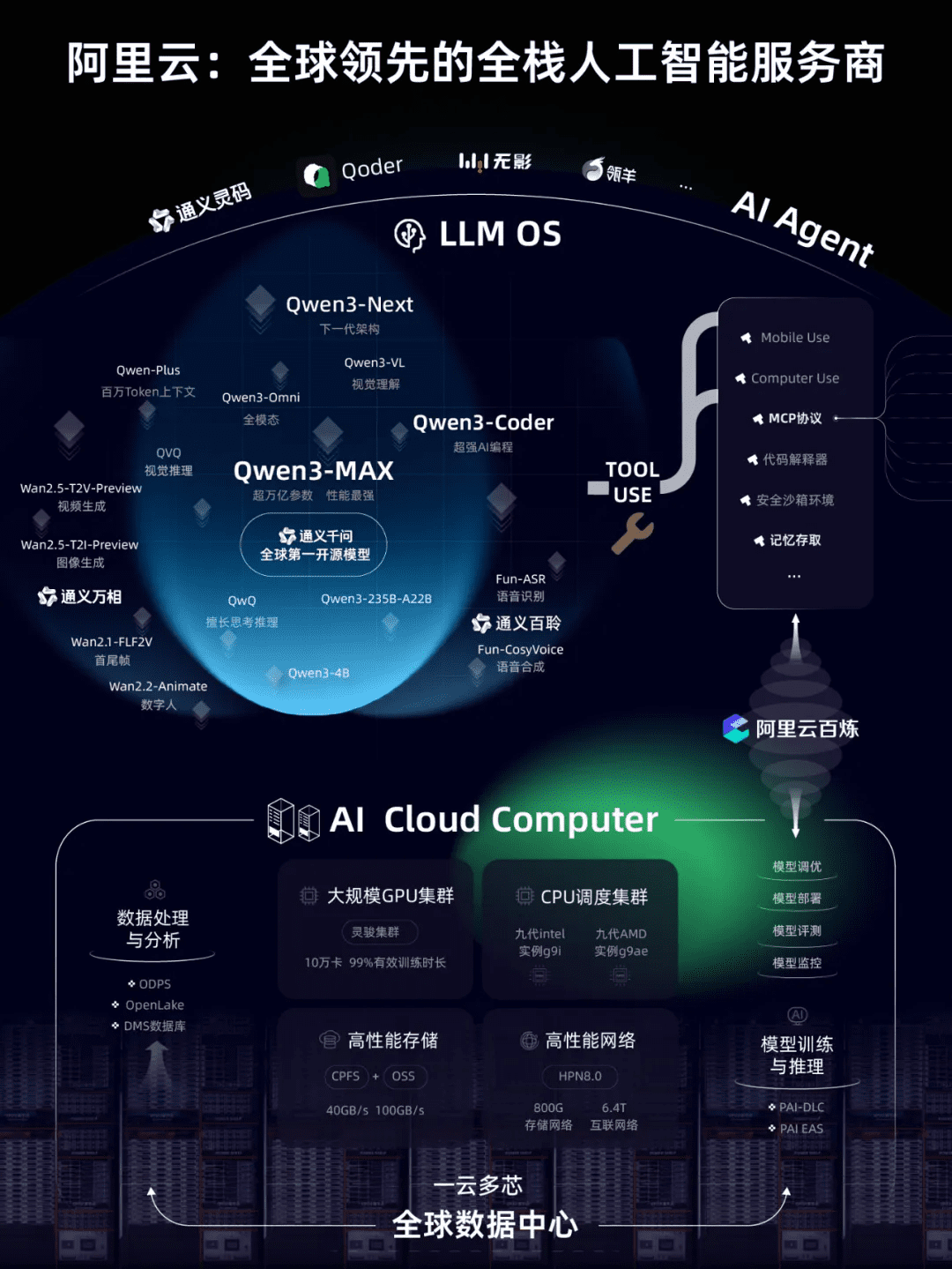

在这个长期规划中,阿里云的定位清晰——全栈人工智能服务商。在模型层面,通义千问坚定开源开放路线,核心目的是打造"AI时代的Android",成为AI生态的基础平台。截至目前,通义千问共开源300多个模型,全球下载量突破6亿次,衍生模型超17万个,超越美国Llama大模型系列,位居全球第一。

在基础设施层面,阿里云全力打造一台全新的AI超级计算机,灵骏智算集群则是这台超级计算机的关键一环。当前,以灵骏为代表的智算产品早已渗透千行百业AI场景,例如自动驾驶是阿里云AI落地进度最快的核心场景之一,市场份额占据绝对优势,绝大部分主流车企、金融企业、物流企业均为其客户。

根据IDC的最新报告,2024年中国AI基础设施(AI IaaS)市场份额,阿里云占比23%,位列中国市场第一,超过第二名和第三名总和;在生成式AI基础设施领域,阿里云取得模型训练和模型推理市场的双项冠军。

这些投入短期来看不仅换来了绝对领先的市场地位,也换来了包括200万VPC以及超千万核CPU调度能力在内的超级能力建设。尽管短期内不会再有如此大体量的单一用户和如此盛大的全民参与活动,但这也正是云服务作为基础设施的意义所在——为业务创新预留技术缓冲带。

站在AI"生物大爆发"的节点当下,我们无法预见未来,就像半导体发明初期无法预见如今人类的手机、电脑中需要纳米级电路在指甲盖大小塞下上亿电路。而作为基础设施,云平台需要前瞻性建设,今天的超级能力建设,是为后续的超级场景埋下的伏笔。

技术演进的未来图景

回顾阿里云十七年双十一的技术演进,从最初的系统保障到如今的全栈AI赋能,每一次技术突破都重新定义了行业边界。双十一不仅是一场商业狂欢,更是技术实力的试金石和展示台。

未来,随着AI技术的进一步发展和应用场景的不断拓展,我们可以预见:一方面,AI将更深度融入电商全流程,从商品推荐、客服到物流配送,实现全链路智能化;另一方面,云基础设施将持续进化,为更复杂的AI应用提供支撑,推动产业数字化转型向纵深发展。

阿里云的实践表明,AI与云服务的深度融合不仅能够提升现有业务效率,更能催生全新的商业模式和用户体验。这种技术溢出效应将不限于电商领域,而是将辐射至金融、医疗、制造等更多行业,加速全社会智能化进程。

在这个AI技术快速迭代的时代,双十一作为全球最大的商业活动之一,其技术演进轨迹某种程度上也预示着未来产业发展的方向。阿里云通过双十一这一超级场景的锤炼,不断突破技术边界,为行业树立了标杆,也为全球AI应用落地提供了宝贵的实践经验。

结语:技术驱动下的商业新生态

2025年双十一的实践证明,全栈AI技术不仅能够应对流量洪峰的技术挑战,更能从根本上重塑商业生态。从消费者体验到商家运营,从基础设施到应用层,AI正在重新定义商业的每一个环节。

阿里云通过十七年的技术积累和创新,在双十一这一超级场景中验证了全栈AI的商业价值。这种价值不仅体现在双十一期间的系统稳定性和性能提升上,更体现在为商家赋能、为用户创造价值的长远影响中。

随着AI技术的不断成熟和应用场景的持续拓展,我们可以期待一个更加智能、高效、个性化的商业新生态。而阿里云作为全栈AI服务的引领者,将继续在这一进程中扮演关键角色,推动技术进步与商业创新的深度融合。