在AI泡沫论甚嚣尘上的今天,业界普遍担忧过度投资可能导致市场崩盘。然而,一个看似矛盾的现实正在上演:谷歌和OpenAI等科技巨头正拼命加速基础设施建设,却仍难以满足日益增长的AI服务需求。这一现象揭示了AI产业发展的深层矛盾与未来走向。

谷歌的惊人扩容目标

在11月初的一次全员会议上,谷歌云副总裁、AI基础设施负责人Amin Vahdat向员工透露了一个令人震惊的目标:公司必须每六个月将服务容量翻倍,才能满足人工智能服务的需求。这一内部信息罕见地揭示了谷歌高管层对AI基础设施发展的战略判断。

Vahdat向员工展示的幻灯片表明,谷歌计划在4-5年内实现算力能力"千倍增长"(1000x scaling)。这一数字本身就已足够雄心勃勃,但Vahdat特别强调了几项关键约束条件:谷歌需要在"基本相同甚至更低的成本、相同甚至更低的能耗水平"下,实现这一能力、计算和存储网络的扩展。

"这不容易,但通过协作和共同设计,我们一定能实现,"Vahdat在会议上对员工表示。这一表态既显示了谷歌面临的巨大挑战,也反映了公司对自身技术实力的信心。

需求本质的复杂性

值得注意的是,谷歌提到的"需求"究竟有多少是来自用户对AI功能的真实兴趣,又有多少是公司将AI功能整合进现有服务(如搜索、Gmail和Workspace)的结果,这一点尚不明确。然而,无论用户是主动使用这些功能还是被动接受,谷歌并非唯一一家难以跟上AI服务用户增长速度的科技公司。

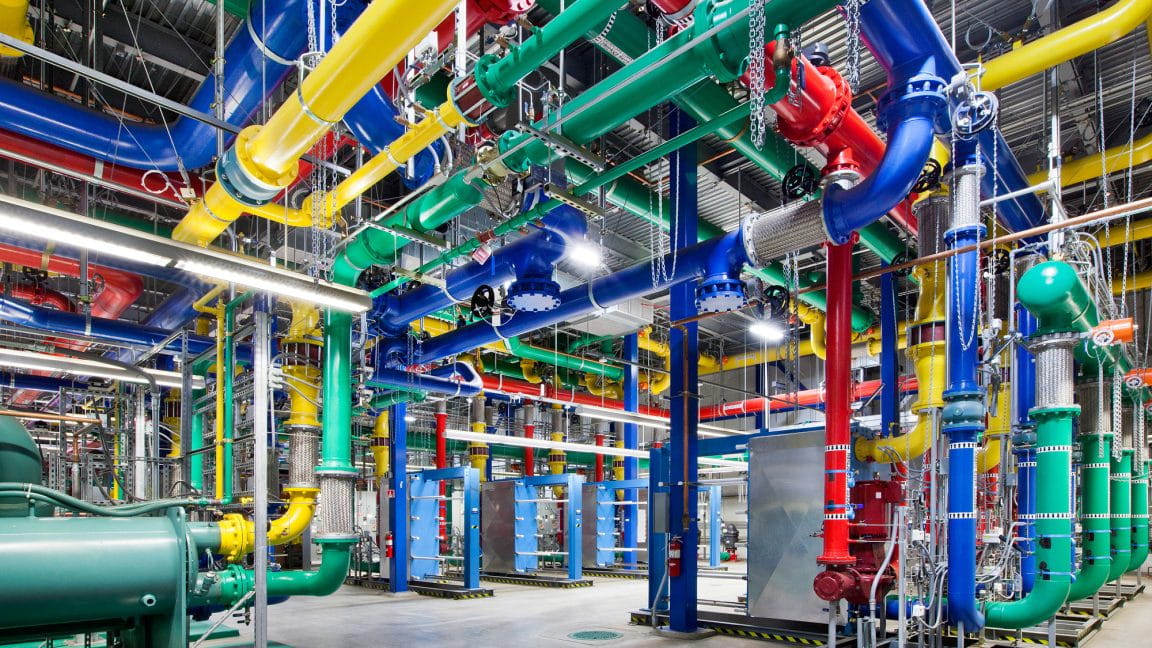

谷歌俄勒冈数据中心的冷却管道系统

谷歌俄勒冈数据中心的冷却管道系统

这种需求增长与基础设施建设的矛盾,实际上反映了AI技术从实验室走向大规模商业应用过程中的必然挑战。当AI技术真正融入日常生活和各行各业,其对算力的需求将呈现指数级增长,这对任何一家科技企业都是严峻考验。

行业巨头的数据中心竞赛

谷歌并非孤军奋战。其主要竞争对手OpenAI正通过其与软银和Oracle的Stargate合作项目,计划在美国建设六个大型数据中心,未来三年内投入超过4000亿美元,目标容量接近7吉瓦。该公司同样面临着服务其8亿周活跃ChatGPT用户的挑战,即使是付费用户也经常遇到视频合成和模拟推理模型等功能的使用限制。

在全员会议上,Vahdat将"AI基础设施的竞争"描述为"AI竞赛中最关键也最昂贵的部分"。这位基础设施高管解释说,谷歌面临的挑战不仅仅是花钱比竞争对手多。

"我们将投入大量资金,"他说,但指出真正的目标是构建"比任何地方都更可靠、性能更高、可扩展性更强的基础设施"。

芯片供应瓶颈与算力困境

AI加速芯片与服务器系统

AI加速芯片与服务器系统

满足AI需求的一个主要瓶颈一直是NVIDIA无法生产足够的AI计算GPU。就在几天前的季度财报中,NVIDIA表示其AI芯片"已售罄",公司正努力满足需求,仅在一个季度内就使其数据中心收入增长了100亿美元。

芯片短缺和其他基础设施限制直接影响了谷歌部署新AI功能的能力。在11月6日的全员会议上,谷歌CEO Sundar Pichai以Veo(谷歌上月获得升级的视频生成工具)为例说明了这一问题。

"当Veo推出时,多么令人兴奋,"Pichai说."如果我们能在Gemini应用中将其提供给更多人,我认为我们会获得更多用户,但我们做不到,因为我们正面临算力限制。"

这一困境揭示了当前AI产业发展的核心矛盾:一方面是用户对AI功能的渴望与需求,另一方面是基础设施建设的滞后与瓶颈。这种不平衡状态将持续影响AI技术的普及速度和应用深度。

谷歌的三重应对策略

在全员会议上,Vahdat的概述了谷歌计划如何实现其雄心勃勃的扩展目标,而不仅仅是简单地向问题砸钱。公司计划依赖三种主要策略:建设物理基础设施、开发更高效的AI模型以及设计定制硅芯片。

1. 物理基础设施扩张

物理基础设施是支撑AI服务的基础。谷歌正在全球范围内扩建数据中心,增加服务器数量,优化网络架构,以提高整体算力供给。这一过程不仅涉及资本投入,还需要考虑能源效率、散热技术、空间利用等多方面因素。

2. AI模型优化

除了硬件扩展,谷歌也在积极开发更高效的AI模型。通过算法优化、模型压缩、知识蒸馏等技术,谷歌希望在保持模型性能的同时,降低对算力的需求。这种"软件优化"策略与硬件扩展相辅相成,共同构成谷歌应对算力挑战的双轮驱动。

3. 定制芯片开发

谷歌最新发布的Ironwood TPU芯片

谷歌最新发布的Ironwood TPU芯片

使用自研芯片意味着谷歌不必完全依赖NVIDIA硬件来构建其AI能力。本月早些时候,谷歌宣布其第七代张量处理单元(TPU)Ironwood已全面可用。谷歌声称,Ironwood比2018年的第一代Cloud TPU"能效提高了近30倍"。

自研芯片代表了谷歌在AI基础设施领域的战略转向。通过定制硬件,谷歌可以更好地优化AI工作负载,降低对第三方供应商的依赖,并在特定领域获得性能优势。这种垂直整合策略是大型科技公司在AI竞赛中的重要布局。

AI泡沫论与战略投资

鉴于业界对潜在AI泡沫的广泛认可,包括Pichai最近在接受BBC采访时发表的评论,谷歌对AI数据中心扩张的激进计划反映了其计算:低估投资的风险超过过度产能的风险。然而,如果需求没有按预期持续增长,这可能是一笔代价高昂的赌注。

在全员会议上,Pichai告诉员工,2026年将是"激烈的一年",他提到了AI竞争以及满足云和计算需求的压力。Pichai直接回应了员工对潜在AI泡沫的担忧,承认这一话题"确实已成为时代精神的一部分"。

这种看似矛盾的态度——一方面承认泡沫风险,另一方面大力投资基础设施——实际上反映了科技巨头对AI未来的复杂判断。他们既看到了短期内的炒作与泡沫,也坚信长期来看AI技术将彻底改变人类社会,因此必须在基础设施上提前布局。

行业竞争格局与未来趋势

当前AI基础设施的竞争格局正在重塑整个科技行业。传统科技巨头如谷歌、微软、亚马逊等凭借其资本优势和技术积累,在AI基础设施领域占据主导地位。同时,新兴AI公司如OpenAI、Anthropic等则通过与大型科技企业合作,加速自身基础设施建设。

未来几年,AI基础设施竞争将呈现以下趋势:

算力需求持续增长:随着AI应用场景不断拓展,对算力的需求将继续保持高速增长态势。

芯片多元化:除NVIDIA外,更多厂商将进入AI芯片市场,包括自研芯片和专用ASIC芯片。

能效成为关键指标:在算力增长的同时,能源效率将成为衡量AI基础设施性能的重要标准。

云服务与边缘计算融合:AI算力将不仅在云端集中部署,也将向边缘设备扩展,形成分布式算力网络。

绿色AI理念普及:随着环保意识增强,"绿色AI"将成为行业发展的重要方向,降低AI模型的碳足迹。

结论:技术变革的必然选择

尽管存在AI泡沫的担忧,但谷歌等科技巨头对基础设施的大规模投入实际上反映了技术变革的必然选择。当一项技术具有颠覆性潜力时,基础设施的超前布局是把握机遇的关键。

AI技术的未来发展不仅取决于算法创新,更依赖于算力基础设施的支持。在这一背景下,谷歌的每半年翻倍扩容目标虽然看似激进,却可能是应对未来AI需求增长的必要举措。随着技术的不断进步和应用的深入,AI基础设施竞赛将推动整个行业向更高效、更可持续的方向发展。

最终,这场算力竞赛的结果将不仅影响科技巨头的市场地位,更将决定AI技术能否真正实现其改变世界的潜力。在这场变革中,平衡短期风险与长期机遇,将是所有市场参与者必须面对的挑战。