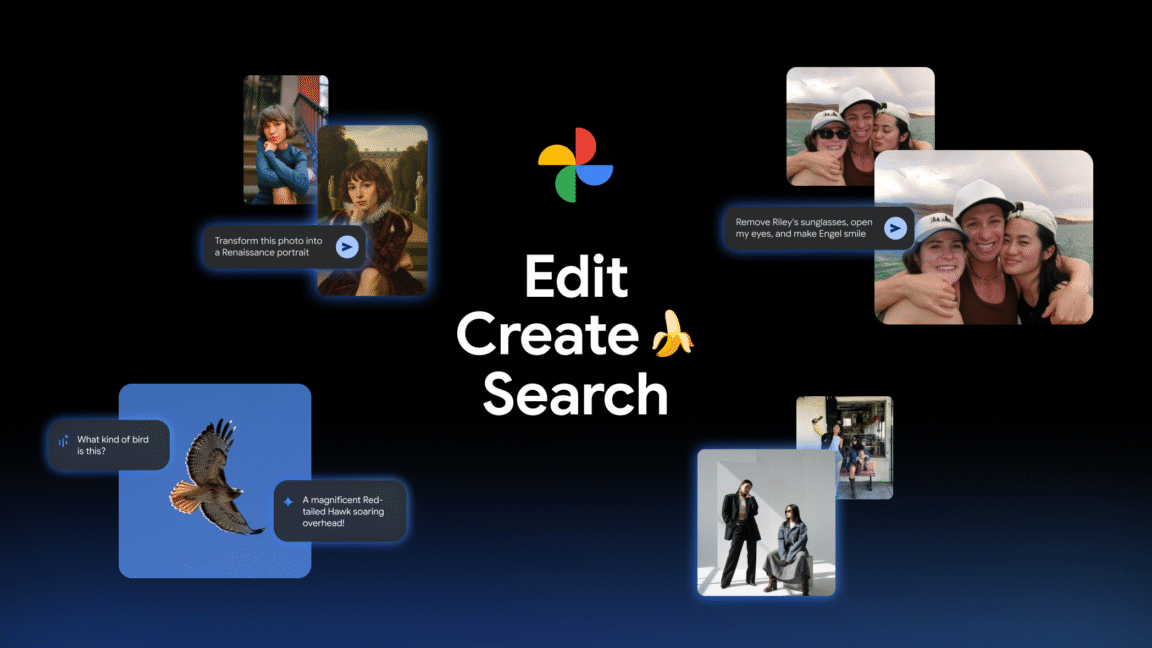

在人工智能技术飞速发展的今天,Google再次引领潮流,将其先进的Nano Banana AI模型集成到Google Photos应用中,为用户带来前所未有的图像编辑体验。这一更新不仅提升了照片处理的智能化水平,更通过自然语言交互降低了专业编辑的门槛,让普通用户也能轻松创作出令人惊艳的图像作品。

Nano Banana:AI图像编辑的新里程碑

Nano Banana作为Google最新的AI图像编辑模型,自今年年初以未品牌化演示形式亮相以来,便在科技圈引起广泛关注。这一技术的核心优势在于其能够理解用户的具体指令并精准执行图像修改任务。与Google Photos之前使用的旧模型相比,Nano Banana不仅编辑效果更加自然,还能更好地理解复杂指令,实现了质的飞跃。

Google早在2025年10月就宣布了将Nano Banana集成到Photos应用的计划,而现在这一承诺终于开始兑现。值得注意的是,这一先进功能并非仅限于Android平台,iOS用户同样能够享受到Nano Banana带来的便利,体现了Google在跨平台AI体验一致性上的努力。

Help Me Edit:从基础编辑到智能对话

Google Photos的"Help Me Edit"功能迎来了重大升级,现在完全由Nano Banana驱动。这一转变意味着用户可以通过自然语言描述来指导图像编辑,而无需掌握复杂的图像处理技巧。例如,用户只需输入"移除Riley的太阳镜",系统就能识别出照片中的Riley(前提是用户已保存该人物的面部信息)并执行相应操作。

这一功能的关键突破在于其对私人面部识别组的访问权限。Google Photos能够识别并记住用户经常接触的人物面部,建立私人面部数据库。当用户在编辑指令中提及这些人物时,系统可以准确识别并执行针对性的编辑操作,大大提升了编辑的精准度和效率。

创意编辑的无限可能

除了基础的图像修改,Nano Banana还支持更为创意的编辑需求。用户可以要求改变整个图像的风格,例如将一张普通的生活照转变为复古风格、艺术画作或特定主题的创意作品。这种从上到下的风格转换能力,让普通用户也能轻松实现专业级的创意效果。

Create with AI:降低AI使用门槛的模板库

尽管Nano Banana功能强大,但并非所有用户都熟悉AI提示词的编写技巧。为了解决这一问题,Google在Google Photos中新增了"Create with AI"板块,提供了一系列预设的AI编辑模板。这些模板基于应用内最受欢迎的编辑类型设计,使用户无需编写复杂指令即可实现专业效果。

热门模板一览

- "将我置于高级时尚摄影中":一键将普通照片转换为时尚大片风格

- "创建专业头像":优化人像照片,突出面部特征,适合职业社交平台

- "将我置于节日贺卡中":将用户照片与节日元素结合,制作个性化贺卡

这些模板不仅简化了操作流程,还为用户提供了创意灵感,帮助他们探索Nano Banana的更多可能性。对于初次尝试AI图像编辑的用户来说,这是一个完美的入门途径。

Ask按钮:全新的图像交互方式

Google Photos还引入了一个全新的"Ask"按钮(注意区别于现有的"Ask Photos"功能)。这一按钮在用户查看照片时出现,提供了一种全新的图像交互方式。点击后,用户可以获取关于照片内容的信息,或查找相关图像,甚至可以描述想要的编辑效果,由Nano Banana即时执行。

Ask按钮与Ask Photos的区别

虽然名称相似,但这两个功能有着明确的区别:

- Ask按钮:针对单张照片的交互工具,提供内容信息和即时编辑功能

- Ask Photos:Google的自然语言搜索功能,可在整个照片库中进行语义搜索

目前,Ask按钮仅在美国地区推出,而Ask Photos则在本周扩展到100多个新国家。这种差异化的区域策略表明Google正在根据不同市场的用户需求进行功能优化。

技术解析:Nano Banana如何实现精准编辑

Nano Banana的成功离不开其先进的技术架构。作为Google最新的AI图像编辑模型,它采用了深度学习算法,能够理解复杂的自然语言指令,并将其转化为精确的图像修改操作。其核心技术优势包括:

- 上下文理解:能够理解指令中的上下文关系,准确把握编辑意图

- 对象识别:精准识别图像中的各种元素,包括人物、物体和场景

- 风格迁移:能够将特定艺术风格应用到原始图像上

- 细节保留:在执行大幅修改时保持图像的细节和质量

用户体验:从技术到实用的跨越

Google在将先进技术转化为用户友好体验方面一直表现出色。Nano Banana的集成也不例外,通过精心设计的用户界面和交互流程,使复杂的AI技术变得简单易用。

普通用户的获益

对于不熟悉图像编辑的普通用户,Nano Banana提供了前所未有的便利:

- 无需学习专业软件,通过自然语言即可实现专业效果

- 预设模板降低了尝试AI功能的门槛

- 私人面部识别使针对特定人物的编辑变得简单

专业摄影师的新工具

对于专业用户,Nano Banana同样提供了有价值的辅助功能:

- 快速实现创意效果,作为灵感的来源

- 简化重复性编辑任务,提高工作效率

- 探索新的视觉风格,拓展创作可能性

市场影响:AI图像编辑的竞争格局

Google在AI图像编辑领域的这一举措,将进一步加剧科技巨头之间的竞争。随着Adobe、Apple等公司也在积极布局AI图像处理技术,消费者将迎来更多创新选择。Nano Banana的推出不仅巩固了Google在AI应用方面的领先地位,也为整个行业设定了新的标准。

未来展望:AI图像编辑的发展方向

基于Nano Banana的技术特点和市场反馈,我们可以预见AI图像编辑的几个未来发展方向:

- 更精准的对象识别:未来版本将能够识别更多类型的对象和场景

- 跨设备协同:在不同设备间同步编辑项目和设置

- 社交功能整合:将AI编辑与社交分享更紧密地结合

- 实时协作编辑:允许多人同时编辑同一项目

实用建议:如何充分利用Nano Banana功能

为了帮助用户充分发挥Nano Banana的潜力,以下是一些实用建议:

- 建立清晰的私人面部组:定期添加和更新重要人物的面部信息,提高识别准确率

- 尝试多样化的指令:不要局限于简单指令,探索更复杂的编辑需求

- 结合模板与自定义指令:以模板为起点,添加个性化细节

- 保存编辑历史:利用版本历史功能对比不同编辑效果

总结:AI赋能的图像编辑新时代

Google将Nano Banana集成到Google Photos,标志着AI图像编辑技术进入了一个新阶段。通过自然语言交互、预设模板和智能识别技术,这一功能不仅降低了专业图像编辑的门槛,还为创意表达提供了全新可能。随着技术的不断进步,我们可以期待未来AI图像编辑将更加智能、精准和个性化,彻底改变我们处理和分享视觉内容的方式。

对于普通用户而言,Nano Banana意味着无需学习复杂软件就能创作出专业级图像;对于专业创作者,它则是一个激发灵感、提高效率的强大工具。无论你是记录生活瞬间的普通用户,还是追求完美图像的专业摄影师,Google Photos的这一更新都将为你带来前所未有的体验。