人工智能领域在2025年迎来了一系列令人瞩目的技术突破,从多模态大模型到专业领域应用,从视频编辑到语言模型,AI技术正在以前所未有的速度重塑各行各业。本文将深入分析近期AI领域的重大创新,探讨这些技术如何改变我们的工作和生活。

北京发布人工智能产业白皮书,产业规模预计超4500亿元

2025年中国人工智能大会在北京召开期间,北京市科学技术委员会正式发布了《北京人工智能产业白皮书(2025)》。这份重要文件全面分析了全球和中国人工智能的发展现状,并指出北京作为全国人工智能企业集聚地,其产业规模正在迅速增长。

白皮书数据显示,北京的人工智能企业数量已超过2500家,形成了完整的产业链和创新生态。预计到2025年底,北京人工智能核心产业产值将超过4500亿元,成为推动数字经济发展的重要引擎。

这一增长主要得益于北京市政府的政策引导和科研创新投入。通过建设人工智能创新平台、培育龙头企业、完善人才引进政策等措施,北京市持续推动人工智能产业的高质量发展。白皮书还强调了人工智能与实体经济深度融合的重要性,提出了在智能制造、智慧医疗、智慧城市等领域的具体应用方向。

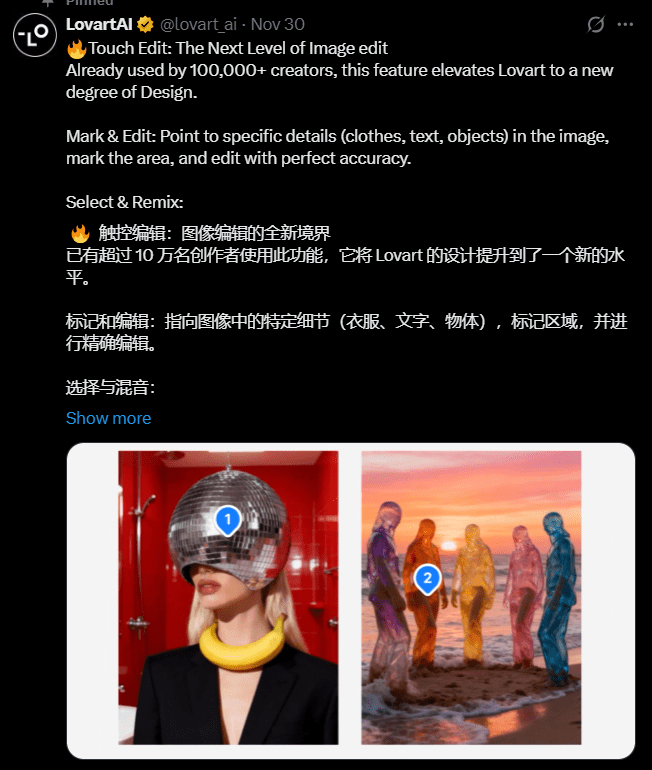

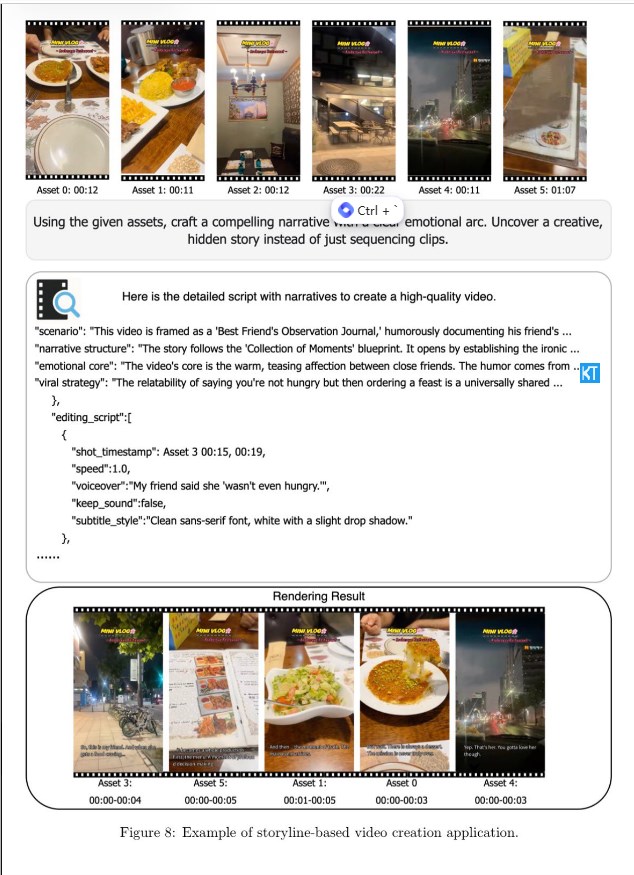

字节跳动发布震动级AI模型Vidi2:120亿参数引领视频编辑革命

字节跳动近期推出了多模态大语言模型Vidi2,拥有120亿参数,专注于视频理解与编辑领域。这一模型的发布被誉为"震动级"创新,因为它彻底改变了传统视频编辑的工作流程,实现了从手动剪辑到自动化编辑的跨越。

Vidi2的核心优势在于其精细的时空定位(STG)功能,能够精确识别视频中的时间戳和目标对象边界框。这意味着用户只需通过简单提示,就能让模型处理长视频并生成短视频或电影片段,大大提升了视频编辑的效率和准确性。

在技术架构上,Vidi2采用Gemma-3作为主干网络,并结合自适应标记压缩技术,确保在处理长视频时既能保持高效运算,又能保留细节信息。这种技术创新使得Vidi2在处理复杂视频场景时表现出色,能够准确识别并跟踪多个对象,理解场景变化,并生成连贯的编辑结果。

基于Vidi2开发的工具已成功应用于TikTok平台,其中Smart Split功能实现了自动剪辑、重构图和添加字幕等功能,极大地提升了内容创作者的工作效率。用户只需上传原始视频,输入简单的编辑指令,Vidi2就能在几秒钟内完成原本需要数小时的人工编辑工作。

西藏首个千亿参数藏语大模型"阳光清言"问世,AI助力高原语言保护

西藏大学与创业团队联合发布了"阳光清言"V1.0,这是西藏首个千亿参数的藏语大模型,标志着人工智能在高原地区迈入新阶段。这一突破性成果为藏语AI发展提供了重要支撑,也为低资源语言的智能化保护提供了高原样本。

"阳光清言"模型覆盖了多领域藏语语料,包括文学、历史、医学、宗教等,能够理解和生成高质量的藏语内容。其参数量突破千亿,远超以往藏语AI模型的规模,这使其能够更准确地把握藏语的语法规则、表达习惯和文化内涵。

这一技术突破将带来多方面的积极影响。首先,在政务办事和远程医疗等领域,藏语民众将能够使用母语与AI系统交互,大大提高了服务的可及性和亲和力。其次,在教育领域,"阳光清言"可以辅助藏语教学,帮助年轻一代更好地传承民族文化。此外,该模型还将促进藏语内容的数字化保存和传播,为文化遗产保护提供技术支持。

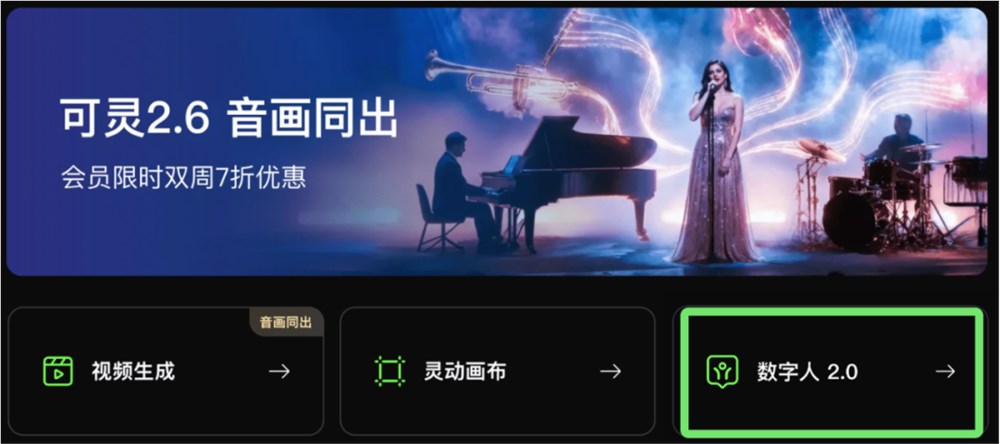

快手Kling Omni即将发布:实现"导演级"精准控制的长视频生成

快手科技旗下Kling AI正式开启"Kling Omni Launch Week",即将推出多模态视频基础模型Kling O1(Omni One)。这一创新模型标志着AI视频创作从随机生成向程序化导演模式的转变,为内容创作者提供前所未有的创作自由度。

Kling O1的核心优势在于其支持文本、图像和视频的多输入参考,实现了导演级的精准控制。用户可以通过多种方式指定视频内容,包括文本描述、参考图像或现有视频片段,模型能够准确理解并执行这些指令,生成符合预期的视频内容。

在技术规格上,Kling O1能够生成长达2分钟的连续视频,远超当前大多数AI视频生成模型的长度限制。同时,它还增强了运动稳定性和风格连贯性,确保生成的视频在长时间播放中保持一致的视觉风格和流畅的运动效果。

音频同步是Kling O1的另一大亮点。该模型集成了原生音频同步技术,确保声音与画面达到帧级精确匹配。这意味着用户可以为视频指定特定的音频,模型会自动调整视频内容和节奏,使画面与声音完美协调,大大提升了视频的专业感和沉浸感。

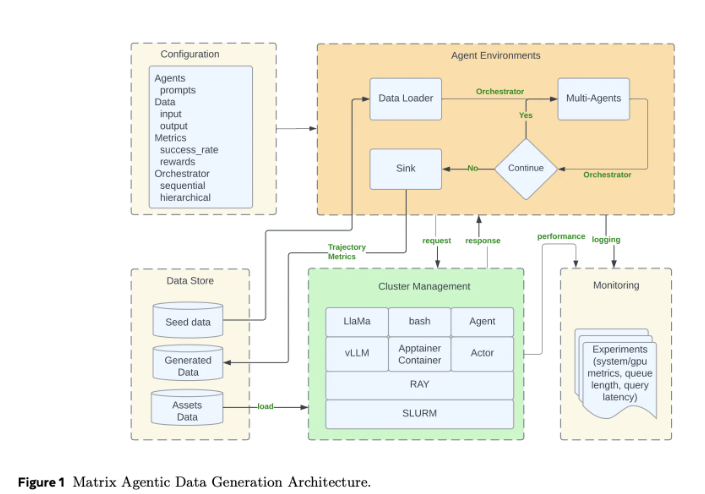

Meta AI推出Matrix框架,革新多智能体合成数据生成

Meta AI近期推出了Matrix框架,这一创新技术通过去中心化的设计解决了合成数据新鲜性和多样性的问题,同时显著提升了令牌吞吐量,为AI训练数据的生成带来了革命性变化。

传统合成数据生成系统通常采用中心调度器模式,这成为性能瓶颈和单点故障的来源。Matrix框架采用去中心化设计,消除了这一限制,使系统能够更高效地处理大规模数据生成任务。

在实际应用中,Matrix框架展现出卓越的性能。在多项案例研究中,该框架实现了2到15倍的令牌吞吐量提升,这意味着在相同时间内能够生成更多的训练数据,大大加速了AI模型的训练过程。这一突破对于需要大量高质量训练数据的大语言模型和多模态模型尤其重要。

Matrix框架充分利用了Ray集群的分布式特性,实现了高效的合成数据生成与处理。通过智能任务分配和负载均衡,该框架能够在保持数据质量的同时,最大化计算资源的利用率,为企业节省了大量训练成本。

国产家庭机器人F1:22个关节完成复杂家务,明年初上市

国产家庭机器人F1的问世标志着家用服务机器人技术的重要突破。这款创新机器人具备22个关节和轮式底盘,能够完成多种家务任务,如扫地、哄娃等,并且能执行复杂的长序列起床任务,为现代家庭提供全方位的智能服务。

F1的技术核心是其RVLA模型架构,这一创新设计使机器人的任务成功率超过94%。与传统机器人不同,F1具备自动重试机制,当遇到障碍或任务失败时,能够智能调整策略并重新尝试,大大提高了服务的可靠性。

在空间利用方面,F1的设计特别考虑了小户型家庭的需求,通过紧凑的结构设计和智能路径规划,能够在有限空间内高效完成各项任务。此外,F1还具备8小时续航能力,能够长时间连续工作,满足家庭日常需求。

市场方面,F1计划于明年Q1上市,定价不到两万元,首批1000台将通过微信小程序进行抢购。这一亲民的价格策略有望使先进的家庭机器人技术进入更多普通家庭。未来,F1还将推出教育模块,拓展其在儿童教育和陪伴领域的应用场景。

豆包升级语音功能:支持四种方言,助力老年人沟通无障碍

豆包App近期对其语音功能进行了重要升级,新增支持粤语、四川话、东北话和陕西话四种地道方言的语音对话功能。这一创新举措大大提升了用户与AI之间的交流体验,尤其对不熟悉普通话的老年人群体提供了极大便利。

豆包语音模型采用了创新的方言迁移技术,能够根据用户意图灵活切换方言。这意味着即使在与标准普通话对话时,AI也能理解并回应方言表达,实现了真正的双向无障碍沟通。

在技术实现上,豆包团队通过先进的ASR(自动语音识别)技术提升了方言识别的准确率,并结合深度学习模型优化了方言语音的合成质量。这使得AI生成的方言语音不仅准确,而且自然流畅,接近人类表达。

除了技术升级,豆包团队还通过举办奖学金活动支持科技人才培养,将奖学金总额提升至20万元。这一举措体现了字节跳动对AI人才培养的长期承诺,也为行业可持续发展注入了新动力。

豆包手机助手发布技术预览版,开启手机AI交互新体验

豆包团队正式推出豆包手机助手的技术预览版,这一创新产品旨在为用户提供更高效的交互体验和更加丰富的功能。该助手依托于豆包大模型的强大能力,并结合了手机厂商的系统授权,力求打造全新的使用体验。

搭载豆包手机助手的nubia M153工程样机已少量发售,面向开发者和感兴趣的用户。这款设备展示了AI助手与手机硬件深度融合的可能性,用户可以通过自然语言指令完成各种手机操作,从简单的拨打电话、发送信息,到复杂的日程管理、内容创作等。

豆包团队表示,将持续优化助手功能,并与多家手机厂商合作,推动手机助手的成熟落地。未来,我们可能会看到更多集成豆包手机助手的新机型问世,为用户提供更加智能、便捷的移动体验。

结语:AI技术多元化发展的未来趋势

从北京发布的人工智能产业白皮书到字节跳动的Vidi2模型,从快手的Kling Omni到西藏的"阳光清言",从Meta的Matrix框架到国产家庭机器人F1,再到豆包的方言语音和手机助手,我们看到了AI技术多元化发展的清晰趋势。

这些创新不仅展示了AI技术的强大能力,也反映了行业从通用模型向专业领域应用的转变。未来,AI技术将更加注重垂直领域的深度应用,解决特定场景下的实际问题。同时,多模态交互、低资源语言支持、边缘计算与AI的结合等方向也将成为技术创新的重点。

随着这些技术的不断成熟和普及,人工智能将更加深入地融入我们的日常生活和工作,创造更大的社会价值。对于开发者和企业而言,把握这些技术趋势,积极探索应用场景,将是在AI时代保持竞争力的关键。