人工智能领域正在经历一场前所未有的技术革命,各大科技公司纷纷推出创新产品和应用,推动AI技术在内容创作、人机交互和日常生活中的深度融合。本文将深入探讨近期AI领域的重大突破,从视频生成模型到智能眼镜,从多模态交互到语音技术,全面解析这些创新如何改变我们的数字生活。

视频生成技术的突破:从文本到影像的跨越

腾讯元宝HunyuanVideo1.5:一句话生成视频的新时代

腾讯元宝团队最新推出的HunyuanVideo1.5模型标志着视频生成技术的重要里程碑。这一创新功能允许用户仅通过一句话或一张图片即可生成5至10秒的高清视频,彻底改变了传统视频创作的高门槛和复杂流程。HunyuanVideo1.5基于Diffusion Transformer(DiT)架构,拥有8.3亿个参数,展现了腾讯在AI生成领域的深厚技术积累。

这一技术的意义不仅在于降低了视频创作的门槛,更为普通用户和专业内容创作者提供了全新的创作可能性。想象一下,社交媒体营销人员可以快速生成产品展示视频,教育工作者能够即时创建教学动画,甚至个人用户也能轻松将自己的创意转化为动态影像。这种技术民主化趋势正在重塑内容创作生态,使视频表达变得更加普及和个性化。

视频生成技术的应用前景与挑战

HunyuanVideo1.5的出现引发了对视频生成技术未来发展的广泛讨论。从技术角度看,这类模型面临着几个关键挑战:首先是生成视频的时长限制,目前5-10秒的时长虽然足以展示创意,但无法满足长视频内容的需求;其次是视频连贯性和一致性问题,如何在多帧之间保持视觉逻辑的连贯性仍需技术突破;最后是版权和伦理问题,AI生成内容的版权归属和使用边界亟待明确。

然而,挑战与机遇并存。随着技术的不断进步,我们可以预见视频生成模型将朝着更长时长、更高分辨率、更复杂叙事的方向发展。未来的视频生成技术可能不仅能够生成静态场景,还能模拟物理交互、情感表达甚至复杂的故事情节,这将彻底改变影视制作、广告创意、游戏开发等多个行业的工作流程。

多模态AI的演进:从文本到全方位感知

谷歌Nano Banana Pro:4K时代的多模态革命

谷歌最新推出的Nano Banana Pro模型代表了多模态AI技术的最新进展。基于Gemini 3架构,这一模型不仅支持4K分辨率输出,还实现了14对象融合和5人身份一致性保持等高级功能。更令人瞩目的是其新增的联网搜索与C2PA验证功能,使AI模型能够实时获取网络信息并验证内容来源,大大提升了生成内容的准确性和可信度。

Nano Banana Pro的专业控制功能尤为值得关注,用户可以在提示词中精确指定机位、景深、焦点、光效与色彩分级等参数,默认提供6张高保真成片供选择。这种精细化的控制能力使得AI生成的图像不仅质量高,而且能够满足专业创作者的特定需求。联网生成功能则打破了AI模型与实时信息之间的壁垒,使生成的图像能够包含最新的信息,如实时股价、新闻事件等。

多模态AI的技术架构与突破

多模态AI的核心挑战在于如何有效整合不同类型的数据(文本、图像、音频等)并理解它们之间的复杂关系。Nano Banana Pro的成功在于其采用了更先进的注意力机制和跨模态融合技术,使模型能够同时处理和理解多种输入信息。

从技术架构来看,这类模型通常包含三个关键组件:多模态编码器负责将不同类型的输入转换为统一的表示形式;跨模态注意力机制允许模型在处理一种模态时参考其他模态的信息;生成模块则基于这些综合信息输出最终结果。这种架构的优化和创新是推动多模态AI性能提升的关键。

智能交互设备的创新:AI眼镜与输入法的进化

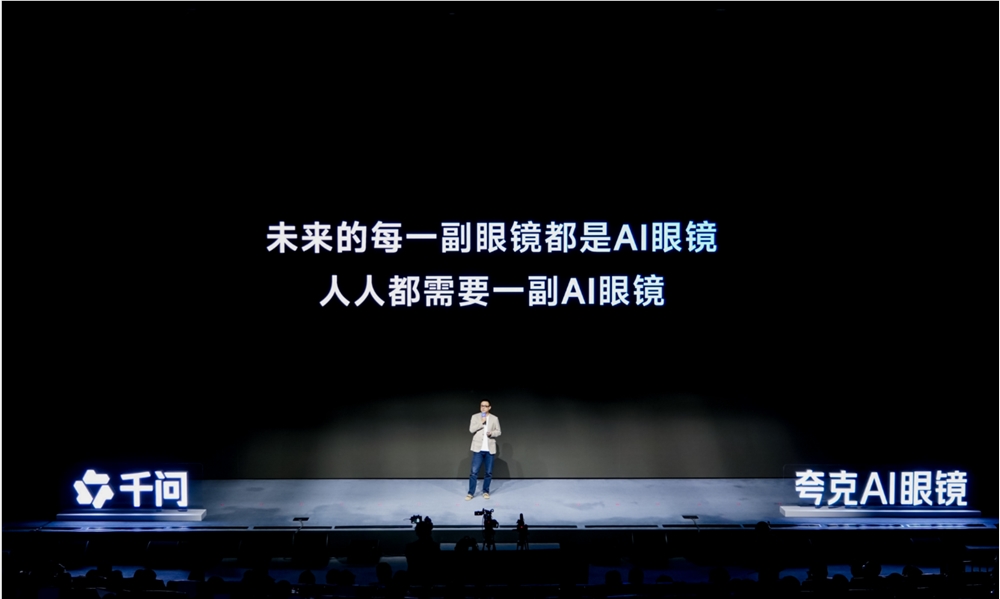

夸克AI眼镜与高德合作:重新定义出行体验

夸克AI眼镜与高德地图的深度合作展示了AI技术在垂直领域的创新应用。通过新增导航投屏功能,用户可以将导航信息直接投射到眼镜视野中,实现手机与眼镜的无缝连接。更令人印象深刻的是导航方向会随头部转动自动调整,这一创新极大地提升了步行和骑行时的便捷性与安全性。

这种交互方式的革命性在于它将数字信息与物理世界无缝融合,创造了一种"增强现实