在数字化转型的浪潮中,AI Agent正成为企业提升生产力的关键引擎。2025年12月,全球最大云厂商亚马逊云科技(AWS)在re:Invent大会上发布了一系列围绕AI Agent的重大更新,标志着云计算正式进入Agent时代。这些更新不仅涵盖了面向客户的Agent应用和平台工具,还包括了支撑这些Agent运行的新一代基础设施。本文将深入分析AWS如何通过具体产品解决企业痛点,以及其基础设施升级如何支撑Agent大规模落地,更重要的是,AWS如何为Agent时代建立'可控、可信'的基本法则。

Agent应用与治理:从模型到可控的'数字员工'

AI Agent的价值已不再是传统的'聊天',而在于'行动'。今年re:Invent期间,AWS发布了一系列围绕Agent构建的产品和应用,将Agent融入到各类传统平台和工具中,实现技术升级,提高生产效率。

三个关键场景的Agent应用

针对企业数字化经营中最耗时、最复杂的三个领域:代码运维、应用现代化和客户服务,AWS推出了一系列Agent产品,每个产品都针对特定场景提供了创新解决方案。

代码与运维领域的Agent革命

在代码和运维领域,AWS发布了多个Agent产品,其中Kiro Autonomous Agent值得关注。传统的AI编程工具虽然能写代码,但往往把开发者变成了忙于搬运上下文和协调工具的'助理'。而Kiro Autonomous Agent解决了这个问题,它可以被视为团队中一位24小时待命、过目不忘的'影子开发者'。

开发者只需专注于核心难题,把修Bug、跨库变更等繁琐任务直接丢给它。它不仅能在后台自主规划并执行,还能像真人一样记住跨会话的上下文,通过连接Jira和Slack深度学习团队的业务逻辑与协作规范。随着每一次代码审查,它会越来越懂团队的产品和标准,真正成为团队共享的'超级大脑',让开发者只做决策,不再打杂。

AI Agent正在改变传统编程方式,让开发者专注于核心创新

DevOps Agent则是另一个重要创新。从国内的'双11'到海外的'黑五',大型数字营销活动背后,技术运营人员熬夜加班已经成为常态。当下的模式是系统监测预警,技术人员需要随时待命处理每一个问题。而AWS DevOps Agent像是一个永不眠的运维员工,可以24小时调查事故和识别运营问题,从而大幅减少需要提报告给运营人员的警报数量,让后者可以更轻松更高效地处理那些真正有价值的问题,而非一直被一些没什么意义的警报轰炸。

应用现代化领域的Agent突破

Agent还在重塑企业的核心资产——传统应用。今天很多企业面临沉重的'技术债务',很多传统应用的工作负载都运行在大型机、VMware等传统服务器上,云迁移虽是趋势,但也是巨大的负担。而Amazon Transform Agent就像一位专业的'全能代码重构工程师',能够对任何代码、API、语言、甚至企业自有的编程语言或框架进行定制化转换。

这种能力将传统应用现代化的速度提升至5倍,减少80%的时间和成本。对于拥有大量遗留系统的企业而言,这意味着可以更快地拥抱云原生架构,享受云计算带来的弹性、可扩展性和成本优势。

客户服务领域的Agent升级

在客服领域,Amazon Connect的新Agent帮助这个产品实现了能力飞跃。此次Amazon Connect一口气发布了四项更新,包括用更先进的语言模型提供更加自然、类人的对话体验;同时让AI掌握工具从而完成整理材料、执行常规流程等工作,让其与真人员工更好地协作;以及基于历史行为和点击流等构建客户画像,让AI可以提供更加个性化的推荐。

另外,随着企业部署越来越多AI Agent参与客户交互,理解其决策过程对保障服务质量与合规至关重要。Amazon Connect新增AI Agent可观测性功能,为企业提供高度透明度——清晰呈现AI的理解内容、使用的工具以及决策过程。这种可见性帮助企业优化性能、确保合规,并增强对AI交互体验的信心。

Agent治理与评估:建立'数字员工'的行为边界

随着Agent获得执行企业操作的权限,可控性和可信赖性成为其规模化落地的首要前提。AWS本次发布的重点在于:对Agent的约束,必须从传统的'内容安全'转向更高级的'行为治理'。

AWS正在构建全面的Agent治理体系,确保企业安全部署AI Agent

AWS推出的Policy in AgentCore功能,正是针对Agent行为治理的新工具。它允许用户使用自然语言来设定Agent的行为边界。这与传统安全护栏(Guardrails)仅过滤语言内容不同,Policy可以简单地创建和管理Agent运行策略,并在Agent工作流中进行实时检查,确保Agent的操作始终在预设的权限范围内。

例如,企业可以设定'退款金额不得超过1000元'或'只能访问特定客户数据'等规则,Agent在执行任务时会自动检查这些约束条件。这种基于自然语言的策略设定方式,降低了技术门槛,让更多业务人员能够参与到Agent的治理中。

此外,为了确保Agent在实际工作中的表现,AWS还推出了AgentCore Evaluations。这项服务允许基于真实世界的行为对Agent的工作质量进行持续检查和评估,为企业规模化部署Agent提供了可靠的性能衡量标准。

通过这一系列治理工具,AWS试图告诉企业:AI Agent是可以信任的。只要设置了明确的'红线',平台就能保证Agent的行为始终在安全边界之内。

基础设施升级:构建AI应用生态的算力和模型'基石'

如果说Agent是台前的'数字员工',那么支撑它们日夜运转的基础设施就是幕后的'超级工厂'。今年AWS在基础设施层面的动作,似乎在向行业传达一个信号:要让Agent真正普及,不仅要让它变得聪明,更要让企业'用得起'且'不论用什么模型都能跑得好'。

算力革新:Agent时代的性价比之选

Agent时代对算力的消耗模式发生了根本改变。过去,企业关注的是'训练'一个大模型需要多少张卡;而在Agent时代,成千上万个Agent需要24小时在线,进行持续的推理、规划和工具调用。推理成本如果居高不下,Agent就无法大规模落地。

AWS Trn3 UltraServer采用3nm工艺,为Agent大规模部署提供强大算力支持

Matt Garman在会上宣布,AWS正式推出了由第四代AI芯片驱动的Amazon EC2 Trn3 UltraServer。作为AWS首款采用3nm工艺制造的AI芯片,Trainium3实际上是在构建一种比通用GPU更具性价比的算力替代方案。每颗芯片提供2.52 PFLOPs的FP8计算能力,配合144 GB内存(比上一代提升1.5倍),它完美契合了Agent应用中长上下文架构和多模态推理的需求。

Trn3 UltraServer服务器最多可以集成144颗Trn3芯片,并可以通过EC2 UltraClusters扩展至数十万颗。而对于企业最关心的成本问题,Trn3在Bedrock上的表现是:相比Trn2,性能提升3倍,每MW能耗的输出Tokens数提升超过5倍。对于目前AI算力昂贵的挑战,Trn3的推出可以起到明显的降低作用。

模型战略:'自研强模型+全球全明星模型托管'

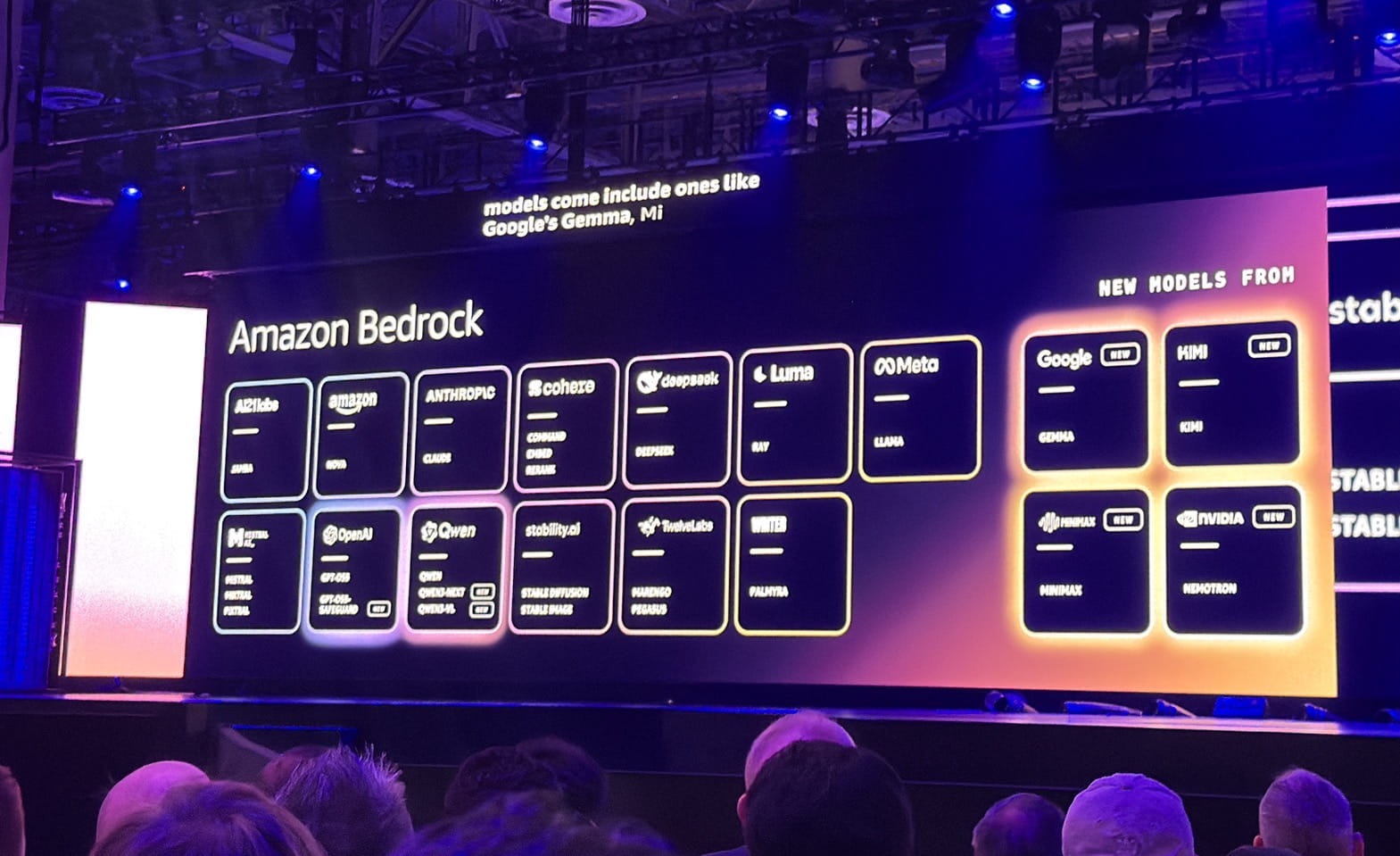

在模型层面,AWS再次证明了自己是'最开放的AI平台'。通过Amazon Bedrock,AWS打出了一套'自研强模型+全球全明星模型托管'的组合拳。

自研模型方面,AWS正式发布了下一代Amazon Nova 2模型家族。其中包括了针对Agent语音交互优化的Nova 2 Sonic——这是一款新一代的speech-to-speech模型,它不仅具备行业领先的对话质量和更低延迟,还能实现实时、人类般的语音对话。

此外,AWS还推出了Amazon Nova Forge,首次引入了'开放式训练模型'理念。它解决了企业'既想深度定制又怕灾难性遗忘'的痛点。与今天大多专有模型依赖后训练的精调或者接入专用数据库不同,Forge允许开发者访问Nova训练检查点,并在训练的每一个阶段将自有数据与Amazon精选的数据集深度融合,从而训练出既理解业务又保留大模型智能水平的专属模型。

AWS Bedrock平台托管了全球顶尖AI模型,为企业提供丰富选择

中国AI模型的全球舞台

今年AWS展现出对中国本土AI模型前所未有的拥抱。在Bedrock新增的18个完全托管模型名单中,三家中国公司的四个模型名列其中:

- 月之暗面的Kimi K2思考模型:具备深度推理能力,能在使用工具的同时进行思考。

- MiniMax AI的MiniMax M2模型:适合Coding和自动化场景,擅长多文件编辑和长工具调用链,被视为开发者Agent的强力大脑。

- 阿里巴巴的Qwen模型:其中的Qwen3-VL能将屏幕截图直接转换为可运行的代码,并自动执行界面点击操作,是自动化UI操作的神器。

过去,全球云厂商往往更倾向于绑定少数几家欧美头部模型厂商。而AWS此次将Kimi、MiniMax、Qwen等中国顶尖模型纳入核心库,不仅是因为这些模型在性能上已经具备了全球竞争力,更显示了AWS'互联互通'的生态格局。

对于企业而言,这意味着选择权的极大丰富。无论是需要Mistral Large 3这样的长文档处理专家,还是需要中国本土的优秀模型,AWS Bedrock正在变成一个打破地域和技术栈隔阂的'万能转换插座',让算力和模型真正成为像水电一样的资源。

当喧嚣退去,AWS正在为AI Agent制定'基本法'

乍看之下,今年的re:Invent似乎显得有些'波澜不惊'。这里没有令人瞠目结舌的参数大跃进,也没有颠覆认知的'黑科技'突袭。

Trn3的性能提升固然强悍,但基本也在预期之内;更有性价比的Nova 2和首次推出的语音模型,虽然让人眼前一亮,但在如今SOTA模型遍地跑、参数竞赛白热化的行业背景下,似乎也算不上'核弹级'的重磅发布。即便是最受关注的AI编程工具Kiro和Agent开发平台AgentCore,也多是基于既有产品的更新——这些关于安全性、可观测性或辅助功能的修修补补,难免让人产生'没什么大动作'的错觉。

然而,这种'平淡'或许正是AWS最厉害的地方。当我们将视线从单个产品移开,投向整个产业,会发现AWS其实在定义下一代基础设施的路上,迈出了极为关键的一步。

从'技术玩具'到'商业实战'

AWS做对的第一件事,是率先打破了Agent的'空谈'阶段。在大多数平台还在比拼Agent框架的灵活性、推理速度时,AWS敏锐地意识到:企业需要的不是一个能聊天的机器人,而是一个能干活的员工。于是我们看到,Transform Agent被用来解决棘手的技术债务,DevOps Agent被用来处理繁琐的运维报警。

AWS正在通过具体实践展示Agent在企业环境中的真实价值

AWS不再只是提供一个简单的LLM接口,而是将行业Know-how(如19年的运维经验、代码迁移经验)封装进Agent,将其打造成了真正能解决具体业务痛点的'成品工具'。这种'将能力封装为产品'的思路,标志着Agent从技术玩具正式迈向了商业实战。

Agent时代的治理范式

更深层的变革在于Agent治理。Agent的运行范式与过去的Chat类应用和传统的云计算业务有着本质区别。传统的云关注'资源',Chat应用关注'内容',而Agent关注的是'行动'。将一个拥有自主决策权的Agent放入企业的核心业务流,其风险不亚于招聘一名不受控的员工。难点不在于如何让Agent跑起来,而在于如何让它不乱跑。

AWS在本次大会上展示的Policy功能,实际上是在尝试重新定义一套Agent时代的治理范式。这种用自然语言设定边界的方式,不再是死板的代码约束,而更像是给数字员工颁布一套'法律'。它让管理者可以用人类的逻辑(如'退款金额不得超过1000元')来约束AI的行为。

这种治理模式的建立,比单一模型的性能提升更具战略意义——因为只有解决了'可控性'和'合规性'这两个拦路虎,企业才敢真正让Agent接入核心业务。

生态位的抢先占领

最终,当我们重新审视这次re:Invent,会发现它的意义不在于某个单品的参数碾压,而在于生态位的抢先占领。当大多数玩家还沉浸在解决架构优化和算力堆叠的'基建期'时,AWS已经通过一系列真实的落地案例和完善的治理技术栈,开始为行业'打样'——它展示了一个Agent在真实企业环境中,应该如何被构建、如何被管理、以及如何产生价值。

AWS正在构建的Agent生态系统,将成为企业数字化转型的关键基础设施

这或许不是一场充满噱头的发布会,但对于渴望用AI提效的实体产业而言,AWS正在构建的那套让Agent'可用、可控、可信'的基础设施,可能是通往未来的真正门票。当喧嚣退去,真正推动产业变革的,往往是那些看似平淡却深思熟虑的战略布局。