卢浮宫盗窃案:一场关于认知与分类的社会学实验

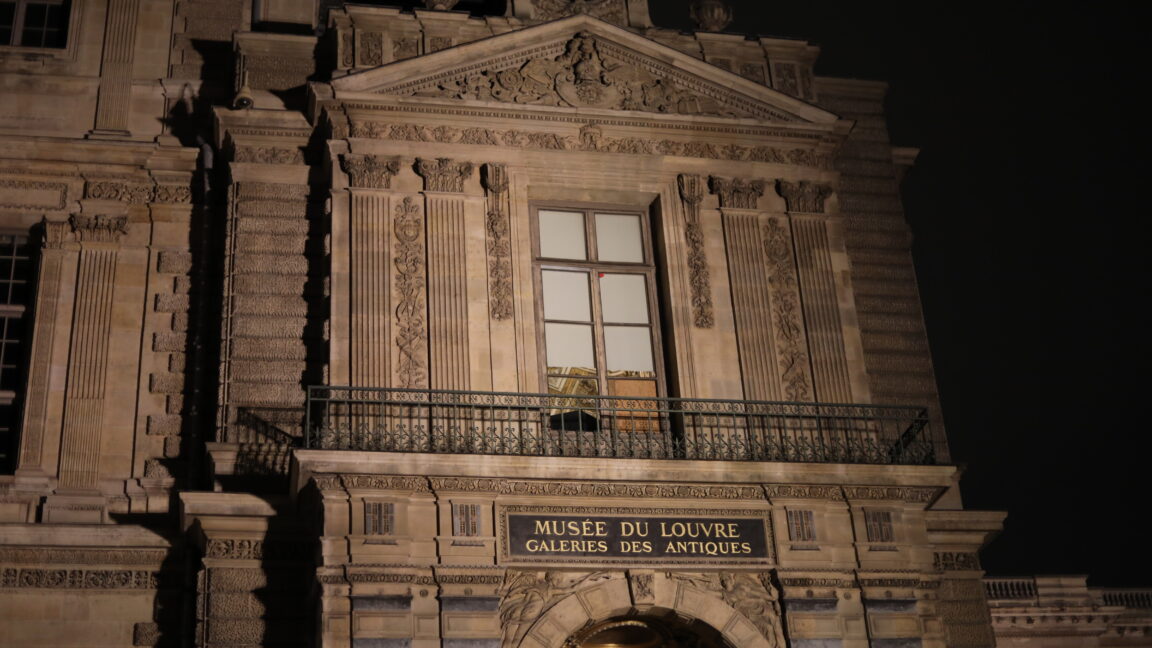

2025年10月19日的一个阳光明媚的早晨,四名男子走进世界上参观人数最多的博物馆,短短八分钟后,他们带着价值8800万欧元(约合1.01亿美元)的皇冠珠宝离开。这一发生在巴黎卢浮宫——全球安保最严密的文化机构之一——的盗窃案震惊了世界。更令人惊讶的是,游客们继续浏览展品,安保人员没有反应(直到警报被触发),盗贼们在人们意识到发生了什么之前就消失在了城市的车流中。

盗贼的心理战术:伪装的艺术

调查人员后来揭示,盗贼穿着高能见度背心,伪装成建筑工人。他们带来了一台家具升降机,这在巴黎狭窄的街道上是常见的景象,并用它到达了一个俯瞰塞纳河的阳台。身着工人服装的他们看起来仿佛本就属于那里。

这一策略之所以奏效,是因为我们并非客观地看待世界。我们通过类别——通过我们期望看到的事物来看待世界。盗贼理解了我们视为'正常'的社会类别,并利用它们来避免怀疑。许多人工智能系统也以同样的方式运作,因此容易犯类似的错误。

社会学家欧文·戈夫曼(Erving Goffman)会用他的'自我呈现'概念来描述卢浮宫发生的事情:人们通过采用他人期望的线索来'表演'社会角色。在这里,对常态的表演成为了完美的伪装。

社会学视角下的视觉认知

人类持续进行心理分类,以理解人和事。当某事物符合'普通'类别时,它就会从注意中溜走。

用于面部识别和检测公共区域可疑活动等任务的人工智能系统以类似方式运作。对人类而言,分类是文化的;对AI而言,分类是数学的。

但两种系统都依赖于学习到的模式而非客观现实。因为AI学习关于谁看起来'正常'和谁看起来'可疑'的数据,它吸收了嵌入其训练数据中的类别。这使得它容易受到偏见的影响。

卢浮宫的盗贼之所以不被视为危险,是因为他们符合受信任的类别。在AI中,同样的过程可能产生相反的效果:不符合统计规范的人变得更显眼,受到过度审查。

这可能意味着面部识别系统不成比例地将某些种族或性别群体标记为潜在威胁,而让其他人畅通无阻。

AI作为社会类别的镜子

社会学视角帮助我们认识到这些问题并非孤立的。AI不会发明自己的类别;它学习我们的类别。当计算机视觉系统在安全录像数据上训练,其中'正常'由特定的身体、服装或行为定义时,它会重现这些假设。

正如博物馆的警卫因为盗贼看起来属于那里而忽略了他们,AI也可能忽略某些模式,同时对其他模式过度反应。

分类,无论是人类还是算法性的,都是一把双刃剑。它帮助我们快速处理信息,但也编码了我们的文化假设。人和机器都依赖于模式识别,这是一种高效但不完美的策略。

从AI的社会学视角来看,算法就像镜子:它们反映我们的社会类别和等级制度。在卢浮宫案例中,这面镜子朝向我们。盗贼成功不是因为隐形,而是因为通过常态的棱镜被看见。用AI术语来说,他们通过了分类测试。

从博物馆大厅到机器学习

感知与分类之间的联系揭示了关于我们日益算法化世界的某些重要信息。无论是警卫决定谁看起来可疑,还是AI决定谁看起来像'小偷',基本过程都是相同的:根据感觉客观但实际上是文化学习的线索,将人分配到不同类别。

当AI系统被描述为'有偏见'时,这通常意味着它过于忠实地反映了这些社会类别。卢浮宫盗窃案提醒我们,这些类别不仅塑造我们的态度,还塑造了什么会被注意到。

盗窃发生后,法国文化部长承诺安装新摄像头并加强安保。但无论这些系统变得多么先进,它们仍然依赖于分类。某人或某物必须决定什么构成'可疑行为'。如果这一决定依赖于假设,同样的盲点将持续存在。

分类思维的胜利与启示

卢浮宫盗窃案将被铭记为欧洲最引人注目的博物馆盗窃案之一。盗贼成功是因为他们掌握了外表的社会学:他们理解常态的类别并将其作为工具。

通过这样做,他们展示了人和机器如何可能将 conformity( conformity 应为 conformity,意为一致性或从众)误认为安全。他们在光天化日之下的成功不仅是计划的胜利,也是分类思维的胜利,这种逻辑既 underlying( underlying 应为 underlying,意为基础的)人类感知,也 underlying 人工智能。

教训很明确:在教会机器更好地'看见'之前,我们必须首先学会质疑我们如何'看见'。

超越卢浮宫:认知与技术的共同进化

卢浮宫盗窃案不仅是一个引人入胜的犯罪故事,更是一个关于人类认知与人工智能发展的深刻案例。它揭示了我们在设计AI系统时面临的核心挑战:如何避免将人类认知中的偏见和盲点编码到算法中。

当我们在开发更强大的AI识别系统时,我们需要认识到这些系统本质上是在学习我们的分类方式。这意味着,如果我们希望AI能够超越人类的认知局限,我们需要首先审视和改进我们自己的分类系统。

在安全领域,这一认识尤为重要。无论是物理安全还是网络安全,我们都需要重新思考'正常'与'异常'的定义。卢浮宫的盗贼提醒我们,最有效的威胁往往是最不被注意的,因为它们符合我们对'正常'的期望。

重新思考分类:从效率到包容

分类思维的高效性使其成为人类认知和AI系统的基础,但这种效率是有代价的。当我们过度依赖分类时,我们可能会忽视个体差异,导致对不符合主流规范的群体的不公平对待。

在AI领域,这一问题表现为算法偏见。当AI系统在主要由某一群体创建的数据上训练时,它可能会强化现有的社会偏见。例如,面部识别系统可能在识别不同种族和性别的面孔时表现不均,这是因为训练数据中的不平衡反映了社会中的历史偏见。

解决这一问题需要多管齐下。首先,我们需要确保AI训练数据的多样性和代表性。其次,我们需要开发能够识别和减轻算法偏见的工具和方法。最重要的是,我们需要培养一种批判性思维,不仅质疑AI的决策,也质疑我们自己的分类方式。

从卢浮宫到未来:构建更公平的认知与技术体系

卢浮宫盗窃案提供了一个独特的机会,让我们反思人类认知与AI系统之间的复杂关系。它提醒我们,技术进步必须伴随着认知进步。如果我们希望创建真正公正和有效的AI系统,我们需要首先理解并改进我们自己的认知模式。

在未来的发展中,我们需要重新思考分类的目的。分类不应是为了排除和标记'异常',而应是为了理解和包容多样性。这意味着我们需要发展一种更加细致和灵活的分类方式,能够捕捉复杂性和灰色地带,而不是简单地将事物划分为'正常'或'异常'。

卢浮宫的盗贼展示了分类思维的力量,但也暴露了其局限性。通过他们的故事,我们可以学到宝贵的一课:在追求效率和确定性的同时,我们不能忽视认知的复杂性和人性的多样性。只有当我们学会以更加包容和批判性的方式思考,我们才能创建真正服务于人类需求的AI系统。