新一代AI芯片架构的技术突破

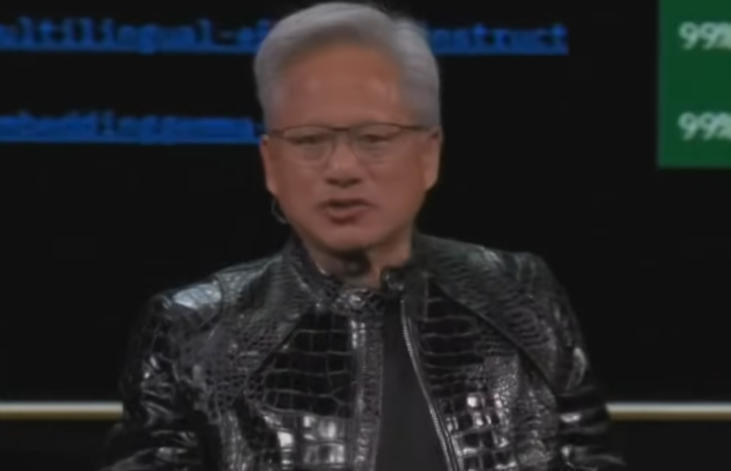

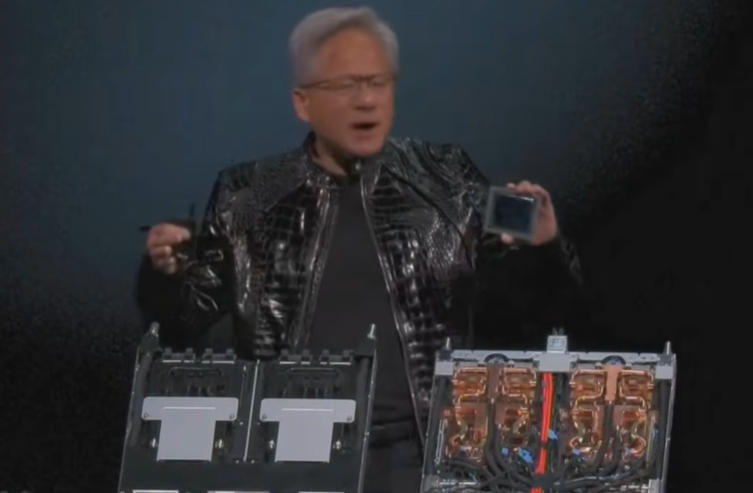

在拉斯维加斯CES展会上,英伟达公布的Vera Rubin平台引发行业震动。该平台通过六芯片集成设计实现架构革新,相较于Blackwell平台,其训练性能提升3.5倍的同时,AI推理token生成成本最高可降低10倍。这种跨越式进步主要得益于三大技术创新:

- 动态缓存分配技术:实现显存资源的实时智能调度

- 混合精度运算矩阵:将FP8与INT4计算单元深度融合

- 光追加速引擎:专为生成式AI的并行运算优化设计

中美芯片博弈的新战场

尽管H200芯片已获准对华出口,但其实际市场前景仍存变数。美国智库进步研究所数据显示,H200性能虽达H20的6倍,但成本增幅达82%。这种性价比落差正在催生两种市场现象:

- 互联网巨头加速自研芯片步伐

- 国产替代方案的市场接受度持续提升

华为最新发布的昇腾920芯片实测数据显示,其在典型AI推理场景下的能耗比已达到H200的76%。

开源生态对芯片架构的影响

黄仁勋在演讲中特别强调开源模型的革命性作用:"DeepSeek R1等开源框架正在改写行业规则,它们与顶尖闭源模型的差距已缩短至6个月。"这种技术演进对芯片设计提出新要求:

class OpenSourceOptimizer:

def __init__(self, chip_arch):

self.support_risc_v = True

self.quantization_level = 'FP4'全球竞争格局的重构压力

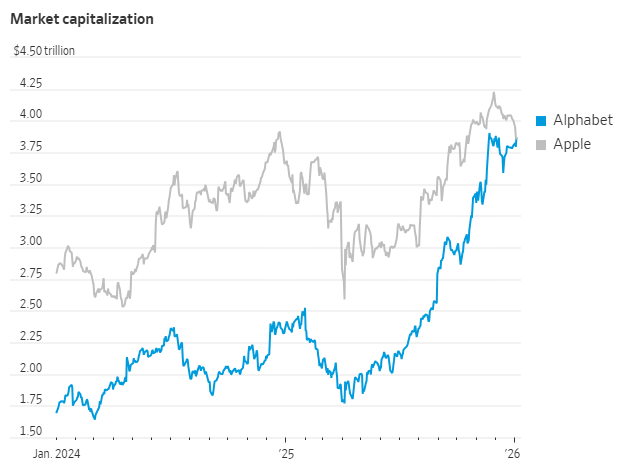

根据IDC最新报告,2026年全球AI芯片市场规模预计突破2000亿美元,但市场格局正在发生结构性变化:

| 厂商 | 2025市占率 | 技术优势领域 |

|---|---|---|

| 英伟达 | 68% | 大规模模型训练 |

| AMD | 19% | 异构计算集群 |

| 华为 | 7% | 边缘智能场景 |

| 其他 | 6% | 特定垂直领域 |

供应链安全的双重挑战

美国政府对H200出口设置的25%收益分成条款,实际上构建了新型技术壁垒。这种政策导向正在驱动中国科技企业采取两大应对策略:

- 技术路线创新:阿里达摩院最新研发的"无界"架构,实现CPU/GPU/NPU的指令集融合

- 产业生态重构:字节跳动建立的芯片设计开源社区,已吸引超过200家上下游企业加入

值得关注的是,工信部近期发布的《智能计算中心建设指南》明确提出,2027年前要实现关键计算部件国产化率不低于70%。这一政策导向将为国产芯片创造超过300亿元的市场空间。

未来技术演进方向

从行业发展趋势看,下一代AI芯片将呈现三个显著特征:

- 存算一体架构的规模化应用

- 光子计算与传统芯片的异构集成

- 自适应功耗管理技术的突破

台积电3nm制程的量产进度显示,采用新工艺的Rubin芯片晶体管密度将提升至2.1亿/mm²,这为上述技术演进提供了物理基础。