在人工智能领域,视频生成技术正以惊人的速度发展。其中,阿里通义开源的万相首尾帧模型(Wan2.1-FLF2V-14B)无疑是这一领域的一颗璀璨新星。该模型以其独特的首尾帧生成视频能力,为创意视频制作、广告营销、影视特效等多个领域带来了前所未有的可能性。本文将深入剖析万相首尾帧模型的技术原理、功能特点、应用场景以及未来发展趋势,带您领略AI视频生成的魅力。

万相首尾帧模型:化想象为现实

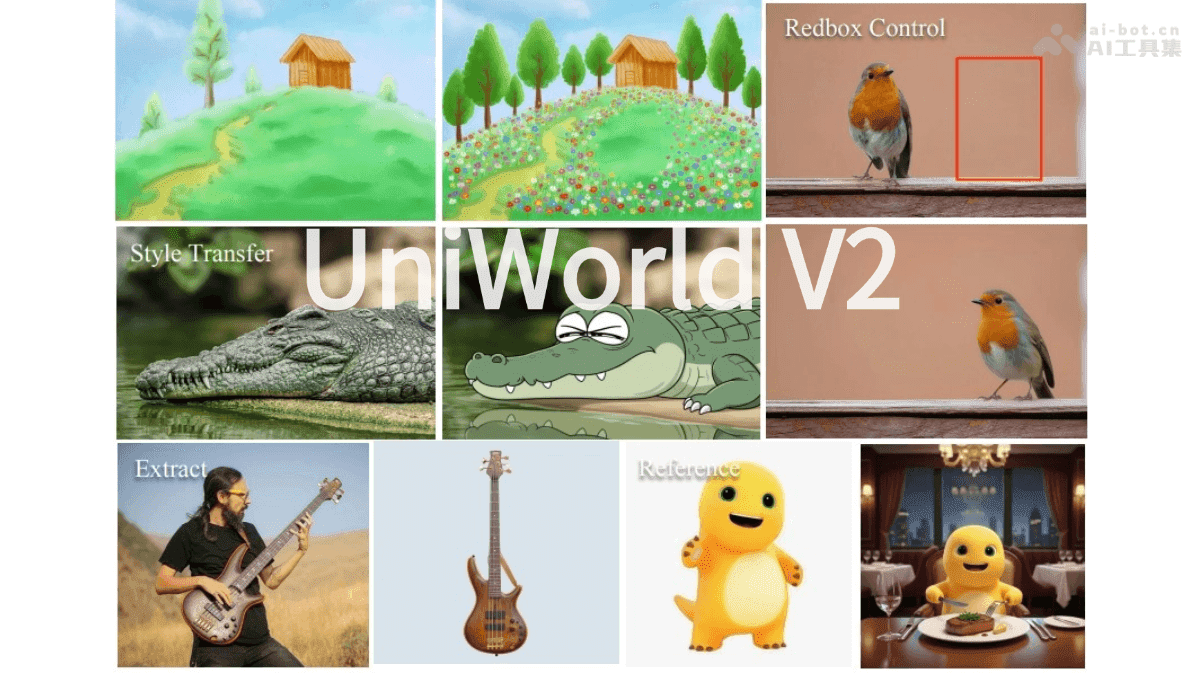

万相首尾帧模型,顾名思义,其核心功能是根据用户提供的首帧和尾帧图像,自动生成流畅、高清的视频过渡效果。这一技术的突破,极大地简化了视频制作流程,降低了创作门槛。用户只需提供视频的起始和结束画面,万相模型即可智能地生成中间的过渡帧,形成完整的视频内容。更令人兴奋的是,该模型还支持多种风格和特效变换,用户可以根据自己的需求,轻松创作出写实、卡通、漫画、奇幻等各种风格的视频作品。

万相首尾帧模型的出现,无疑为视频创作领域注入了新的活力。它不仅为专业视频制作人员提供了更高效的工具,也让普通用户能够轻松实现自己的创意,将想象变为现实。

技术原理:DiT架构与高效视频压缩

万相首尾帧模型之所以能够实现如此强大的功能,离不开其背后先进的技术原理。该模型的核心架构基于DiT(Diffusion in Time)架构,这是一种专门用于视频生成的深度学习模型。DiT架构通过Full Attention机制,能够精准地捕捉视频中的长时程时空依赖关系,确保生成视频在时间和空间上的高度一致性。这意味着,视频中的物体运动轨迹、光影变化等细节都能够得到精确的模拟,从而呈现出更加自然、真实的视觉效果。

除了DiT架构,万相模型还引入了高效的视频压缩VAE(Variational Autoencoder)模型。VAE模型能够在保证视频质量的前提下,显著降低运算成本,提高生成效率。这使得高清视频的生成变得更加经济且高效,为大规模的视频生成任务提供了可能。

此外,万相模型还采用了条件控制分支和交叉注意力机制等技术,进一步提升了视频生成的质量和可控性。条件控制分支允许用户通过提供首帧和尾帧图像,来引导视频的生成过程,实现流畅且精准的首尾帧变换。而交叉注意力机制则能够提取首帧和尾帧的CLIP语义特征,并将其注入到DiT的生成过程中,从而确保生成视频在语义和视觉上与输入的首尾帧保持高度一致。

主要功能:风格多样与细节复刻

万相首尾帧模型的功能十分强大,以下是几个主要的功能点:

- 首尾帧生视频:这是模型最核心的功能,能够根据用户提供的首帧和尾帧图像,生成时长5秒、720p分辨率的自然流畅视频。用户只需简单上传两张图片,即可获得一段高质量的视频内容,极大地简化了视频制作的流程。

- 支持多种风格:万相模型支持生成写实、卡通、漫画、奇幻等多种风格的视频。用户可以根据自己的需求,选择不同的风格,创作出独具特色的视频作品。这为用户提供了更大的创作空间,满足了不同场景下的需求。

- 细节复刻与真实动作:万相模型能够精准地复刻输入图像的细节,并生成生动自然的动作过渡。这意味着,视频中的人物表情、物体纹理等细节都能够得到 максимально accurate 的还原,让视频更加真实、生动。

- 指令遵循:万相模型还支持基于提示词控制视频内容。用户可以通过输入提示词,来控制视频中的镜头移动、主体动作、特效变化等,从而实现更加精细化的视频创作。这为用户提供了更大的创作自由度,让他们能够更好地表达自己的创意。

应用场景:创意视频与广告营销

万相首尾帧模型具有广泛的应用前景,以下是几个典型的应用场景:

创意视频制作:万相模型可以帮助用户快速生成场景切换或特效变化的创意视频。例如,用户可以上传一张日出时的照片和一张日落时的照片,万相模型即可生成一段从日出到日落的延时视频。这为创意视频制作提供了极大的便利,让用户能够轻松创作出引人入胜的视频内容。

广告与营销:万相模型可以用于制作吸引人的视频广告,提升视觉效果。例如,广告商可以上传一张产品图和一张用户使用该产品的照片,万相模型即可生成一段展示产品功能和使用效果的视频广告。这能够有效地吸引用户的注意力,提高广告的点击率和转化率。

影视特效:万相模型可以用于生成四季交替、昼夜变化等特效镜头。例如,影视制作人员可以上传一张春天的照片和一张冬天的照片,万相模型即可生成一段从春天到冬天的季节变化视频。这能够为影视作品增添更多的视觉效果,提升作品的艺术价值。

教育与演示:万相模型可以用于制作生动的动画效果,辅助教学或演示。例如,教师可以上传一张化学反应前的物质照片和一张反应后的物质照片,万相模型即可生成一段展示化学反应过程的动画视频。这能够帮助学生更好地理解抽象的概念,提高学习效果。

社交媒体:万相模型可以用于生成个性化视频,吸引粉丝,提升互动性。例如,用户可以上传一张自己的照片和一张喜欢的风景照片,万相模型即可生成一段自己与风景融合的个性化视频。这能够吸引更多的粉丝关注,提高用户的社交影响力。

项目地址:GitHub与HuggingFace

对于对万相首尾帧模型感兴趣的开发者和研究人员,可以通过以下链接获取更多信息:

- GitHub仓库:https://github.com/Wan-Video/Wan2.1

- HuggingFace模型库:https://huggingface.co/Wan-AI/Wan2.1-FLF2V-14B-720P

在GitHub仓库中,您可以找到万相模型的源代码、文档和示例。通过研究这些资源,您可以深入了解万相模型的技术原理和实现细节,并尝试对其进行修改和扩展。

在HuggingFace模型库中,您可以找到预训练的万相模型权重。您可以直接使用这些权重来生成视频,也可以基于这些权重进行微调,以适应特定的应用场景。

训练与推理:数据并行与分片并行

万相首尾帧模型的训练过程采用了数据并行(DP)与完全分片数据并行(FSDP)相结合的分布式策略。这种策略能够有效地利用多台机器的计算资源,加速模型的训练过程。具体来说,训练过程分为三个阶段:

- 第一阶段:混合训练,学习掩码机制。在这个阶段,模型主要学习如何根据掩码来填充视频中的缺失部分。这为后续的首尾帧生成奠定了基础。

- 第二阶段:专项训练,优化首尾帧生成能力。在这个阶段,模型主要学习如何根据首尾帧来生成中间帧。这能够提高生成视频的流畅性和自然度。

- 第三阶段:高精度训练,提升细节复刻与动作流畅性。在这个阶段,模型主要学习如何更好地复刻输入图像的细节,并生成更加流畅的动作过渡。这能够提高生成视频的质量和真实感。

在推理阶段,万相模型可以高效地生成720p、5秒的视频切片。用户只需提供首尾帧图像,即可在短时间内获得高质量的视频内容。

未来展望:AI视频生成的无限可能

万相首尾帧模型的出现,标志着AI视频生成技术进入了一个新的阶段。随着技术的不断发展,AI视频生成将在未来发挥越来越重要的作用。我们可以预见,未来的AI视频生成将具有以下几个发展趋势:

- 更高的生成质量:未来的AI视频生成模型将能够生成更高分辨率、更高帧率、更加真实的视频内容。这将使得AI生成的视频更加接近真实视频,甚至难以区分。

- 更强的可控性:未来的AI视频生成模型将具有更强的可控性,用户可以通过更加灵活的方式来控制视频的生成过程。例如,用户可以通过自然语言描述来指定视频的内容、风格和特效。

- 更广泛的应用场景:未来的AI视频生成技术将被应用到更多的领域。例如,在游戏开发中,AI可以自动生成游戏场景和角色动画;在电影制作中,AI可以辅助特效制作和场景渲染;在教育领域,AI可以生成个性化的教学视频。

万相首尾帧模型是AI视频生成领域的一个重要里程碑。它不仅展示了AI在视频生成方面的强大能力,也为未来的AI视频生成技术发展指明了方向。随着技术的不断进步,我们有理由相信,AI将在视频创作领域发挥越来越重要的作用,为人类带来更加丰富多彩的视觉体验。